基础模型(Foundation Models, FM)已成为现代机器学习的核心,带来了零样本与小样本学习等强大能力。这些范式在泛化性与鲁棒性方面具有显著优势。然而,它们的广泛应用也带来了关键风险,包括隐私泄露、非预期记忆以及版权争议。

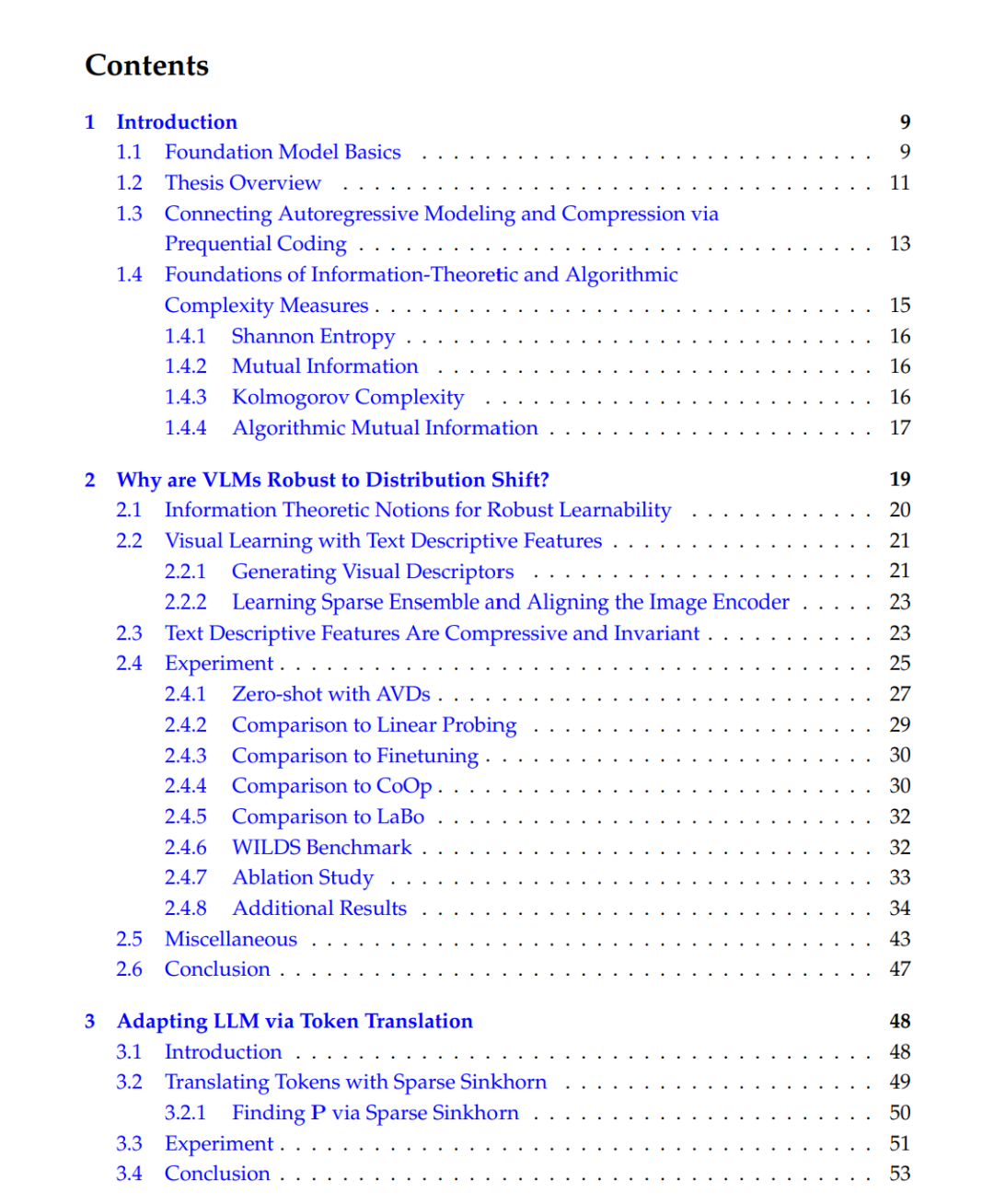

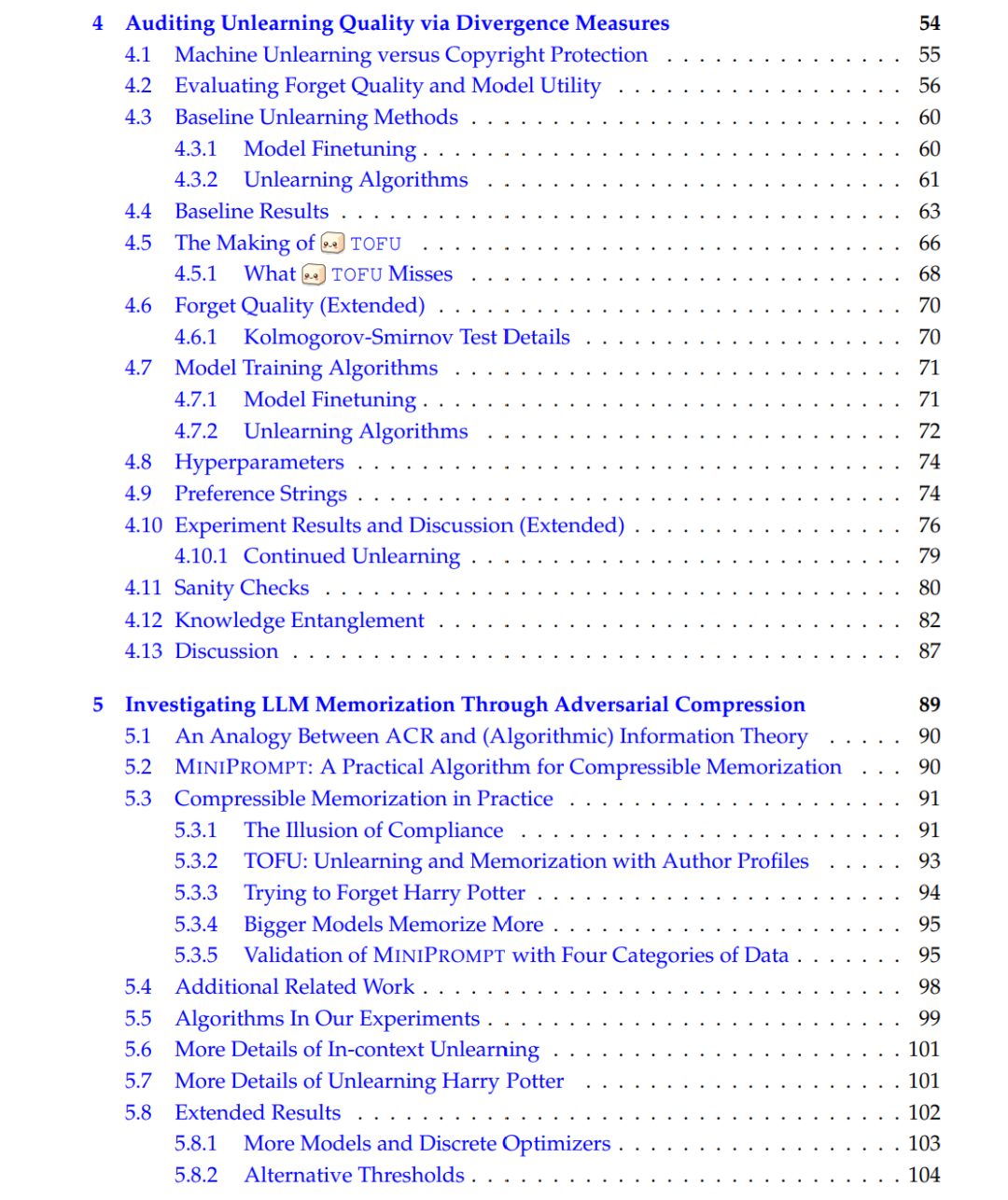

本论文从信息论的视角分析基础模型,聚焦于三个相互关联的领域:鲁棒性、隐私与版权/内容保护。首先,我们研究了在分布偏移(training 与 test 分布不一致)下的对比视觉-语言模型,并提出基于信息论的度量方法,用于量化并提升模型鲁棒性。

随后,我们将视角转向大语言模型(LLMs),其生成特性与大规模参数使得隐私与知识产权问题尤为突出。在这一背景下,我们首先从分词(tokenization)的角度研究其分布外(OOD)适应问题。我们分析了 OOD 数据如何导致更差的分词压缩率(以 token 数量衡量),从而造成计算效率下降。针对这一问题,我们提出了一种基于最优传输(optimal transport)的分词自适应方法,该方法不依赖平行数据。

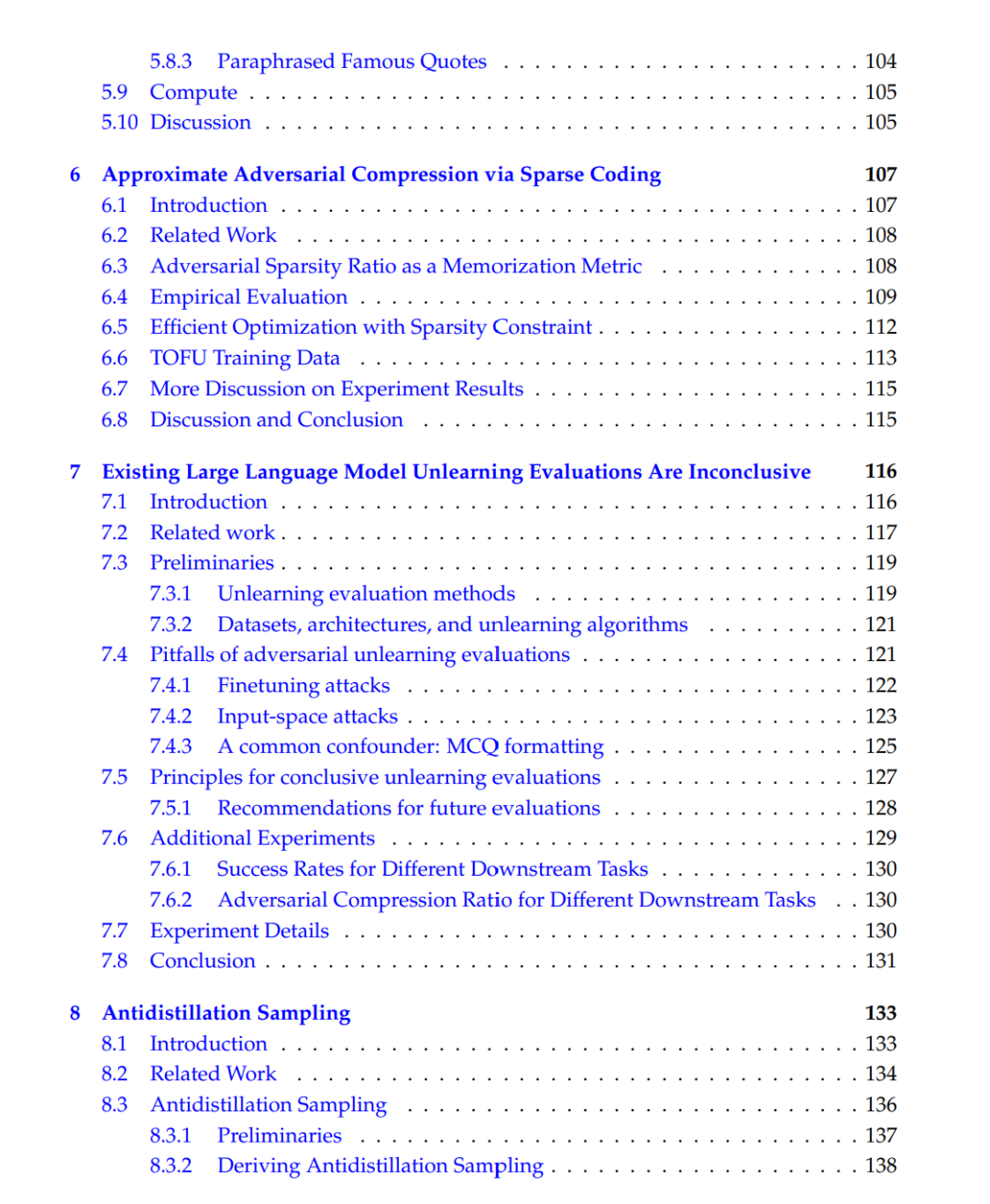

除了分布偏移,AI 安全性也是本论文的另一核心关注点。在这一方面,我们首先探讨了遗忘(unlearning),即遗忘特定训练数据的任务。我们提出了一种高效的基于散度的审计工具,并展示了现有遗忘算法往往未能完全移除隐私信息。接着,我们研究了大语言模型中的记忆(memorization)现象,并提出了一种基于压缩的对抗式提示框架,用于度量压缩性记忆(compressive memorization)——这是版权侵权与安全风险的重要指标。为提升可扩展性,我们进一步引入了一种基于 token 稀疏性的高效近似方法。最后,我们考察了模型蒸馏中的内容风险,并提出反蒸馏采样(antidistillation sampling),通过扰动生成分布来阻止模型蒸馏器复制专有的推理轨迹。 综上所述,本论文提出了一个系统的信息论框架,用于理解并缓解基础模型中的关键脆弱性,为提升模型的鲁棒性、安全性与合规性提供了理论基础与实践工具。