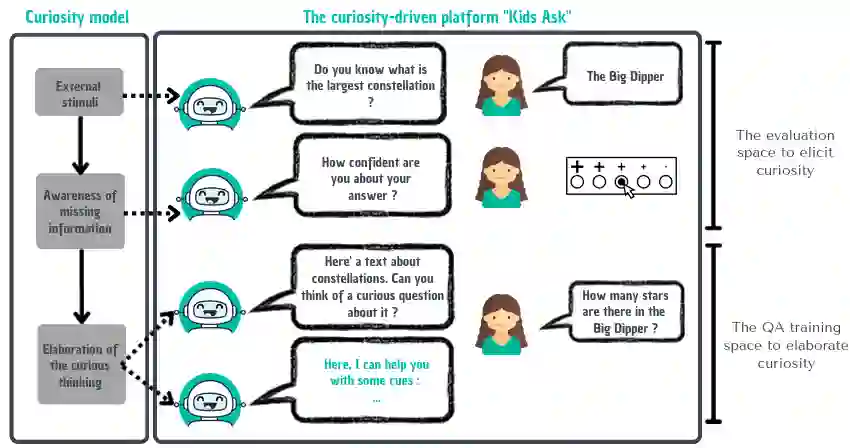

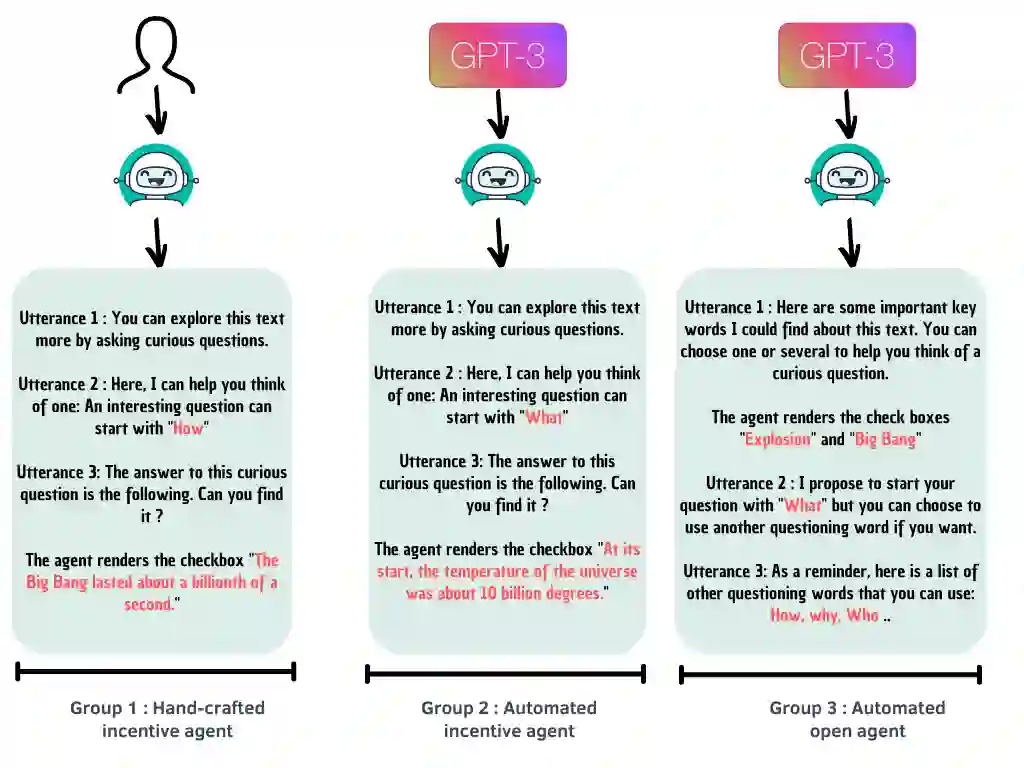

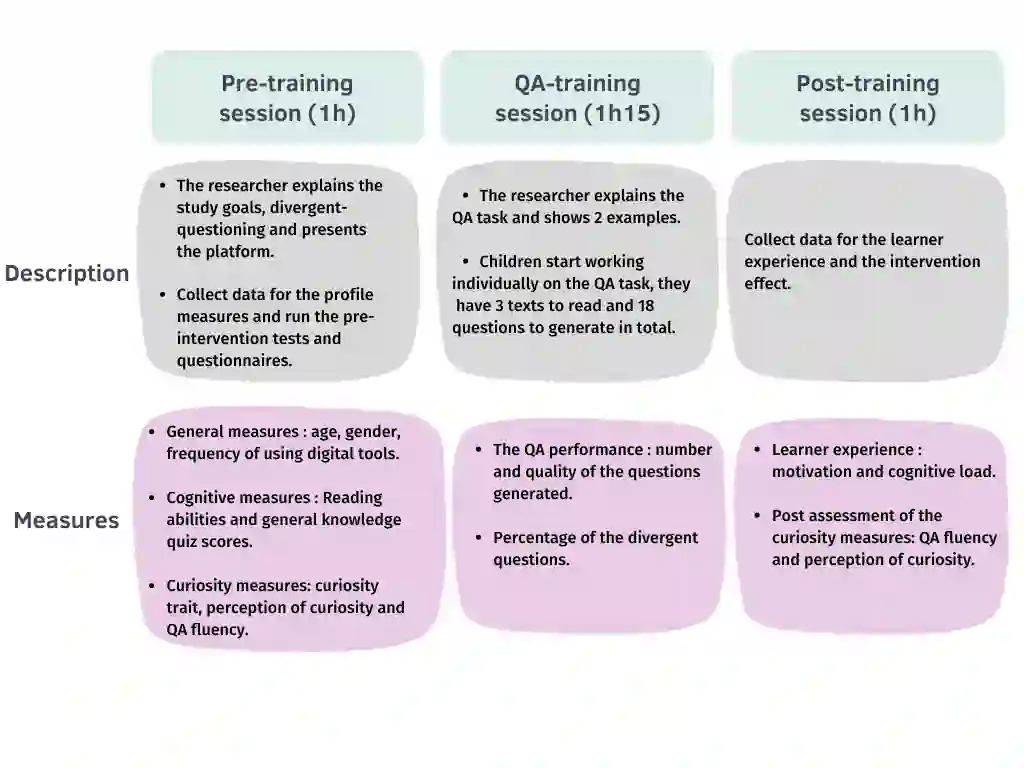

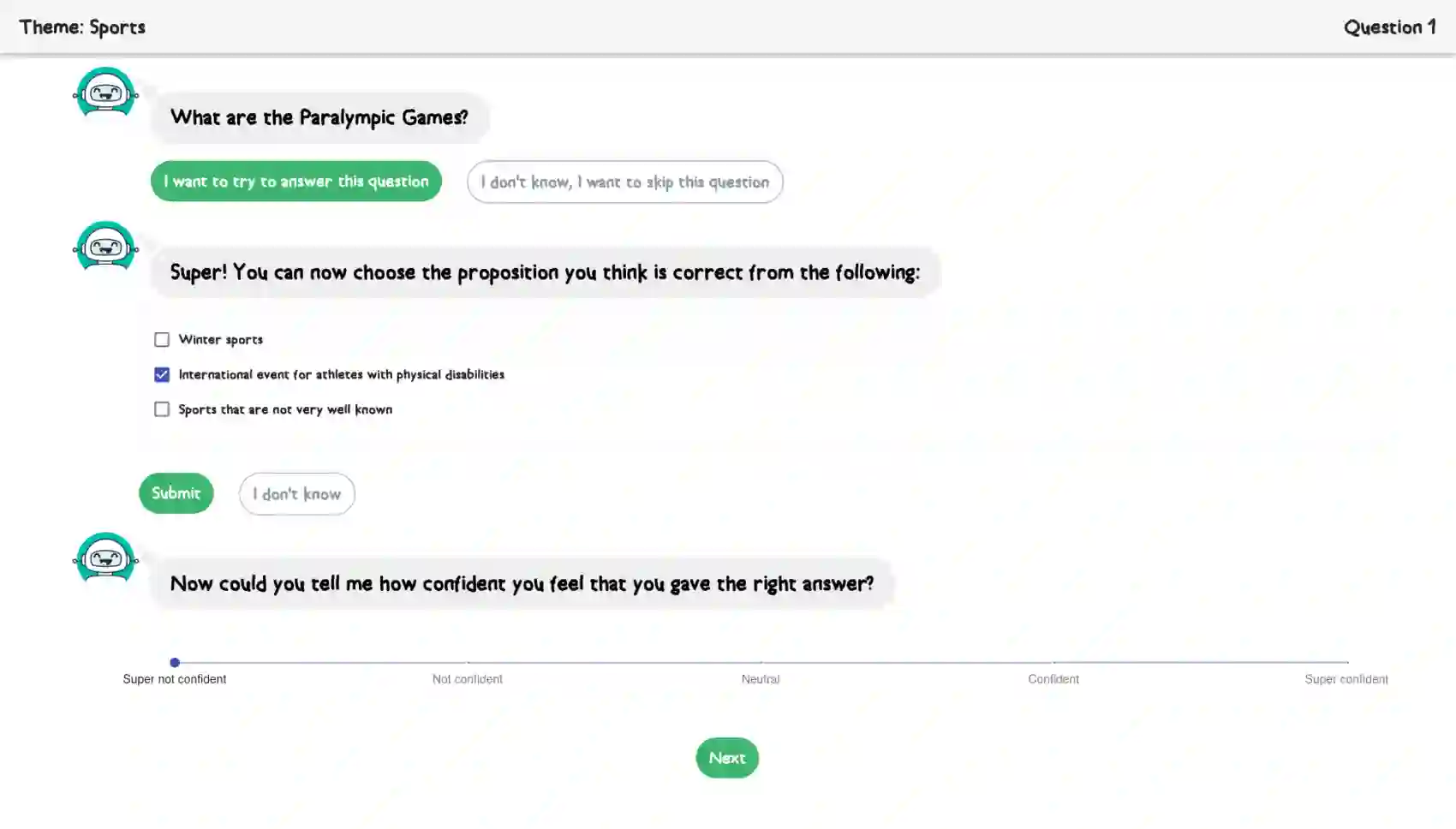

Students' ability to ask curious questions is a crucial skill that improves their learning processes. To train this skill, previous research has used a conversational agent that propose specific cues to prompt children's curiosity during learning. Despite showing pedagogical efficiency, this method is still limited since it relies on generating the said prompts by hand for each educational resource, which can be a very long and costly process. In this context, we leverage the advances in the natural language processing field and explore using a large language model (GPT-3) to automate the generation of this agent's curiosity-prompting cues to help children ask more and deeper questions. We then used this study to investigate a different curiosity-prompting behavior for the agent. The study was conducted with 75 students aged between 9 and 10. They either interacted with a hand-crafted conversational agent that proposes "closed" manually-extracted cues leading to predefined questions, a GPT-3-driven one that proposes the same type of cues, or a GPT-3-driven one that proposes "open" cues that can lead to several possible questions. Results showed a similar question-asking performance between children who had the two "closed" agents, but a significantly better one for participants with the "open" agent. Our first results suggest the validity of using GPT-3 to facilitate the implementation of curiosity-stimulating learning technologies. In a second step, we also show that GPT-3 can be efficient in proposing the relevant open cues that leave children with more autonomy to express their curiosity.

翻译:学生询问好奇问题的能力是提高学习过程的关键技能。 为了培训这一技能, 先前的研究使用了一个对话工具, 提出具体的提示, 以激发儿童学习过程中的好奇心。 尽管显示教学效率, 这种方法仍然有限, 因为它依赖于每个教育资源亲手生成所述提示, 这可能是一个非常漫长和昂贵的过程。 在这方面, 我们利用自然语言处理领域的进步, 并探索使用一个大型语言模型( GPT-3) 来自动生成该代理的好奇心促进提示, 以帮助儿童问更多更深的问题。 我们随后利用这项研究来调查该代理的不同好奇心促进行为。 这项研究是针对75个年龄在9至10岁之间的学生进行的, 他们要么与一个手写手写的对话工具互动, 提出“ 关闭” 手动的提示, 导致预先界定问题。 一个由GPT-3驱动的大型语言模型( GPT 3 ) 提出同样的提示, 或者由GPT-3 驱动的“ 开启” 提示, 可以导致几个可能的问题。 结果显示一个类似的问题在儿童中间的“ 学习 G- PT 的结果 ” 。