阿里巴巴淘系开源大型3D家具数据集(3D-FUTURE)推动3D家居智能研究

阿里巴巴淘系技术部与英国伦敦大学伯贝克学院 Steve Maybank 教授(Fellow of the IEEE and a Member of the Academia Europaea, the Koenderink Prize in 2008)、悉尼大学陶大程教授(Fellow of the IEEE, ACM and Australian Academy of Science)等国际知名学者合作,与3月30日正式开源业界首个饱含纹理细节的大型3D家具数据集(3D-FUTURE),共同推动3D家居智能研究。并面向全球3D几何与视觉研究爱好者同步启动第一届阿里巴巴3D人工智能挑战赛暨IJCAI-PRICAI 2020 Workshop。

什么是3D-FUTURE?

在过去十多年里,科学家们在 3D 视觉及几何的研究投入了巨大的努力,但是 3D 人工智能的工业落地任然困难重重,尤其是在家居家装行业。

阿里巴巴淘系技术部协同躺平设计家也在持续不断地探索数字化家居建设。以真实家居场景为背景,定义了许多新问题,进行了大量的知识重建,并结合 3D 人工智能技术初步打造了场景化数字营销,推出了智能设计搭配服务。

同时,在相关团队的技术研发过程中发现,海量的高质量 3D 模型与纹理,以及专业的房屋设计布局是推动未来数字化家居建设的基础。为了启发高质量 3D 模型理解与重建,并且建立学术研究与工业应用的桥梁。阿里巴巴针对家居场景开源大型3D数据集3D-FUTURE(3D Furniture shape with TextURE)。

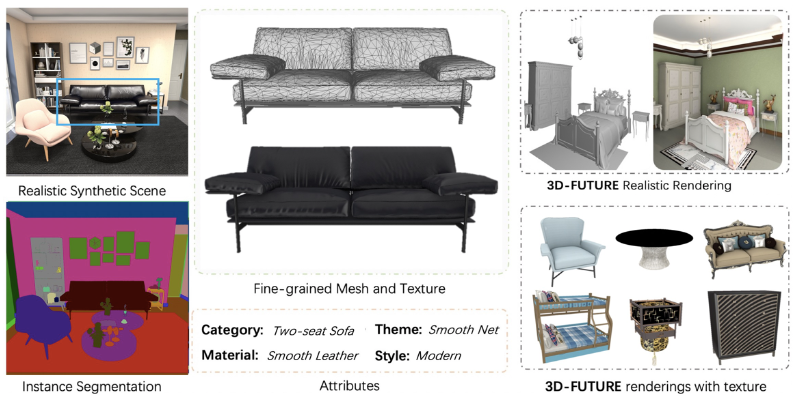

其初版包含 20,000+ 高清室内场景专业设计渲染图,与 10,000+ 精细的高质量 3D 家具模型及对应的高清且饱含信息的纹理,数据积累沉淀于阿里巴巴官方家装家居设计平台-躺平设计家。目前提供家具实例分割标注,完全真实的 2D 到 3D 的对准标注,以及专业的细粒度家具属性标注。

阿里巴巴希望持续建设 3D-FUTURE ,不断为 3D 几何及视觉研究提供需求的标注以及新特征,包括但不限于已有数据扩充,完整房屋布局信息提供,3D 模型分割标注等,以推进学术尖端科技的工业落地。

为什么需要3D-FUTURE?

当前大型开源 3D 数据集都存在一些不足,不足以支持工业级的 3D 模型重建与纹理恢复等领域的深入细致研究。

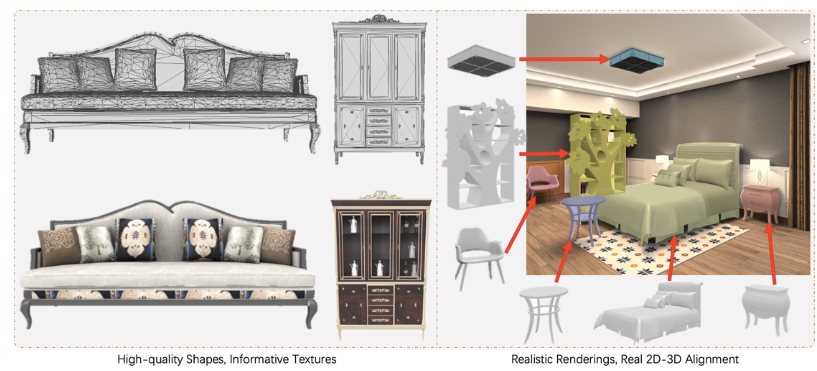

首先,已开源数据集的大多数 3D CAD 模型 (家具类) 都是从网上收集的,因此普遍存在细节缺失以及无纹理或纹理信息度低等问题,且没有多样专业的属性标签。针对此现象,3D-FUTURE 提供多种不同风格且带有丰富细节的高质量 3D 家具模型,并配备了高清饱含信息的纹理以及多样化的属性标签。

其次,目前学界暂无组织较好的大规模室内仿真图像数据集。3D-FUTURE 通过最先进的工业 3D 渲染引擎,在专业设计师所设计的 5,000 多个场景中渲染产生了 20,000+ 图像,填补了这一空白。

最后,现有数据集只提供 2D-3D 伪匹配,即根据 2D 图中物体,人工从开源 3D 模型池里选择与之相似的 3D 模型作为匹配结果。这种标注过程极有可能忽视掉一些局部的形状细节特征,导致提供的 2D-3D 匹配结果并非完全一致。因此难以支持数据驱动的高质量三维重建以及高精度形状检索等相关3D研究。与之相比,3D-FUTURE 提供的 10,000+ 3D 模型都是与 2D 渲染图中的物体真实配对的。

我们相信,3D-FUTURE 这些特性可以启发高质量 3D 模型理解和重建等领域的创新研究。

阿里巴巴3D人工智能挑战赛暨IJCAI-PRICAI 2020 Workshop

阿里巴巴淘系技术部联合来自于悉尼大学、英国伦敦大学伯贝克学院、墨尔本大学、中国科学院计算所的顶尖学者举办基于 3D-FUTURE 的第一届 3D 人工智能挑战赛暨 IJCAI-PRICAI 2020 Workshop。

3D 几何与视觉研究是广受关注的基础研究领域,是建设未来3D智能世界必经之路。淘系技术部在人工智能国际顶级会议 IJCAI-PRICAI 举办 workshop 及竞赛,旨在总结目前最先进的 3D 几何与视觉技术,启发高质量 3D 模型理解与重建,并且建立学术研究与工业应用的桥梁。

竞赛内容包括三个项目,分别是基于图片的3D模型推荐,基于单张图的3D模型重建,实例分割。信息如下:

基于图片的 3D 模型推荐:在该项挑战赛中,参赛者被要求根据 2D 图片在给定 3D 池中检索出对应的 3D 模型。随着极速增长的3D模型数量,建立一个可靠的IBSR(image-based 3D shape retrieval)系统不管在工业界还是在学术界都非常重要。

比如用户 3D 场景布局重建的基础就是根据 2D 图中物体,从大型 3D 池中找出对应的 3D 模型。该项竞赛最大的挑战是针对 2D 与 3D 是完全不同域以及表征信息的差距,提取具有域不变性且纹理抑制的的特征表示。我们希望参赛者能充分探索最先进的解决方案,并基于此设计出更加精准可靠的IBSR算法。

另外,我们也期望通过这项比赛来促进具有鲁棒性的形状检索发展,即在图片中物体存在轻微遮挡以及具有复杂背景的情况下实现较高精度的检索。我们将用 TopK 召回率以及 TopK 平均 F-score 作为主要性能衡量指标。

基于单张图的 3D 模型重建:在该项挑战赛中,参赛者被要求从单张RGB图像重建对应的 3D 模型,这些图片主物体可能存在轻微遮挡以及少部分残缺。众所周知,3D 模型的数量与质量是数据驱动的 3D 理解研究以及 3D 相关人工智能应用的基础,比如虚拟场景搭建。

然而,目前海量的网络图片中的物体都没有或很难收集到对应的 3D CAD 模型。另一方面,目前工业界高质量 3D 模型生产效率很低,无法支持大规模高效生产。

这项奖赛旨在总结目前最先进的单目图像 3D 重建方案,并启发工业级 mesh 表面细节重建的研究探索思路。Chamfer Distance(CD)以及 F-score 将作为重建结果质量的评价标准。

实例分割:在该项挑战赛中,参赛者被要求对渲染的室内场景图进行实例分割。

在训练集中,3D-FUTURE 将提供场景图中部分物体所对应的带有纹理的 3D模型作为辅助信息,期望能提升边缘分割精度。实例分割是学界的基础研究问题,也是室内场景理解的关键之一。高精度尤其是边缘鲁棒的实例分割不仅有利于启发高质量图像合成相关工业应用,例如有潜力部分取代昂贵低效的渲染过程,从而实现高效自动化用户室内搭配编辑生成;也有潜力大幅提升 IBSR, 3D 重建等基础 3D 问题的效果。该项挑战赛的评估指标为被广泛认可的 Mask Average Precision (mAP)。

附workshop及竞赛重要信息

重要日程节点:

3月30日竞赛开启报名,并开放部分示例数据集。

4月03日开放完整训练集与验证集。

5月31日开放相关测试集。

6月05日竞赛结束。

6月12日潜在优胜者报告提交截止日期。

6月17日报告审核以及竞赛最终结果公开。

7月13日3D-FUTURE Workshop at IJCAI-PRICAI 2020。

优胜者奖励:

第一名1500美金,第二名1000美金,第三名500美金。

受邀请到国际人工智能顶会IJCAI-PRICAI 2020 Workshop进行报告。

受邀合著Workshop报告。

🔍

现在,在「知乎」也能找到我们了

进入知乎首页搜索「PaperWeekly」

点击「关注」订阅我们的专栏吧

关于PaperWeekly

PaperWeekly 是一个推荐、解读、讨论、报道人工智能前沿论文成果的学术平台。如果你研究或从事 AI 领域,欢迎在公众号后台点击「交流群」,小助手将把你带入 PaperWeekly 的交流群里。