知识图谱如何用于可解释机器学习中?KGC2021这份教程为你讲解(附34页ppt与视频)

【导读】 知识图谱KGC是一个世界级会议,将有经验的实践者、技术领导者、前沿研究人员、学者和供应商聚集在一起,就知识图的主题进行为期两天的演讲、讨论和网络交流。KGC2021在5月3号到6号举行。来自加拿大CortAIx 首席人工智能科学家Freddy Lecue做了关于《知识图谱在可解释机器学习系统中应用》的报告,特别对可解释人工智能以及知识图谱在可解释机器学习中的作用进行了重点讲述,是非常好的学习资料。

Freddy Lecue

Freddy Lecue博士是加拿大蒙特利尔泰勒斯人工智能技术研究中心的首席人工智能科学家。他也是法国索菲亚安提波利斯温姆斯的INRIA研究所的研究员。在加入泰雷兹新成立的人工智能研发实验室之前,他曾于2016年至2018年在埃森哲爱尔兰实验室担任人工智能研发主管。在加入埃森哲之前,他曾担任研究科学家,2011年至2016年在IBM research担任大规模推理系统首席研究员,2008年至2011年在曼彻斯特大学(University of Manchester)担任研究员,2005年至2008年在Orange Labs担任研究工程师。

知识图谱在可解释机器学习的应用

报告摘要

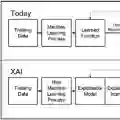

机器学习(ML),作为人工智能的关键驱动力之一,已经在许多行业显示出颠覆性的结果。在关键系统中应用ML(尤其是人工神经网络模型)最根本的问题之一,就是它无法为其决策提供依据。主要是因为常识知识或推理超出了ML系统的范围。我们展示了如何运用知识图谱来揭示更多人类可以理解的机器学习决策,并展示了一个框架,将ML和知识图谱结合起来,在识别4,233,000个资源的知识图谱中的任何一个类的对象时,展示出一个接近人的解释。

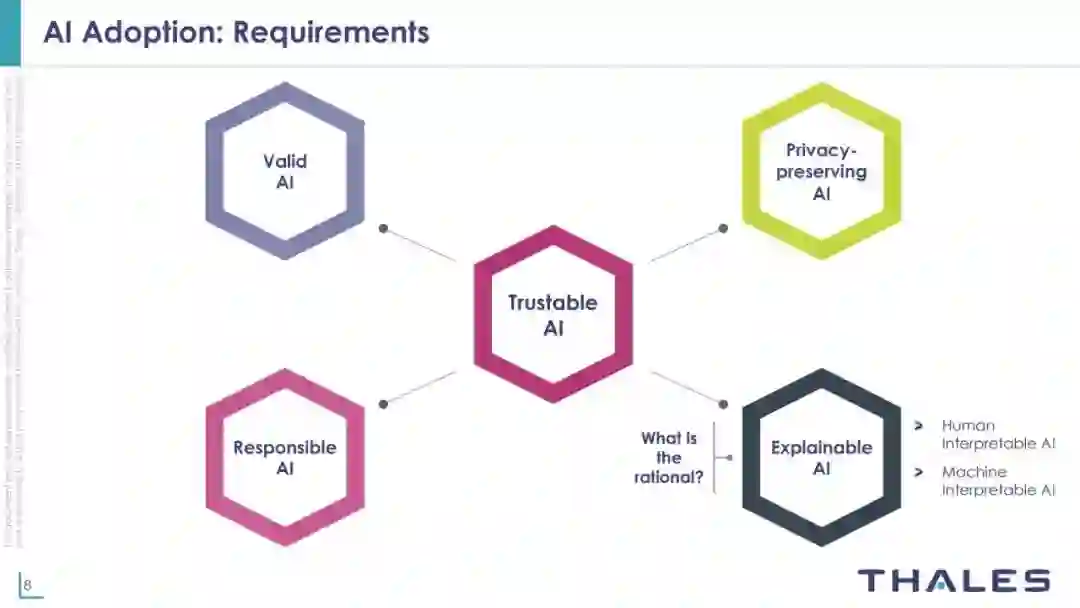

可信赖人工智能包含要素

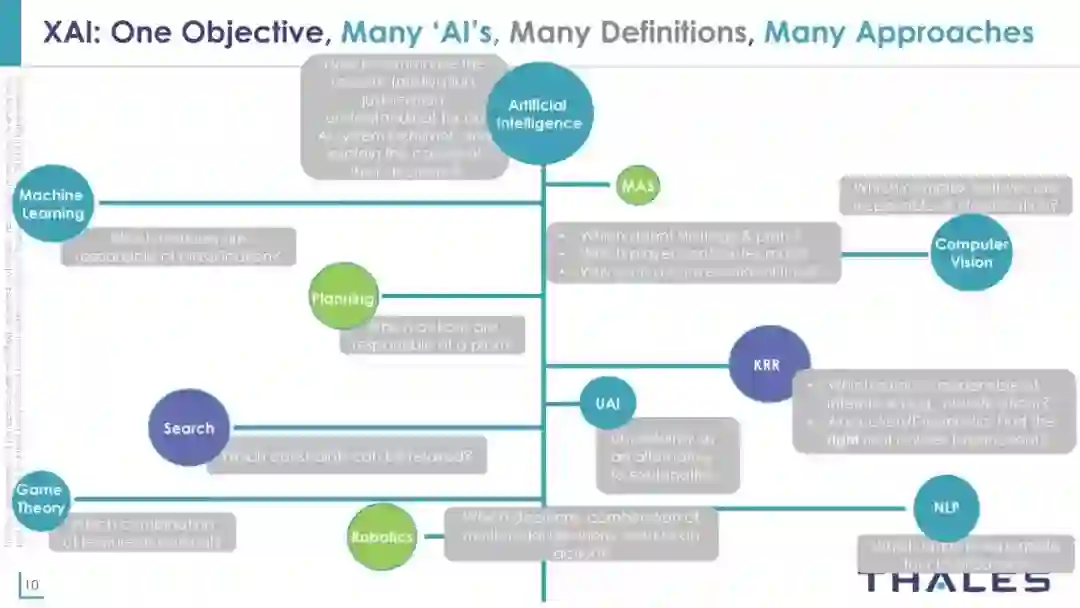

可解释人工智能涵义

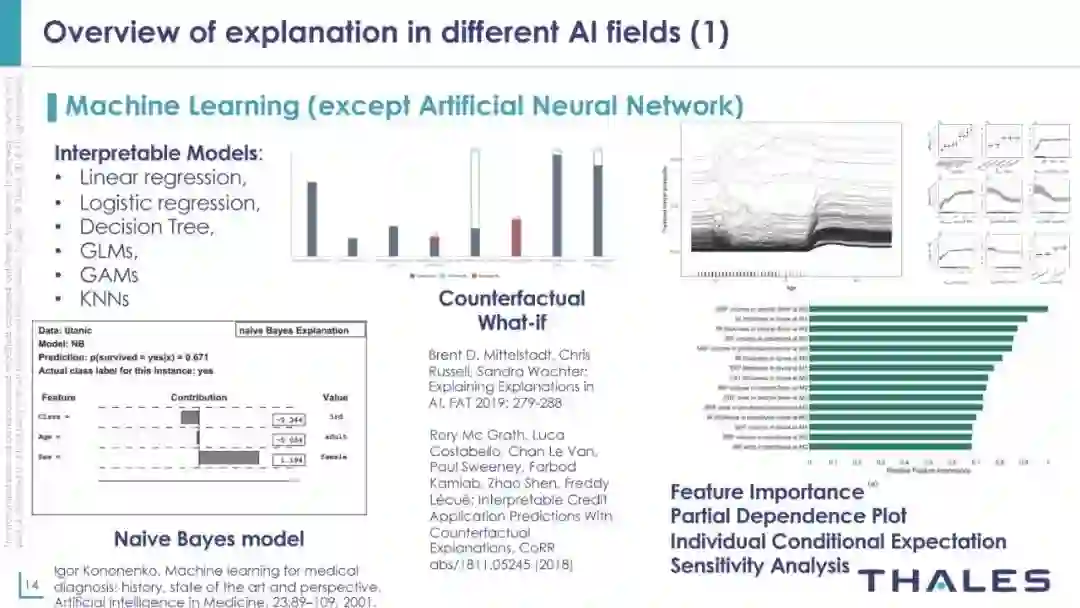

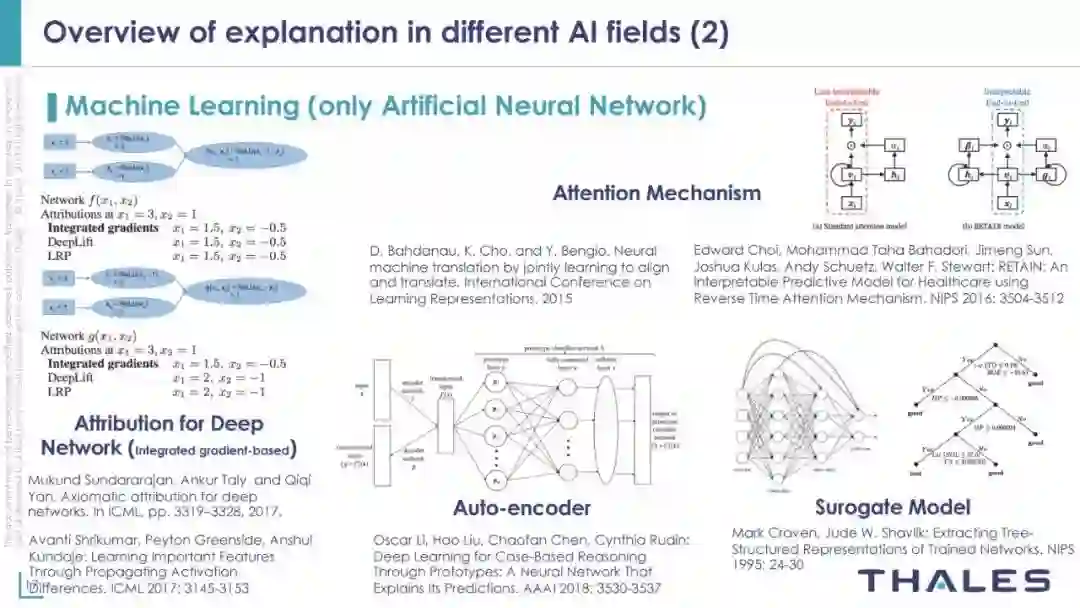

可解释机器学习模型包括线性回归、逻辑回归、决策树、GLMs、GAMs、KNNs等

深度神经网络模型

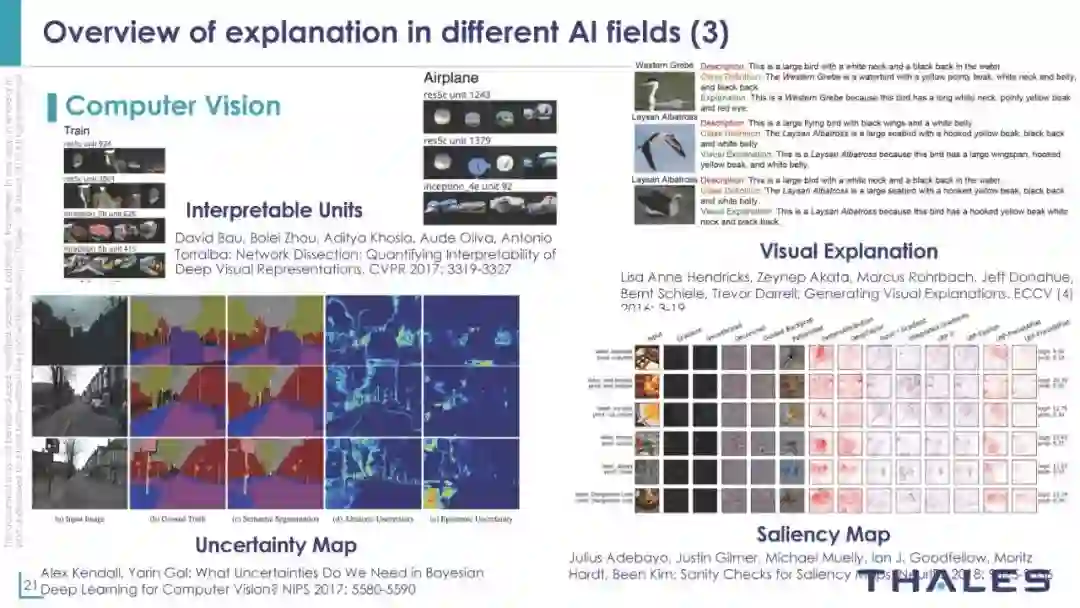

计算机视觉可解释实例

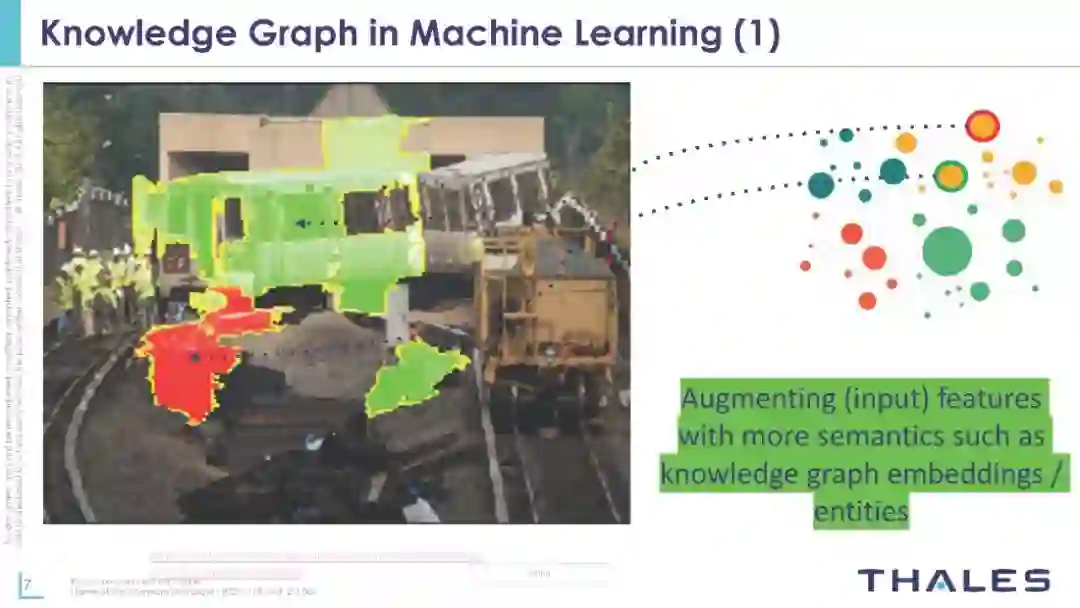

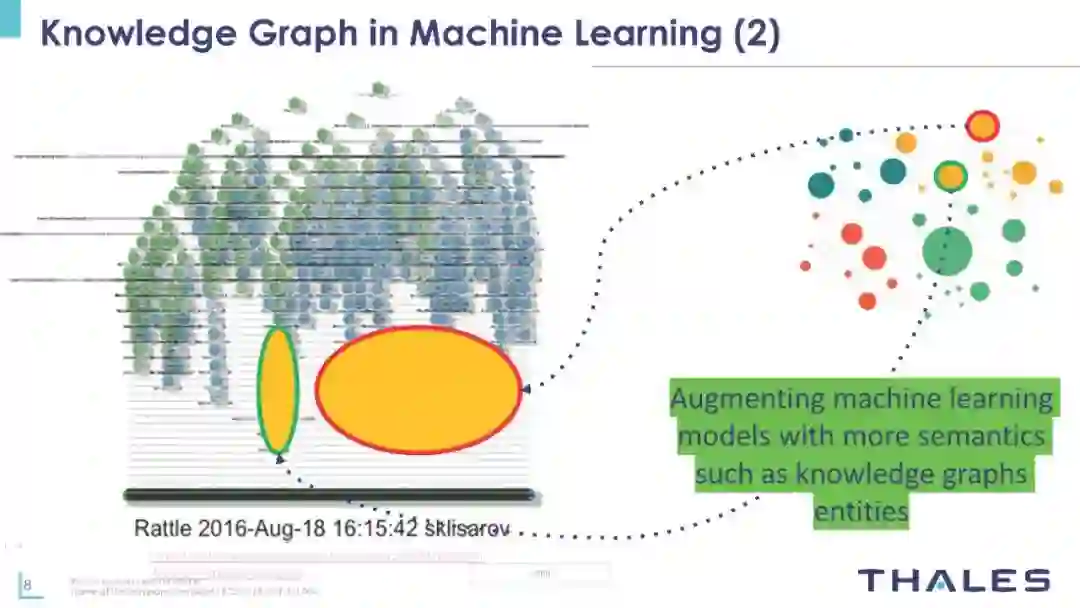

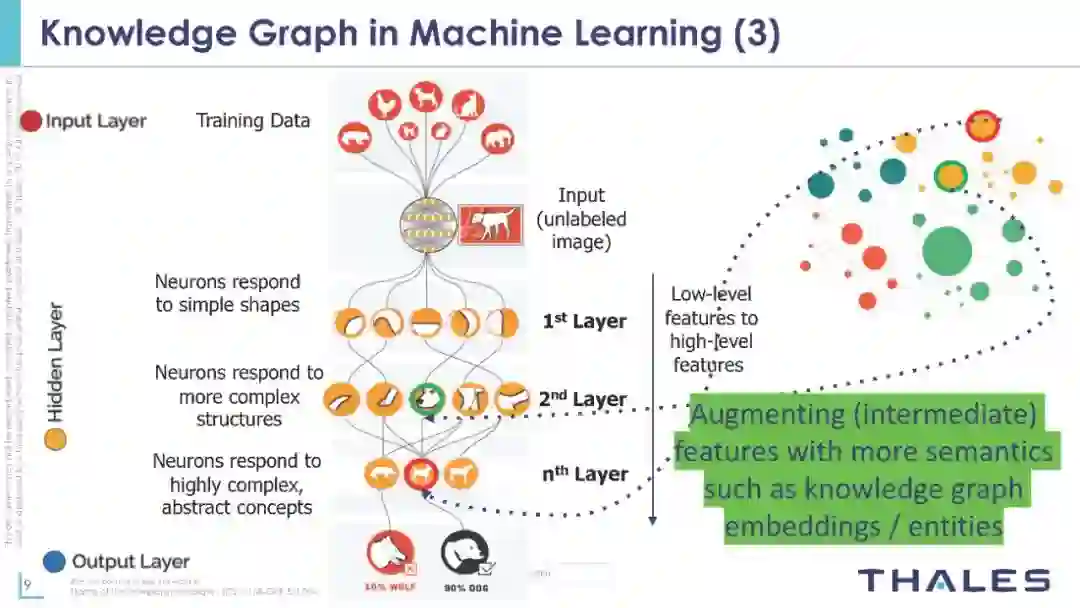

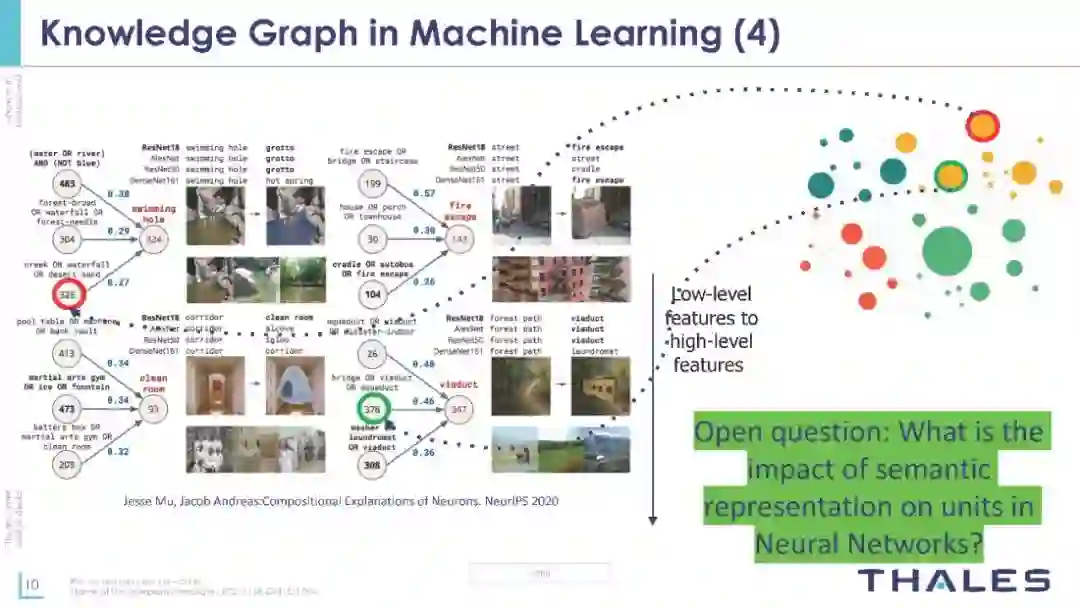

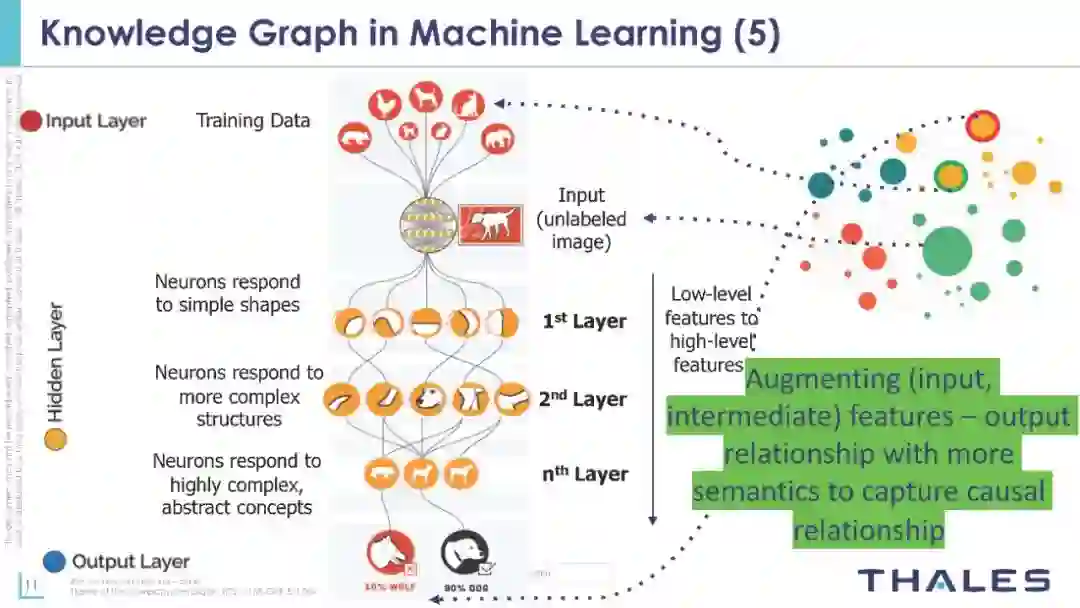

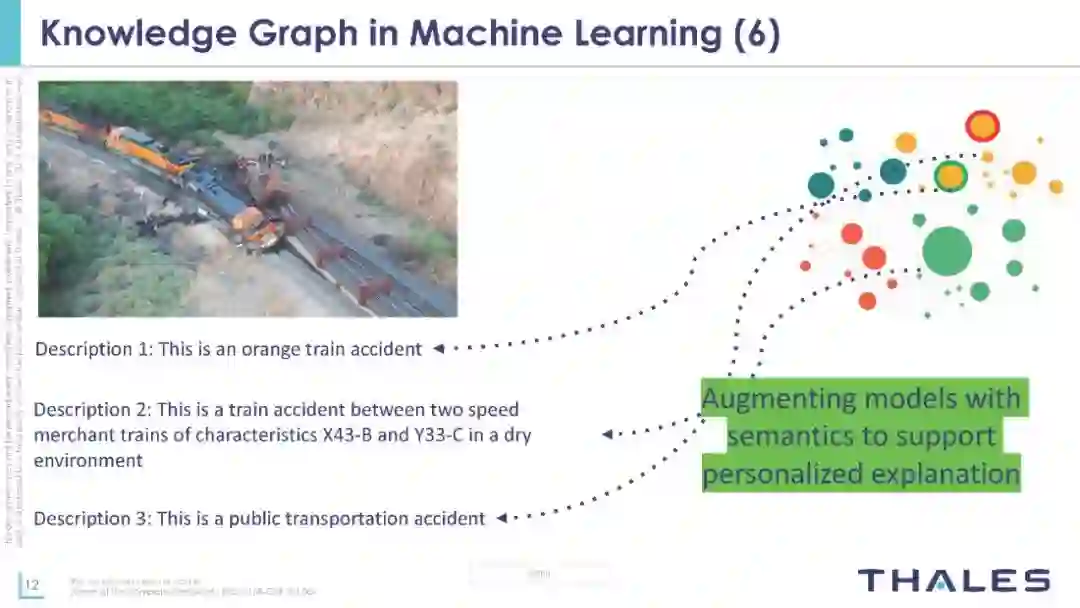

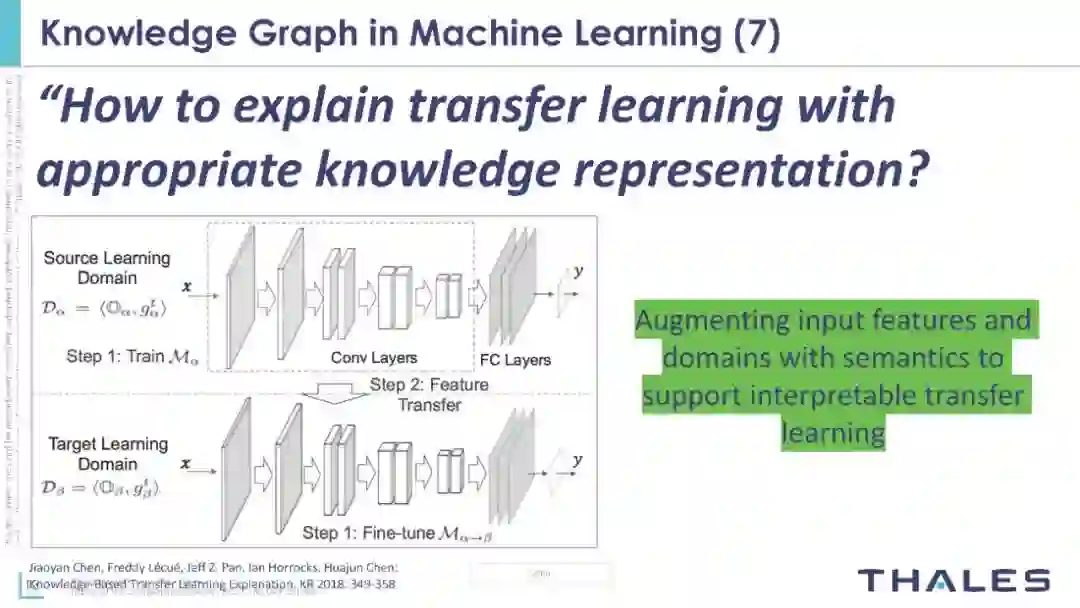

机器学习中的的知识图谱嵌入

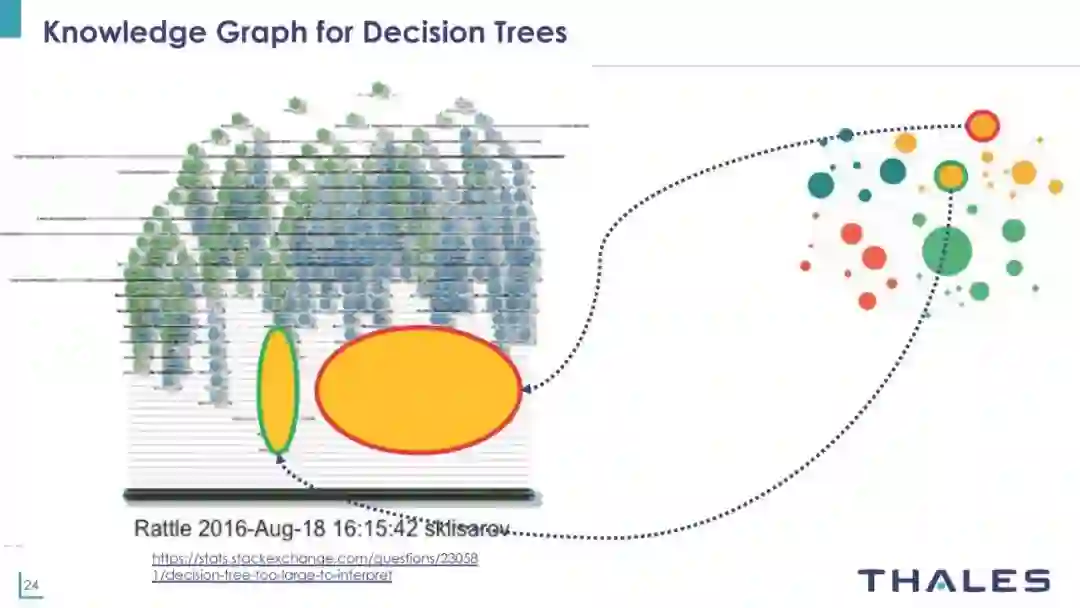

知识图谱决策树

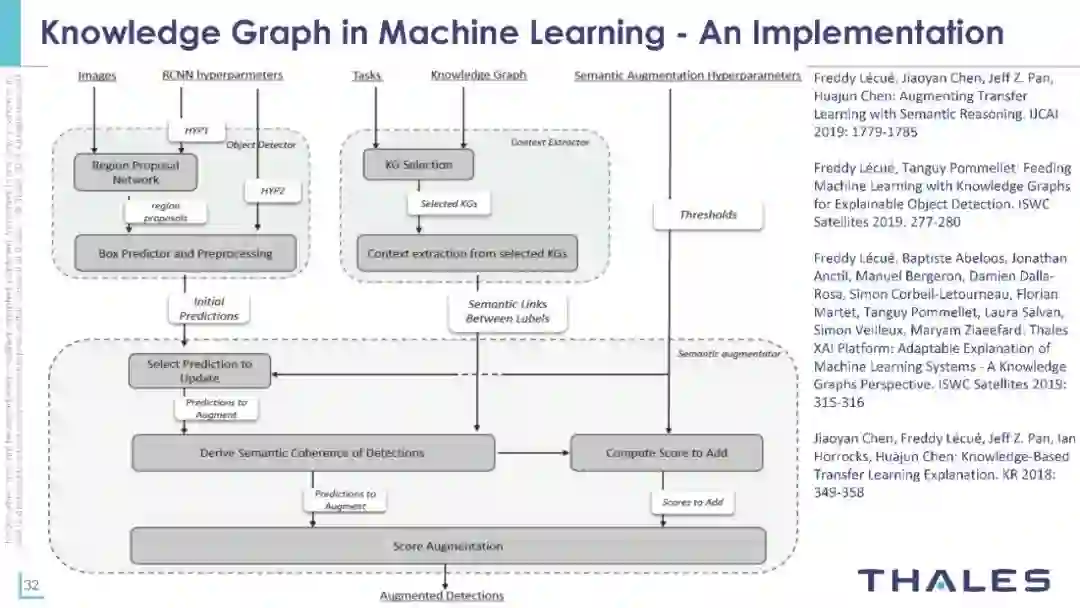

知识图谱机器学习实现

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“KGEML” 就可以获取《知识图谱如何用于可解释机器学习中?KGC2021这份教程为你讲解(附34页ppt与视频)》专知下载链接