美国播客节目《指数视角》专访李飞飞:疫情、 AI 伦理、人才培养

摘要:李飞飞近日参与了由《哈佛商业评论》出品的播客节目《Exponential View 指数视角》,作为嘉宾接受了科技媒体人 Azeem Azhar 的访问,介绍了 HAI 实验室近期在医疗 AI 方面的研究,并探讨了人工智能在隐私、道德伦理上的问题。

关键词:李飞飞 医疗 AI 隐私 机器价值

李飞飞(左)与主播 Azeem Azhar(右)进行了远程访谈

李飞飞与主播 Azeem Azhar 围绕 AI 技术与应用,从 AI 愿景到目前专注于AI 医疗的历程,再到 AI 技术所面临的隐私、道德伦理问题等,一一进行了深入探讨。

30 分钟的对话,干货着实不少。一起来看看 AI 女神最近有什么思考,她又是如何看待人工智能技术的热点问题。

以下是太长不看版:

1. 人工智能技术能够帮助老年人更独立、更健康地生活,早期发现 COVID-19 感染迹象

使用 AI 驱动的智能传感器技术,可能有效减少老年人 COVID-19 的感染和病死率。

利用非接触式的传感器,如深度传感器、热传感器,能够进行体温测量,并监测老年人饮食模式、上厕所模式、睡眠模式等的改变,以及孤独、痴呆症的早期检测等等。

李飞飞 4 月在斯坦福的一次在线会议中

介绍了最新研究,如何利用 AI 帮助弱势群体

2. 技术发展的同时,要顾及隐私尊重与保护

每一步的技术发展,尤其是以人为中心的技术,都需要在过程中考虑隐私、尊重与尊严的问题。即使因此会给技术带来更大的难度与挑战,也不能因此而不考虑人文方面的诸多因素。

3. 在学生学习代码与算法之前,让他们先融入生活

在 AI 技术发展早期,技术专家们并未考虑到技术的迅猛发展,会对当今人类社会造成什么影响。

基于历史经验,李飞飞认为今后应该更多地将技术与人文因素联系起来。比如斯坦福 HAI 的课程设计中,就将科学与人文两方面的内容都融合起来,既有纯技术内容的课程,也有 AI 的原则、算法的政治、伦理学等内容。

HAI 学生在学习技术的同时,也会深入到工作场景中

4. 机器的价值观反映了人类的价值观,因此人类负有道德责任

机器的价值观正是人类的价值观的映射。技术的发展与应用是依赖于人类的,因此人类负有道德责任。技术专家应该从所有利益相关者的角度去看问题,而不仅仅是自己的视角,从而消除技术的偏见。

李飞飞曾在演讲中称,未来 AI 需要以人为本

5. ImageNet 的诞生:源于正确的方法与路径

ImageNet 不仅对计算机视觉,更是对整个人工智能领域都产生了巨大影响。而李飞飞表示,ImageNet 的诞生,源于团队在当时现有研究基础上,正确定义了方法以及关键路径。

6. AGI(强人工智能)的到来自然而然,与人类相互促进

强人工智能从 AI 诞生之初就已有这个诉求,因此它的到来自然而然。而为了避免 AGI 被人类的智慧边界所限制,科学家们应该被允许去做更大胆的尝试,不断创新突破自我极限,并与 AGI 相互促进、启发,实现双向发展。

以下是播客音频:

我们对内容进行了翻译与整理,以下为完整版。

李飞飞:疫情让我用 AI 帮助和保护老年人

Azeem Azhar:大家好,我是 Azeem Azhar,您现在收听的是 《指数观点》播客节目。

李飞飞博士是人工智能领域著名的研究者,目前是斯坦福大学计算机科学系首届红杉讲席教授、以人类为本人工智能研究所(HAI)联合主任。她最为著名的是发起了 ImageNet 项目。

我相信,ImageNet 是过去八年来,助推人工智能投资研究和应用热潮的催化剂与推动力之一。

今年年初,她当选为国家工程院院士,这是她所在领域的最高专业荣誉之一。飞飞,很高兴今天有你的到来,谢谢你能抽出时间来。

李飞飞:谢谢你,很激动,我也非常喜欢你的节目。

Azeem Azhar:我在伦敦,你在哪里?现在因为隔离,我们都不能外出了。

李飞飞:我在斯坦福大学。是的,我们都被「封锁」了,真的很怀念每天和年轻人一起工作的日子。

Azeem Azhar:我们知道,你的研究实验室都是围绕着机器学习和人工智能的人才。其中一些技能似乎与解决 COVID-19 这种疾病以及它所产生的一些影响非常相关。请问你们的实验室是如何参与到这其中的?

李飞飞:其实早在八年前,我们就已经意识到计算机视觉和智能传感器、设备已经进入了一个阶段,我们可以开始解决一些现实世界的问题,尤其是我非常感兴趣的卫生保健问题。

因此,我们一直在试验一些关于非接触式传感器的研究,试着理解与临床结果相关的人类行为。

其中一个引起我们注意的主要领域是世界人口老龄化问题——我们如何帮助老年人更独立、更健康地生活?所以我们的研究与临床和家庭支持都有关。

具体地,比如包括体温测量 、饮食模式的改变,以及对上厕所的模式、睡眠模式还有孤独、痴呆症的早期检测等等。

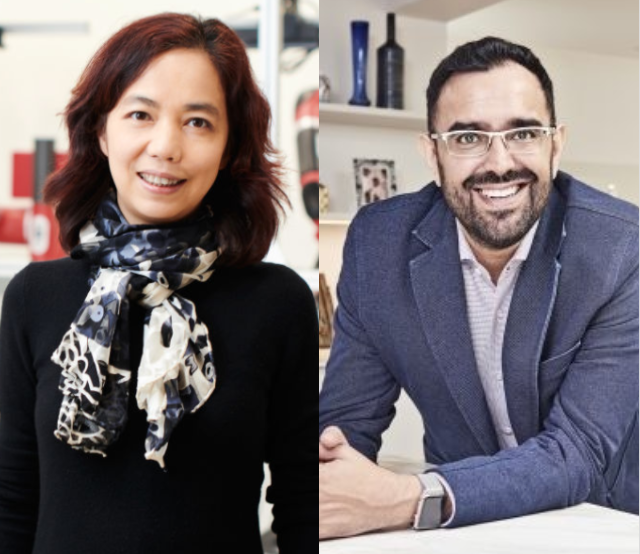

智能传感器在家中可收集多个维度的数据

所以,当 COVID-19 疫情爆发时,我很早就注意到了老年人的看护问题。因为我有两个年迈父母,我也很担心他们。

从数据统计中,我们惊恐地看到独居者的脆弱性和死亡率更大,因为独居者们不仅从免疫系统的角度来看更加脆弱,而且他们中更多人基本的健康状况都受到影响,因为他们没办法去诊所看医生。

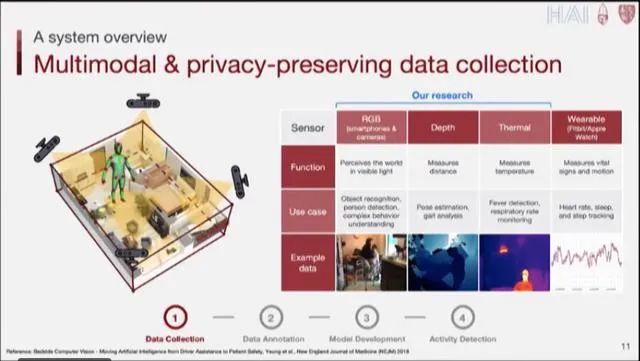

我们就想,能不能加速这项技术,把它带到老年人的家里和社区,这样我们一方面可以帮助早期发现 COVID-19,比如体温变化、感染的迹象。

Azeem Azhar:那么可以介绍下你们所研究的是哪种传感器吗?这项工作需要哪些数据?

李飞飞:我们目前正在使用和试点的传感器有两种。

一种是深度传感器,比如我们玩 XBox 的视频游戏时,就会用到这种传感器。它不需要看到玩家就能获取距离信息。

另一种是热传感器,研究的是温度变化或行为。如果你长时间坐在沙发上不运动,你的饮食频率和液体摄入就会进入睡眠模式,这种传感器就能够监测得到。

热传感器有助于发烧、呼吸异常等早期感染现象

技术发展与隐私问题之间的权衡

Azeem Azhar:我见过类似的项目,比如大家喜欢高清相机,它的高分辨率可以让人们看到面部细微的表情。

但是,随着这种高清技术的出现,它可能会具有侵入性,可能被滥用。在你们研究传感器过程中,都需要哪些参数呢?

李飞飞:我们所研究的任何传感器,都会处理隐私问题和尊重人类,我们正与伦理学家和法律学者合作研究隐私问题。

而顾及到隐私问题,深度传感器就会丢失数据和高保真度、高分辨率的像素着色数据。那么,我们如何弥补这个问题呢?

我们实验室正在进行计算机视觉研究,可以在没有 RGB 高清摄像头数据的情况下,理解人的姿态细节。

李飞飞介绍道,他们将 AI 模型部署在边缘设备

数据直接在终端处理,从而减少了隐私风险

Azeem Azhar:在你能得到的数据的保真度和质量以及隐私侵入性之间,是否存在折中?这是必要的权衡吗?它是一种基本的公理化权衡系统吗?

李飞飞:这是个很好的问题。我认为总是会有考虑的。

我们每一步的技术发展,尤其是以人为中心的技术,隐私、尊重、尊严方面,不应该是事后才考虑。所以,从这个角度来说,我们会折中。如果我们不能使用某些信息,就会给技术带来更大的挑战和更多的机会。

李飞飞:我的学生,需要懂技术也要理解场景

Azeem Azhar:您目前所在的是斯坦福以人为本人工智能研究所 HAI,能否介绍一下,作为一个人工智能研究机构,它与你之前工作的团队或其他更传统的人工智能机构有什么不同?

2019 年 3 月,斯坦福 HAI 研究院成立

李飞飞与 John Etchemendy 博士联合担任主任

李飞飞:在这里,让我兴奋的是,从一开始,我们的基因中就带有的抱负,就是让我们的研究所(HAI),成为一个真正的跨学科研究和教育机构。

我们的联合创始人来自计算机科学、哲学、经济学、法律、伦理、医学等各个领域。20 年前,当我还是一名博士生的时候,我做梦也不会想到,我自己的好奇心,会成为未来改变人文科学和社会的一股力量。

所以,当我意识到这一点,我个人产生了一种巨大的责任感。

Azeem Azhar:在科学实验室和工程实验室,特别是计算机科学,它们和人类特征化的东西之间一直存在着脱节,你会如何解释这种脱节造成的一些后果?

李飞飞:说起来,这也是我个人成长的一个历程。我记得 2000 年,我在加州理工学院读博士一年级的时候,读的第一篇研究论文是一篇关于人脸检测的开创性论文。

我导师说,这篇论文是一篇非常棒的机器学习论文。它展示了使用非常慢的 CPU 芯片,进行实时的人脸检测。

李飞飞在加州理工学院博士期间的导师 Pietro Perona

如今回过头来看,当年我的导师、同学读完论文,从来没有人,甚至连我自己,都没有考虑到这和人类隐私有什么关系。

说明这些技术的发展早期没有考虑到这一点。但过去没考虑到,是我的问题吗?可能并不是。

我们做梦都没有想到这个技术的影响会有多大,但是今天我们看到了这些后果。

Azeem Azhar:没错,这是一个非常重要的观察。这让我想起 1959 年 C. P. Snow (英国科学家、小说家)一个著名演讲,叫做《两种文化》。

他讲道,一般的学者是多么了解莎士比亚,却对热力学第二定律一无所知。而知道第二定律或热力学的学者,却对莎士比亚一无所知。如果没有共同的知识,我们就不能用智慧去思考。

如今,你似乎在这两种文化之间架起了一座桥梁。

李飞飞:对我来说,这是个双螺旋,我们认为下一代的学生应该是「双语」的——技术和人文,这两种学科都要学习。

过去几年里,在硅谷有一件事让我印象深刻,那就是年轻的技术专家告诉我,他们没有接受过这样的知识教育。

当他们现在从新闻中听到,甚至看到他们自己公司生产的产品,正面对这些对人类影响的问题时,他们都会感到非常恐惧。他们甚至不知道去思考自己的角色是什么,如何让世界变得更好。

Azeem Azhar:所以我的经验是,尽量别把学生看成研究者,而是把他们看成产品经理、开发者和创业者。

我想给大家介绍一下 HAI 有一些课程,真的是非常科学的。比如知识图、理论神经科学、机器学习和因果推理。然后另一方面,还有算法的政治、伦理学、公共政策、技术变革、数字公民社会、设计人工智能来培养人类的福祉。

在 HAI 课程列表里,不乏 AI 造福社会

计算机与安全、道德、公共政策等课程

所以,我很好奇,你有什么创新的方式,来将这两方面很不相干的学科领域结合起来?

李飞飞:我的学生大多是来自计算机科学背景的硕士和博士生。当他们加入到我们 AI 医疗保健团队中时,只有一项基本要求——在讨论代码与算法之前,先融入医护人员的日常生活。

他们需要进入 ICU、病房、手术室甚至是医护人员 / 患者家中,了解这些人的生活方式并跟他们的家人面对面接触。

所以,这只是一个小小的例子。但是 HAI 在各方面都在做这个事情。

技术是中立的吗?

Azeem Azhar:我听到有两类说法,有些人说,技术在伦理上是中立的,它就像一颗行星绕着一颗恒星转一样。

但还有一些人说,技术在某种意义上说,是依赖路径的,是在特定的结构和接触、偏见、特权和观点中演化出来的。因此,技术从来都不是中立的。

你认为这两种观点中,哪一种更正确?

李飞飞:所以恒星不是人类制造的,而科技是。

所以我确实相信,有一句话:没有独立的机器价值。机器的价值是人类的价值。科学规律有其自身的逻辑和美感,没有人类的偏见。但是技术的发明创新和技术的应用是非常依赖人的,我们都有这个道德责任。

Azeem Azhar:比如当你在成立这个研究所的时候,你有着来自于斯坦福的背景,你自己也是一个多元文化的人,那么你怎么看待斯坦福等这些背景?

李飞飞:我想说,还是责任感。从早期的斯坦福大学领导层开始,我们就认识到责任感的重要性。

这就是为什么 HAI 得到了这么多的支持。因为我们清醒地认识到,我们的角色不仅仅是在技术上的创新,而是要利用技术为人类社会带来繁荣,包括艺术、音乐、人文科学,以及社会科学、医学、教育等。

ImageNet:彻底转变图像识别

Azeem Azhar:再聊聊你的项目 ImageNet。我认为它对当下人工智能投资和应用的热潮中是非常关键的。ImageNet 提醒了人们,数据对于 AI 发展的重要性。你有没有想过,这可能是你在 2006 年开始做这个的时候带来的影响?

李飞飞:我觉得完成 ImageNet 的项目过程更让我兴奋,我和其他大多数科学家一样,对于知识都有追求和好奇心,不仅限于关注我们提出的想法会产生多大的影响。

Azeem Azhar:这很了不起。从本质上说,你做了很多繁重的工作来对图像进行分类,才创造了一个干净的数据集,人们才可以把他们的算法应用在上面。

ImageNet 数量之大,质量之高都是空前的

而在 2012 年之前的几年里,每年大约有 3 亿美元的资金投入到人工智能创业公司,ImageNet 对人工智能创业环境产生了巨大的影响。

李飞飞:首先,我很惭愧受到这些褒奖,也很感谢你把这些功劳归功于 ImageNet,我想历史和时间最终会判断我们的贡献,但我们的确为这些工作感到很自豪。

Azeem Azhar:现在回想 2011 年、2012 年的图像识别技术发展,但也远没有我们今天的图像识别那么厉害。现在您作为这个领域的科学家,如何解读这些年来的变化?

李飞飞:ImageNet 正是诞生于「彻底转变图像识别」的这个愿望,我们当时提出的想法和很多科学发现没有太大区别, 我们非常希望能够建立一个能够真正推动视觉智能研究的北极星(NorthStar),让我们能够定义用何种办法解决大规模物体分类,并且解决这个问题。

我们也的确成功地找出了这个办法,当然,我们也是站在巨人的肩膀上,并不是凭空想出了这个办法。正因为有着前三十年认知神经科学的研究和计算机视觉的研究。

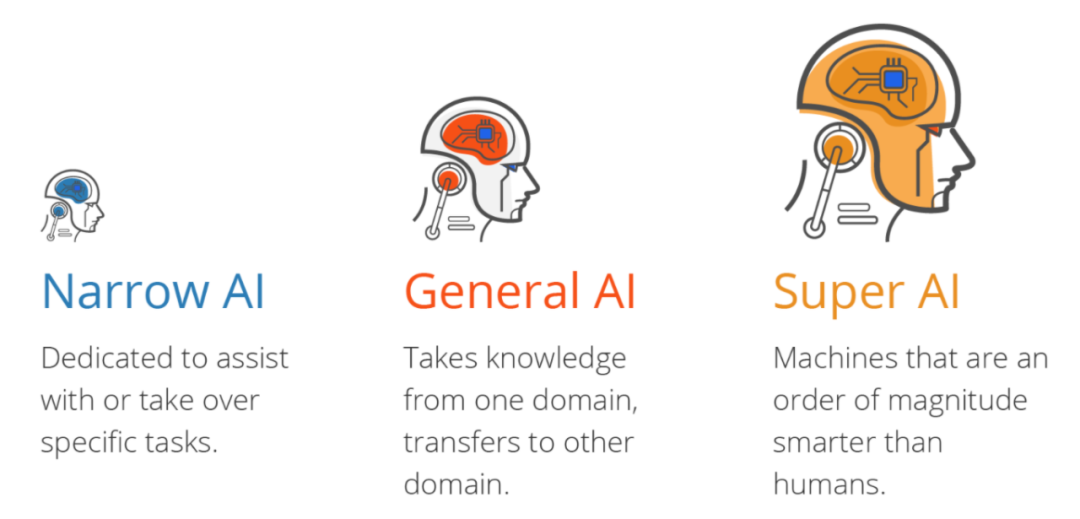

Azeem Azhar:对于大众和媒体,近来经常提及通用人工智能,或者说强人工智能,对你来说 AGI 有什么意义?

李飞飞:当我最初读人工智能奠基人图灵的《机器会思考吗》,AGI 强人工智能这个概念,也是自人工智能诞生之初就有诉求。所以我觉得强人工智能的诞生是自然而然的。

Azeem Azhar:我很好奇的是,当我们在思考 AGI 强人工智能时,会不会陷入人类中心主义的陷阱?比如第一种是我们通过工程化的方式实现人工智能;第二种是我们推动机器理解我们的规则,导致机器智能的边界,其实就是人类智慧的边界。

李飞飞:所以,我觉得应该允许科学家做更大胆的尝试。牛顿在看星星的时候,人类还没有用上电力,但是我们要尊重历史过程中所有的努力。

AI 通常被分为弱人工智能、通用人工智能(即强人工智能)

和超人工智能

从人类智能的角度来说,更让我兴奋的是,我们的工作,让人工智能、脑科学和认知科学产生了融合。所以在斯坦福大学我们 HAI 的三大原则之一就是:通过人类启发智能。这些发展也都是双向的,我们推进对人类认知和人脑的理解,也从中学到更多的东西来提高我们对人工智能的发展。

Azeem Azhar:算法能做的事情比人类要多得多,但现在还处于初期。当你展望 15 年、20 年、30 年后,你认为我们的人工智能系统的决策能力会怎样?

李飞飞:首先对于科学的好奇心,是我们继续推动创造创新的智能机器的动力。想要让机器智能更加接近人类智能的话,就是我们本身作为人类,具备人性,能帮助机器更好地与人类交互。如果机器能够理解人类,能够像人类一样思考。

但是同样,这种发展不能没有边界。人类一直创新的方式就是,突破自己的极限。比如,我们没有汽车、马车跑得快,但是我们能够创造这些工具扩展和增强我们的能力,甚至超越我们的能力。

有时创新也不只是突破,创新是复制出人类类似的能力,通过替代人力解决问题。但不管是哪一方面,在我们推进这项技术的同时,边界必须要有。

Azeem Azhar:谢谢,李飞飞博士,谢谢你愿意抽出时间来参与我们的节目。

点击阅读原文,查看更多精彩!