69页Slides与视频!《网络联邦学习》教程,阿尔托大学Alexander Jung博士讲述大数据网络中如何用联邦学习

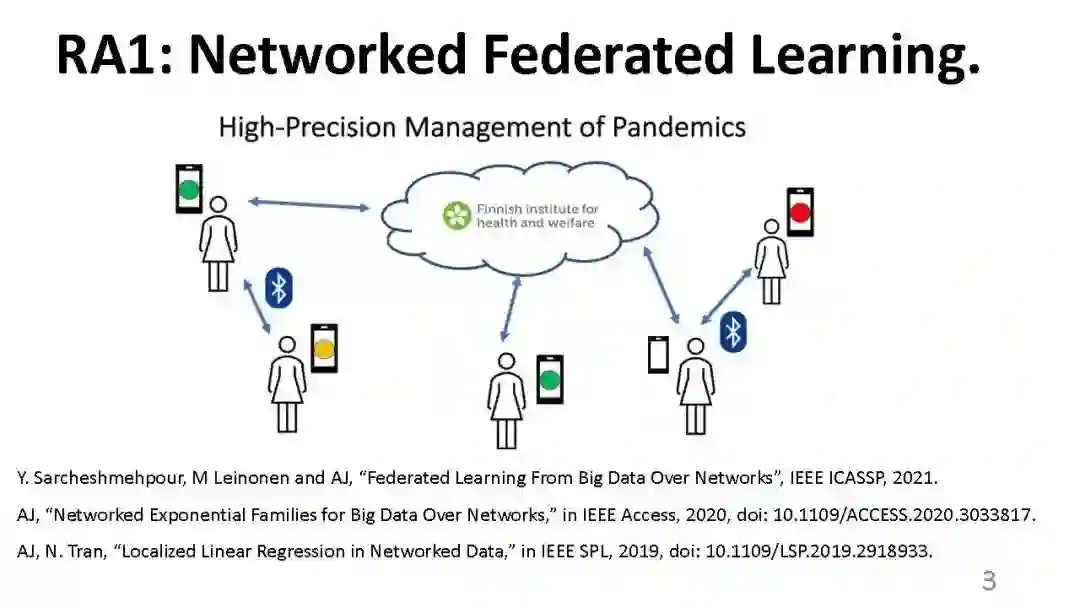

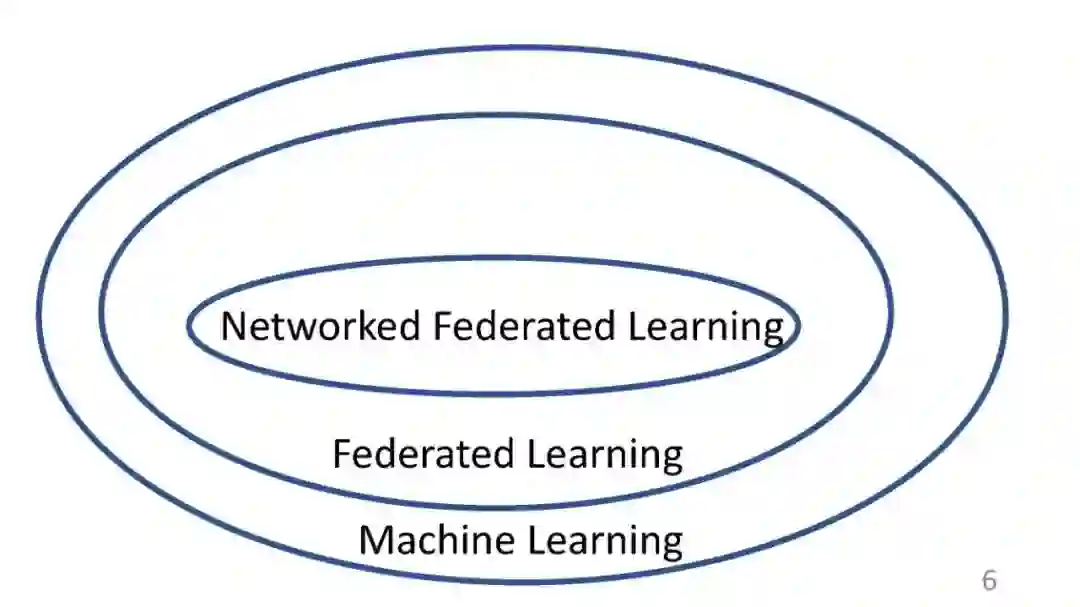

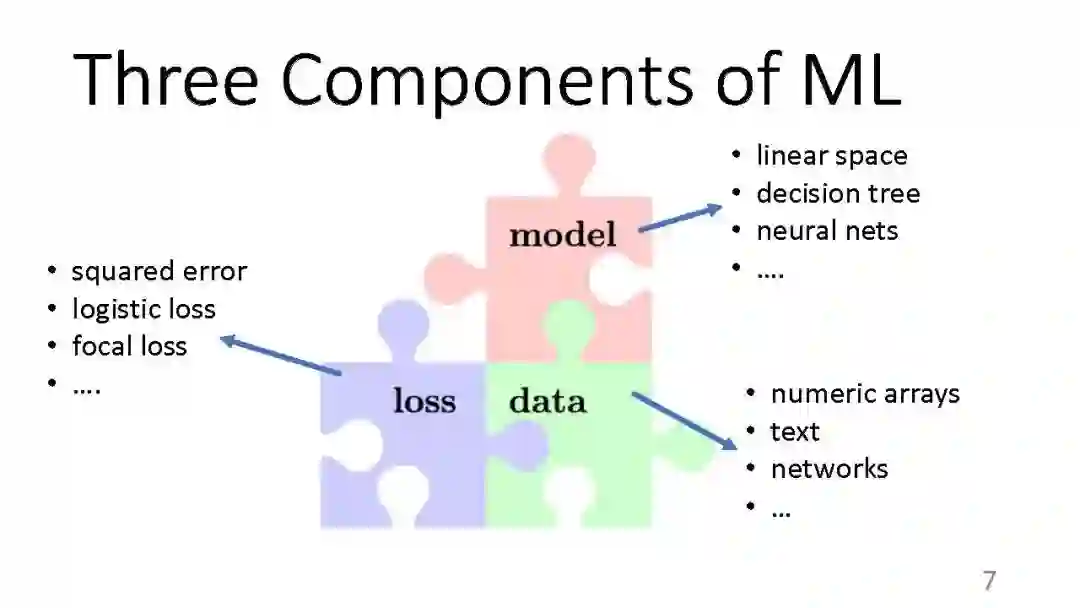

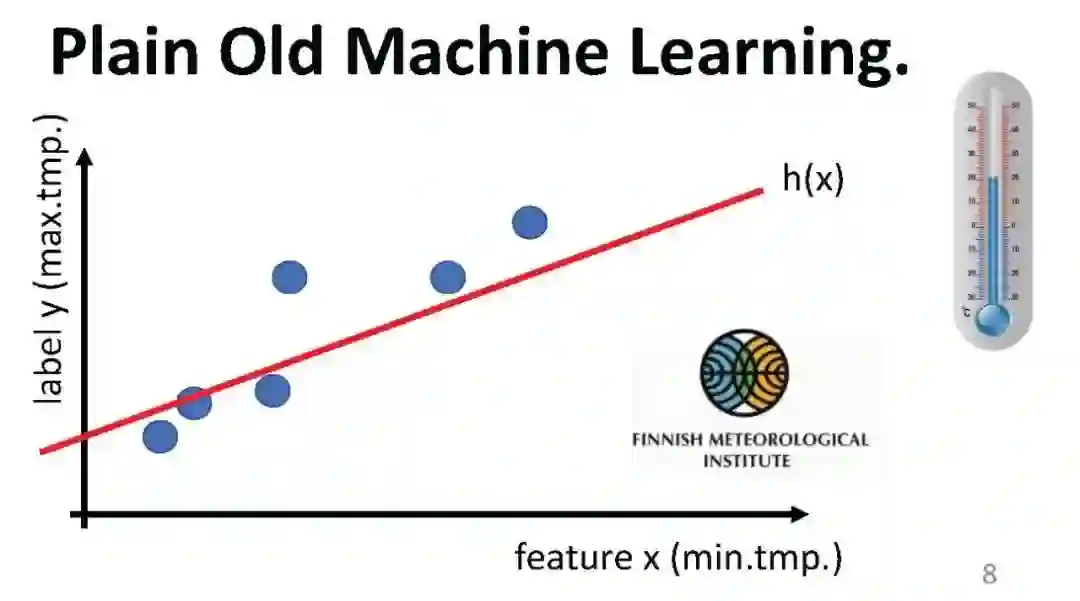

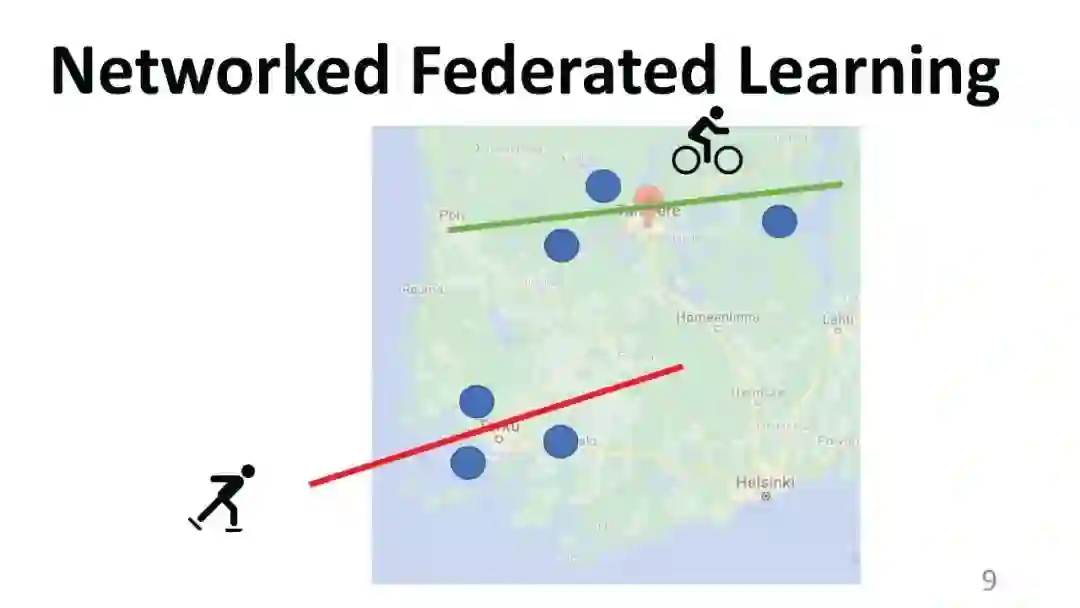

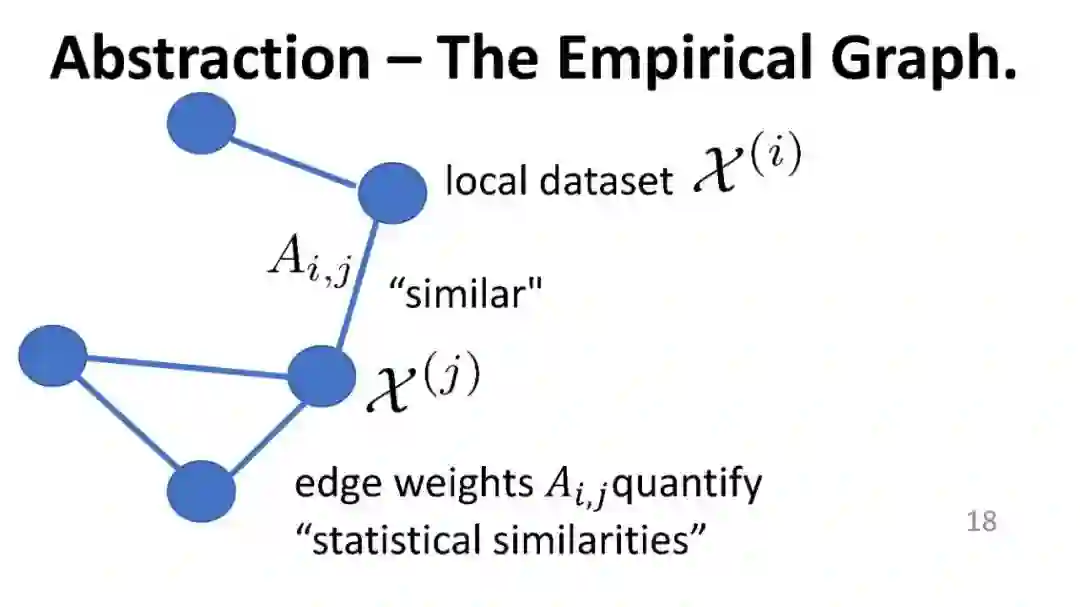

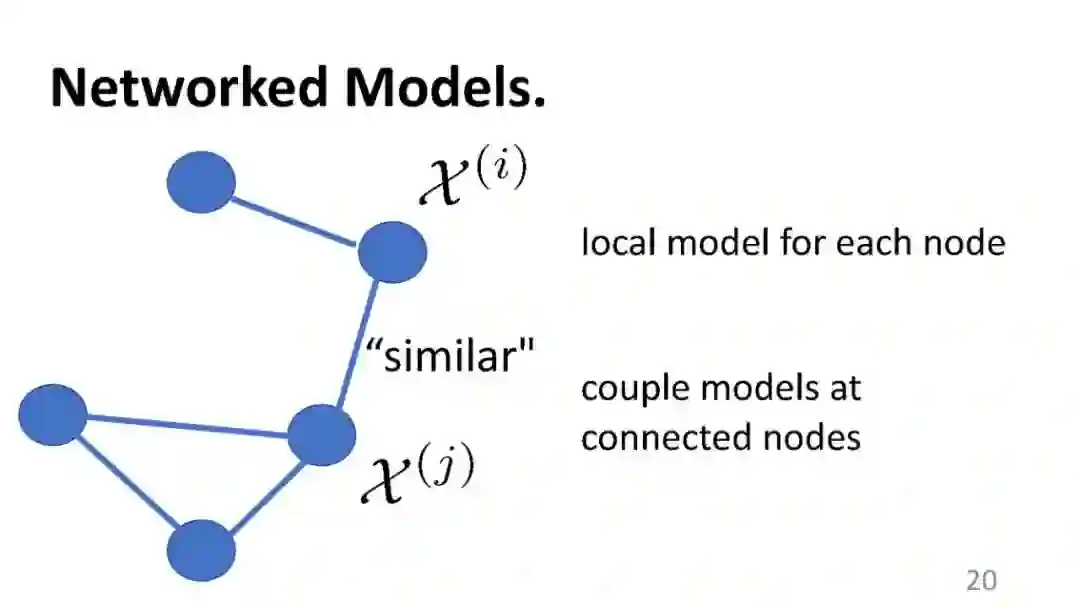

许多重要的应用领域生成异构本地数据集的分布式集合。这些本地数据集通过一种内在的网络结构相互关联,这种网络结构源于本地数据集之间特定领域的相似性概念。网络联邦学习的目的是为每个本地数据集学习一个量身定制的本地模型。我们使用广义总变分(GTV)最小化的概念作为正则化器来制定网络联邦学习。这个公式统一并在很大程度上扩展了联邦多任务学习的近期方法。我们在局部模型及其网络结构上推导出精确的条件,使我们的算法学习到接近最优的局部模型。我们的分析揭示了局部模型的(信息-)几何与其网络的(集群-)几何之间有趣的相互作用。

Alexander Jung于2012年在维也纳技术大学获得博士学位。在维也纳理工大学和苏黎世理工大学完成博士后工作后,他于2015年加入阿尔托大学,担任机器学习助理教授,领导“大数据机器学习”小组,研究网络结构数据中的可解释机器学习。Alex的第一篇论文获得了2011年IEEE ICASSP最佳学生论文奖。他获得了AWS机器学习研究奖,并于2018年成为阿尔托大学的“年度计算机科学教师”。目前,他担任IEEE信号处理快报的副主编和IEEE芬兰Jt的主席。信号处理、电路和系统。他撰写了将于2022年由施普林格出版社出版的教科书《机器学习:基础》。

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“NFL” 就可以获取《69页Slides与视频!《网络联邦学习》教程,阿尔托大学Alexander Jung博士讲述大数据网络中如何用联邦学习》专知下载链接

登录查看更多

相关内容

Arxiv

0+阅读 · 2022年7月27日

Arxiv

11+阅读 · 2021年12月16日