Science发布最疯癫视频!AI守门员以最搞笑的方式让对手抓狂

新智元报道

新智元报道

来源:Science,Nature

编辑:向学、张佳

【新智元导读】近日,Science发布了一个AI疯癫发作的视频,AI守门员以最搞笑的方式让对手抓狂,AI相扑变成大型碰瓷现场。这项研究表明,AI太好骗,不仅会被“骗”去看一些不该看的东西,还会被“骗”去做一些不该做的事情!戳右边链接上 新智元小程序 了解更多!

人工智能一直被视为学习能力极强、学习速度极快的“超级物种”,秒杀人类不解释、无商量;无论是在国际围棋比赛,还是在星际争霸游戏对决,均多次战胜人类顶级选手,所向披靡,不可一世。

但最近,Science发布了一个AI视频颠覆了大家对AI的认知,纵然是“聪明绝顶”的AI,也很容易被“坏朋友”带歪,变得让人啼笑皆非。

戳小程序查看Science完整视频“以最搞笑的方式观看AI守门员的心理状态”:

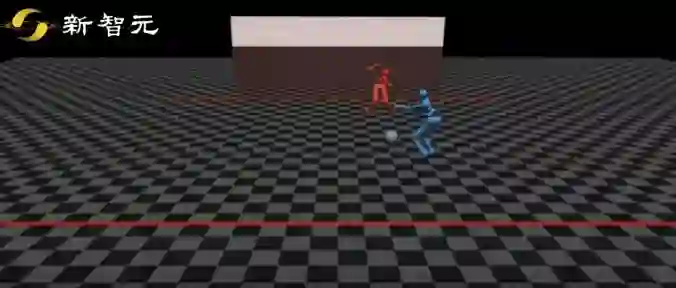

视频中,“小红人”和“小蓝人”看似是“癫痫发作”,其实是在展示一个人工智能(红色)以一种意想不到的方式战胜另一个人工智能(蓝色)。

这是发表在NeurIPS(Neural Information Processing Systems)2019 上的一项研究。这项研究是在模拟运动中进行的:足球、相扑及某人阻止跑步者越线的游戏。通常这2个竞争对手都是通过互相比赛来训练的。

小红人假装倒地迷惑小蓝人(足球运动)

在上面这个动图中,小蓝人本来要射门,但一看到守门员小红人倒了,自己也抽搐起来,简直像癫痫发作,连球都够不到了。

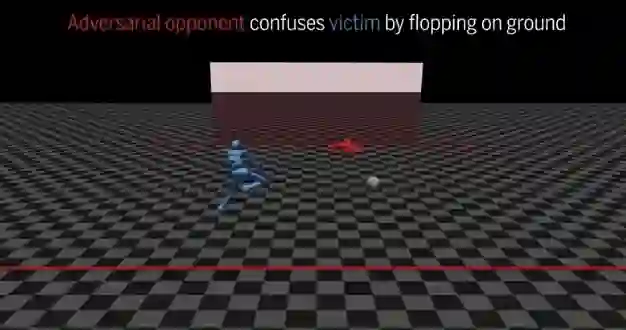

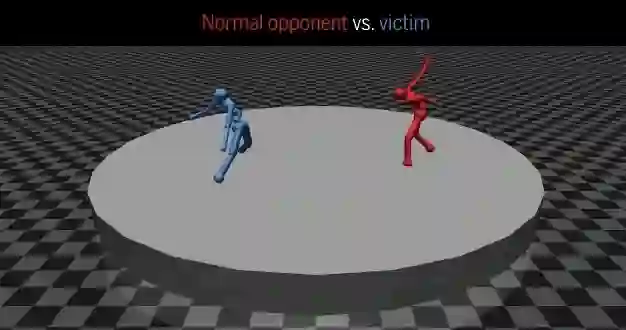

小红人假装倒地迷惑小蓝人(相扑运动)

这张动图中,两个AI本来应该相扑(也可能是摔跤),小红人先来个假摔,小蓝人见势也马上跪倒了,简直是上演了一场“碰瓷”大戏。

小红人假装倒地迷惑小蓝人(阻止越线)

这张动图中,小红人本应该阻挡小蓝人“越红线”,但小红人没能抱住小蓝人的大腿,让小蓝人绕过去了,眼看着小蓝人要突破红线,小红人扑通一声跪倒在地,小蓝人也跟着倒下了,未能突破红线。

被小红人这样干扰后,小蓝人输掉的游戏次数竟然是正常情况下的2倍!

这项新研究表明,AI很容易被骗,不仅会被“骗”去看一些不该看的东西,还会被“骗”去做一些不该做的事情。想象一下假如用到自动驾驶,会有多么危险?

微小改变就能愚弄AI,AI距离真正的“聪明”还有点远

让人工智能变得“更聪明”的一个方法是让其从环境中学习。例如,未来的汽车可以获得更多的“经验”,进而更好地“阅读”路牌并避开行人。但这正好也是黑客用来“愚弄”人工智能的“惯用伎俩”,他们可以利用这些系统进行“对抗性攻击”,比如通过精巧地修改图像就可以“愚弄”人工智能,一个带有几张贴纸的停车标志可能会被人工智能系统视为限速标志(这肯定会让自动驾驶汽车公司在微风中瑟瑟发抖!)。

利用贴纸,图像识别算法将停车标志认作限速标志

在一次国际机器学习会议(International Conference on Machine Learning ,ICML)上,一个研究团队报道了他们的3D打印乌龟。对于人类来说,它看上去就像一只乌龟;但对于人工智能,它们却有着不同的看法——在大多数时候,人工智能会认为这像是一支步枪!

利用难以察觉的元素,对抗性攻击欺骗图像识别算法,使其将3D打印乌龟认作步枪

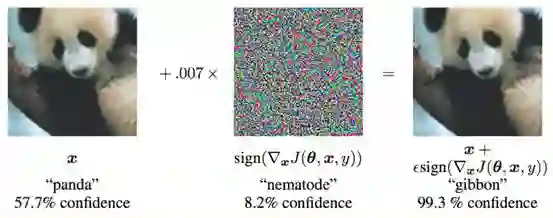

在下面这张图中,用机器学习模型识别最左侧的图像,可以正确识别出来这是一只熊猫。但是在图像中增加了中间所示的噪声之后得到的右侧图像,竟然被模型识别成一只长臂猿(而且置信度还非常高)!

这说明,对输入的改变——以人类通常察觉不到的微小改变的形式——就可能会扰乱最好的神经网络,进而改变模型的预测结果。

AI如此好骗,你怎么看?欢迎来小程序一起探讨~

参考资料:

https://www.sciencemag.org/news/2019/12/watch-ai-goalie-psych-out-its-opponent-most-hilarious-way

https://www.nature.com/articles/d41586-019-03013-5#ref-CR1