行家来信 | 我在国际AI开源组织LFAI当董事的200天

来信行家:肖涵 腾讯AI Lab高级科学家

量子位 出品 | 公众号 QbitAI

编者按:在国际知名开源组织工作是一种怎样的体验?目前中国组织和公司,正在越来也多参与到全球技术开源的生态建设中,口碑和话语权也在不断加重。

但开源组织究竟如何运作?在其中工作又如何建立信任和话语权?之前还没有人能完整分享。

幸运的是,代表腾讯在LFAI开源基金会担任董事的肖涵博士,现在可以在真实一线体悟后回答上述问题、分享个中经验。

LFAI全称Linux Foundation Artificial Intelligence,是目前世界上最大的非营利性开源联盟——Linux 基金会旗下专注于人工智能方向的子基金会。

之前业内颇有影响的Angel分布式机器学习框架(腾讯开源)和Horovod分布式训练框架(Uber开源)都在LFAI基金会中孵化。

行家简介:肖涵,腾讯AI Lab高级科学家、LFAI开源基金会董事、德中人工智能协会会长。

肖涵的Fashion-MNIST和bert-as-service开源项目分别被评为2017、2018年世界范围内最为流行的AI开源项目之一。

其中Fashion-MNIST已经成为机器学习基准数据集之一,在谷歌学术上拥有超过一千篇论文使用了该数据集。

肖涵在德学习生活工作近10年,2014年博士毕业于德国慕尼黑工业大学计算机系,2009年本科毕业于北京邮电大学信通工程。

加入腾讯之前,肖涵在位于柏林的Zalando Research任高级科学家。肖涵所创办的德中人工智能协会是德奥地区颇具影响力的国际非盈利组织之一,其会员超过700名,亦被Nature杂志提及。

△作者:肖涵(微信ID:hxiao1987)

全文要点:

LFAI基金会的组成

我在LFAI的工作

对于AI开源社区的思考

正文全文:

从2019年3月起,我开始代表腾讯在Linux Foundation Artificial Intelligence (LFAI) 开源基金会中兼任Board Member(董事)。

Linux 基金会成立于2000年,目前是世界上最大的非营利性开源联盟;而LFAI作为Linux基金会旗下专注于人工智能方向的子基金会,成立于2018年。

其拥有来自腾讯、AT&T、诺基亚、华为、中兴、百度、爱立信、IBM、滴滴、RedHat等13家公司会员。

那么在LFAI基金会的200多天里,我都做了哪些工作?开源基金会的日常运作是怎么样的?我从中学到了什么?在这篇文章里我会向大家一一介绍。

希望能让大家对非盈利组织的日常运作有更多的了解,对国际开源联盟有更多的兴趣。

在AI技术日趋工程化的今天,开源社区需要什么?我们又该如何构建一个有价值的AI开源项目?中国AI在出海时又会遇到哪些困难?我也希望与大家分享下我在这几个问题上的个人理解。

在内容上,我尽量不涉及专业但又不失专业,希望让更多拥有不同背景的读者都能够读完全文,对中国AI技术开放和国际化上有些不同的认识。

1. LFAI基金会的组成

LFAI基金会内部组织架构分为管理(Governance)、技术协调(Project Coordination)和项目实践(Technical Project)三个的方向的团队。

其中管理团队决定了基金会的发展和运作方式,具体可细分为董事会(Governing Board),业务拓展子委会(Outreach),法务子委会(Legal),经费子委会(Budget),策略子委会(Strategy)和2019年9月新成立的AI伦理子委会(Trusted AI)。

由于LFAI基金会成立时间不到两年,人员相对稀缺,所以来自会员公司的负责人往往会同时参与多个子委会。

比如我自己除兼任董事成员外,也在业务拓展子委会中帮助LFAI在国际开源社区中上扩大影响力。

每个子委会都有自己的主席(Chair):

董事会的主席自然也就是LFAI的主席,由在开源领域15年实践经验的Ibrahim Haddad博士担任;

业务拓展子委会主席是由自华为SoftCOM AI的CTO Jessica Kim担任;

值得一提的是,来自于腾讯研究院的高级研究员Jeff和来自IBM的Jim Spohrer和Animesh Singh共同在此担任AI伦理子委会中担任联合主席。

关于AI伦理子委会的故事,后面我会详细的介绍。

技术咨委会(Technical Advisory Council)是LFAI技术策最重要的组成部分,其成员主要来自于各个公司的一线技术人员,用于把控开源项目的技术质量。

Angel的核心开发者Fitz就是其中的一员。技术咨委会也是一个开源项目进入基金会孵化和从基金会毕业时所需要面临的第一关。

这个过程有点类似于答辩:外部开源项目的负责人被邀请到技术咨委会的电话会议上进行一个40分钟的演讲,接受咨委会成员的提问。

技术咨委会随后会发起一个投票表决,通过项目的技术含量、开源生态、社区互动等几个维度决定该项目是否可以进入基金会孵化。

当一个孵化的项目准备从基金会中毕业时,技术咨委会会再次通过答辩、投票表决的形式评价该项目的成熟度,报告给董事会,最终由董事会投票决定。

成功毕业的开源项目会获得Linux基金会资源和社区上的全力支持,每年也会获得LFAI基金会的现金资助。

除此之外,技术咨委会也会定期在线上跟踪孵化项目的进度,从而保证LFAI下各个开源项目的健康。

△LFAI内部组织架构及参与其中的腾讯员工

2. 我在LFAI的工作

从2018年LFAI成立起,腾讯就是该基金会顶级会员。不过由于行事过于低调,我司在基金会中的存在感比较低,尤其在基金会的一些决策上没有能充分利用好顶级会员的权利。

为此,Linux基金会的负责人在2019年3月来访腾讯时,还特意友好的提醒了我们要增加与基金会的互动,积极行使创始成员的权利和责任。

2019年初,随着我进入腾讯技术管理委员会下设的对外开源管理办公室,我从上一任手中接过了LFAI负责和代表。

在AI开源方向,我有些成功的经验。我的Fashion-MNIST和bert-as-service开源项目分别被评为2017、2018年世界范围内最为流行的AI开源项目之一,在社区内产生了不小的影响:Fashion-MNIST已经成为机器学习入门基准数据集之一,而bert-as-service开启了预训练模型服务化的先河。

除技术之外,我也比较熟悉非盈利组织的运作方式。我2017年在德国注册成立的德中人工智能协会,从一开始的7个人一步步发展到如今德中两国超过700名会员,14位国际化的管理团队成员,还被Nature杂志提及。

因此对于非盈利组织的运营方式、国际化团队的领导和文化互信上我都有较为清晰的理解和实践经验。

在接过此棒时,我有着极大的信心和热情去做好腾讯和LFAI基金会之间的工作,增进互信合作,扩大双方在AI开源社区上的影响力。

2.1 重拾话语权

在接手LFAI的董事工作之后,我做的第一件事情就是仔细阅读LFAI基金会的章程(Charter),了解基金会的条例、选举投票规则和不同级别的会员权利。对于非盈利组织(NPO)不太熟悉的朋友,可能不太清楚章程是什么。

我在这里解释一下,每一个非盈利组织都会有一个章程,这个章程规定了组织的目的、兴趣范围、运作方式、会员权益和选举规则。

章程之所以非常重要,是因为当地法院一般会对非盈利组织的章程进行备案,是有效的法律约束。

如果出现纠纷,无论是内部纠纷还是NPO与外部的纠纷,章程都可以在必要时作为法律依据。而章程上的更新,需要会员表决通过后再到法院重新备案。

了解LFAI的规则和玩法之后,我要做的就是重拾腾讯在基金会中的话语权。具体来讲包括,积极与主席和其他董事互通邮件,按时参加月度的董事会、各个子委会的工作同步,并且对征询和投票提出意见。

这些看似简单琐碎的小事,能够坚持做到却并不容易。在接管LFAI的工作后,我发现腾讯在技术咨委会(TAC)和业务拓展子委会(Outreach)中的代表席位都是空缺,于是我便把这两个职位也都接了下来,积极参与到他们的日常讨论中。

等到我熟悉了各个职位的目的、使命和规则后,我再把职位分派出去。身兼数职的我在忙时,一周连续三次不同主题的视频会议,被安排在晚上11点、12点或是早上7点。

我这样做的意义,一方面让自己去熟悉这些子委会的话题,明白每一个子委会到底是做什么的,日后可以更有效的举荐腾讯内部合适的同事参与讨论;另一方面也是释放一个积极的信号,让其他的成员留下腾讯在基金会中积极参与的印象。

虽然基金会下中国会员公司不占少数,不过以我几个月来的观察,国外公司在每次讨论时话题的参与度往往较国内友商更为积极。

这其中语言和文化上的差异是一部分原因:中国人在表达自己观点时会比较害羞。另一个原因是对基金会章程和非盈利组织的玩法的陌生,也使得国内公司在讨论时未能涉及重点,在行使权利时也不够高效。

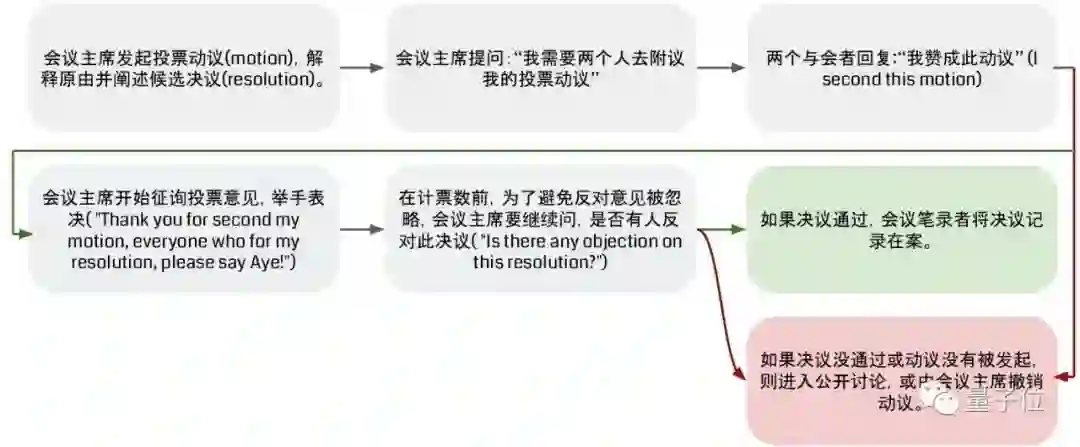

我这里举一个开会时的小细节。LFAI基金会每次开视频会议的时候都会走一套固定的流程:

签到(Roll Call) -> 表决上次会议纪要(Approval of Minutes) -> 处理具体事务 -> 表决 -> 最后5分钟自由讨论。

这一套看似八股文的固定流程,实际上每一个环节都不可或缺。比如签到(Roll Call)的目的是确保法定人数(Quorum)足够,此会议中的表决才有效。

上次会议纪要的通过是确保所有参会人员对到现在为止的决议都达成了共识。值得一提的是,在会议中的每一次表决时,会议主席(Chairperson)可不是直接让大家举手进行Yes/No/Abstain(弃权)投票。

而是首先需要得到至少两个与会人赞成这个投票动议(to second this motion),然后才能向大家发起投票。

如果没有人表态赞成这项动议,那么主持人只好放弃此动议。这一套流程看似多次一举,却能够有效避免Chairperson发起无意义的投票,在参会人数较多时能够保证会议高效进行。

实际上,这套议事流程正是《罗伯特议事准则》(<Robert’s Rules of Order>)中的一部分,对于欧美西方国家的人来说可能在高中就已经学过并早已熟记于心,对于中国人来说相对比较陌生。

有人可能会问,知道这些形式主义的东西有什么用呢?反正我又不是会议主席。

这一认识也是有误的,会议主席(the Chairperson of the meeting)和LFAI的主席是两码事。会议主席可以是轮值的,也可以是被任命的。

当你有一天做为会议轮值主席时,如何有效的组织大家表决动议,如何展示出中国公司对规则的尊重和在细节上的认真态度,就显得尤为重要了。

清楚规则,尊重规则并且熟练运用规则,是赢得国际友商的信任的重要一步。

△这是一次技术咨委会的例会中会议主席如何发起动议促成某开源项目进入LFAI孵化

随着我在基金会中的互动增加,话语权逐渐回归。国际友商看到腾讯在此展现出的积极态度,都释放出了友好合作的信号。

我的两个提议:将LFAI的日常会议时间提前以方便亚太地区的会员公司参加,以及将董事会面对面的地点从美国移到欧洲以减少国内AI人员赴美参会时遇到的签证问题,都得到了其他成员的支持并已经落实。

在基金会的一些重大决定上,包括年会举办、项目孵化流程和预算规划上我也都积极参与决策,并提出建设性的意见。

2.2 建立伙伴

信任和友谊是所有合作的基石。而建立友谊最有效的方式就是一起去做事情。

2.2.1 与华为合办上海LFAI开发者沙龙

2019年6月初,LFAI基金会为了扩大在中国社区中的影响力,筹备9月份在国内举办一次线下沙龙活动。但是基金会的人力资源远在美国,所以活动的真正落地还是需要依靠几家中国会员公司。

我相信无论是AI的研究者或是开源代码的贡献者,大家都会享受站在台上被聚光灯环绕的那一刻。

但是对于会议的预备、组织、物流等各种繁琐前期工作,能够自告奋勇站出来的人大概不多,尤其是非盈利组织的活动。

对于第一次在国内举办活动的LFAI,国内会员公司更多的是持观望态度。在这个时候,来自华为SoftCOM AI的CTO Jessica Kim站出来愿意提供会议筹备上的支持。

在和腾讯开源办公室的同事商榷后,我代表腾讯很快站了出来愿意与华为合办好这一次活动,此时国内的其它会员公司还在观望或沉默。

就这样,由华为、腾讯以及Linux基金会亚太地区负责人组成的会议筹备小组成立。大家商定好每周的同步时间,从会场、宣传、直播、物流、嘉宾等多个方向相互配合。

在会议开始的前一天,我还与会议筹备组的朋友们一起在咖啡厅去编排会议流程,以确保各个环节顺利进行。

当你环顾四周,看到来自不同公司的朋友们努力做好同一件事情的时候,是会被开源的力量所感染的。在这里我要特别感谢腾讯TEG办公室Xingjia和Barnett在直播上提供的技术支持,两位同事专程从深圳来到上海确保了直播的顺利进行。

最终,第一届LFAI开源沙龙活动上海站吸引了100余人的现场参加和线上1500人次的直播观看,来自华为、腾讯、阿里、百度、滴滴、微众银行等开源项目负责人在此沙龙中做了主题分享。

Linux基金会亚太地区的几位负责人和代表出席了会议,他们高度认可会议的质量。LFAI的主席Ibrahim和其他成员在之后的视频会议中也对筹备组的执行力赞不绝口。

对这个结果我还是很满意和骄傲的,这件事的成功也让我们在基金会中建立了友谊交到了伙伴,这比会议本身的成功更为重要。

△LFAI基金会上海站开源沙龙活动

有人可能会问,你不是做开源社区么,怎么讲着讲着感觉做成会议接待服务了?真正做开源社区就是这样,不是每天站在聚光灯下讲话宣布个某某软件开源就是做社区了,开源不是开发布会,不是做个单方面的PR就完事了。

做开源社区是需要接地气的,是需要有人去做这些不起眼的琐事去持续性的维护。你可以把会议组织的琐事就像解决一个一个的线下”Issues/Tickets”,就如同线上的一样,这些Issue同样来自于社区而服务于社区。

无论线上线下,只有对解决Issue抱有耐心,才能做好开源的社区化。如果开源作者想的全是如何在闪光灯下搞个大新闻,那就如同把项目放在Github上后不再去维护一样,这一定不会是个成功的项目。

也有人会说,你费了那么大劲儿,联合腾讯华为两家的资源力量,最后只搞了个100人的小会,还有什么可在这说的呢。

要知道,公司再大,真正落实做事的是个人。对于开源这盘新游戏,它带来的价值往往是不能通过短期KPI/OKR来量化的,它的打法也不是每一个人都熟悉的。

就好比一个人下了很多年的围棋,段位很高且乐此不疲,这时候你走过来突然说我们来打麻将吧,麻将好玩。你觉得他能和你一起玩么?所以,如何去说服大家去认同开源价值,有效地整合资源,无论公司大小这都是真正做事的人需要解决的实际问题。

就我个人而言,我不太喜欢一次搞个大新闻,弄得好几百人参会然后媒体争相报道。前进的步子不需要一次迈的很大,只要一步步朝着正确的方向就可以了。

2.2.2 为IBM的入会背书

2019年8月,IBM决定加入LFAI成为会员公司,这无疑是对基金会的重大利好。

从Deep Blue深蓝到Jeopardy智力抢答,IBM在人工智能方向上的贡献和成就是大家有目共睹的。

此次IBM加入LFAI也带来了它在AI伦理上的几个重要开源成果:AI Explainability 360, AI Fairness 360和Adversarial Robustness Toolkit,这将完善基金会在可信任及社会责任AI上的技术光谱。

对于把科技向善作为公司使命的我司来说,也可以借此机会相互交流经验方法,探寻合作的可能性。

在LFAI与IBM正式发布新闻稿之前,LFAI主席Ibrahim希望先向现有会员征集对IBM的引荐和背书(quote),表达对IBM加入的欢迎。

这么一个简单的请求,很容易被遗忘在每天的繁忙工作中。但其实短短的一两句话几分钟的时间,为国际友商帮个小忙,可以展现出我们在基金会中开放友好的形象和外交技巧。

虽说小信未孚,但很多细枝末节的小事,一点一点夯实,这样建立起来的信任往往更加牢固。

△各个会员公司为IBM加入LFAI基金会的引荐

在今年4、5月时,中美贸易战紧张,美国科技公司接连服从出口管制,再加上Github又封掉了几个账号,一时间国内开源技术社区也弄得风声鹤唳。很多技术人员担心平时依赖的开放平台是否有朝一日不可用,是不是需要在国内重造一批轮子。

无论是开源基金会还是个人开发人员,心情上多多少少都会影响。开源本是件带有理想主义色彩的事情,而到这种时候理想主义者也难免被迫站队。相对于重新造轮的Plan-B,我更想强调的是日常Lobby,即游说,尤其是技术文化上的游说。

有些人可能管这个叫Advocacy或Evangelist。技术外交,简而言之,就是要让我们在国际上交到好朋友,形成联盟。我认为,外交不该只在危机来临时去突击,而需要贯彻到每天的日常中。

具体如何做呢?

比如在基金会中,积极参与日常讨论和事务处理,与国际伙伴之间形成良好沟通,建立文化互信;

与各个国外公司开源办公室的负责人保持良好的关系,定期互访;再往深了做,可以共同制定规范和标准。

又比如:很多国际伙伴认为中国技术大多抄袭和跟风,中国企业对数据安全缺乏理解,这就需要有人站出来去演讲、去回答、去在圆桌会议中开诚布公的谈论。

借助国际开源平台、内外会议、民间meetup等实现技术人对技术人的游说,从技术文化层面建立互信。公司之间相互利益固然重要,但对于一个技术公司,技术文化上的互信是合作的基调,毕竟具体做事情的是个人。

无论是Linux基金会还是Apache基金会,在国际开源基金会的每一位公司代表都应该是一个好的Lobbyist,他/她能在国际社区中展示出一定的个人魅力、感染力和外交能力,扩大技术”朋友圈”,树立友好形象。

△ 我在德国、奥地利科技公司与其开源项目团队交流

对于一些刚入行的工程师来说,做Lobby的意义短时间内不好理解。毕竟从”talk is cheap, show me the code”的不talk,到勇于”talk openly”需要一定的时间和经验积累。技术游说让我们能跳出日常的二进制思维,一方面布道技术影响力,另一方面也在国际舞台上展示中国企业的开放友好姿态。

如果某一天形势所迫真的需要大家去站队时,即便是理想主义者的我也不会期待每一个公司都能顶住压力挺中国,但我希望这些伙伴心里能够明白真实的中国是值得互信和合作的。

2.3 走出代码,构建健康向善的AI生态

2019年9月,LFAI基金会下的Trusted AI子委会正式成立,旨在解决开源项目中的AI伦理冲突以及可信任、可解释性等诸多新问题。

而子委会所探求的解决方案,既可以是具体的技术方案,比如前文中所提到的IBM AI Fairness 360;也可以是宏观的框架。

AI到底向不向善,这个问题不应该是AI工程师们在办公室里敲代码敲出来的,而应该集思广益,尊重并整合社会科学以及其他领域的多边意见。

实际上,对社会科学正确的理解往往比解决那些所谓的AI挑战性问题更为重要。

我这里举一个例子,最近EMNLP 2019——全球NLP顶会,接收了一篇扩展Attention注意力机制的深度学习模型”read-attend-comment”论文。

该论文提出了一个端到端的深度学习方案根据新闻内容去自动撰写评论。抛开模型的技术实现,这个研究是否会造成伦理上的问题论文中没有进行任何的提及和讨论。

实际上,这种构建假新闻(disinformation)、假评论(trolling)的AI一旦被广泛使用是会对社会的信任感造成潜在危害的。

研究人员往往过分沉迷于技术本身,而忘掉了自己也始终是社会的一员;无论你专业领域多么聪明,聪明永远不是逃避社会责任的借口。

有人可能会说,你可别在这给我扣大帽子了,我在EMNLP发个学术论文怎么就扯到社会责任感上了呢?

如果你是AI从业人员,那你一定知道,当今的AI已经高度工程化,从你的论文到代码实现再到app上线,这其中的门槛已经比10年前降低太多,或许一两周的时间,你所提出的技术就可以被部署投入实用。

在明知可能造成社会负面影响的情况下,不去在论文中主动提及,如果这不算是逃避,那就是说明AI方向上伦理(Ethics)和合规(Compliances)的普及还不够深入人心。

纵观人类史,无论是火药、炸弹、还是核能,历史一遍又一遍的告诉我们:只要科技上的进步能被用来伤害人类,它就一定会。

即便这样,为什么我们仍对科技进步报以极大的信心?因为科技本身的价值不应该被它的使用方式去衡量,尤其是那些为社会和人类带来危害的方式。一项技术上的革新,如果没有合规框架和伦理上的约束,那是非常危险的。

我曾在德国学习生活工作近十年,欧洲这边对于AI伦理、隐私、数据保护问题的讨论一直持续不断。相信在欧洲生活过的朋友们,对于欧洲在社会责任感上的自觉性和技术伦理上的先行性也都是认可的。

今年在奥地利举办的Darwin’s Circle峰会上,我在台上被欧洲的朋友们问到中国AI发展和数据隐私问题。我打了个比方:

“It’s just like eating soup. You European and western guys like eating soup before the main dish. We Chinese like eating soup after the main dish. Either way, we both like soup and we will eat it sooner or later.”

主持人大笑,而在场的很多欧洲朋友会后对我的这个比方赞不绝口。我想传达的意思,不是说我们中国没有重视数据隐私和AI伦理问题,而是每个国家发展AI的方法不同,“打开方式”不同,本无孰优孰劣,而道德问题是各个社会各个国家所面临的共同问题,迟早需要去解决。

△我在Darwin’s Circle峰会

话说回来,LFAI基金会下的这个Trusted AI子委会不能靠我在这抖机灵,而是需要专业的人才去有理有据的发声。

平时我也会经常翻阅一些公众号,关注国内对伦理科技社会责任的讨论。我发现在AI伦理方向,其实腾讯有丰富的理论储备和完整的伦理框架。

在2019年1月4日,腾讯研究院参加了由Elon Musk资助的未来生命研究所(Future of Life Institute,FLI),在波多黎各(Puerto Rico)组织举办为期两天半的“向善的通用人工智能2019(Beneficial AGI 2019)”国际研讨会。

该会议邀请了150多位来自全球各地的各领域顶级人工智能专家,从跨学科、跨领域的角度共同探讨通用人工智能的安全、实现路径及可能的后果、治理及对策、国际合作等话题。DeepMind等AI企业也受邀参加。

腾讯研究院院长司晓在会上展示并阐释分享了腾讯的“ARCC”方舟伦理框架(A即available(可用),R即reliable(可靠),C即comprehensible(可知),C即controllable(可控),英文简称ARCC与Ark方舟恰好同音)理念,获得了与会专家的认可。这个框架的英文版还发表在了世界经济论坛上。

抱着尝试的心态,我顺着一篇公众号文章联系到了腾讯研究院的高级研究员Jeff,和他表达了Trusted AI子委会的理念和目标,希望邀请他参与到LFAI的日常中来,用他的专业知识来扩大中国企业在科技社会责任感上的国际影响力。

Jeff作为社会科学从业者和我这个工程人员本没有任何交集,不过几次电话和当面沟通后,我的想法很快得到了Jeff积极回应。

现在,Jeff也是LFAI中的一员,做为AI伦理子委会(Trusted AI)的联合主席在国际舞台上发声。

我在LFAI的工作就介绍到这里。今年10月底,我会出席Linux基金会在里昂举办的开源峰会和LFAI的董事会。在那里我会和其他董事一起,统筹下一年的规划和重点。

3.我们到底需要怎样的AI开源

在结束之前,我还有个问题希望与大家讨论:我们到底需要怎么样的AI开源?

相较于传统软件领域的开源,AI领域的开源最近几年一直在闪光灯下。每一次算法和模型和的公开,都会引得媒体争相报道。

随着AI模型迭代速度越来越快,有些AI方向上的开源变成了占山插旗子:研究者将代码上传到Github上视作一个项目的终点而非起点,之后就不再去维护,而转向另一个山头。

这种现象似乎也是情理之中。首先AI本来就是一个竞争激烈的行业,如果不去占快速插旗子山头,那么很快你的风头就会被别人盖过。

其次,很多研究人员非常熟悉那套会议论文模式,做实验赶deadline,投会议回rebuttal,一旦论文录取则万事大吉,短暂庆祝后转向下一个研究点。对于开源需要维护这件事情,大多数研究人员是没有思想准备的。

最后,也是人性使然:那些去冒险去开拓新领域的工作就是会比平平淡淡的维护工作要刺激的多。谁不喜欢站在风口上,谁不喜欢追求刺激和新鲜呢?

再看目前已开源的AI项目,其实做生态打配合的项目不多。举个例子,自从2018年下半年Bert预训练模型问世以来,很多NLP开源框架相继浮现。

它们力图把所有最新的语言模型囊括进来,提供一个统一的接口。这其中有不少框架是出自个人开发者。工程上,这类框架主要采用两种做法:

我不去改模型原始代码,我把你的代码包装一下,提供更丰富易用的API接口;

我完全重写了代码,我觉得我写的比原始代码要更好。

无论你采用哪种方式,当你想做大一统的开源模型框架时,就会遇到的可持续性开发的问题(sustainable development)。

AI模型更新的速度越来越快,每天都有新的模型刷榜。无论是机构开发者还是个人开发者(其实两者都一样,我还是前面的话,真正落实做事的是个人),你几杯咖啡下去熬个通宵能覆盖住几个新的模型,可是你能一直跟上今天AI模型的迭代速度么?你帽子扭到后面一咬牙说我跟得上,那么这些AI模型的底层依赖关系呢?他们背后需要的Tensorflow/Pytorch/cuda/驱动版本呢,这些你也需要在你的开源项目中进行版本管理么?

就像我们一直在喊可持续性发展,做项目也一样,做开源项目尤其讲究可持续性发展。

做开源最怕的就是体力和热情全被燃烧殆尽(Burn-out)。

3.1 给希望参与建设AI开源社区开发者的话

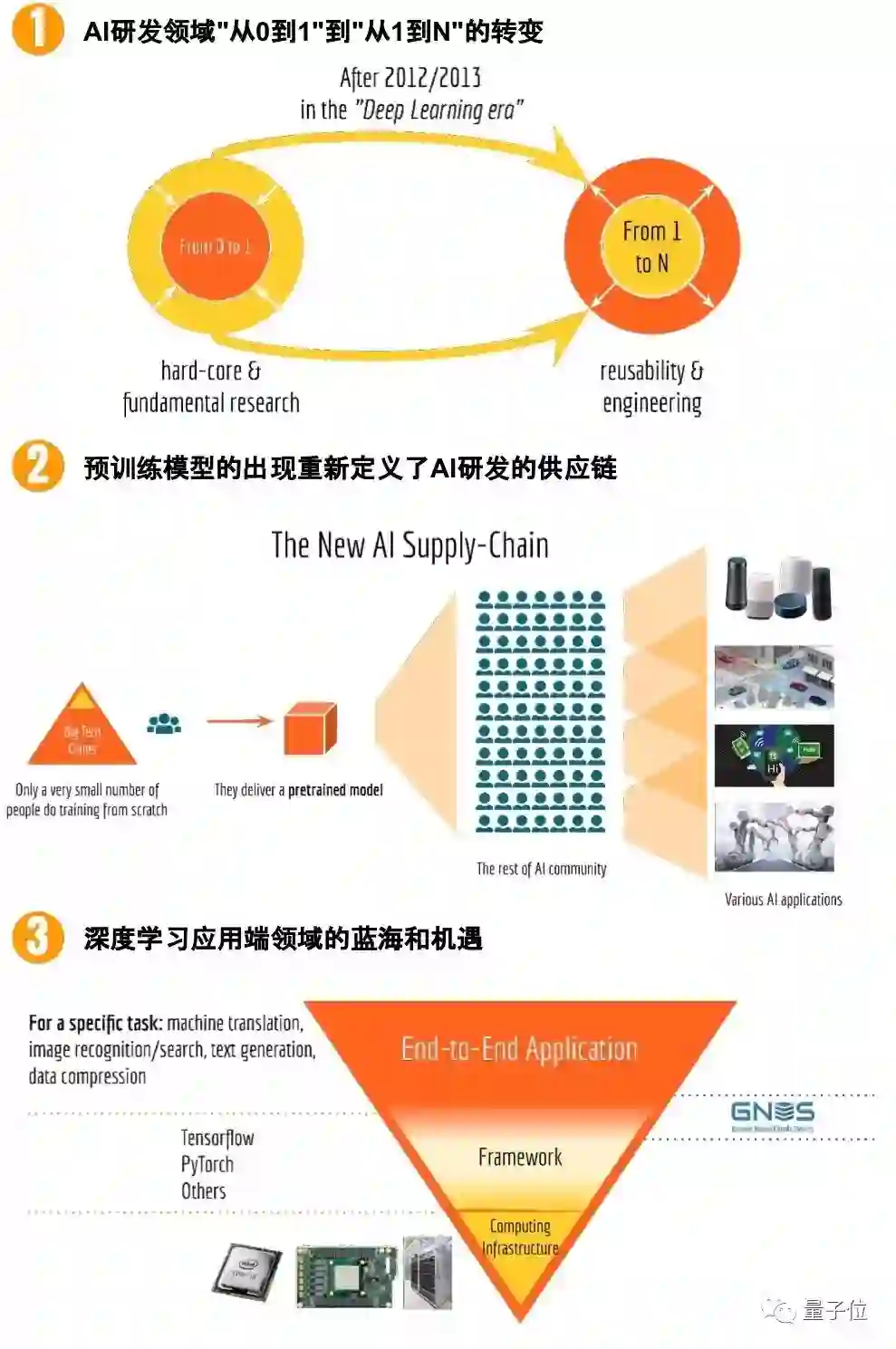

回过头看来近十年来AI的发展,下面三个观点是我想和大家分享的,尤其是对那些有热情参与建设AI开源社区的开发者:

AI研发领域已经不在是2013年以前的”从0到1”硬核创新和”从1到N”的应用创新并驾齐驱。在深度学习时代,越来越多的人转而投入到”从1到N”的应用创新上。

他们会优化已有的算法和模型,在更好的知识融合,更广的应用领域、更多的服务受众、更快的部署速度上下功夫。

而”从0到1”的硬核创新圈会变得非常小众。

预训练模型的出现重新定义了AI研发的供应链。传统的机器学习下那种一两个团队全栈负责AI训练部署分发等以整条供应链的情景将会越来越少。

大家更多的从供应链上游得到已预训练好的模型,然后去做预测时态下的工程优化。真正负责从零开始训练模型的人,会越来越少,哪怕是在大公司。

一是训练成本的高速增加,二是我们也确实没必要那么多模型:通用的知识(比如语言中的语法、比如视觉中的颜色、反光、文理)一旦模型被掌握,往往是可以跨领域复用的。

虽然计算架构层(CPU/GPU/TPU/NPU/FPGA)和框架层(Tensorflow/Pytorch)要么门槛高,要么已经是红海。

但是面向客户面向应用的深度学习市场上仍然是一片蓝海,还有很多垂直领域的机会等着我们去挖掘。

△我关于AI研发的三个观点

*如果读者有兴趣,可以在这里看到我博客(地址后附),里面配合了一些例子,也会更容易理解一些。

开源即创业

说到底,做开源项目就像做一个Startup,技术策只是其一,把代码放到Github上也只是小小的一个起点,还会有运营、有市场、有客户管理需要去考虑。

像创业一样,你需要画一个“大饼”,囊括住社区的热情和梦想;也需要有个坚定和目标才不会被社区纷杂的Issue带偏。

而作为一个拥有计算机博士学位的人来说,我一直不相信一个黑科技算法会成为开源项目的技术壁垒,我反而更相信那些工程化、社区化的东西会最终决定用户的留存,比如可移植性、弹性伸缩和用户体验。

最重要的,其实往往是你对开源的理解和信念:你是个理想主义者,那么你就会感染那些理想主义者与你一同前行;你是个注重细节的人,那么你项目中每一个小feature就会让那些在乎细节的用户津津乐道;你是个乐于助人的人,那么你所打造的社区就会感激你的无私付出。

无论你是哪种人,正是因为你相信了开源,开源才有了意义。

传送门:

LFAI开源基金会:

https://lfai.foundation

Angel分布式机器学习框架:

https://github.com/Angel-ML/angel

Uber的Horovod分布式训练框架:

https://github.com/horovod/horovod

德中人工智能协会:

https://gcaai.org

Nature杂志提及德中AI协会

https://nature.com/articles/d41586-019-01681-x

肖涵博士的GitHub:

Github: https://github.com/hanxiao

肖涵博士关于AI研发观点的完整博客:

https://hanxiao.github.io/2019/07/29/Generic-Neural-Elastic-Search-From-bert-as-service-and-Go-Way-Beyond/

量子位系网易新闻·网易号“各有态度”签约作者

— 完 —

大会启幕!预见智能科技新未来

量子位MEET 2020智能未来大会启幕,将携手优秀AI企业、杰出科研人员呈现一场高质量行业盛会!详情可点击图片:

2019中国人工智能年度评选启幕,将评选领航企业、商业突破人物、最具创新力产品3大奖项,并于MEET 2020大会揭榜,欢迎优秀的AI公司扫码报名!

量子位 QbitAI · 头条号签约作者

վ'ᴗ' ի 追踪AI技术和产品新动态

喜欢就点「好看」吧 !