“平衡发展”的人工智能治理白皮书

来源:商汤智能产业研究院

随着人工智能技术高速发展,加强人工智能伦理与治理成为大势所趋。近日,商汤科技发布《“平衡发展”的人工智能治理白皮书——商汤人工智能伦理与治理年度报告(2022年)》(以下简称“报告”),系统呈现了商汤在推动AI治理落地进程中的洞察、思考、目标与实践。

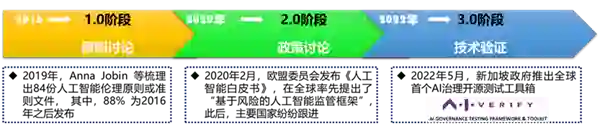

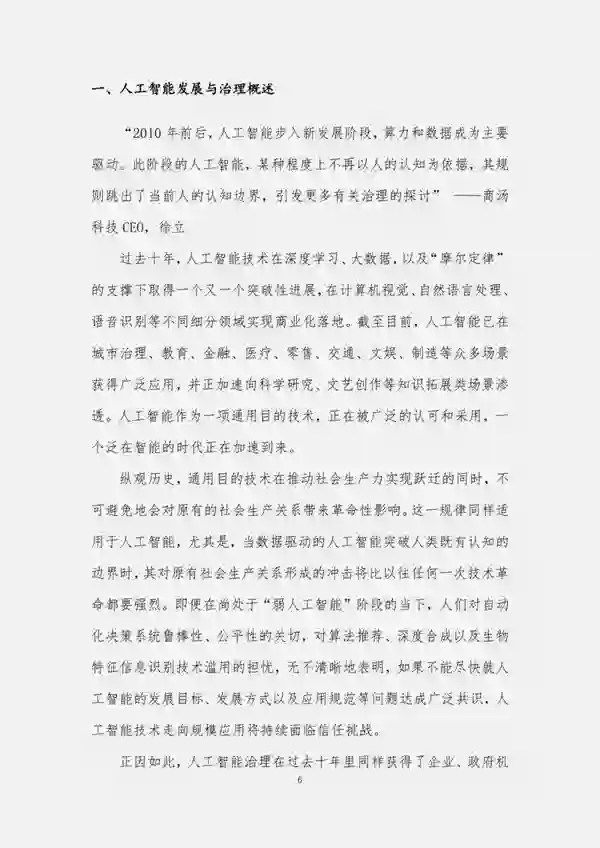

报告提出,从发展历程看,人工智能治理至今先后经历了三个发展阶段,目前,已进入落地实践阶段,即人工智能治理3.0阶段。

图1 全球人工智能治理发展历程

资料来源:商汤智能产业研究院

人工智能治理的1.0阶段

起于2016年,以原则讨论为主。哈佛大学Jessica Fjeld等在研究中将人工智能治理1.0阶段开端定位于2016年9月的Google、Facebook、IBM、亚马逊和微软等美国企业发布的《Principles of Partnership on AI》。

Anna Jobin 等通过梳理来自全球84份人工智能伦理相关的原则或准则文件同样发现,2016年之后发布的占比高达88%;其中,私营企业和政府部门发布的文件数量分别占比22.6%和21.4%。

人工智能治理的2.0阶段

起于2020年,以政策讨论为主。2020年2月,欧盟委员会发布《人工智能白皮书》,在全球率先提出了“基于风险的人工智能监管框架”。此后,主要国家纷纷跟进,均在不同程度开展了监管人工智能相关技术及应用的探索。因此,2020年也常被称为“人工智能监管元年”。

据OECD的最新监测,全球已有60余个国家提出了700余项人工智能政策举措,而德勤全球(Deloitte Global)则进一步预测 ,2022年将会有大量关于更系统地监管人工智能的讨论。

人工智能治理的3.0阶段

起于2022年,以技术验证为主。进入2022年,随着全球人工智能治理进程的持续推进,以及可信、负责任人工智能等相关理念的持续渗透,有关验证人工智能治理如何落地实施的倡议日益增多。

在政府侧,2022年5月,新加坡政府率先推出了全球首个人工智能治理开源测试工具箱“AI.Verify”;2022年6月,西班牙政府与欧盟委员会介绍了第一个人工智能监管沙箱的试点计划。

在市场侧,美国人工智能治理研究机构RAII发布了“负责任人工智能认证计划”,向企业、组织、机构等提供RAII认证评级系统。

面向3.0阶段,报告提出人工智能治理的技术验证应包括两个层面,一是通过实践验证原则、政策要求和标准的可落地性,二是通过采用技术工具验证对各方对人工智能治理规范的落实程度。

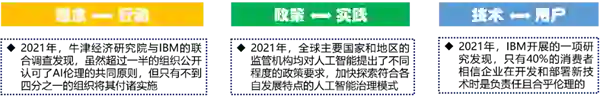

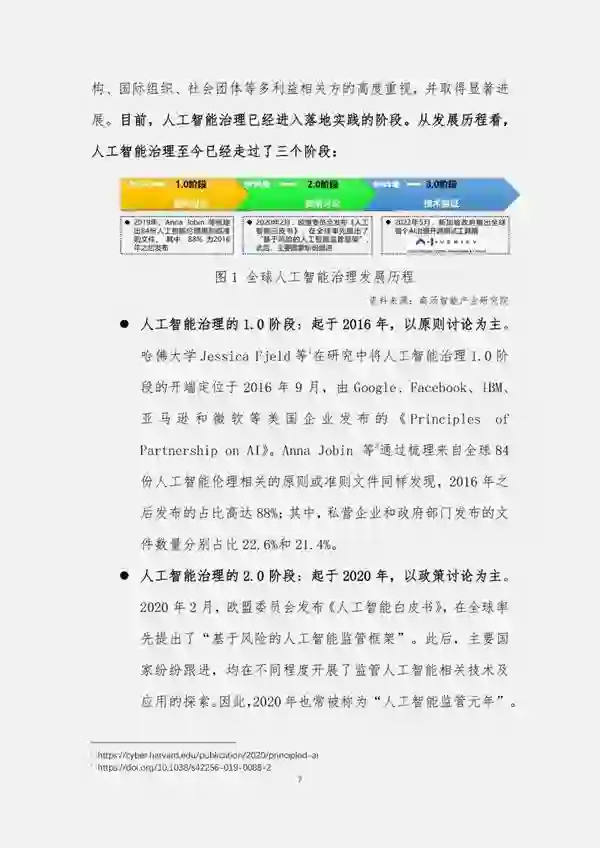

报告指出,目前,人工智能治理落地实践仍面临许多挑战,下一步,推动人工智能治理落地应重点关注以下“三组关系”:

图2 人工智能治理落地应重点关注“三组关系”

资料来源:商汤智能产业研究院

第一:理念与行动的关系。研究发现,虽然超过一半的组织发布或公开认可AI伦理的共同原则,但只有不到四分之一的组织将其付诸实施,AI治理在实践过程中仍面临诸多现实挑战:

一是人工智能治理与现有组织结构的融合问题。人工智能治理工作涉及信息安全、数据治理等与现有组织结构重叠的领域,职责交叉、工作范围难以厘清等问题在组织层面对推动落地实践形成了一定的制约;

二是伦理治理短期业务收益不明显的问题。在推动AI伦理治理工作时,业务方可能会因看不到短期收益,出现对伦理治理工作重视程度降低、治理工作落实缺位等情况;

三是伦理治理落实缺乏共识性标准的问题。

第二:政策与实践的关系。政策制定者与技术开发者的视角不同、立场不同,对政策意涵的理解也不尽相同,在推动人工智能治理落地的过程中,还需要将政策要求转化为技术和业务团队可执行的实践标准。处理好政策与实践的关系,应重点考虑以下四方面:

一是政策制定应考虑产业、技术应用的动态性和多样性,为行业发展提供一定宽松的环境;

二是不同机构、部门、国家应努力推动AI治理标准的互联互通;

三是应加强AI治理实践部门在政策制定过程中的参与程度,提升政策要求的可落地性;

四是政策层面与产业层面在AI治理相关问题的定义方面应当寻求更多共识。

第三:技术与用户的关系。目前,AI治理仍主要局限于专业讨论、企业内部治理领域,尚未将最终用户纳入AI治理的工作体系之中。因此,市场或者社会上对AI相关的治理问题还存在不少的误解,有些用户会将暂时的技术问题定义为长期性的治理问题,例如,将新部署的AI系统暂时性的识别效果不佳的问题理解为算法歧视问题。

有研究发现,只有40%的消费者相信企业在开发和部署新技术时是负责任且合乎伦理的,用户对AI治理缺乏深度认识。因此,在推动AI治理落地的过程中,应处理好技术与用户间的关系,技术提供方应使用用户语言讲解技术,AI治理机构应主动清治理挑战的根源、深化用户对AI治理问题的理解、赋予用户参与治理的能力。此外,企业还应加大对治理技术工具的投入,提升AI治理的可验证性。

同时,报告指出,商汤科技作为AI行业的领先企业,高度重视人工智能伦理与治理工作,始终坚持“平衡发展”的伦理观,倡导“可持续发展、以人为本、技术可控”的伦理原则,实行严格的产品伦理风险控制机制,建设全面的AI伦理治理体系,并积极探索数据治理、算法治理相关的检测工具和技术手段,致力于将伦理原则嵌入到产品设计、开发、部署的全生命周期。

报告内容表示,在未来,商汤将持续推动发展负责任且可评估的人工智能,为AI治理实践不断贡献完善、可行的落地方案。

具体内容如下

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“AIGP” 就可以获取《“平衡发展”的人工智能治理白皮书》专知下载链接