大咖 | 清华魏少军:今天多数AI芯片创业者会成为技术变革的先烈

“今天的一部分甚至大部分的AI芯片创业者会成为技术变革的先烈。”

在近日于上海召开的GTIC 2018全球AI芯片创新峰会上,清华大学微纳电子系主任、微电子所长魏少军教授如此评价今天的AI芯片创业大潮。

从AI芯片的发展历程讲到架构创新、发展桎梏,魏少军教授为现场听众讲述了芯片领域一些不太一样的观点。

演讲的最后,魏少军教授也给现场的企业家留下了两个问题:

“未来能否出现像通用GPU这样独立存在的通用AI处理器?如果存在的话它的架构是什么样,如果不存在,AI公司将何去何从呢?”

会后,大数据文摘也就这两个问题专访了英伟达AI技术中心亚太首席技术官 Simon See。

Simon介绍,目前AI芯片主要分两种:一类是数据中心(云)中用于训练的芯片;第二类是面向端的手机、安防等的芯片,主要是推理功能,不排除未来有训练的需求。毫无疑问GPU在这两个方向都是市场上应用最广泛的通用AI芯片。

“是否未来会出现像GPU一样通用的AI芯片现在还很难讲。但是,要想达到这个目的还需要很长时间,到时候可能很多芯片公司可能已经改变了设计,或者不存在了。”

魏少军教授现场演讲如下,速记来自主办方:

无芯片不AI

主持人介绍我们是做人工智能芯片,错了,我是做芯片设计,研究芯片设计的方面和理论。

2年前我们伟大征兆前一些年的成果尝试做了一些AI芯片,结果效果不错。后来,在国际上连续发表了一些有影响里的论文,有些结果被一些引用,突然发现了我自己成了AI芯片的专家,其实不是。

今天跟大家做一些沟通,主要希望提出一些可能跟我们在坐的大佬们不太一样的观点,供大家批判和产生共鸣。我的观点中有冒犯在坐各位,请大家务必原谅。

谈四个方面们内容,集成电路芯片是实现人工智能的载体,AI其实在50年代出现过,经过30年后又一次火起来了。从基本的概念到机器学习,再到深度学习。

现在看深度学习是当下研究的主要内容,其实深度学习只是人工智能比较窄的一面,为何我们如此热衷于研究一个很窄的方面呢,原因就是前年AlphaGo在人机围棋比赛中战胜了人类围棋高手李世石这一标志事件。

早在2011年的流行一个游戏其实比阿尔法狗更有代表性,当然可能大家不一定同意我的观点。

智能化到底是什么?具体来讲就是:人类在面对一件事情所做的处理和决策。处理加决策,它支撑了我们现在计算逻辑分析思维经验支持判断的各种主要内容,我们称之前者为能力,后者为智慧。

中文有时候比较宽泛一些,智能包含智慧和能力,我们在处理多数事情的时候需要的智慧而非能力,人工智能这个词有问题,不清楚,英文叫人工智慧,并未将智慧和能力两者结合在一起。

芯片是实现AI的当然载体,无论从英特尔的GPU等重要的提供商,还是CPU加是FPGA,或者其它的出现多个芯片的平台,CPU加IPG等,所有这些东西都离不开芯片,所以讲一句话,无芯片不AI,做AI一定要有芯片,芯片是AI不可或缺的基本内容。

架构创新

人工智能芯片如此重要,怎么实现它?AI的算法非常多,算法不断的延进,一个算法对应一个应用,我们没有一个算法覆盖所有的应用,你希望找到适应所有算法的架构,而不是一个应用做一个芯片。

我们当前的AI项目复杂程度不一样,无一例外都需要一个专用的神经网络实现。在这样的情况下,我们需要在芯片当中实现一个具备深度学习的引擎。

如今的深度学习所需要的计算量和参算量都非常庞大。以往的深度学习计算量较小,完成的工作量也有限,当时觉得有个10万个参数就很多了。

但是今天已经大有不同,比如说2017年当神经网络做到17层需要每秒196亿次的运算速度,新增加了1.38亿个参数。到了2015年的时候参数增加到1.5亿个。因此我们需要一个好的计算引擎,否则无法完成这些运算工作。

随着AI算法的不断发展,对AI芯片也提出了更高的计算诉求。AI芯片不仅要适应算法的引进,当然前提是算法适应所有的应用,还需要具有架构可变性,同时也要有高效的架构变换能力。

运算速度要多快?当架构中10个引擎同时工作,效率一定会提高,同时我们不能忽略能量效率。计算量的要求是多少?大概每瓦10个TOS,每秒完成10万亿次的运算或许能满足基本需求。

AI芯片进入家电和消费电子,还需要解决低功耗、低成本、小体积和开发简便等计算问题,方便搭载在各种设备上,且无需其他芯片的支持。开发设计芯片本身难度很大,再加上与CPU、软件和FPGA匹配,需要我们探索架构上的创新。

如何进行架构创新

应用和架构创新是发展应用创新的必由之路,我们说今天的应用涵盖所有的各个方面,例如人脸识别,语音识别、机器翻译。

我们看到屏幕上已经做到了记事的传译,还包括无人驾驶,智能陪伴、能源、农业或者生产,似乎AI涵盖了我们生活各个方面。但是我想问几个问题,我们哪些需要,哪些应用真的需要AI?

我们用AI的时候我们希望这些AI解决什么样的问题,什么是AI的杀手级的应用,什么样的AI是我们每天都需要的?我觉得这些问题到今天为止都没有答案,有些貌似是AI的东西好像是AI,但是实际上并不是AI。

我们说开发应用确实很难,做芯片的人一定会考虑架构是什么。架构创新很重要,从感知传输到中间的处理和后面的执行,都离不开基本架构。

大家对AI的通俗理解是,这是一个传感器,通过执行器和中间的传输网络实现输入输出的对应。基本的逻辑是这样,那么智慧处理的根本架构是什么?

计算无处不在,架构是计算的基本前提,GPU就是因为有很好的计算量而占据了优势。我们想要构建一个所谓能够具备智慧处理能力的芯片,一个智能的软件和硬件。智能软件包含这几方面的内容,形成知识能力,组织能力,思维推理能力。

软件定义芯片

在智慧芯片的构建过程中软件的地位一点不比芯片差,而相反我们看到芯片更多提供计算的平台,多任务并行的能力,极高的运算效率,和灵活高效的存储和实时动态的能力。

我们因此经常说,实现智能的核心其实是软件不是芯片,芯片不过是支撑智能的基础而已。因此我们要改变一些思路,就是我们做芯片的人,特别做AI芯片的人把软件放在足够高的来看。

因此我们说希望在这种情况希望我们硬件可以跟着软件不断变化,所谓软件定义芯片的概念,芯片不能被软件定义,那你是做不好。

这个概念我们在10年前就提出来了,但是因为大众对其了解甚少。去年有一个很有意思的国家电子设计能力的课题,提到了软件定义硬件的概念,即,让硬件结果可以软件变化的时候,可以从300变化到1000个纳米,硬件跟软件变化,硬件的功能和架构,随软件变化而变化。这个工作10年前已经完成,走在美国同行的前面。

大家说FPGA早可以做了,其实FPGA也不行。第一就是FPGA颗粒度是细力度,所以配置一样信息量内容需要很长的时间,十几毫秒甚至要停要更长的时间,无法实现静态配置。在线更新也需要很长时间,信息需要装载进整个电路,面积效率很低,效率只有5%,千万面积的FPGA实现几十万的信息,能量效率很低,功耗很大。

FPGA需要非常先进的工艺,工艺还要调整,电路和技术的调整是必须的,要想使用FPGA不懂电路设计寸步难行。用FPGA做一个简单的验证系统的成本都非常高,实用系统恐怕更加困难。所以我们说FPGA无法承担软件芯片。

想要构建软件芯片非常困难,什么样系统可以完成STC。从架构上去考虑,右边给出一个完全一致的硬件结构,没有考虑硬件本身的开销,这样的计算效率一定是最高的,但是软件的设计可以无穷大,而硬件设计总有边界。

把软件分成若干块,一块一块搬过去,运行完了以后,执行第二个模块,任务依赖性第三个模块搬过去,回来计算第四个、第六完成这样的多级发展,要求我们的硬件结构和功能必须是动态的、随时可以改变的,这就是软件定义芯片的基本概念,但如何快速实现它这是工作的难点。

我们过去10年当中的努力就是解决这个问题,这样的计算架构是非常经典的架构,我们可以看到这两者一个是所谓的控制单元划分的内容逐步送进去执行,根据要求配置计算单位并且完成执行,问题是要出现完全可重构的数据通道和可完成变成的控制单位,这样做到就是软件可变化的。

软件芯片与传统芯片的结构是有差别,经典的计算模式做了一个比较,它是弓形的,可传播的、计算是函性的,它是应用使用计算。

经典模式中一个处理任务的软件,有多个等效的处理软件。经典架构当中,软件硬件不变。而在我们现在的架构中,硬件和软件都在做动态的选择性的改变,经典架构用高度复用的方式,降低它的成本。

而在我们这边是荣誉应用,是不是改变的计算模式,很遗憾告诉大家,我们还是在架构当中,有些人我说改变了模式,我做出了丰富的计算架构,其实我说,你没有弄明白。

我们利用软件定义芯片可重构硬件的结构实现AI芯片的时候,可以利用软件独特优势来把硬件按照AI的算法来不停的变换,以达到最佳的计算效率。我们从AI的应用定义采用深度神经网络,再来决定硬件的功能,这样的结构我们认为是一个最佳的方式,我们只是在无意当中尝试一下,构建一个芯片叫“思考者”。

结束语

我们说应用领域的确立是AI领域的确立前提,而AI的杀手级应用还没有出现,因此我们说AI的发展有很长的路要走,主要的是,能否出现像通用GPU独立存在的通用AI处理器?

如果存在的话它的架构是什么样,如果不存在,我们今天的已满足特定应用的芯片恐怕只能做IT核了,我们AI公司何去何从呢。

这个问题留给企业家们思考,可能大家不同意我的观点,两到三年内一定会碰到一个低潮,今天的一部分甚至大部分的创业者成为技术变革的先烈,但是我钦佩大家,也是最令人动容的伟大事件。

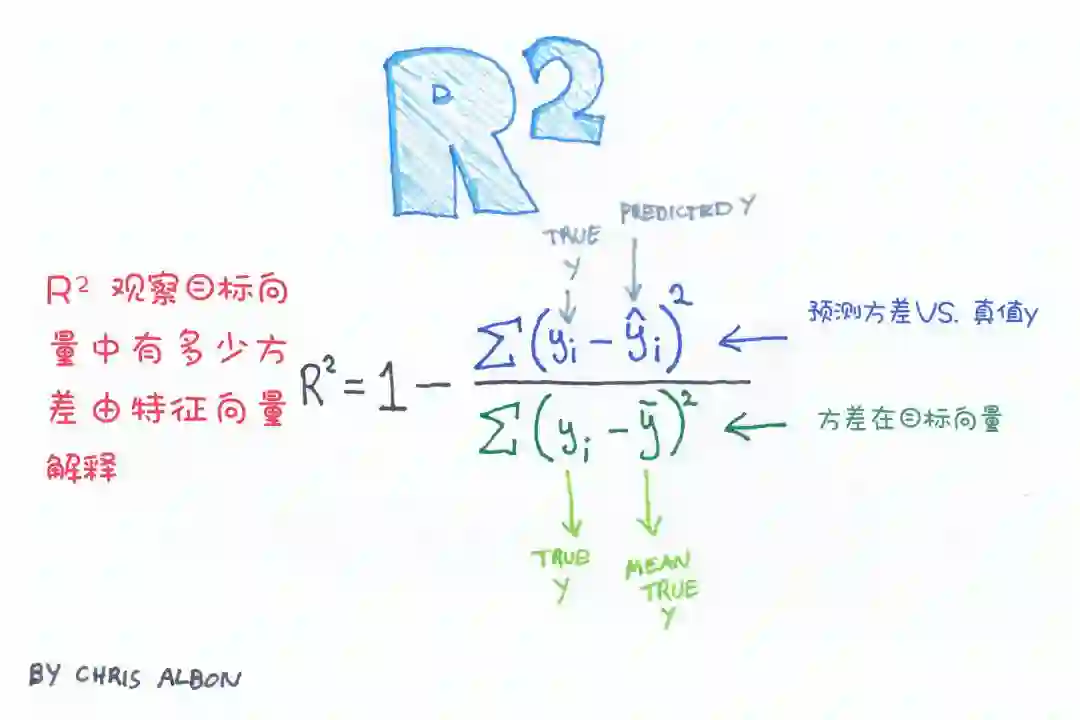

【今日机器学习概念】

Have a Great Definition