论文导读 | 阿兰·图灵《计算机器与智能》

更多干货内容请关注微信公众号“AI 前线”,ID:ai-front

模仿游戏

“我建议考虑这样一个问题,‘机器能思考吗?’要回答这个问题,我们需要先定义‘机器’和‘思考’这两个术语的含义。”

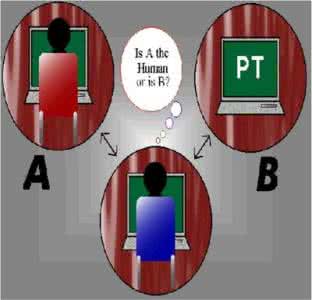

为了避免讨论逐渐退化为通过民意调查而解决的问题,Turing 很快将其提炼成一个可以通过测试来决定的命题。模仿游戏最开始是一个男人(玩家 A)和一个女人(玩家 B)在一间房子中,还有一个询问员在另一间房子。询问员通过向两个玩家提问(以打印通讯的方式),要确定两个人中哪一个是女人。男人要努力使询问员误认为他是女性。

“现在我们提出这样的问题,‘如果用一个机器来担任 A 的角色,将会发生什么情况?’”

询问员能区分出人和机器吗?这个问题取代了原先的“机器能够思考吗”这个问题。

“机器会不会完成了一些应该是思考的行为,但其实却和人类的思考相差甚远?这个反对意见很棘手,但是,至少我们可以说,机器可以通过设计玩好这个模仿游戏,我们不需要对这个问题过分担心。”

机器的定义随后被缩小为一台数字计算机。“我们不是要问是否所有的数字计算机都能在游戏中表现得很好,也不是目前的计算机能不能玩好,而是有没有可能会有计算机能做得很好。”在介绍了通用机器的概念后,论文将我们的注意力集中在一台特殊的数字计算机 C 上。我们可以让它有足够大的存储空间,足够快的计算速度,而且对它进行适当的编程。当 C 扮演模仿游戏中 A 的角色,人扮演 B 的角色,C 能不能在这个游戏中表现良好?

“我想要是我先就这个问题阐述一下自己的看法,读者就会觉得问题更简单一些。首先让我们来看看这个问题更确切的形式。我认为在 50 年内,计算机的信息存储量可以达到约 10^9(125MB),足以让它们在模仿游戏中很顺利,一般的询问者在 5 分钟提问后,询问者能准确鉴别的概率不会高于 70%。原来那个问题,‘机器能思考吗?’我认为没有什么意义,不值得讨论。”

在原始的论文中,Turing 开始着手讨论一系列想象中的异议。最后我会简单地回顾一下,因为我想首先关注图灵对于学习机器的愿景。

“考虑一个低于临界体积的原子堆:输入的想法就像从外界往原子堆轰击的中子。每个中子都会引起一些扰动但是最终将逐渐消失。但是,如果原子堆的大小变得足够大的时候,中子产生的反应很可能会持续地增加,直到原子堆解体。思维中是否存在这样的现象呢?机器中呢?”

如果你向许多思想提供一个想法,只会产生少于一个的想法。但是有一小部分的思想处于超临界,进入其中的想法会产生第二个、第三个、以及更多更深的想法,最终成为一个完整的“理论”。一个机器能不能成为超临界的?Turing 认为存储或速度不是问题,程序的编写才是关键。

考虑一个成人思维:它是怎样达到当前状态的?

“我们可以发现以下三点:(a)思维的初始状态,也就是出生时的状态。(b)它所接受的教育。(c)它所经历的,不能被称为教育的事情。除了尝试产生编程来模拟成人思维,为什么不试试去设计一个儿童的思维!这样,问题就分为两个部分。设计儿童程序和教育过程。”

我们在初次尝试时并不能找到一个很好的模拟儿童的机器,但是 Turing 建议我们通过实验和进化的过程来找到它。将儿童模拟机的结构看作遗传物质,儿童模拟机的变化看作变异,然后自然选择的角色将由实验者的决定来扮演。

“然而,人们可能希望,这一进程将比进化更快。适者生存是一个较慢的度量优势的过程。而结合智能的实验将会加快这一进程。”对于教育过程的核心,Turing 提出了强化学习的一种形式:“机器构建的原则应该是,如果某个行为后立即接收惩罚信号,机器要能做到不再重复这样的行动,而奖励信号的出现能增加产生这个奖励的行为的可能性。”以及,“这些定义不预先假定机器的任何感觉。”

但是自主的强化学习是不够的。如果在学生发声时老师只能给出奖励或惩罚信息,想想要多长时间一个儿童才能学会说“Casabianca”。我们需要一些其他的交流渠道,例如一种符号语言。

“对于什么样的复杂度更适合儿童机器人们可能有不同的看法。有人会主张尽可能的简单以保持通用性。另一种方式是嵌入一个完整的逻辑接口系统。”

Turing 认为,最重要的是规定逻辑系统的规则以什么样的顺序执行。不同的选择存在着优秀的推理者和无用的推理者之间的区别(而不是合理的推理者与错误的推理者之间的区别)。

我们是否有必要搞明白机器的内部工作原理?

“学习机器的一个重要特点是它的老师通常不关心其内部发生了什么变化,尽管老师还是能在一定程度上预测他的学生的行为。当儿童机器是设计好的(或者编程好的),其后期教育更应注重这一点。”在一个学习机其中加入随机元素也会有帮助。“一个随机元素在我们寻找问题答案时是相当有用的。”

Turing 考虑(并驳斥)了 9 种对于机器有一天会在模仿游戏中成功这一想法的可能出现的反对意见。我们没有足够的时间和篇幅来详细介绍这些想法,不过如果你有意向的话,它们充满了个性,值得阅读。简而言之,它们是:

来自神学的异议——思考是人的不朽灵魂的一种功能,而只有上帝才能创造灵魂。(“不管用神学的证据来证明什么,我都不以为然。过去已经证明这样的论据是漏洞百出的。”——伽利略)。

“鸵鸟式”反对——后果太可怕了,我们还是希望它不会发生吧。(“我认为这个观点不值得反驳”)。

来自数学的异议——哥德尔的理论,以及丘奇、克里恩、罗瑟等人的结论,并且 Turing 也表示离散状态的机器的能力有一定限制。(“但是,没有任何证据表明,人类的智能没有这种局限性。但我认为这个论点不能这么轻易了解。”)

来自意识的论点——“是的,但是机器真的可以有感觉吗?”(“这个论点看上去否定了我们测试的有效性。”)

来自种种能力限制的论点——你永远也不能使一台机器有 X 类行为(例如享受草莓和奶油)。(大部分都是基于人类一生中所看到的机器得出的结论)。

洛芙莱斯夫人的异议——机器可以做我们知道该如何指挥它去做的任何事(暗指机器“只能”做这些)。这种异议还有另一种说法,就是机器永远也不能为我们创造惊喜。(“机器经常令我吃惊”)。

来自神经系统连续性的异议——神经系统不是离散状态的机器(“但是提问者不能从这个差异中得到任何利于判断的信息。”)

来自行为变通性的异议——不可能总结出一套适用所有情况的清晰的规则。(“‘因为不存在这样的规则,所以人不能成为机器’,这种中项不周延的错误太刺眼了。”)

来自超感官知觉的异议——(“如果允许心灵感应介入模拟游戏,那只要将玩家置入一间‘防心灵感应’屋就能满足所有要求。”)

我们可能希望机器能和人在所有的纯智力领域竞争。但是应该从哪里开始呢?这也是一个困难的决定。许多人认为一个非常抽象的活动,例如下国际象棋可能是最好的选择。也有人认为要给机器用钱能买到的最好的感知器,然后教会它理解和说英语... 我并不知道正确的答案,但我认为这些方法都值得一试。

“我们的目光所及,只是不远的前方,但是可以看到的是,还有许多工作要做。”

查看英文原文:

https://blog.acolyer.org/2017/10/20/computing-machinery-and-intelligence/