CVPR 2022 线下会议将于 2022 年 6 月 21 日-24 日在美国新奥尔良举行。而今年投稿量创新高超过了一万,其中 2067 篇论文被接收。各位学者带来了一系列教程。来自卡内基梅隆大学研究学者讲述了《多模态机器学习》教程,200+页ppt值得关注。

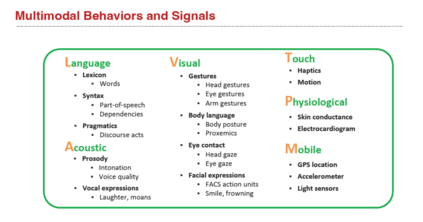

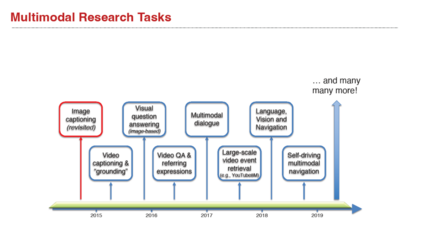

多模态机器学习是一个充满活力的多学科研究领域,通过设计计算机agent来实现人工智能的一些原始目标,这些计算机agent能够通过集成和建模多种通信模态(包括语言、声学和视觉信息)来展示智能能力,如理解、推理和规划。随着视听语音识别的初步研究,以及最近的语言和视觉项目,如图像和视频字幕、视觉问题回答和语言引导强化学习,该研究领域给多模态研究人员带来了一些独特的挑战,因为数据的异质性和通常发现的模态之间的偶然性。

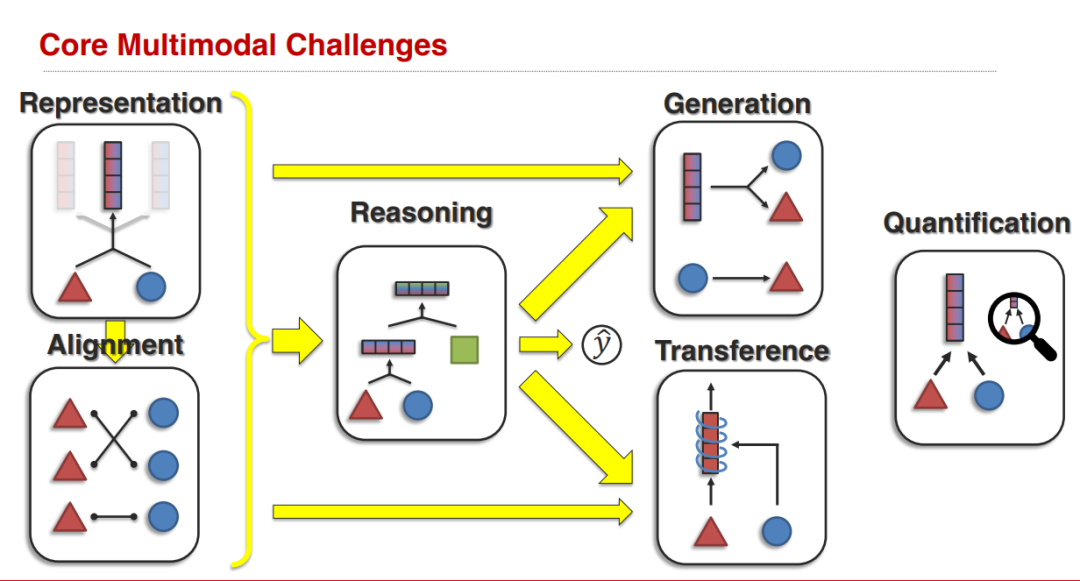

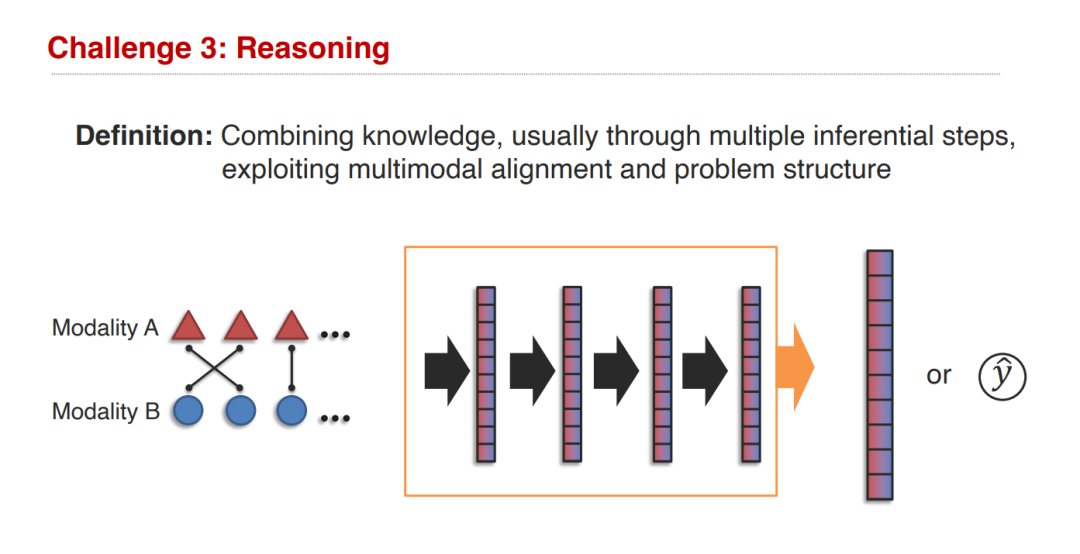

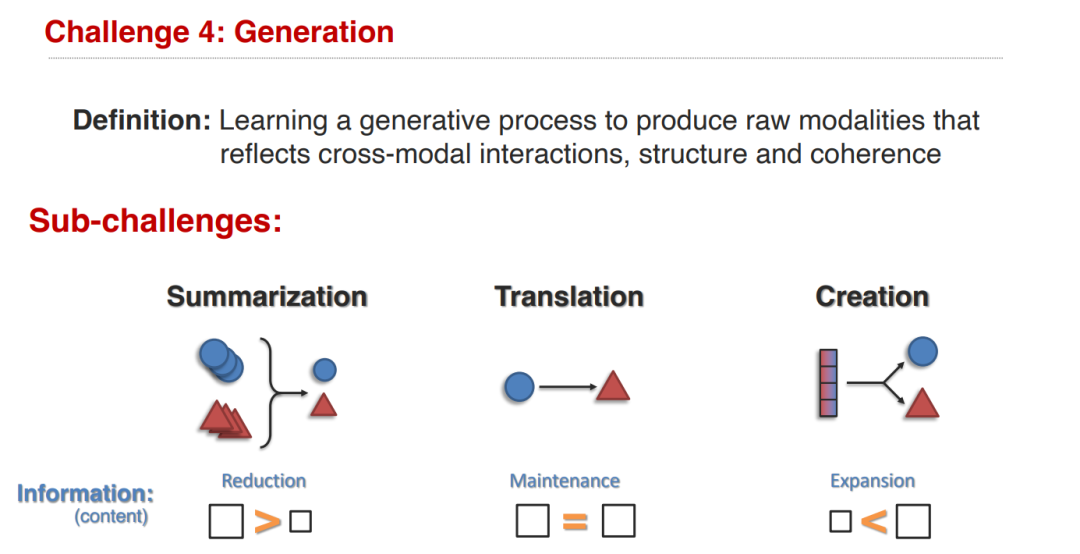

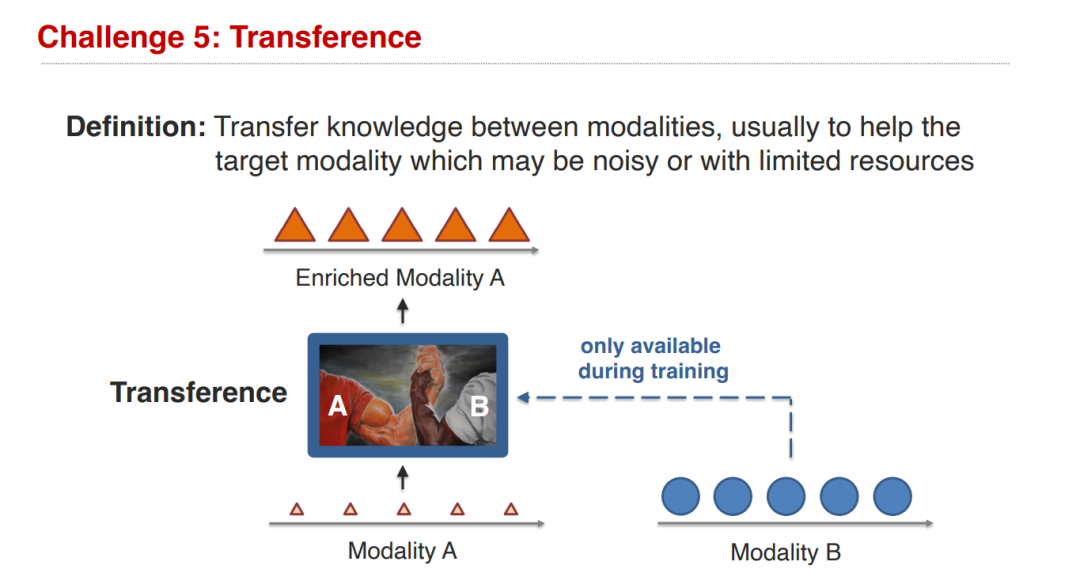

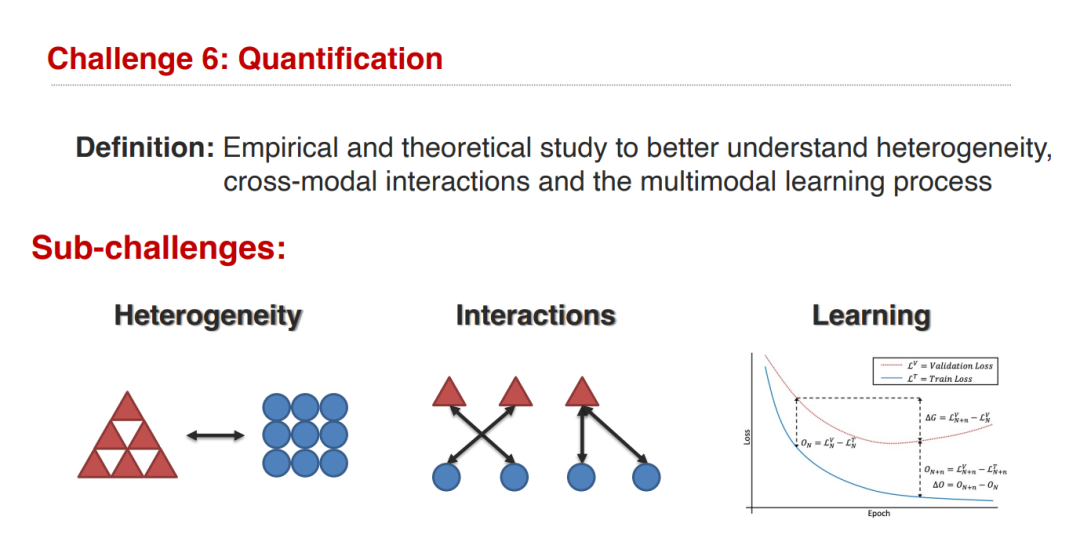

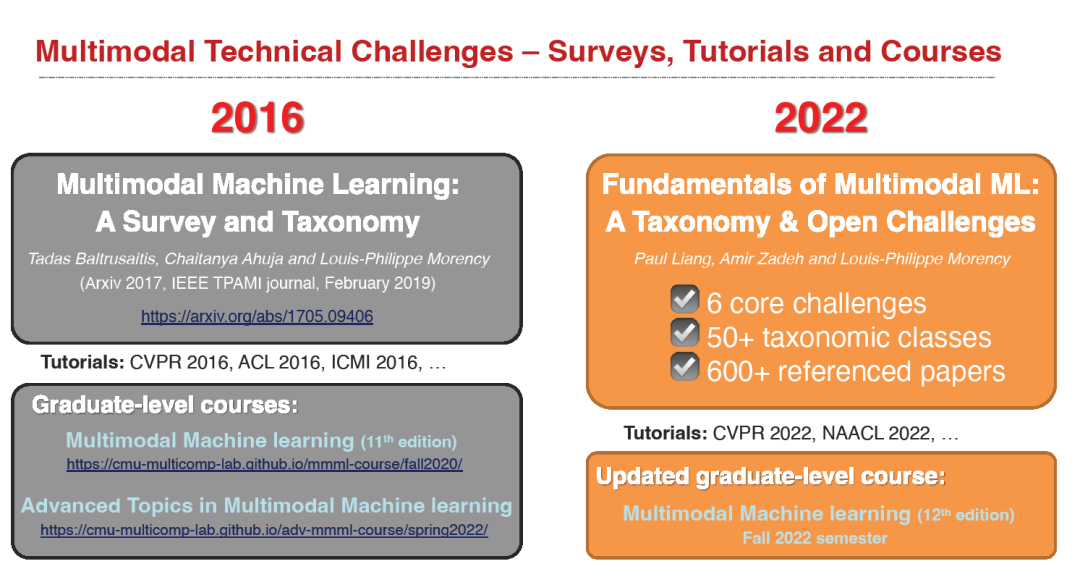

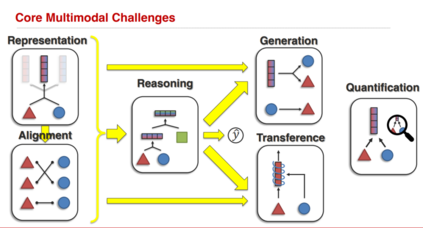

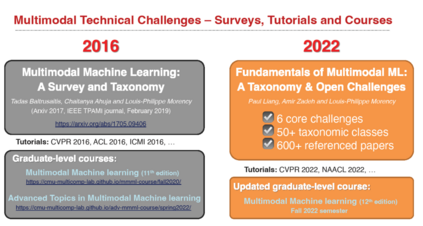

本教程建立在卡内基梅隆大学教授的多模态机器学习年度课程的基础上,是CVPR、ACL和ICMI会议上多模态学习以前教程的一个完全修订版本。本教程基于多模态机器学习中存在的核心技术挑战的修订分类,围绕这六个核心挑战: 表示、对齐、推理、迁移、生成和量化。最近的技术成果将通过这种多模态核心挑战的分类法来展示,使研究人员能够理解方法和新模型之间的相似性和差异性。本教程还旨在对多模态机器学习的未来研究方向提供一个视角。

https://cmu-multicomp-lab.github.io/mmml-tutorial/cvpr2022/

讲者:

目录内容:

1. 介绍

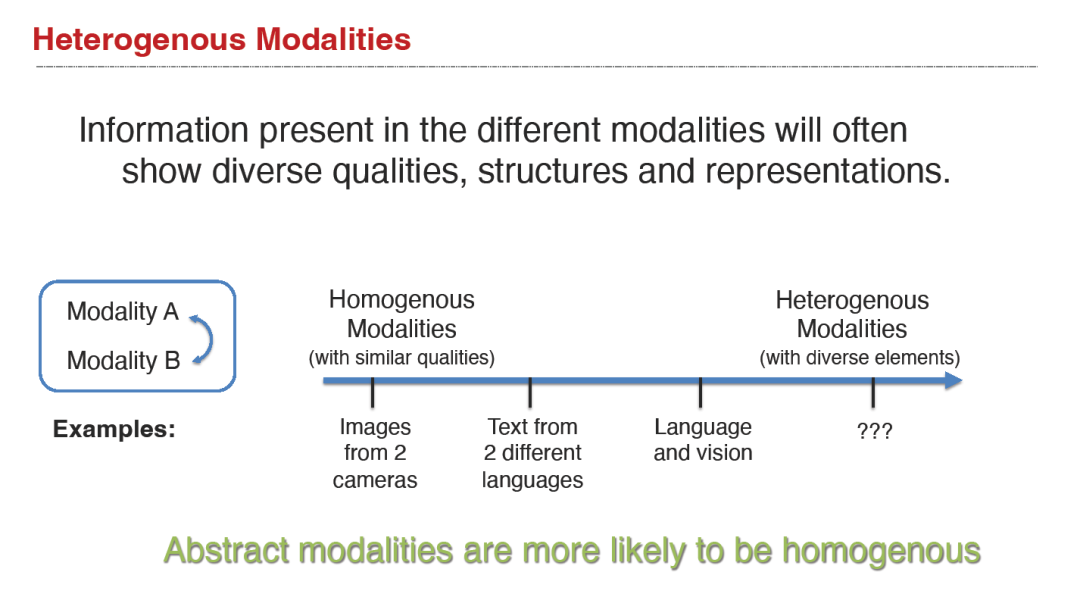

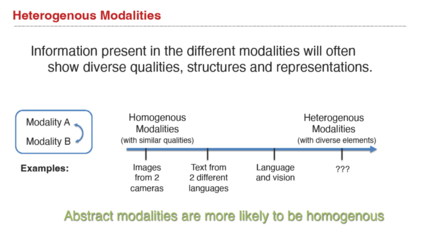

- 什么是多模态?定义,异质性的维度和跨模态的相互作用。

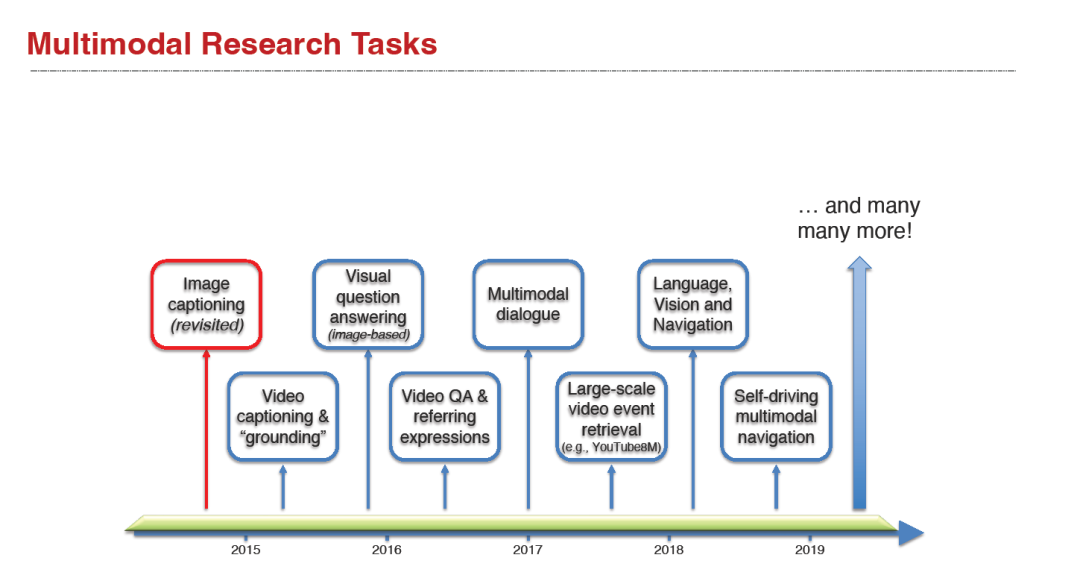

- 历史观与多模态研究任务。

- 核心技术挑战: 表示、对齐、转移、推理、生成和量化。

- 单模态语言、视觉和听觉表征。

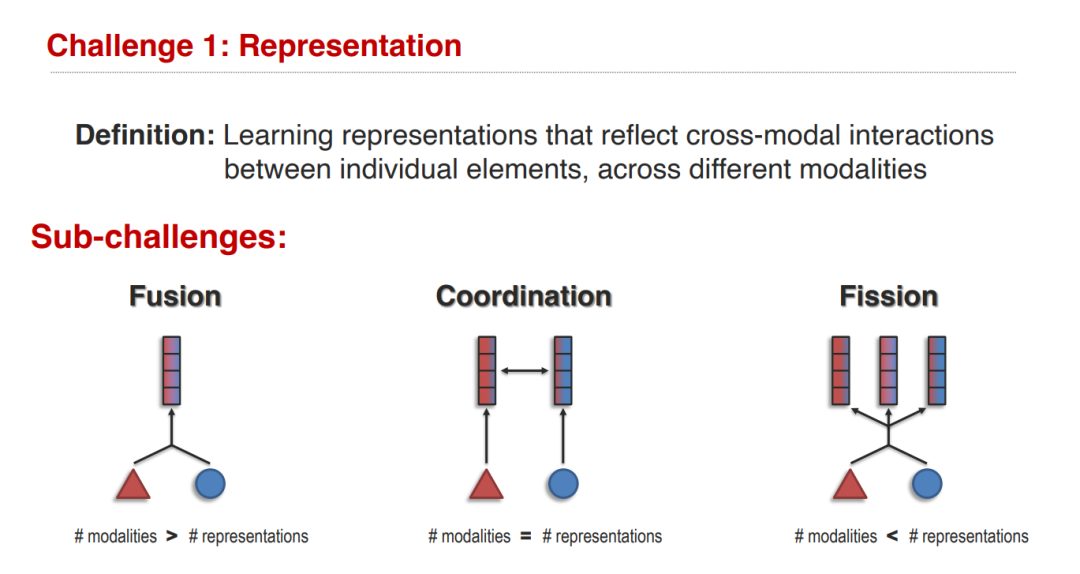

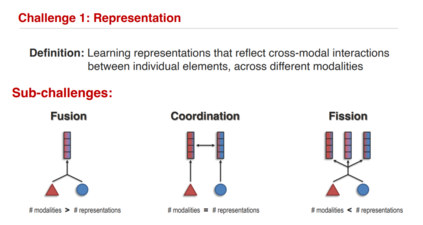

2. 表示

- 表示融合: 融合策略,多模态自编码器。

- 表示协调: 对比学习,向量空间模型,典型相关分析。

- 表象裂变: 因式分解、成分分析、解缠。

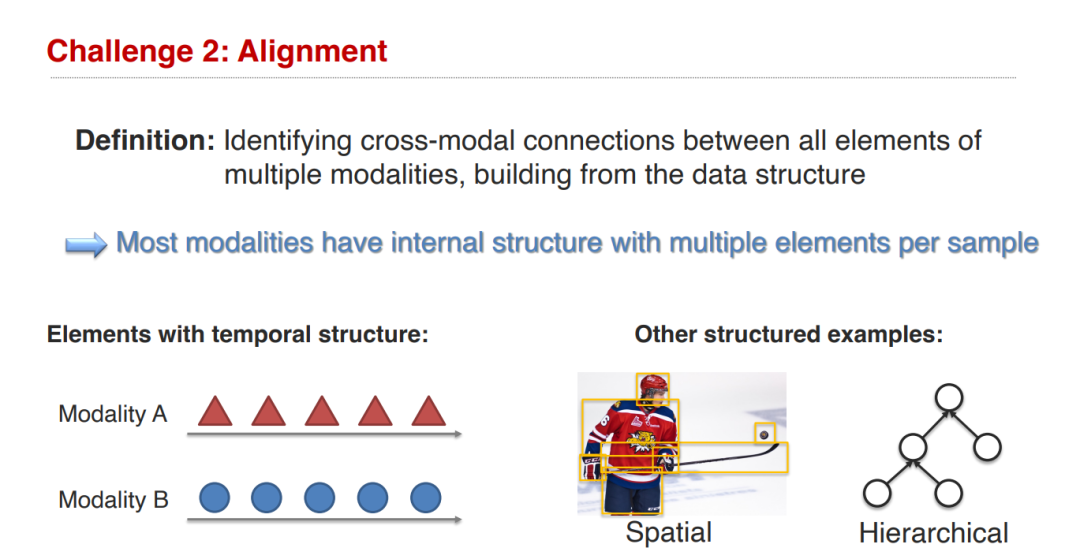

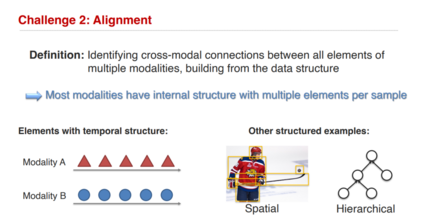

3. 对齐

- 粒度: 分割、聚类、单元定义。

- 对应: 潜在对齐方法,注意力模型,多模态transformers。

- 依存类型: 图神经网络,多实例学习。

4. 推理

- 结构: 层次结构、图形结构、时序结构和交互结构、结构发现。

- 概念: 密集和神经象征。

- 构成: 因果关系和逻辑关系。

- 知识: 外部知识基础,常识推理。

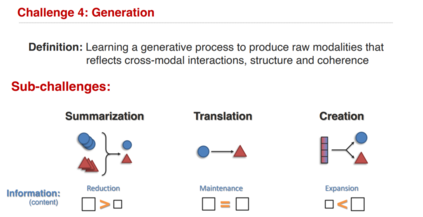

5. 生成

- 总结、翻译、创作。

- 模型评估和伦理问题。

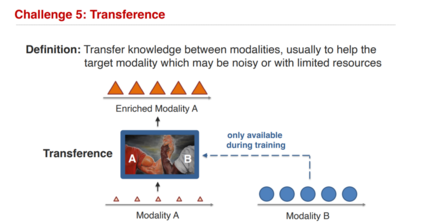

6. 迁移

- 模态转移: 损失,幻觉,跨模态转移。

- 基础模型:预训练模型和适应。

- 模型归纳:协同训练,跨模式学习。

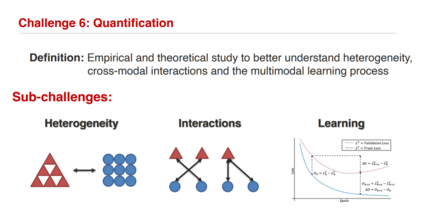

7. 量化

输出质量:泛化、鲁棒性、复杂性。 内部机制:可解释性,理解跨模型交互。 模态权衡: 数据集偏差、社会偏差、理论收益、优化挑战。

成为VIP会员查看完整内容

相关内容

Arxiv

11+阅读 · 2021年12月16日

Arxiv

19+阅读 · 2021年10月28日