日前,中科院自动化所提出了全球首个图文音(视觉-文本-语音)三模态预训练模型(OPT-Omni-Perception pre-Trainer),同时具备跨模态理解与跨模态生成能力,取得了预训练模型突破性进展。

自GPT/Bert模型提出后,预训练模型迎来了爆发式发展。多模态预训练模型被广泛认为是从限定领域的弱人工智能迈向通用人工智能的路径探索,其具有在无监督情况下自动学习不同任务、并快速迁移到不同领域数据的强大能力。

近年来,互联网音视频数据呈高速增长,占比超过80% [1],纯文本的预训练模型只涵盖了互联网数据中的较少部分,更丰富的语音、图像、视频等数据并未被充分利用与学习,且人类的信息获取、环境感知、知识学习与表达,都是通过多模态信息方式来执行的。OpenAI 联合创始人、首席科学家 Ilya Sutskever 在推特上发文表示,“人工智能的长期目标是构建多模态神经网络,即AI能够学习不同模态之间的概念,从而更好地理解世界”。为实现更加通用的人工智能模型,预训练模型必然由单模态往多模态方向发展,将文本、语音、图像、视频等多模态内容联合起来进行学习。自动化所瞄准这一方向,成功构建视觉-文本-语音三模态预训练模型。

目前,已有的多模态预训练模型通常仅考虑两个模态(如图像和文本,或者视频和文本),忽视了周围环境中普遍存在的语音信息,并且模型极少兼具理解与生成能力,难以在生成任务与理解类任务中同时取得良好表现。

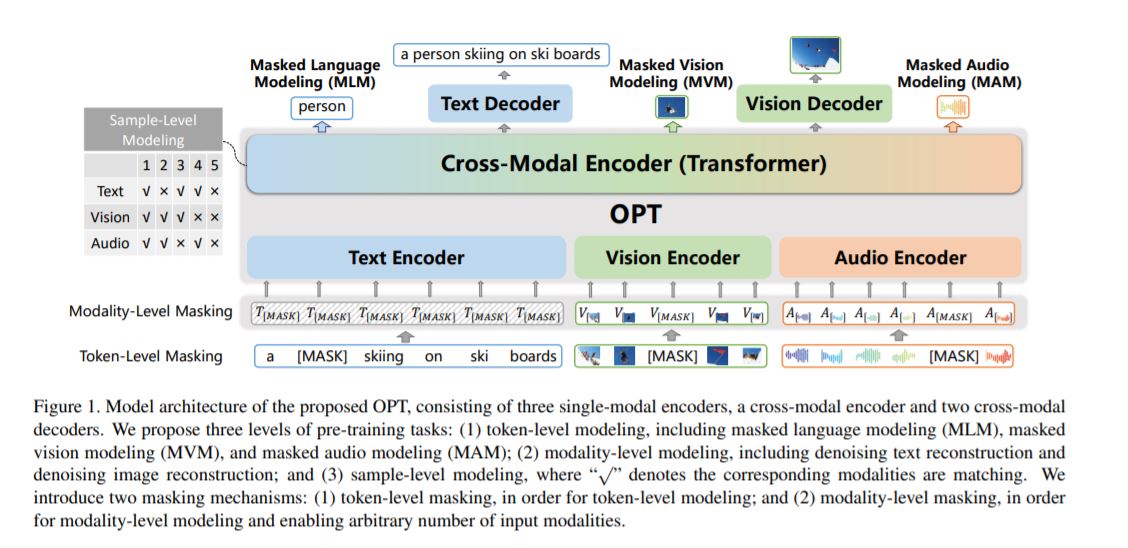

针对这些问题,自动化所此次提出的视觉-文本-语音三模态预训练模型采用分别基于词条级别(Token-level)、模态级别(Modality-level)以及样本级别(Sample-level)的多层次、多任务子监督学习框架,更关注图-文-音三模态数据之间的关联特性以及跨模态转换问题,对更广泛、更多样的下游任务提供模型基础支撑。

该模型不仅可实现跨模态理解(比如图像识别、语音识别等任务),也能完成跨模态生成(比如从文本生成图像、从图像生成文本、语音生成图像等任务)。灵活的自监督学习框架可同时支持三种或任两种模态弱关联数据进行预训练,有效降低了多模态数据收集与清洗成本。