4年4篇顶刊顶会论文!清华开源肖像线条画生成代码,惟妙惟肖模仿人类作画

![]()

新智元报道

新智元报道

编辑:好困

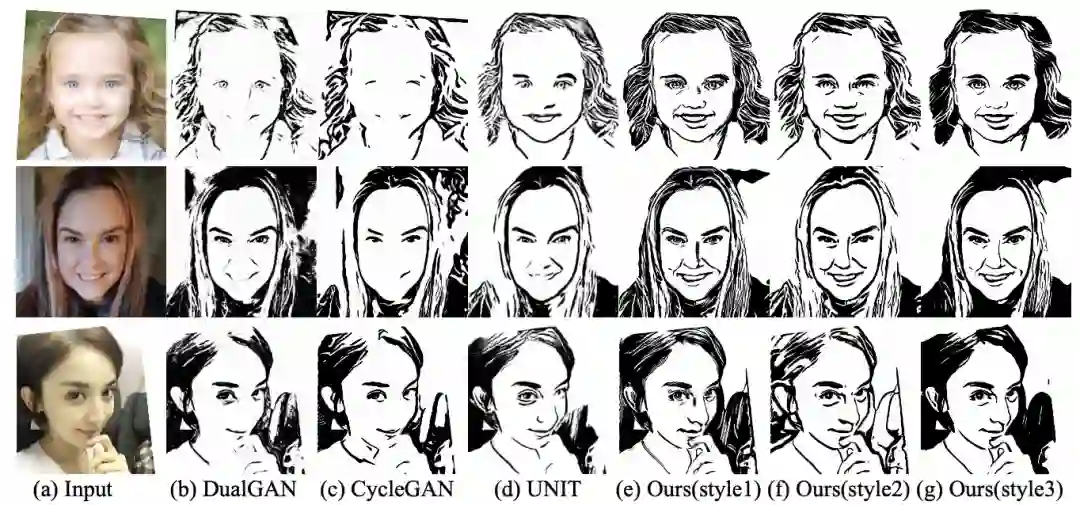

【新智元导读】近日,清华大学提出的非成对人脸照片肖像线条画生成方法,被IEEE Transactions on Pattern Analysis and Machine Intelligence(PAMI)录取为regular paper。代码已经全部在Github上开源。

易冉现在是上海交通大学计算机系助理教授。她于2016年获得清华大学工学学士学位,2021年获得清华大学工学博士学位。她的研究方向包括计算机图形学、计算机视觉和计算几何。近五年共发表录用20余篇论文于IEEE PAMI、ACM TOG、TVCG、CVPR、ICCV、AAAI等国际期刊和会议。

2021年12月,易冉获得中国图象图形学学会2021年度石青云女科学家奖。

她的博士学位论文《艺术肖像画的多风格与跨模态深度生成模型研究》,受到答辩委员会主席张钹院士、委员查红彬教授、陈熙霖教授、史元春教授和胡事民教授的一致好评,入选2021年清华大学优秀博士学位论文。

除此以外,易冉还获得过中国计算机学会计算机视觉专委会学术新锐奖、第十六届图像图形技术与应用学术会议(IGTA2021)论文竞赛一等奖、北京市图象图形学学会优秀博士论文、微软学者提名奖等学术奖项。

并且她还担任中国图象图形学学会智能图形专委会、动画与数字娱乐专委会委员,AAAI程序委员会委员,IJCV、TIP、TMM、CVPR、ICCV、NeurIPS、ICLR、VR等重要期刊会议审稿人。

课题组部分成员合影

连续4年发表顶刊顶会论文

2022

论文链接:https://doi.org/10.1109/TPAMI.2022.3147570

代码链接:https://github.com/yiranran/QMUPD

2021

论文链接:https://doi.org/10.1109/TPAMI.2020.2987931

代码链接:https://github.com/yiranran/APDrawingGAN2

2020

2019

论文链接:https://doi.org/10.1109/CVPR.2019.01100

代码链接:https://github.com/yiranran/APDrawingGAN

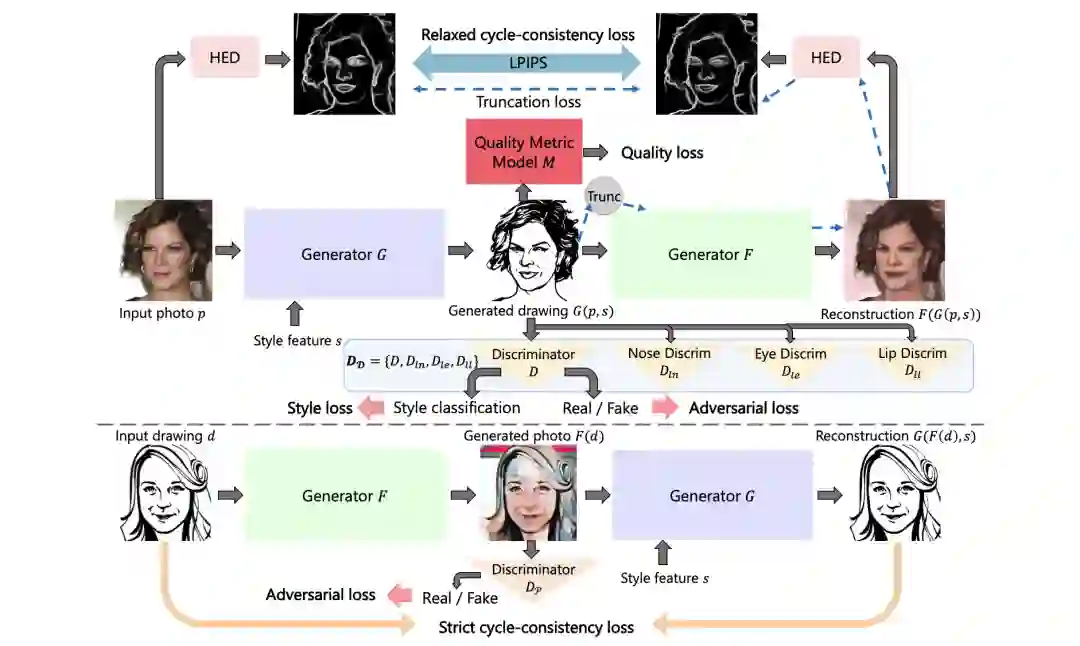

实现方法

参考资料:

https://news.sjtu.edu.cn/zhxw/20211222/165563.html

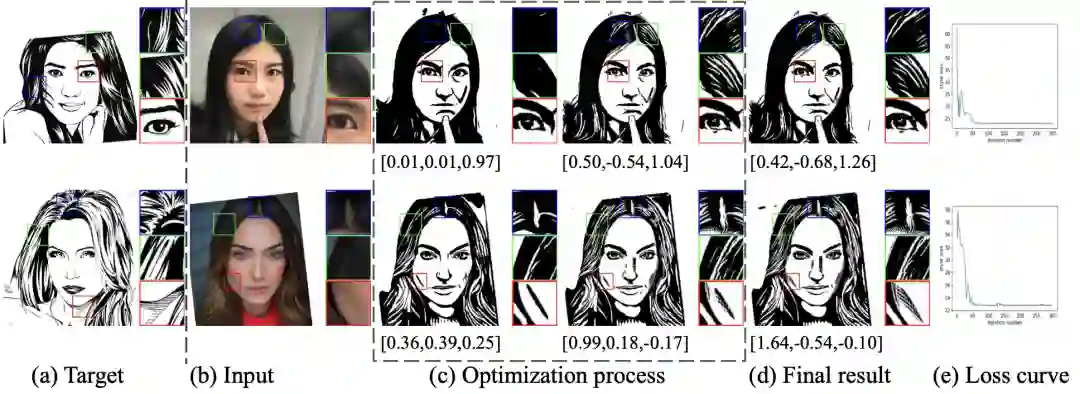

[1]Quality Metric Guided Portrait Line Drawing Generation from Unpaired Training Data

https://doi.org/10.1109/TPAMI.2022.3147570

https://github.com/yiranran/QMUPD

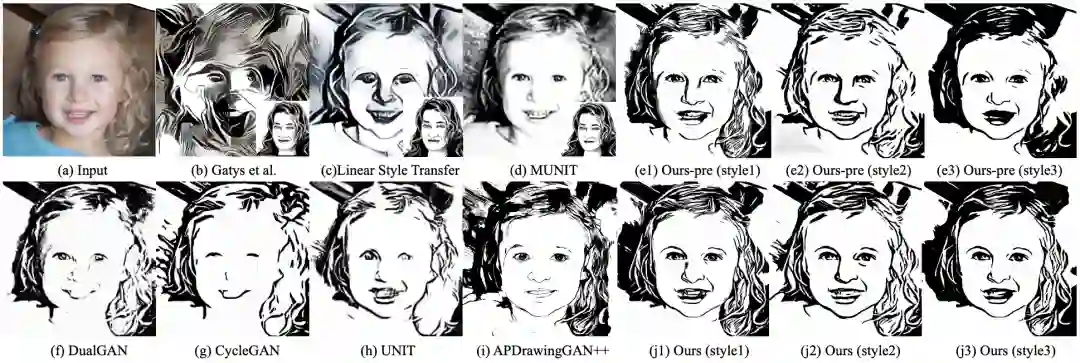

[2]Line Drawings for Face Portraits from Photos using Global and Local Structure based GANs

https://doi.org/10.1109/TPAMI.2020.2987931

https://github.com/yiranran/APDrawingGAN2

[3]Unpaired Portrait Drawing Generation via Asymmetric Cycle Mapping」

https://doi.org/10.1109/CVPR.2019.01100

https://github.com/yiranran/APDrawingGAN