【新智元导读】LSTM之父、暴脾气大爷Jürgen Schmidhuber又开炮了?这回怼的是LeCun,说最近的新论文是炒了自己20多年前的冷饭,只不过换了种说法而已。

图灵奖得主Yann Lecun,作为AI界的三巨头之一,他发表的论文自然是被人当成「圣经」来学习的。

然而,最近突然有一个人跳出来炮轰LeCun「炒冷饭」:「无非就是把我的核心观点换种说法罢了」。

莫非……

![]()

没错,此人正是「LSTM之父」Jürgen Schmidhuber。

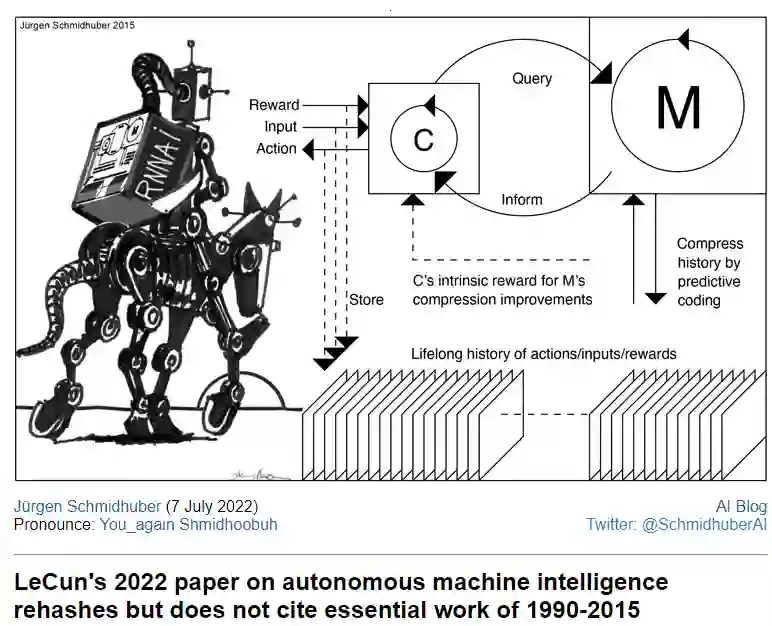

Schmidhuber表示,LeCun的这篇论文并未提及1990-2015年期间的重要成果,文中所提及的「主要原创成果」,包括「学习子目标、可预测的抽象表征、多个时间尺度」等概念,他们也已经发表过了。

原推中用的rehash这个词,也就是把原先的idea用另一种方式表达而不做创新,妥妥的「洗稿」了。

当然,这只能算是Schmidhuber的一面之词罢了。

「你过去是AI界的一位重量级人物,但现在你出名的地方在声称每个人的学术成果都是剽窃了你的观点」。

「神经网络、transformers、LSTMS是你发明的,那厕纸和面包片是不是也是你们家发明的」。

2022年6月14日,被Schmidhuber称作Science Tabloid的一家「科学小报」(说的就是你MIT科技评论)发表了一篇LeCun的报告,其中阐述了他对AGI的新构想。

6月27日,Yann LeCun发表了自己积蓄几年的论文「A Path Towards Autonomous Machine Intelligence」,并称其为「指明AI未来发展方向之作」。

这篇论文系统讲述了关于「机器如何能像动物和人类一样学习」的问题,长达60多页,感兴趣的朋友可以去看看。

LeCun表示,此文不仅是自己关于未来5-10年内关于AI发展大方向的思考,也是自己未来几年打算研究的内容,并希望能够启发AI界的更多人来一起研究。

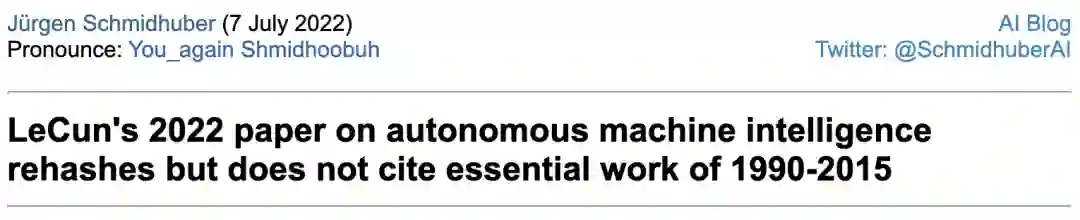

大概是看LeCun这篇论文的影响越来越大,Schmidhuber终于决定在7月7日,放出自己写的长文,怒斥Lecun抄袭他的idea。

Schmidhuber称,在文章还没公开发表之前,那家「科学小报」发来一份报告的草稿(还在保密期),并希望他能对此发表一些评论。

于是,Schmidhuber便洋洋洒洒地写了一篇「控告」,表示LeCun的文章基本上就是自己以前工作的翻版,而且还没有引用。

Schmidhuber在这篇长文中表示,希望读者能研究原始论文,自己判断这些评论的科学内容,并且还希望自己的工作得到承认和认可。

LeCun论文开头部分说,本文描述的许多观点(几乎都是)由许多作者在不同的背景下以不同的形式提出,Schmidhuber则反驳称不幸的是,这篇论文的大部分内容就和我们1990年以来的论文「似曾相识」,且没有任何引用的标识。

证据1:

(1)机器如何能学会代表世界,学会预测,并学会主要通过观察来采取行动

(2)机器如何以与基于梯度的学习兼容的方式进行推理和计划

(3)机器如何以分层的方式,在多个抽象层次和多个时间尺度上学习表征感知(3a)和行动计划(3b)

这些问题在1990年、1991年、1997年和2015年发表的一系列论文中得到了详细解决。

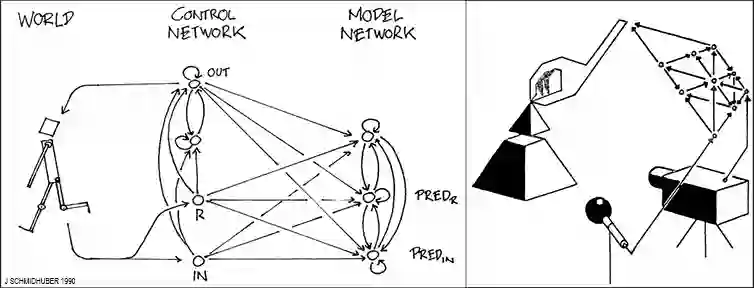

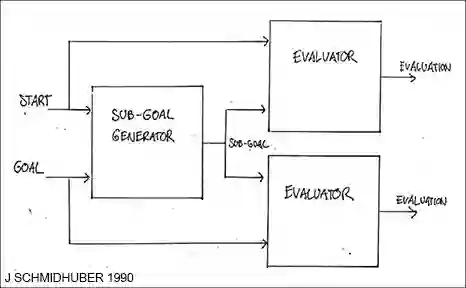

1990年,第一篇关于基于梯度的人工神经网络(NN)用于长期规划和强化学习(RL)以及通过人工好奇心进行探索的工作发表。

它描述了两个递归神经网络(RNN,最强大的NNN)的组合,称为控制器和世界模型。

其中,世界模型学习预测控制器行动的后果,控制器可以利用世界模型提前规划几个时间步骤,选择使预测奖励最大化的行动序列。

关于基于神经网络的分层感知(3a)的答案,这个问题至少部分由我 1991年发表的「第一台深度学习机器—神经序列分块器」解决。

它在递归神经网络 (RNN) 的深层层次结构中使用无监督学习和预测编码,以在多个抽象级别和多个时间尺度(正是 LeCun 所写的内容)上找到「长数据序列的内部表征」。

关于基于神经网络的分层行动计划(3b)的答案,已在 1990 年通过我的分层强化学习 (HRL)这篇论文至少部分解决了这个问题。

证据2:

由于成本模块的两个子模块都是可微的,所以能量梯度可以通过其他模块反向传播,特别是世界模块、表演模块和感知模块。

这正是我在 1990 年发表的内容,引用了 1980 年发表的「具有前馈神经网络的系统识别」论文。

2000年,我的前博士后 Marcus Hutter 甚至发表了用于学习世界模型和控制器的理论上最优、通用、不可微的方法。(另请参考称为哥德尔机的数学上最优的自我参照 AGI)

证据3:

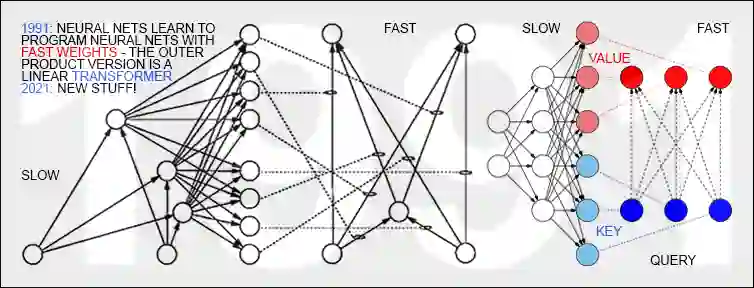

然而,他没有提到我在 1991 年发表了第一个这样的「键值记忆网络」,当时我描述了序列处理「Fast Weight Controllers」或 Fast Weight Programmers (FWPs)。FWP 拥有一个慢速的神经网络,它通过反向传播学习以快速修改另一个神经网络的快速权重。

证据4:

(I)一个整体认知架构,其中所有模块都是可区分的,其中许多模块是可训练的。

(II)H-JEPA:预测世界的非生成层次架构在多个抽象级别和多个时间尺度上学习表示的模型。

(III)一系列非对比自我监督学习范式,产生同时提供信息和可预测的表示。

(IV)使用 H-JEPA 作为不确定性下分层规划的预测世界模型的基础。

对此,Schmidhuber也按照LeCun列出的这四个模块一一校对,并给出了与他论文中有重合的点。

文章最后,他表示这篇文章的重点不是攻击发表的论文或是其作者所反映的想法,关键是这些想法并不像LeCun 的论文中写的那样「原创」。

他说,这些观点的提出中许多都有着我和我的同事的努力,LeCun现在所提出的他的「Main original contribution」其实与我几十年来研究的贡献密不可分,我希望读者自己判断我的评论的有效性。

其实,这位大爷声称别人抄袭他的成果也不是第一回了。

早在去年9月,他就在博客上发文表示,现在引用最多的神经网络论文成果,都是建立在我实验室完成的工作之上的:

「LSTM不用说了,其他还有今天鼎鼎大名的开创性工作比如ResNet,比如AlexNet、GAN、Transformer,都和我的工作有关系。有些工作的第一版就是我做出来的,但是现在这些人不讲武德,引用不规范,搞得这些成果现在的归属认知有问题。」

虽然大爷气性很大,但不得不说Jürgen Schmidhuber这么多年来确实有些意难平。

同为AI领域的前辈级人物,开创性成果没少做,但获得的声誉和认可度似乎总与期望值有很大差距。

尤其是在2018年,深度学习三巨头:Yoshua Bengio、Geoffrey Hinton、Yann LeCun荣获图灵奖时,就有不少的网友发出了质疑:图灵奖为什么没颁给LSTM之父Jürgen Schmidhuber?他也是深度学习领域的大家啊。

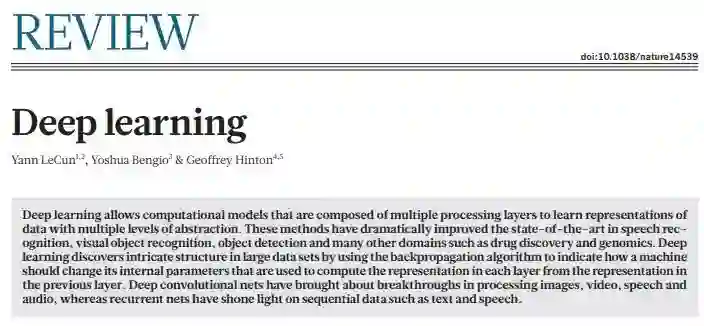

时间回到2015年,当时Bengio、Hinton和LeCun三位大神联手在Nature上发了一篇review,题目直接就叫《Deep Learning》。

文章从传统的机器学习技术讲起,总结了现代机器学习的主要架构和方法,描述了训练多层网络架构的反向传播算法,以及卷积神经网络的诞生,分布式表示和语言处理,以及递归神经网络及其应用等等。

不到一个月后,Schmidhuber就在自己的博客上发文进行了批评。

Schmidhuber表示,这篇文章让他非常不爽,因为全文多次引用三位作者自己的研究成果,而对于其他先驱人物对深度学习更早的贡献则只字不提。

他认为,获得图灵奖的「深度学习三巨头」俨然成了贪他人之功,以为己利的鸡贼、借助江湖地位互相吹捧,压制老前辈的学阀。

2016年,Jürgen Schmidhuber又在NIPS大会的Tutorial上和「GAN之父」Ian Goodfellow正面交锋。

当时,Goodfellow正讲到GAN与其他模型相比较时,Schmidhuber便站出来提问打断。

Schmidhuber的问题很长,大概说了两分钟,主要内容是强调说自己在1992年就已经提出来PM,接着说了一大堆它的原理、实现过程等等,最后图穷匕见:你说说你的GAN和我的PM有没有相似之处?

Goodfellow也不示弱:你说的问题我们之前在邮件里已经交流过很多次了,我也早就公开回应过你了,不想在现在的场合浪费听众的耐心。

或许Schmidhuber的这些「蜜汁操作」,可以用LeCun曾经的一封邮件来解释:

「Jürgen 对众人的认可过于痴迷,总是说自己没有得到应得的很多东西。几乎是惯性地,他总是在别人每次讲话结束时都要站起来,说刚刚提出的成果有他的功劳,大体上看,这种行为并不合理。」

https://people.idsia.ch/~juergen/lecun-rehash-1990-2022.html

![]()

![]()