现场 | CVPR第一天:展台布置巨头涌动,tutorial和workshop惊喜开场|CVPR 2017

CVPR 是 IEEE 一年一度的计算机视觉与模式识别技术会议,也是计算机视觉的世界三大顶会之一。2017 年的 CVPR 会议将于 7 月 21 日到 26 日于夏威夷会议中心召开,AI 科技评论将赴前线做覆盖与报道。

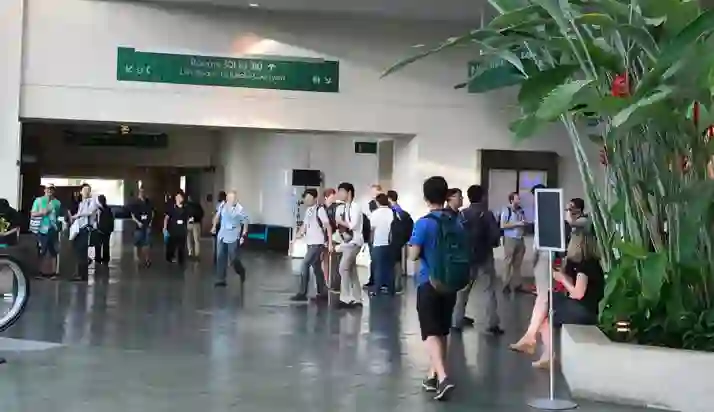

今天是 CVPR 大会的首日,一大早,CVPR 的签到台就井然有序地排起了长龙。与其它国际会议相似的是,会议采用扫码打印名牌的方式入场,此外也支持通过下载 App 的方式来关注自己想看的议程。

(这是下午拍的,早上可不是长这样)

现场还有纪念衫领取,不少同学已经迫不及待地穿上啦。

一楼的一整层是会议展台与茶歇区,规模五五平分,密密麻麻布满了展台与茶歇的大桌子,有种吃流水席的感觉。

由于正式议程明天才开始,目前展台还没有完全搭好。

不过从展板来看,微软、京东、谷歌等众多厂商将在接下来的几天开启一场声势浩大的宣传活动。

而三楼和四楼则是今天 tutorial 和 workshop 的主要阵地。根据大会资料统计,今年 CVPR 共有 44 个 workshop 和 22 个 tutorial 举行,分别与 21 日和 26 日进行,覆盖计算机视觉的多个细分领域,包括语言、生物学、3D 建模、自动驾驶等。因此,持续一整天的 tutorial 和 workshop 简直是让人眼花缭乱,目不暇接。AI 科技评论现场询问了几位到场的同学,他们都表示只能是忍痛割爱,选择自己所研究的领域或是自己感兴趣的方向进行了解。

其中,大牛多且演讲内容翔实的 workshop 自然成为了一座难求的热门议程,比如周博磊、王晓刚、Ross Girshick 和何凯明所组织的《 Deep Learning for Objects and Scenes 》就是今天比较火爆的 tutorial 之一,有好几位同学都提及自己去了这个议程。在计算机视觉领域,深度学习已经成为了视觉建模的主要驱动力。而这个 tutorial 将围绕近期在深度学习领域的研究进行展示,着实令人非常期待。

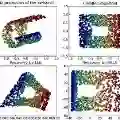

而在 21 日下午,两位 FAIR 实验室的研究员何凯明与 Ross Girshick 分别介绍了视觉识别如何学习深度表征(深度残差网络的设计),以及物体识别的深度学习研究;而 MIT 的周博磊则对量化分析不同卷积神经网络内部神经元的语义特征进行分析;香港中文大学的王晓刚则介绍了用深度学习进行视频分析。

清华大学的三年级博士生孔涛去年参加了 CVPR ,今年再次来到现场的他告诉AI科技评论,《Deep Learning for Objects and Scenes》的这几位组织者都是这个领域比较顶尖的研究者,因此受欢迎也毫不意外,他自己也听了这个报告。

从 14 年到 17 年,目标检测的研究重点变化非常快。而为何会有如此迅速的进展,孔涛向 AI 科技评论表示,一方面是因为工业界有这样的需求,另一方面也是靠研究自身的推动。

至于应用领域,孔涛表示最简单直接的应用就是以图搜图,或者是用文字描述视频等内容。「目标检测、识别这些任务,实际上只是最基础的一环,要实现更具体的应用,如无人驾驶,还需要在基础研究上做更多的工作。」

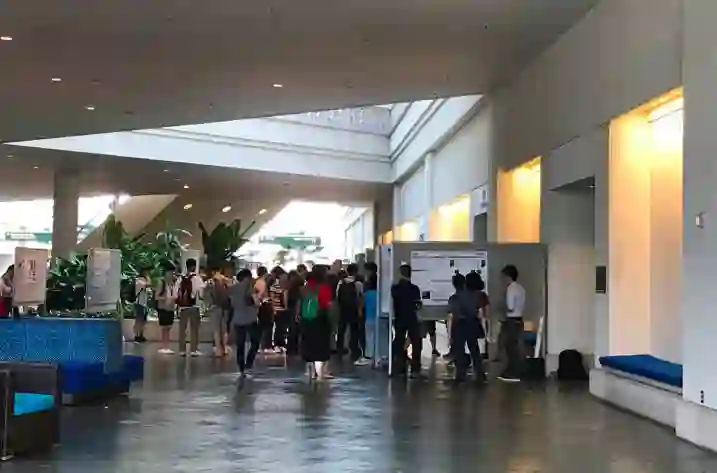

一叶知秋,其它的议程相信也非常充实和精彩。在会议结束后,还有不少参会者在现场围着 poster 讨论,或是在休息区进行交流和分享。

CVPR 第一天就在满满的议程以及辛苦地倒时差中度过了,而明天主议程召开,真正的重头戏才刚刚开始。AI 科技评论也将从前线继续带来 CVPR 的一线报道,敬请关注。