程序员早下班的编码神器 GitHub Copilot,遭 90 亿美元的集体诉讼!

【CSDN 编者按】GitHub Copilot 的到来,是自动化工具的一个里程碑事件,但是因其采用的代码引发的版权争议,似乎正在打开一个潘多拉魔盒。

2021 年 6 月,微软与 OpenAI 宣布共同推出一款 AI 编程工具—— GitHub Copilot,这让不少程序员朋友欢呼雀跃,奔走相告称有了代码补全神器,终于可以减负还能早些下班了。

然而一年之后,在 Copilot 带着每月 10 美元每年 100 美元的价格(面向学生、主流开源项目维护者免费)正式上线之际,「好用」的声音似乎正逐渐淹没在「我的代码没经授权出现在了 Copilot 自动填充的代码行中」斥责与质疑声中。

近日,一位身兼作家、设计师、程序员和律师数职的 Matthew Butterick 正式向 GitHub Copilot “开炮”,向加利福尼亚州旧金山的美国联邦法院提起集体诉讼,诉讼的对象为微软、GitHub 和 OpenAI。

因 Copilot,GitHub、微软、OpenAI 遭到集体诉讼

Matthew Butterick 还专门开发了一个名为 githubcopilotlitigation.com 的网页,用来分享对 GitHub Copilot 诉讼的相关进展。

当打开页面,我们赫然可以看到一些加大的字体内容,「我们已经提起诉讼,挑战 GitHub Copilot,这是一款依赖于前所未有的开源软件盗版的人工智能产品。因为人工智能需要对每个人都是公平和有道德的。」

紧接着,Matthew Butterick 表示其代表可能有数百万 GitHub 用户的拟议集体,对 GitHub Copilot(以及为 Copilot 提供动力的相关产品 OpenAI Codex)的合法性提出质疑,该诉讼的被告包括 GitHub、微软(GitHub 的所有者)和 OpenAI。

发布一年,GitHub Copilot 为何引众怒?

回顾事件始末,Matthew Butterick 等开发者对 GitHub Copilot 实则不满已久。

GitHub Copilot 现如今作为 Visual Studio 以及 IDE 的插件,可以帮助开发者在使用编辑器写代码时,自动生成一些代码建议。不过,Copilot 相比传统的自动代码生成工具有着很大的不同。

用过这款工具的开发者可能都知道,Copilot 是由 Codex 提供支持,Codex 是由 OpenAI 创建并授权给微软的 AI 系统(尽管微软也被称为“OpenAI的非官方所有者”)。但是,作为底层人工智能系统的 Codex 是如何训练的呢?根据 OpenAI 的说法,Codex 接受了“数千万个公共存储库”的训练,其中包括 GitHub 上的代码。

问题的症结就出现在了这里,Matthew Butterick 在一篇文章中直接指责道,“也许现在的你并不介意 GitHub Copilot 在没有询问的情况下使用你的代码。但是,如果 Copilot 逐渐抹杀了开源社区,你会有什么样的感觉?”

通过在公开的 GitHub 存储库上训练自家的人工智能系统,Matthew Butterick 认为微软、OpenAI、GitHub 侵犯了大量创作者的合法权利,这些创作者在 GitHub 上根据某些开源许可发布了代码或其他作品,如基于 MIT、GPL、Apache 等开源许可证,这些都会要求使用者需注明作者姓名和版权等内容,然而 GitHub Copilot 在补全代码时候并没有这些版权信息。

为此,Matthew Butterick 从训练和使用两个角度质疑了 Copilot 这款产品存在的法律问题。

一、Copilot 产品中基于代码训练的问题

绝大多数的开源软件包是在授予用户某些权利和义务(例如保留源代码的精确属性)的许可证下发布的。这些许可证是让软件作者在其代码中声明他们的版权。

因此,那些希望使用开源软件的人必须:

遵守许可证规定的义务

使用受「许可证例外」约束的代码,例如,版权法下的合理使用。

微软和 OpenAI 承认,Copilot 和 Codex 是在 GitHub 上的公共存储库中接受了开源软件的训练。

然而,如果微软和 OpenAI 选择在每个存储库所遵循的开源许可证下使用,那么他们需要发布大量的许可证所要求的版权信息,但是,我们现在看不到任何的版权信息内容。

因此,微软和 OpenAI 必须依赖于“合理使用”的这个理由。针对这一点,GitHub 前 CEO Nat Friedman 在 Copilot 的技术预览会上曾经表示过,“在公开数据上训练(机器学习)系统属于合理使用。”

Matthew Butterick 表示,事实上,这是一个法律问题,并不是谁说了就算的。

二、使用 Copilot 自动补全代码的问题

在使用问题上,此前微软将 Copilot 的输出描述为一系列代码「建议」。微软对 Copilot 提供的代码建议中“不主张任何权利”。但是,微软也不保证如此生成的代码的正确性、安全性和导致的知识产权问题。

简单来看,这意味着作为使用者,当你使用 Copilot 工具提供的代码建议时,「带来的一切后果都由自己承担」:

你要对你代码的安全性和质量负责。我们建议您在使用 GitHub Copilot 生成的代码时采取与使用非您自己编写的任何代码时相同的预防措施。这些预防措施包括严格的测试、IP(知识产权)扫描和安全漏洞跟踪。

问题百出的 GitHub Copilot

虽然 Copilot 可以加快编写代码的过程并简化软件开发,但是它对公共开源代码的使用让包括 Matthew Butterick 在内的不少开发者以及组织担心这款工具带来的一系列麻烦与问题。

不久之前,软件自由保护协会(以下简称 SFC)在官网发表了一篇题为《放弃 GitHub,时机已到》的长文,表示:由于 GitHub 的不当行为,SFC 将结束自己对 GitHub 的所有使用,并将协助其他自由软件项目从 GitHub 迁移。虽然 SFC 现在不会强制要求现有会员迁移项目,但他们将不再接受不打算从 GitHub 迁移的新会员项目。

其中,SFC 怒批 GitHub 的不当行为指的就是 GitHub 在长达一年的时间内拒绝回应 SFC 对于 Copilot 在公开代码上进行训练的合法性质疑。

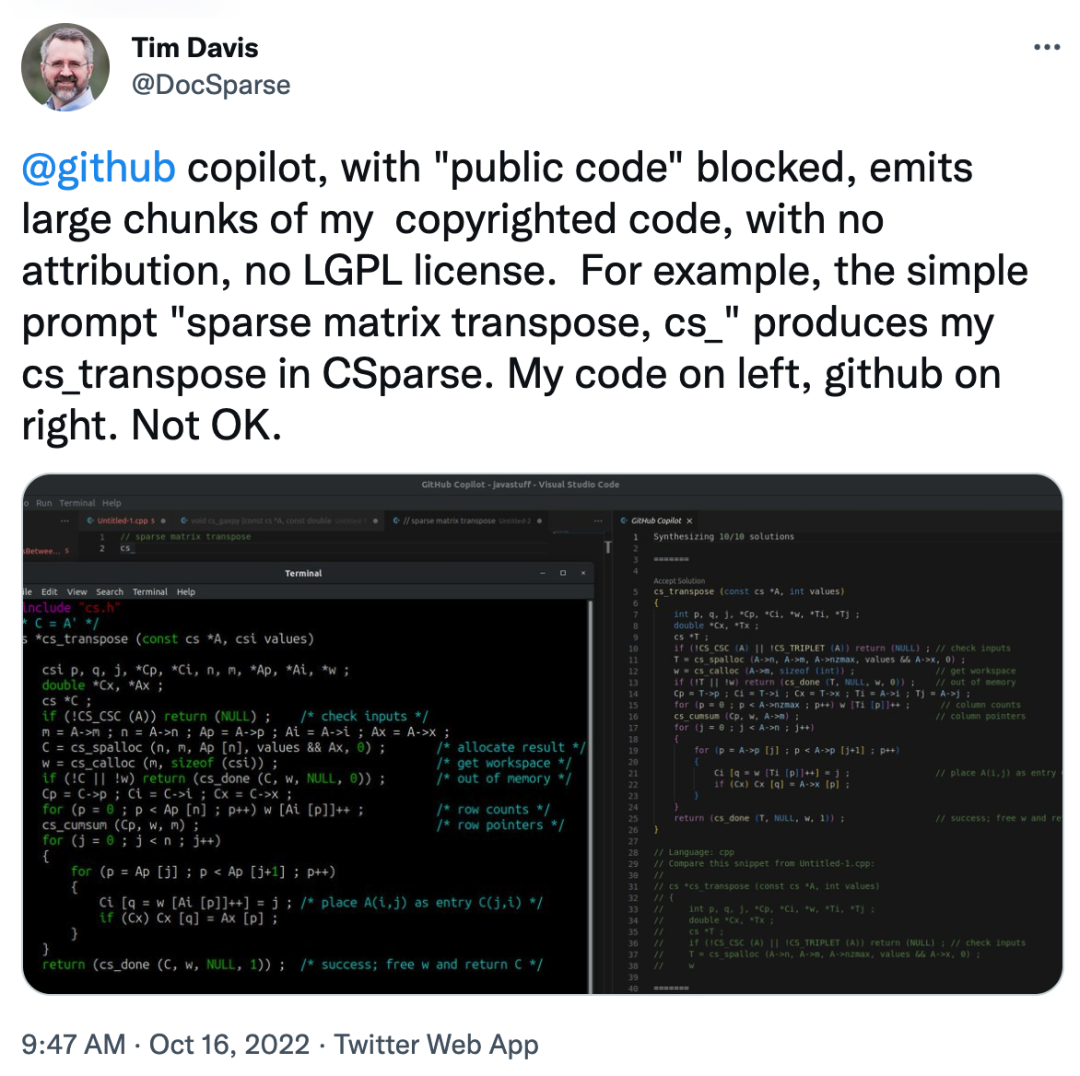

除此之外,德州农工大学的一位计算机科学与工程教授 Tim Davis 近日也在推特上发文抨击 GitHub Copilot,“基于人工智能的编程助手 GitHub Copilot 在没有署名也没有 LGPL 许可的情况下自动填入了大量我个人受版权保护的代码”。

诸如此类的抨击也不在少数,“似乎微软正在无视基础开源许可证的条件和其他法律要求,从他人的工作中获利”,在本次提起诉讼中代表 Matthew Butterick 的律师事务所 Joseph Saveri 评论道。

在此次诉讼中,Matthew Butterick 认为 Copilot 在违反许可证之外,还违反了以下内容:

GitHub 的服务条款和隐私政策

DMCA 1202,禁止删除版权管理信息

加州消费者隐私法

以及引起相关法律索赔的其他法律。

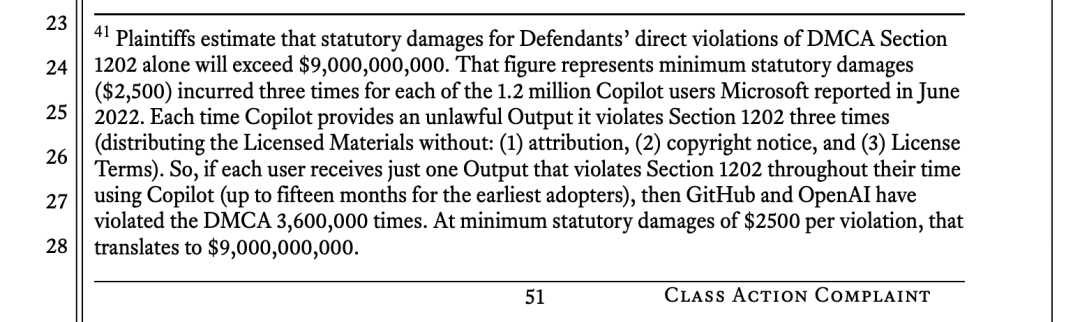

目前诉讼已经提交到了美国加州北区地方法院,要求批准 9,000,000,000 美元的法定赔偿金。根据诉讼书内容显示:

原告估计,仅被告直接违反 DMCA 第 1202 条的法定损失就将过 90 亿美元。这个数字代表了微软在 2022 年 6 月报告的 120 万 Copilot 用户中的每一个人所产生的三次最低法定赔偿金(2500 美元)。每次 Copilot 提供非法输出,都会三次违反第 1202 条(在没有以下内容的情况下分发许可材料:(1)署名,(2)版权声明,以及(3)许可条款)。因此,如果每个用户在使用 Copilot 的整个过程中(对最早的用户来说,最长可达 15 个月)只收到一次违反第 1202 条的输出,那么 GitHub 和 OpenAI 就违反了 DMCA 3,600,000 次。按照每起违法行为 2500 美元的最低法定赔偿额计算,这相当于 90 亿美元。

在未来几周内,Matthew Butterick 称可能会修改这份投诉,以增加其他各方和索赔。同时,他说道,「这是将是漫长旅程的第一步。据我们所知,这是美国第一个挑战人工智能系统训练和输出的集体诉讼案件。它不会是最后一个。人工智能系统不能免于法律的约束。那些创造和使用这些系统的人必须保持负责任的态度。如果像微软、GitHub 和 OpenAI 这样的公司选择无视法律,他们不应该指望我们公众会坐视不理。人工智能需要对每个人都是公平和道德的。如果不是这样,那么它就永远无法实现提升人类的目标。它只会成为少数特权者从多数人的工作中获利的另一种方式。」

对于这样的诉讼,不少开发者认为赢面并不大,不过能够在一定程度上反向促进平台进行改进,未尝不是一件好事。对此,你如何看待 GitHub Copilot 这款工具?欢迎留言分享你的看法。

参考资料:

https://githubcopilotlitigation.com/

https://s3.documentcloud.org/documents/23264658/github-complaint.pdf

— 推荐阅读 —

☞鸿蒙开发套件,打造鸿蒙世界技术底座

☞

张益唐完成“零点猜想”111页论文;裁错人了?马斯克让几十名被裁推特员工返岗上班;Copilot被索赔90亿美元|极客头条

☞

硬货来了,RTE2022 大会技术专场:人性化、软硬件结合

相关内容

http://Gitlab.com

国内类似服务:

http://Coding.net