知名企业与高校代表深入探究“视觉模型基础” | TF58回顾

5月17日上午,CCF TF第58期活动“视觉基础模型”于线上成功举行。本期会议邀请到百度、微软、谷歌、加州大学圣迭戈分校(UCSD)、粤港澳大湾区数字经济研究院(IDEA)等企业和高校的代表,分享视觉基础模型研究进展,探讨视觉基础模型应用落地的现状及挑战等。TF“算法与AI” SIG本年度还有四场活动,欢迎各位关注并参与,具体时间请见文末。

预训练模型(或称基础模型)是近年来人工智能领域活跃的研究方向之一,在科学研究和工业应用中都取得了快速进展,视觉基础模型特别是大模型的研究,方兴未艾。本次由CCF TF算法与AI SIG主席、百度人工智能技术委员会主席何中军主持。本期活动围绕主题重点讨论,线上气氛热烈。

在开场致辞中,何中军提到从大规模数据,如无标注数据、图文数据、或者多模态数据中,通过预训练得到的视觉基础模型,提升了许多视觉下游任务以及某些垂直场景(如OCR等)性能。视觉基础模型的技术进展如何,面临哪些挑战,如何在实际应用场景中产生更大的价值,值得我们进一步探索。

图1:何中军致辞

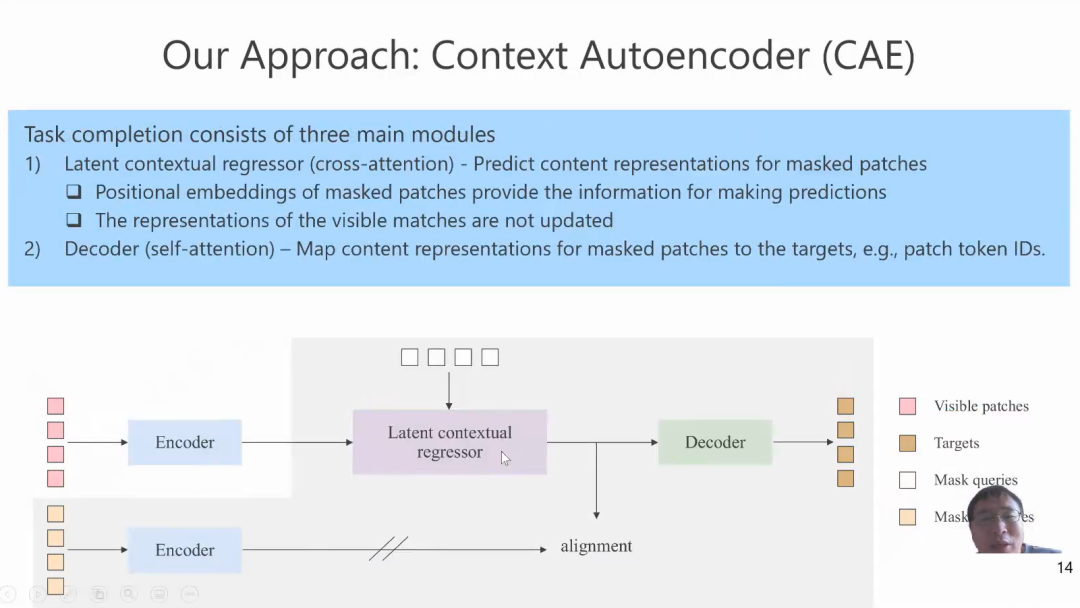

《基于Context Autoencoder的自监督表征预训练》

百度计算机视觉的首席科学家王井东博士介绍了在自监督预训练方面的进展。在本次分享中,介绍了一种新颖的掩码图像建模方法,即Context Autoencoder (CAE),用于规模化的自监督表征学习预训练。核心思想包括在隐表示空间中进行从可见块到掩码块的预测,编码器仅用于表示学习,表示学习仅由编码器进行。实验表明,在物体检测和实例分割等任务上,CAE相比于对比预训练(例如 SimCLR、MoCo)等模型,取得了显著提升。

图2:王井东分享内容

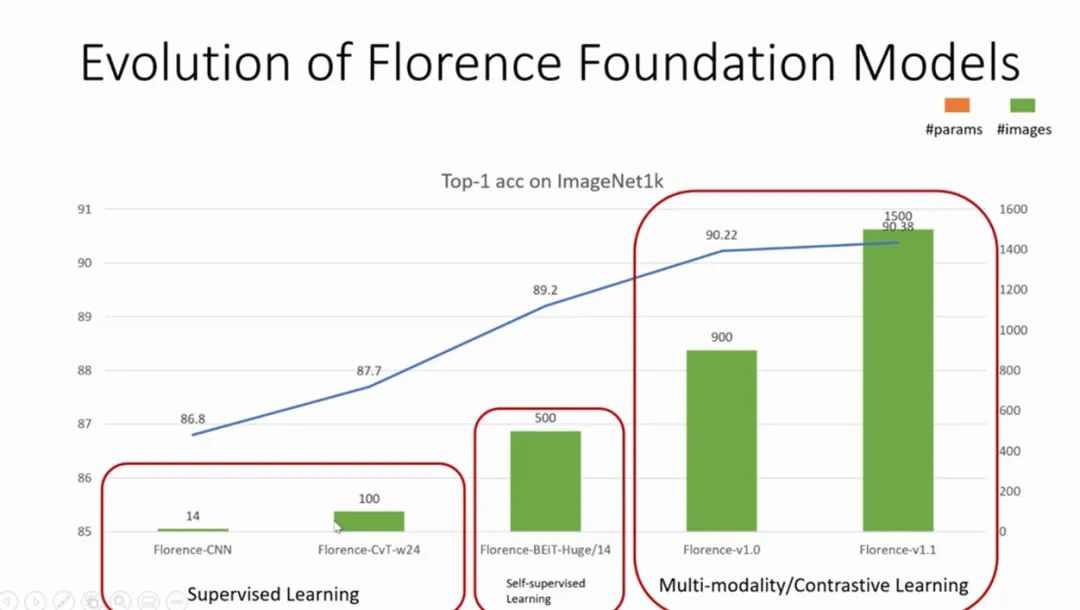

《Florence:计算机视觉的新基础模型》

微软Cloud&AI计算机视觉研究组高级研究员肖斌博士介绍了微软2021年发布的视觉预训练模型Florence。通过结合来自 Web的大规模图像-文本数据训练,可以适应各种计算机视觉任务,包括分类、检索、目标检测、视觉问答(VQA)。模型发布时在40多个表征基准测试中取得了新的SOTA结果。

图3:肖斌分享内容

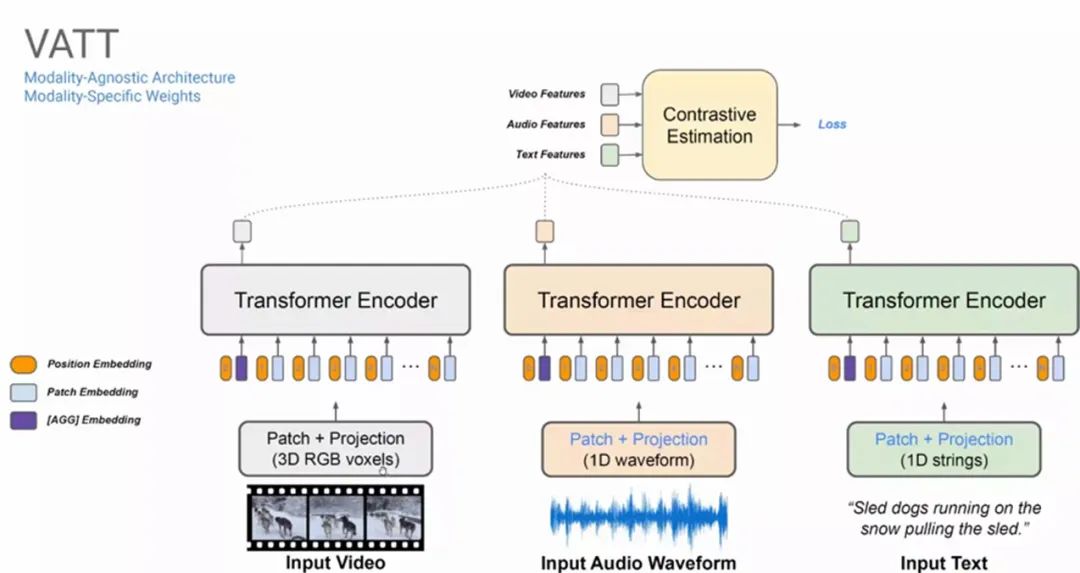

《通过多模态监督和蒸馏的标签高效视觉感知》

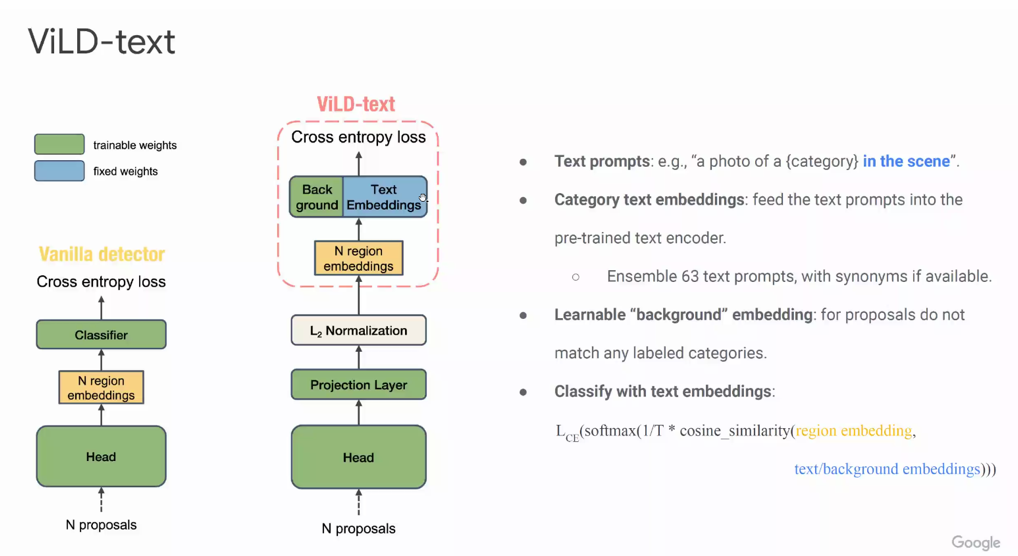

谷歌高级研究科学家崔崟介绍了最近的两项以构建标签高效的计算机视觉模型的工作,VATT(Video-Audio-Text Transformer)以及ViLD(Vision and Language Distillation for Open-Vocabulary Object Detection)。在 VATT 中,使用统一的 Transformer 编码器从未标记的原始视频、音频和文本中学习多模态特征表示。在ViLD 中,通过把预训练的视觉-语言模型中的知识蒸馏到Mask R-CNN中以实现开放词汇目标检测。

图4:崔崟分享内容

图5:崔崟分享内容

图6:Panel

在Panel环节,三位报告人与来自UCSD的屠卓文教授(IEEE Fellow)、IDEA的张磊教授(IEEE Fellow)就视觉基础模型的发展与挑战、落地应用、未来发展等展开了热烈讨论。屠卓文认为视觉基础模型虽然取得了一定进展,但是与自然语言处理(NLP)大模型取得的效果相比,还未取得令人惊叹的进步。可能的原因是视觉是统计信号,而语言则经过人类加工抽象融合了更多知识。肖斌则认为视觉基础模型从训练数据、参数量来看,比NLP预训练模型要小。崔崟认为语言是高层次语义的抽象,而视觉数据相对来说冗余比较大,相应的计算量也大。随着预训练模型规模越来越大,也引发了人们对大模型还是小模型方面的讨论。张磊认为,大模型可以学习和吸收大数据包含的模式,而小的网络(模型)则未必能够“消化”庞大的数据。各位嘉宾还对落地应用、跨模态预训练模型等与参会人员展开了互动和讨论。

视觉基础模型,是计算机视觉研究领域和应用领域里的热门话题,还有很多理论与实践问题值得进一步探索。本次分享和交流给大家带来了不少启发和帮助,算法与AI SIG接下来的四场活动请见下表。本期精彩回顾视频可在CCF数字图书馆观看,欢迎持续关注TF更多精彩活动!

CCF TF算法与AI SIG活动安排

TF64 |

2022/7/5 |

量子人工智能:机遇与挑战 |

TF70 |

2022/8/16 |

跨模态前沿AI技术及产业应用 |

TF94 |

2023/2/23 |

NLP技术产业化之路 |

TF97 |

2023/3/23 |

语音处理前沿及产业化 |

下期预告:

CCF TF60

企业的研发效能实践为企业带来了多大的优势,帮企业解决了哪些问题?CCF TF研发效能SIG系列活动将以企业级研发效能提升为主线,分别进行深入探讨。本期CCF TF将邀请来自腾讯和Thoughtworks的技术代表,深入探讨软件企业在推行研发效能提升过程中遇到的问题以及经过验证的最佳实践。内容涉及大型互联网企业研发效能提升实践的理论框架体系与工程化实践,以及测试效能提升的探索。

识别或扫码报名

报名链接:https://conf.ccf.org.cn/TF60

CCF TF61

在软件定义一切的时代,软件也存在供应链,也有供应链安全问题,2020年底的Solarwinds Orion被植入后门、2021年底Log4J2漏洞事件为全世界敲响了警钟,如何让开发出来的软件更安全,如何保证软件供应链安全,是全世界都在关注的焦点。

本期邀请到悬镜安全创始人子芽(张涛)、默安科技董事副总裁沈锡镛、墨云科技安全研究员和其正(马伦杰)三位从事开发安全与软件供应链安全的专家分享他们对开发安全和软件供应链安全的观点和实践经验。欢迎报名,期待6月16日线上见!

识别或扫码报名

报名链接:https://conf.ccf.org.cn/TF61

关于CCF TF

CCF TF技术前线(Tech Frontier)创立于2017年6月,旨在为工程师提供顶级交流平台,更好地服务企业界计算机专业人士,帮助企业界专业技术人士职业发展,通过搭建平台实现常态化合作和发展,促进企业间、学术界与企业间技术交流。目前已组建架构、安全、智能前端、知识图谱、数据科学、工程师文化、算法与AI、智能制造、智能设备与交互、产业智能化、研发效能等十一个SIG(Special Interest Group),提供丰富的技术前线内容分享。2022年4月至2023年3月,CCF TF将在线开展47场活动,会员免费参加。

加入CCF

加入CCF会员享受更多超值活动,为自己的技术成长做一次好投资。

点击链接了解更多会员权益:CCF个人会员权益 CCF公司会员权益

识别或扫码入会

欢迎关注CCFTF及CCF业务总部公众号,精彩陆续开启!

关注CCFTF获取TF活动资讯

关注CCF业务总部优惠预定会议场地

CCF推荐

【精品文章】

点击“阅读原文”,报名TF60!