可解释人工智能

·

【导读】开放数据科学会议ODSC21在 3 月 30日-4 月 1日,大会涵盖了众多最近研究报告,来自Freddy Lecue博士做了关于可解释人工智能的进展报告,非常值得关注!

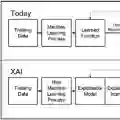

人工智能的未来在于使人类能够与机器合作解决复杂的问题。就像任何有效的合作一样,这需要良好的沟通、信任、清晰和理解。可解释人工智能(XAI)旨在通过结合符号人工智能和传统机器学习的优点来应对此类挑战。多年来,各种不同的AI社区都在研究这一主题,他们有着不同的定义、评估指标、动机和结果。

XAI是指一套用于解释机器学习之外的任何类型的人工智能系统的工具。尽管这些工具旨在解决更广泛意义上的解释问题,但它们并不是为所有用户、任务、上下文和应用设计的。本演讲将通过回顾XAI的方法、动机、最佳实践、工业应用和局限性来描述其迄今为止的进展。

本教程是XAI迄今为止工作的一个概述,并综述了AI社区所完成的工作,重点是机器学习和符号AI相关方法。我们将阐述XAI在现实世界和大规模应用中的需求,同时提供最先进的技术和最佳的XAI编码实践。在教程的第一部分,我们将介绍AI的不同方面的解释。然后,我们将本教程重点介绍两种具体方法:(i) XAI使用机器学习,(ii) XAI使用基于图的知识表示和机器学习的组合。对于这两种方法,我们都进入了具体的方法,目前的技术水平和下一步的研究挑战。本教程的最后一部分概述了XAI的实际应用以及最佳XAI编码实践。

地址:

成为VIP会员查看完整内容

相关内容

Arxiv

0+阅读 · 2021年6月10日

Arxiv

0+阅读 · 2021年6月7日