大国竞争已不再局限于传统战场,更延伸至数据、算法与人工智能(AI)领域。随着敌对势力将虚假信息武器化、网络攻击持续升级,美国面临新挑战:如何在保障敏感数据安全的前提下开发更强大的机器学习系统。

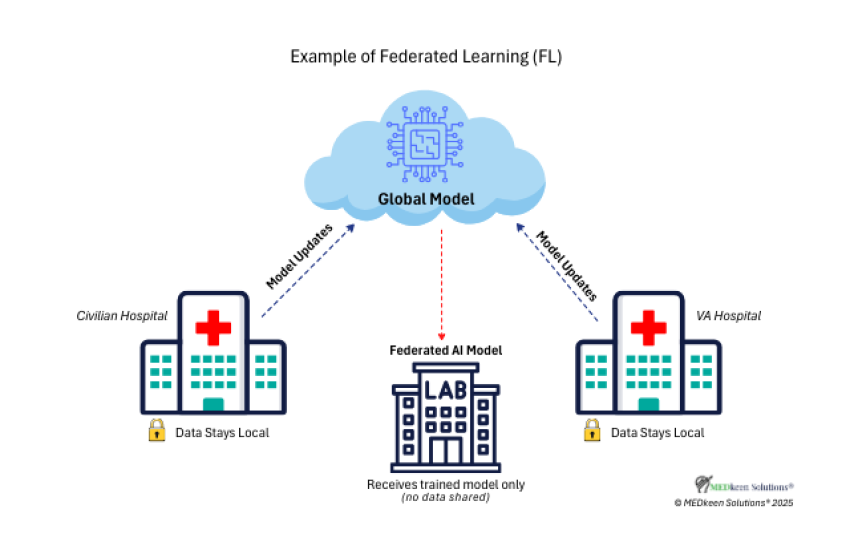

联邦学习(FL)技术直面此挑战。其允许AI模型在分散式网络中训练而无需传输原始数据,从而增强安全性、保护隐私并保持操作控制权——这些特性对国家安全至关重要。

联邦学习运作机制

传统AI模型依赖中心化可信训练环境,默认所有参与者可靠。但现实政府系统中,内部威胁与外部攻击始终存在风险,该假设并不成立。正如加夫尼等人(2021)指出,单一受感染参与者即可污染模型学习过程。联邦学习通过内置防护机制检测隔离此类攻击,为国土安全、作战持续性与政府运作持续性提供强韧保障。

这些威胁印证联邦网络安全核心原则:“零信任”架构。在此环境中,所有内外部参与者均不被默认信任。联邦学习通过最小化共享攻击面、支持敏感数据免传输式更新验证强化该模型。即便在多机构断联场景中,其隐私保护架构仍可与零信任安全框架无缝协同。当政策法规或实操限制阻碍数据直接共享时,该架构使跨机构团队协作成为可能。随着联邦机构推进基础设施现代化,联邦学习的分散化优势在敏感受监管环境中价值日益凸显。

敏感受监管领域的联邦学习应用

联邦学习(FL)可在政府、国防、医疗及公共事业网络中运行,使私有数据保留在本地,同时支持企业级模型开发。这种分散化模式特别适用于需遵守隐私法规或处理涉密信息的机构。

据Check Point研究显示,2024年美国公共事业系统遭受的网络攻击同比激增70%,凸显关键基础设施的脆弱性持续加剧。

现代公共事业高度依赖AI驱动型监控、预测性维护及网络威胁检测系统维持高效安全运行。这些模型通常需基于分布式系统(如发电站、智能电表及物联网电网)采集的敏感运营数据训练。数据集中化存储带来显著风险——特别是当攻击面持续扩大时。联邦学习提供安全替代方案:允许各站点在本地训练模型,仅共享模型更新而非原始数据。在高风险行业(如公共事业),联邦学习能实现协作式AI开发,同时保障系统韧性、控制权与运营安全。

敏感系统防护:联邦学习实战案例

军方、退伍军人医院(VA)与民用医院正采用AI技术辅助诊断、临床决策及运营优化。此类应用需训练处理医学影像、实验室结果甚至人力数据的模型,以识别疾病、推荐诊疗方案或优化分诊流程。然而此类数据的应用面临隐私与合规风险:《健康保险流通与责任法案》(HIPAA, 1996)及《联邦风险与授权管理计划》(FedRAMP)等法规使患者信息集中化存储困难重重——尤其随着远程诊疗平台与移动应用扩大数据暴露面。

联邦学习开辟安全新路径:各医院可协作训练AI模型而无需传输原始患者数据。即使系统架构与政策不同的机构,亦能改进共享模型性能,全程无需交换受保护的健康记录。

该模式已在部分私立医疗领域实践:

“竞争性私立医院间的特定病理科室……通过各自数据集联合训练共享诊断算法。”——ParraMoyano、Schmedders与Werner(2024)

例如退伍军人事务部可与民用医院网络合作提升早期疾病诊断准确率。通过联邦学习,各机构使用自有患者影像或检测结果本地化训练模型。在零数据共享前提下,双方均可获取更强大、更多元的模型性能,实现隐私合规与技术创新双赢。

图:联邦学习可在政府、国防、医疗及公共事业网络等敏感环境中运行。

应急响应与国家持续性的韧性AI

美国国土安全部(DHS)与国防部(DoD)拟解决的共同挑战:如何在增强国家战备能力的同时保护支撑关键任务的敏感数据。无论是协调网络威胁响应、管理灾难后勤还是确保作战持续性,两机构都依赖分布式(通常涉密)数据进行实时决策。然而传统AI模型要求数据集中处理,这在遵循“零信任”原则与严格访问控制的环境中加剧风险。

如《信号媒体》“新兴前沿”专栏2024年1月刊所述,情报界正在开发以网络安全为核心的AI框架——联邦学习通过支持机构间原始操作数据零暴露的协作机制,为此提供关键助力。

DHS与DoD的协作体系已趋成熟:国家灾难医疗系统(NDMS)协调大规模医疗响应,联合网络防御协作组织(JC3)整合联邦资源抵御数字威胁。这些行动反映共同使命:高压环境下保障国家运行持续性。

联邦学习通过支持危机前的模型预训练强化该使命。设想DHS、联邦应急管理局(FEMA)与DoD联合开发现实场景可部署的AI系统,预测病患激增、资源短缺或网络中断。借助联邦学习,各机构可利用历史任务数据本地化训练模型,全程无需传输患者信息、涉密后勤数据或内部系统活动痕迹。由此生成提前预制、安全就绪的实战工具,在分秒必争的危机时刻即刻启用。

无论用于战备支持或应急响应,联邦学习为危机管理赋予前瞻性与灵活性。这是实现兼顾韧性及隐私保护的AI系统的务实举措,可在不危及防护数据的前提下捍卫国家安全。

联邦学习在国家安防AI中的未来

从守护患者数据到助力机构应对突发事件,联邦学习证实安全创新不仅可行而且必要。其赋予团队快速响应、高效协作的能力,同时严格遵循安全信任准则。

随着AI持续重塑国家威胁应对模式,联邦学习以“隐私优先”的务实路径脱颖而出。它使机构能构建更智能的工具,负责任地共享洞察,并牢牢掌控核心数据。

展望未来,政府与产业界需共同投资试点项目、共享标准及实战测试。共建进程愈快,系统韧性与实力愈强。

联邦学习不仅是数据防护机制,更是任务信任与国家战备能力的核心保障。

参考来源:afcea