首批开源超300个顶尖模型:这几家中国「AI主力军」,合力打造了一个AI模型社区「魔搭」

机器之心原创

从今以后,中国 AI 开发者也有了专属的「模型即服务」社区。

「模型即服务(Model as a Service)代表了未来的行业趋势,而魔搭 ModelScope 迈出了最重要的第一步。」

11 月 3 日,2022 云栖大会杭州现场,全新的 AI 模型社区魔搭 ModelScope 横空出世。

魔搭社区 ModelScope 由阿里达摩院联手中国计算机学会(CCF)开源发展委员会共同推出,首批合作机构包括澜舟科技、智谱 AI、深势科技、中国科学技术大学等多家科研机构,首批开源模型超过 300 个,中文模型占比超过 1/3,SOTA 模型超过 150 个,还有 10 多个前沿的大模型,覆盖了计算机视觉、语音、语义、多模态等多个领域,覆盖了 60 多个通用任务。这些优质的模型,从此面向行业免费开放。

为什么要做这样一件事?阿里巴巴集团副总裁、阿里达摩院副院长周靖人表示:「中文为母语的 AI 开发者人数众多,但中文 AI 模型数量不多,难以满足实际需求,而且也没有鼓励开发和使用中文 AI 模型的相关社区。因此,我们希望魔搭 ModelScope 的出现能够填补这方面的空白。」

十多年来,AI 技术的高速发展有目共睹,但如何让先进技术高效落地,始终是一大难题。

这是因为传统的 AI 模型存在技术上的局限性,1 个模型只针对 1 个任务,1000 个任务需要 1000 个模型,研发成本过高,无法实现规模化使用。

而预训练模型的兴起提供了一种新的可能。比如近年来诞生的 Transformer、BERT 等预训练模型,这些模型通过上游统一的预训练后,面对下游各种任务场景只需要微调就能实现较好的效果。很多预训练模型也已经开源,所有开发者都能下载、安装、使用。

开源并不是万能的。对于普通开发者来说,从源代码开始跑一个复杂的 AI 模型,过程较长,充满未知数。除了模型代码,开发者同样需要开源之后的模型使用服务,需要更加简便易用。

魔搭社区 ModelScope 就在这样的背景之下诞生了。

模型即服务:AI 开源 2.0 新范式

践行模型即服务(Model as a Service)的新理念,魔搭社区提供了众多预训练基础模型,只需针对具体场景再稍作调优,就能快速投入使用。

官网地址:http://www.modelscope.cn/

相比于行业内已有的其他 AI 开源社区,魔搭具备三大特征:易用性、本土化、开放兼容。

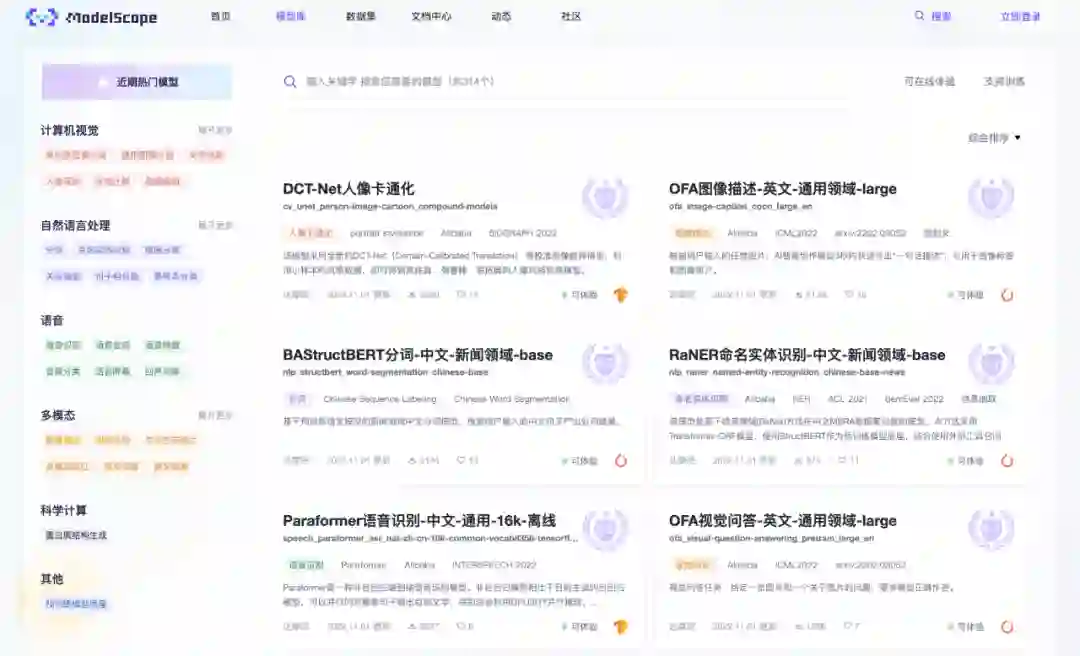

首先,魔搭提供了集模型探索、环境安装、推理验证、训练调优于一体的「一站式服务」。对于模型使用者来说,可以在魔搭平台通过多维度的标签,在线检索并直接体验模型。魔搭既支持本地环境快捷安装,也支持云端 NoteBook 免安装,真正实现了「开箱即用」。

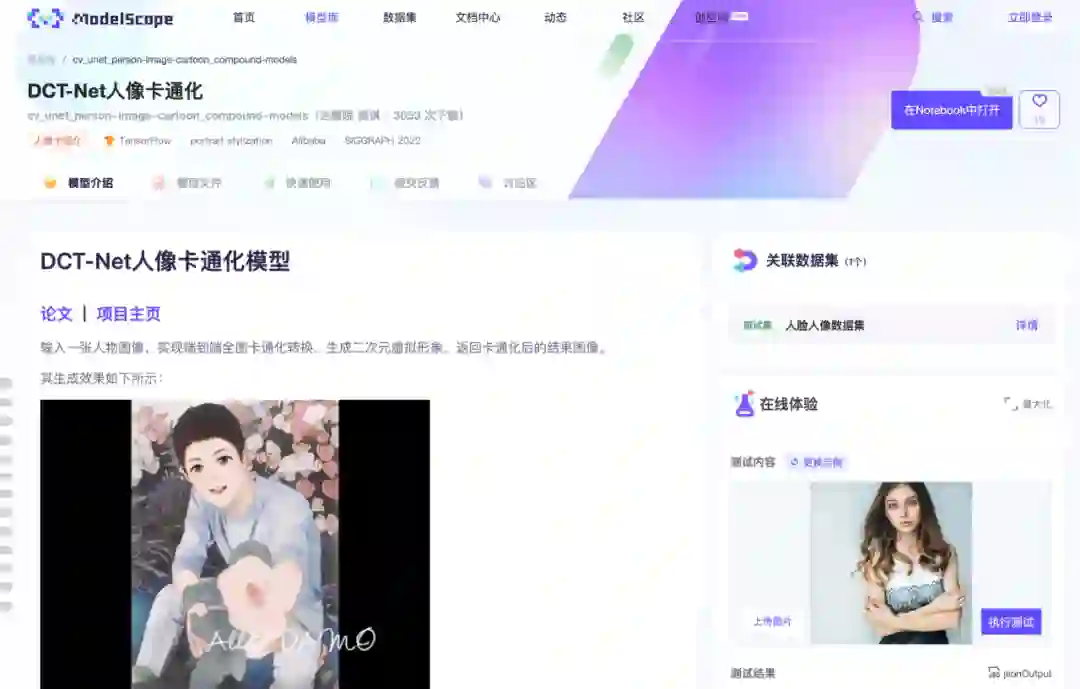

以「DCT-Net 人像卡通化模型」为例,开发者可在模型库主页快速浏览「模型介绍」,初步了解模型的架构和详细参数,还能一键链接到关联数据集或在线体验窗口。「快速使用」版块则提供了下载安装、加载和推理的操作指南。

值得关注的是,针对模型的推理和调优,魔搭通过封装的 Python SDK,实现了一行代码即可实现模型推理;此外通过简单易用的调用接口、灵活的配置文件设计,仅需十行代码就可以运行一个调优任务。

基于云的算力支撑和技术支撑,魔搭提供了更佳的用户体验,使得 AI 模型的开发和使用更简单。以往,要让一个 AI 模型跑起来,从下载开源代码到本地配置、环境部署,得到评测结果往往需要数天时间,现在只需要几个小时甚至几分钟。

其次,魔搭更关注本土化需求,更懂中文 AI 领域研究。

语言是从感知智能迈向认知智能的关键,理解中文,才能在中文世界的任务场景中取得更佳效果。社区鼓励中文 AI 模型的开发和使用,希望实现中文 AI 模型的丰富供给。

目前已经上架的超过 100 个中文模型中,包括了一系列探索人工智能前沿的中文大模型。比如阿里通义大模型系列、澜舟科技的孟子系列模型、智谱 AI 的多语言预训练模型、中文版 GPT-3、中文版 CLIP。

1 亿参数量的中文 GPT-3 文本生成模型,在魔搭社区获得了近两千次下载。

魔搭社区坚持中立开放的原则,兼容 TensorFlow、PyTorch、Caffe 等多种主流学习框架,且支持多种模型训练与服务部署方式,提供更多自主可控的选择。

社区组织架构为理事会领导。所有开发者均可共同参与社区建设,不限机构,不限类型,旨在推动 AI 的大规模使用,不以盈利为目标。

从这个维度去看,魔搭探索的是一种「AI 开源 2.0 新范式」。

推动「模型即服务」迈出重要一步

如果你对云服务行业有所涉猎,那么 IAAS(Infrastructure-as-a-Service,基础设施即服务),PAAS(Platform-as-a-Service,平台即服务) 和 SaaS(Software-as-a-Service,软件即服务) 这三个名词的涵义便不难理解。

但对于当下的行业来说,模型即服务(Model as a Service)还算一个小众概念。魔搭为什么要选择这样一种运作模式?

达摩院副院长周靖人解释说,AI 发展到今天,模型架构变得越来越复杂,参数量也越来越庞大。除了模型本身之外,研发、应用的过程还会涉及到大量的数据和相应的算力。只有少数研究者或者一些大型科技企业可以承担高昂的投入,普通 AI 开发者要训练好一个模型还是非常有难度的。况且,想要把各个领域的模型利用起来,也需要一定的技术背景和比较深入的领域 Know-How。今天,行业内还缺乏统一的框架,帮助开发者们迅速把这些模型调用起来。种种因素使得 AI 的产业化应用面临着挑战,AI 的潜力难以得到充分发挥。

基于对以上观察的思考,魔搭社区背后的创始成员们决定采取模型即服务(Model as a Service)的理念 。「人工智能发展到这个阶段,当前的学界和业界形成了一个共识:模型本身已经成为重要的载体,更加需要的是围绕模型本身搭建相关服务。我们预估,这在接下来会是整个业界发展的重要趋势。」周靖人表示。

纵观 AI 领域的技术进步历程,其实并不是靠某个人或某家公司来实现持续推动的。一个不涉及商业利益的、开放式的平台,才更能够吸引顶尖的技术人才集聚,更快实现「技术的平民化」。

也就是说,不光是从技术上降低门槛,也要从经济上要降低门槛。所以在搭建之初,魔搭就定下了原则:不考虑盈利,免费提供模型下载和二次开发的机会。

为此,魔搭此次开源开放了十多个大模型,尤其包括针对中文的大模型,希望能够被开发者用起来,让大家根据大模型去定制开发下游任务的小模型。

中国科学院院士、CCF 开源发展委员会主任王怀民指出,开源是 AI 发展的重要驱动力,魔搭 ModelScope 作为新型的 AI 开源社区,不仅将有力推动 AI 迈向广泛的落地应用,还将助力中国从开源世界的参与者逐步成长为领导者。

在这个过程中,达摩院也成为了贡献先行者。「我们把自己最好的模型都拿了出来,包括此前发布的达摩院通义大模型系列,这些全部通过社区提供相应的开发以及下载。」

对于各方参与机构来说,开源自研大模型不是「轻而易举」的事。如果想让众多优质模型放弃商业营收,进入到开源开放序列,就必须打破现有的利益格局,重塑共识。当然,要打造一个中文模型社区,不仅需要达摩院等几家机构的参与,更需要高校、科研机构、企业、个人等各种主体的贡献,以推动行业发展为己任,共同建设中文 AI 的新生态。

「魔搭社区的推出,远远算不上一个里程碑,只是一个起点,未来需要各方共同努力。」周靖人总结道。

附:魔搭社区部分模型

达摩院作画 AI(阿里通义文生图大模型) ,支持中文输入,体验入口

https://decoder.modelscope.cn/

(也可手机扫码体验)

阿里通义文本生成视频大模型

https://www.modelscope.cn/models/damo/cv_diffusion_text-to-video-synthesis/summary

阿里通义底座模型之 M6-OFA,可处理 10 多项跨模态任务;

https://modelscope.cn/models/damo/ofa_image-caption_coco_large_en/summary

阿里通义多模态大模型 mPLUG,首次在视觉问答榜单 VQA Leaderboard 上超越人类;

https://modelscope.cn/models/damo/mplug_visual-question-answering_coco_large_en/summary

阿里通义 AliceMind-PLUG (270 亿参数),中文理解和生成大模型,支持写小说、写技术文档、常识问答等功能。

https://modelscope.cn/models/damo/nlp_plug_text-generation_27B/summary

中文版 GPT-3,支持 AI 生成代码、AI 写作文、续写小说

https://modelscope.cn/models/damo/nlp_gpt3_text-generation_13B/summary

中文版 CLIP 模型(2 亿图文对),可用于图文检索和图像、文本的表征提取

https://www.modelscope.cn/models/damo/multi-modal_clip-vit-large-patch14_336_zh/summary

澜舟科技的孟子系列模型,十亿参数的轻量化模型登顶中文语言理解榜单 CLUE;

https://modelscope.cn/models/langboat/mengzi-t5-base-mt/summary

智谱AI的多语言预训练模型,支持101种语言

https://modelscope.cn/models/ZhipuAI/Multilingual-GLM-Summarization-zh/summary

深势科技的蛋白质结构预测模型 Uni-Fold,一个开源的超越 AlphaFold 的模型

https://modelscope.cn/models/DPTech/uni-fold-monomer/summary

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:content@jiqizhixin.com