NeurIPS 2020论文全面分析:2025年将会有5万篇论文提交

作者 | Sergey Ivanov

编译 | 青暮

1

一般统计

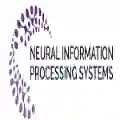

今年共有9454篇论文提交,1900篇总接收,录取率仅为20.09%,其中105篇被接收为oral,280篇被接收为spotlight。

今年共有9454篇论文提交,1900篇总接收,录取率仅为20.09%,其中105篇被接收为oral,280篇被接收为spotlight。

2

组织机构

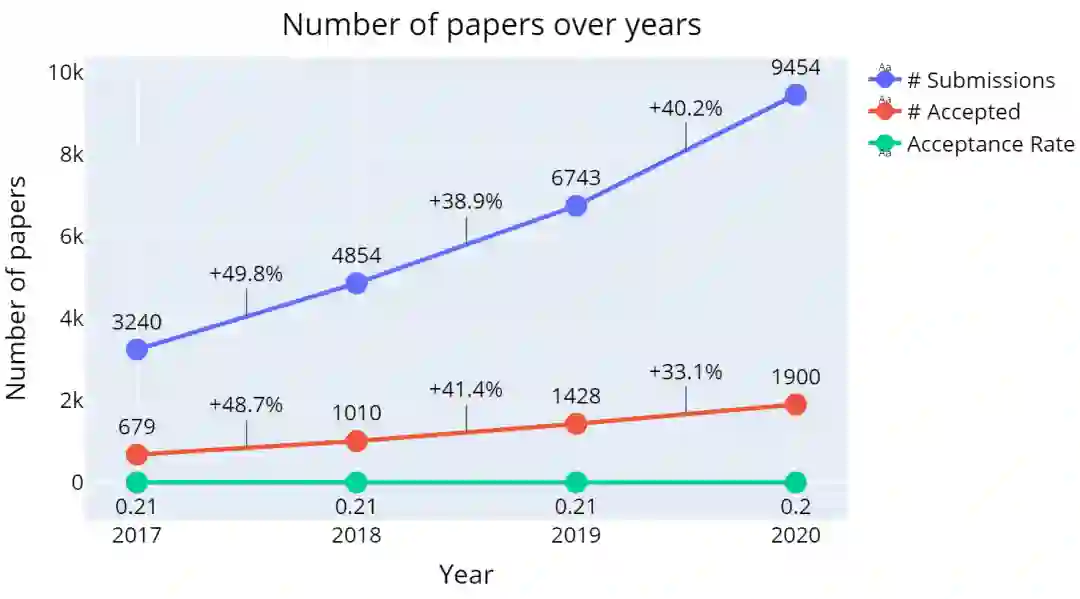

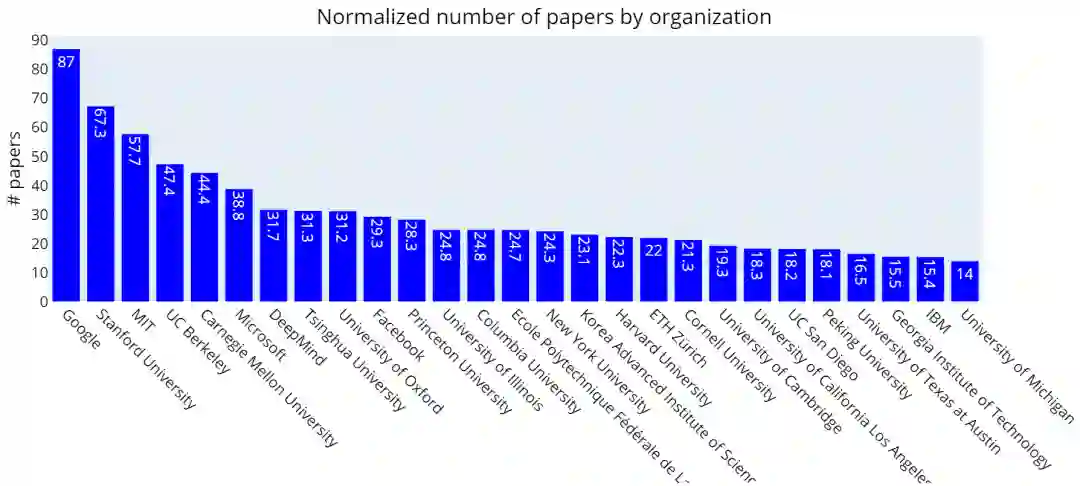

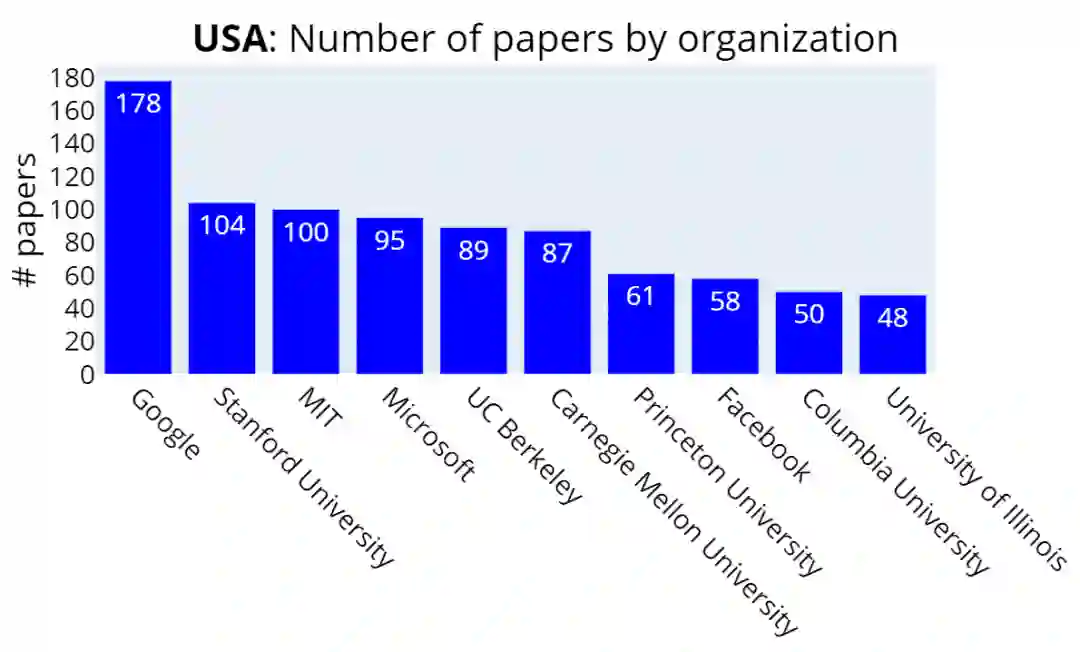

类似于ICML 2020,谷歌、斯坦福大学和麻省理工学院的论文接受数量保持领先。

类似于ICML 2020,谷歌、斯坦福大学和麻省理工学院的论文接受数量保持领先。

虽然归一化分数低于原始分数,但Top组织的相对排名几乎保持不变。

虽然归一化分数低于原始分数,但Top组织的相对排名几乎保持不变。

3

作者

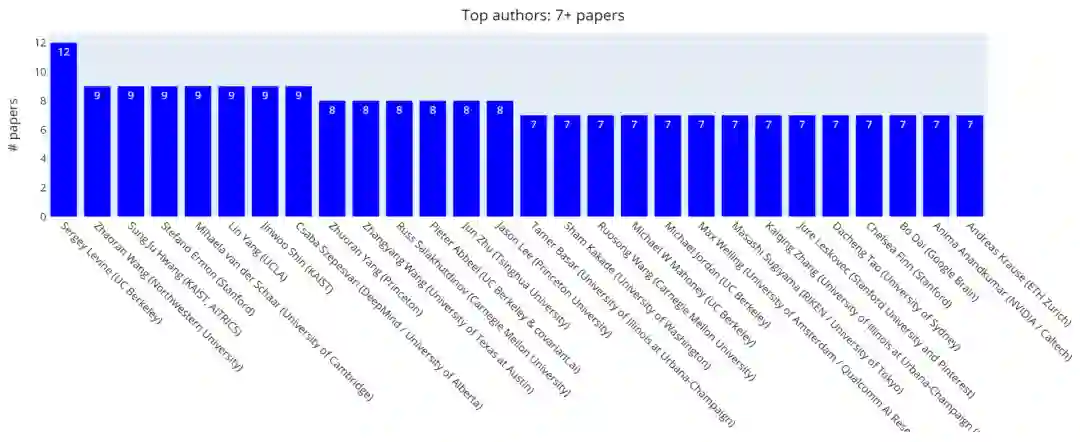

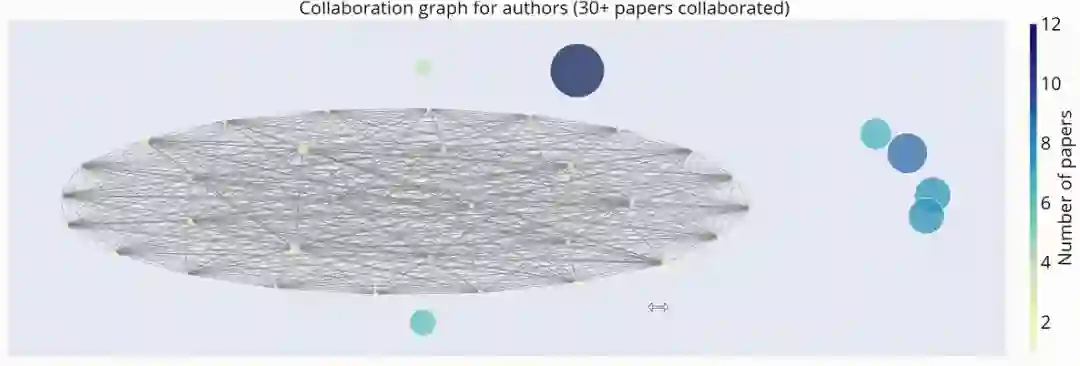

ICML 2020中有9位作者发表了7篇以上的论文,

NeurIPS 2020则有28位作者发表了7篇以上的论文。

ICML 2020中有9位作者发表了7篇以上的论文,

NeurIPS 2020则有28位作者发表了7篇以上的论文。

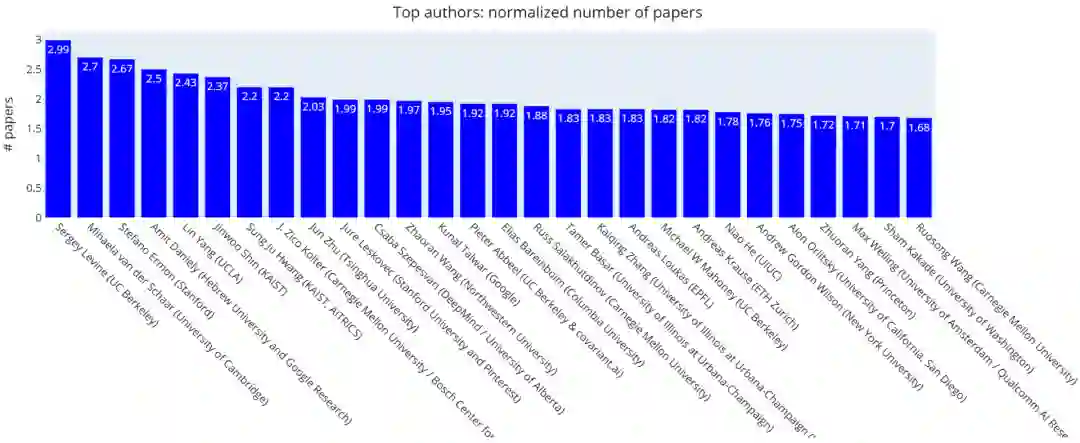

归一化后的论文数量比原来的数量减少了3-4倍,这意味着Top作者的平均论文数量为3-4篇。

归一化后的论文数量比原来的数量减少了3-4倍,这意味着Top作者的平均论文数量为3-4篇。

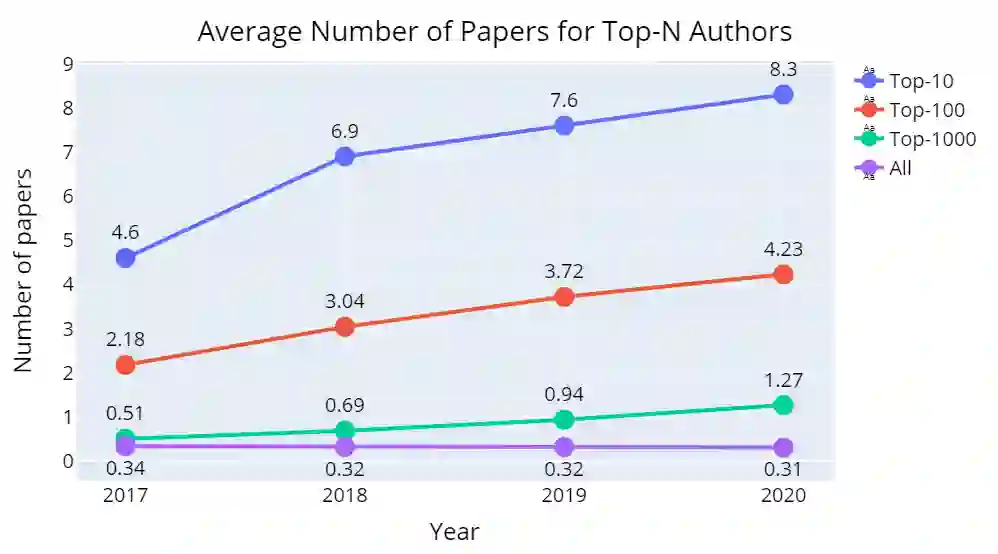

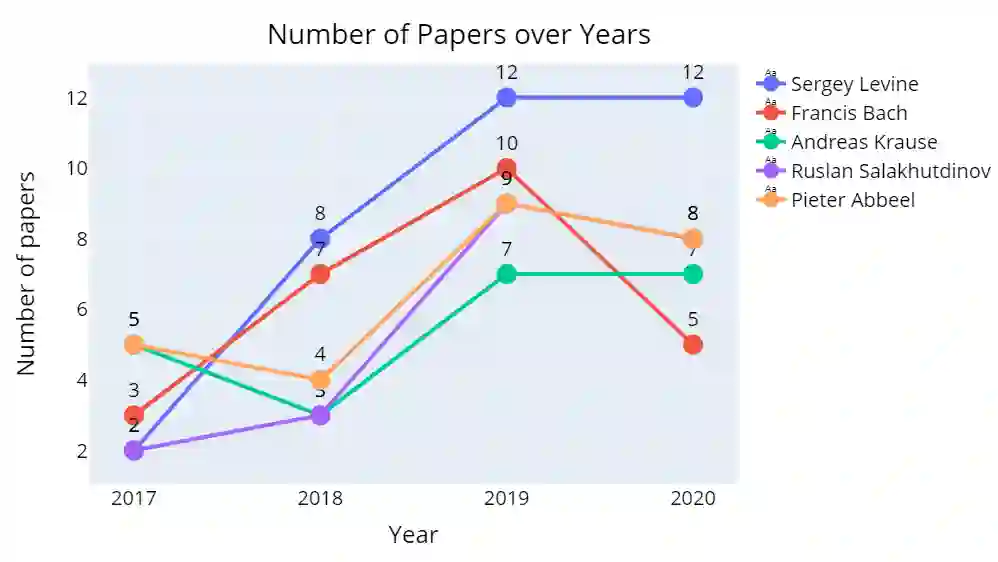

每年排名前10位的作者发表的论文数量在4年中翻了一番,从2017年的平均4.6篇增加到2020年的平均8.3篇。

每年排名前10位的作者发表的论文数量在4年中翻了一番,从2017年的平均4.6篇增加到2020年的平均8.3篇。

他们拥有

大量接受论文的主要原因是与更多学者合作。例如,Sergey Levine到2020年拥有来自8个分支机构的35位合著者。

他们拥有

大量接受论文的主要原因是与更多学者合作。例如,Sergey Levine到2020年拥有来自8个分支机构的35位合著者。

4

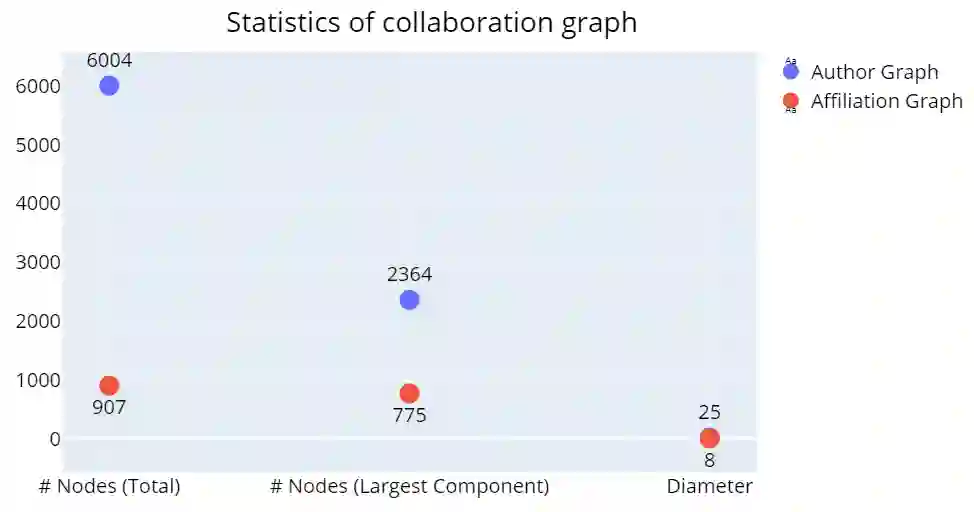

合作

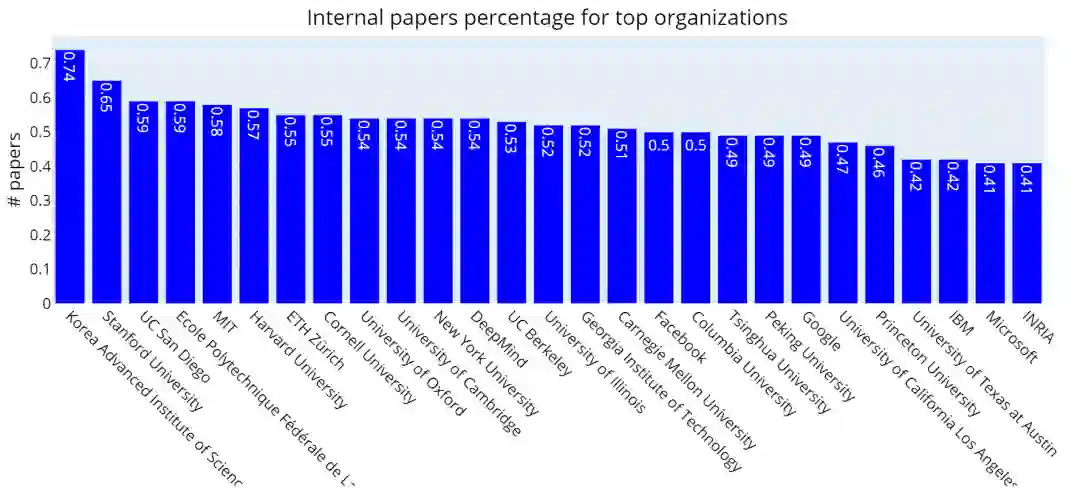

Top机构

的内部协作量相差很大:从KAIST的74%(KAIST的每篇论文大约有四分之三的作者来自KAIST)到Microsoft的41%。

Top机构

的内部协作量相差很大:从KAIST的74%(KAIST的每篇论文大约有四分之三的作者来自KAIST)到Microsoft的41%。

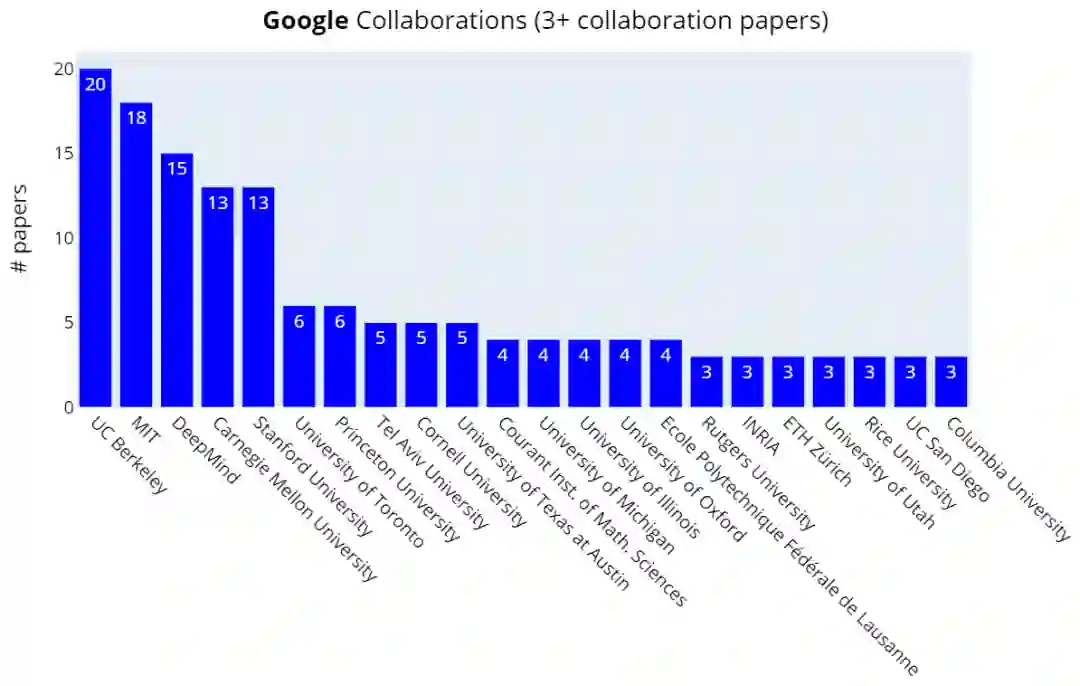

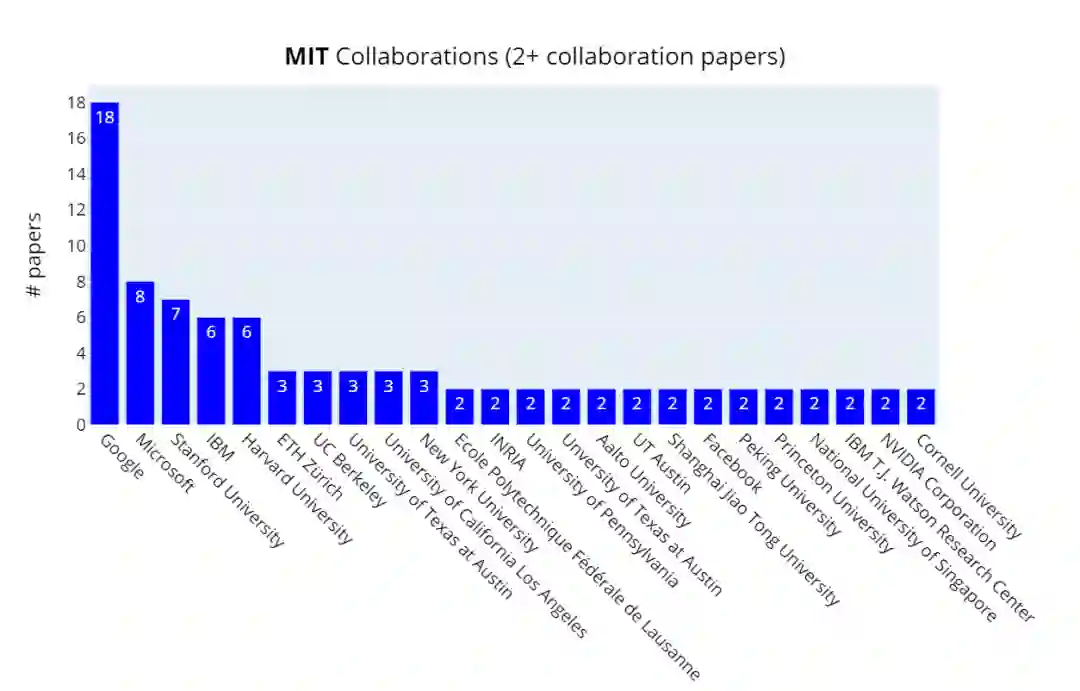

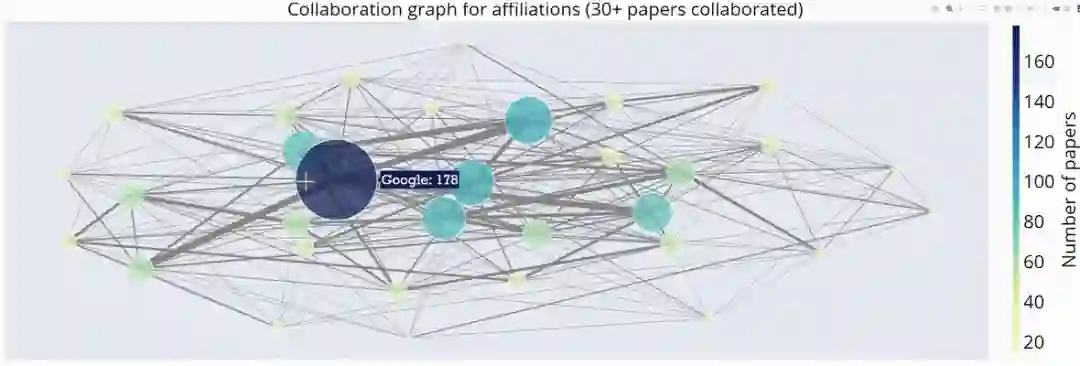

值得注意的是,

谷歌并未与其他工业公司(DeepMind除外)合作发表论文,而MIT与世界各地的工业界和学术界都有合作。

值得注意的是,

谷歌并未与其他工业公司(DeepMind除外)合作发表论文,而MIT与世界各地的工业界和学术界都有合作。

上图中的子图是互相连接的,每个节点大小等于机构的发表论文数,边的粗细等于两个机构之间的合著作者数。

5

国家

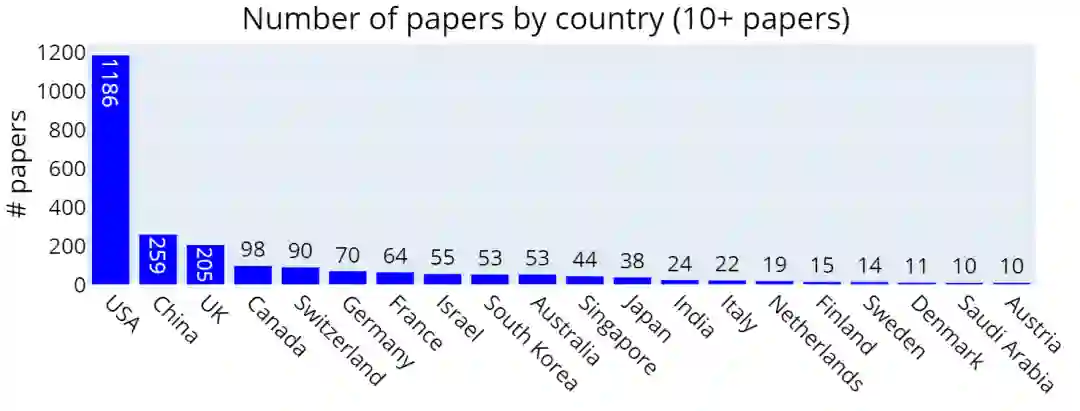

现在让我们考虑一下不同国家的表现。我将机构总部所在国家作为论文从属的国家。虽然这可能会将个别论文归于“错误的”国家,但类似于ICML 2020的分析,结果应该非常接近现实(由于大学关联的是单个国家,而大学发表的论文远远多于企业)。

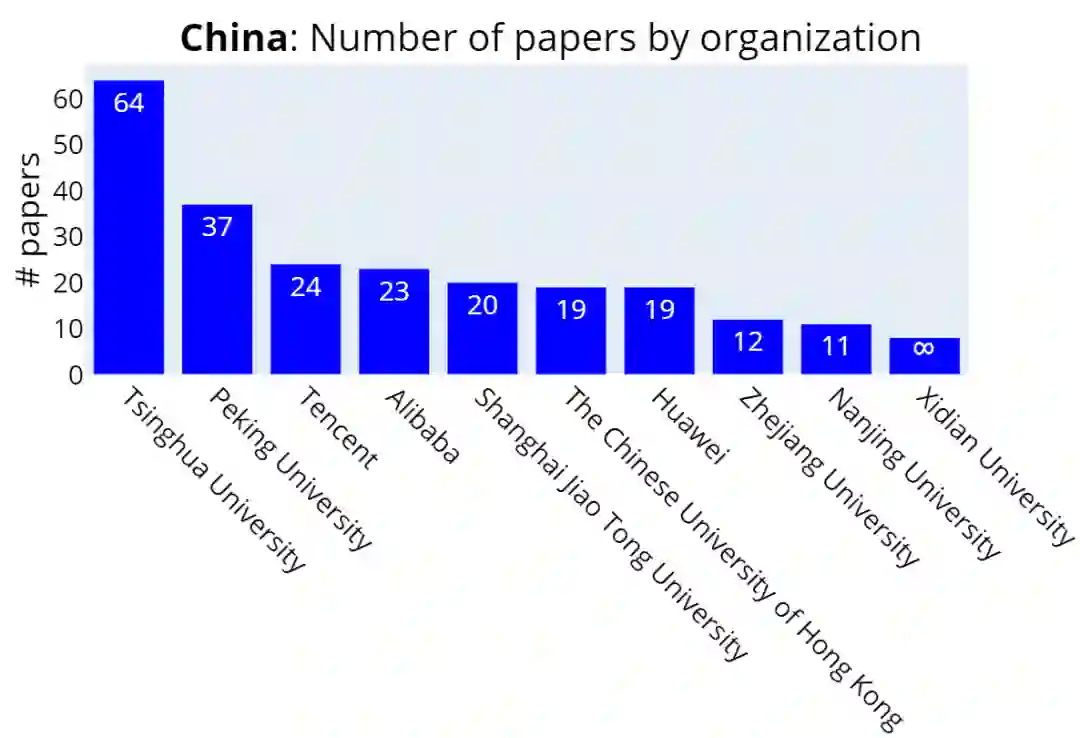

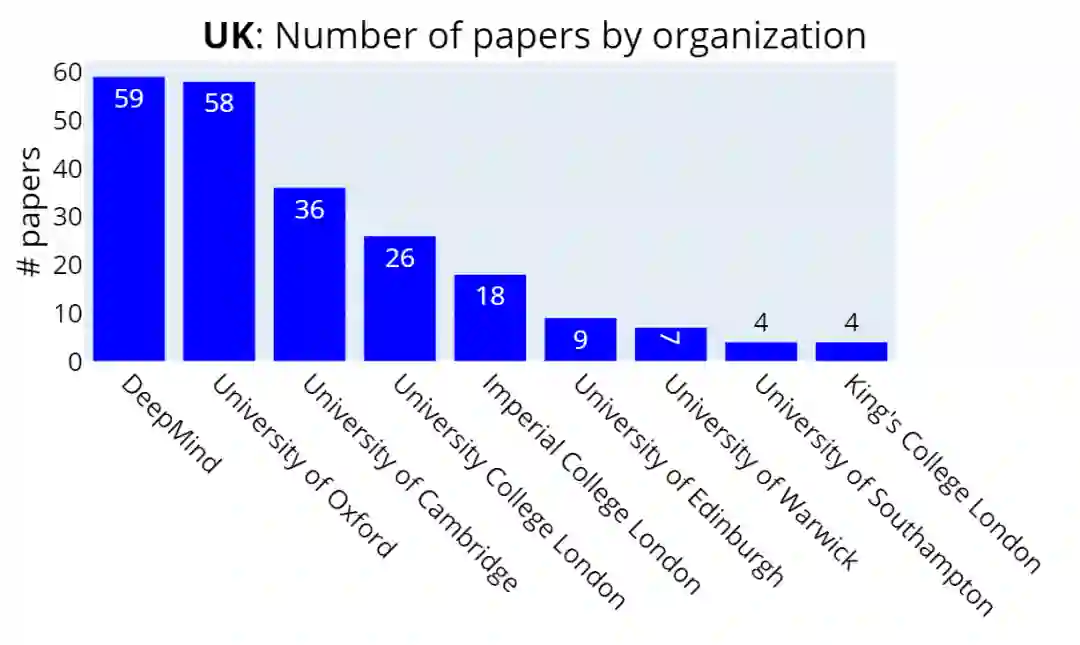

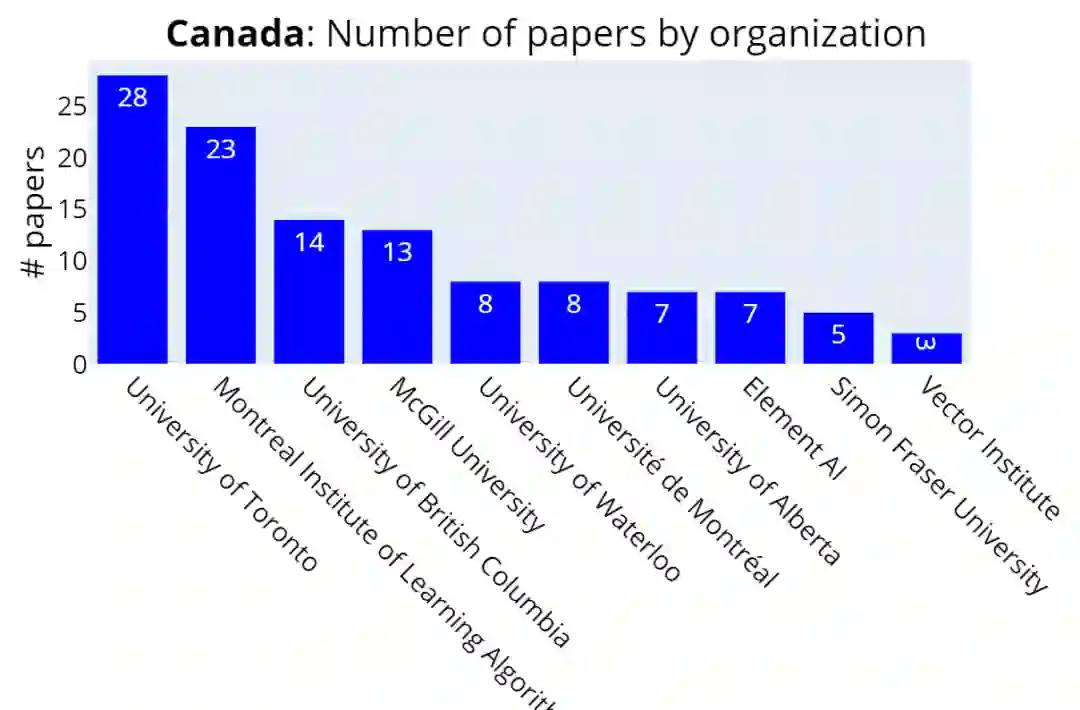

毫不奇怪,美国再次登上了榜首,参与了一半以上的论文。中国领先英国,位居第二。

毫不奇怪,美国再次登上了榜首,参与了一半以上的论文。中国领先英国,位居第二。

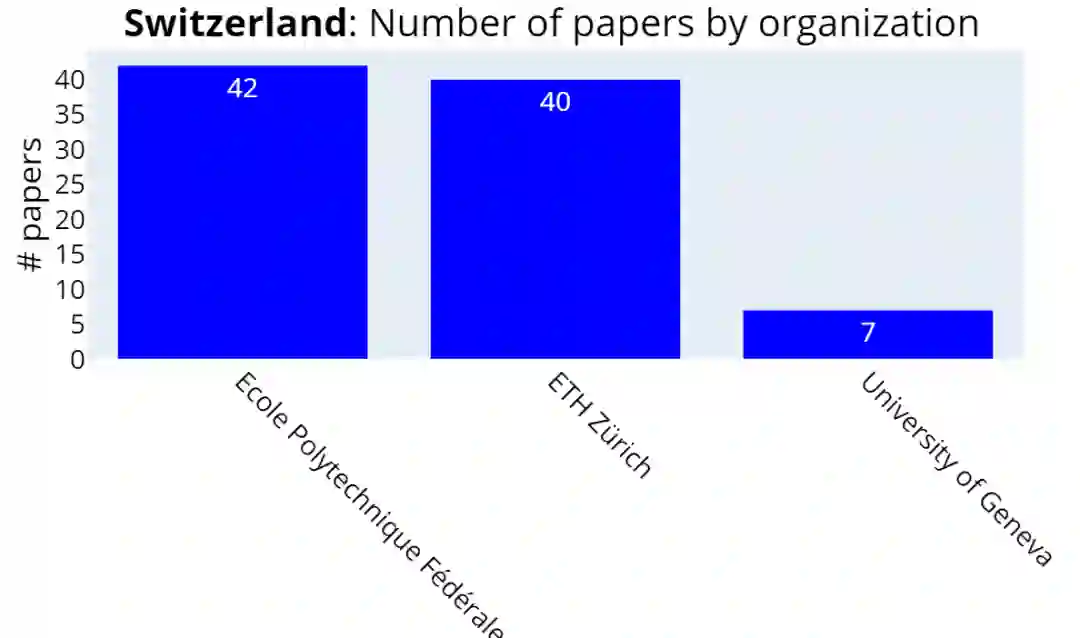

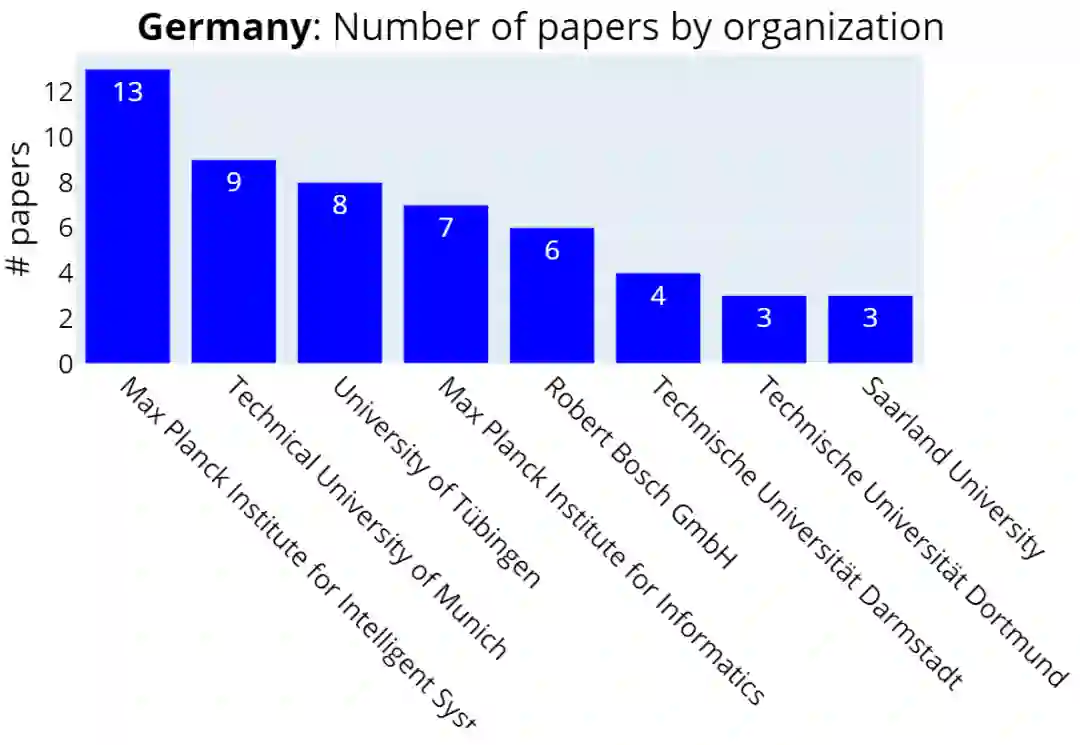

除了美国和中国(排名靠前的有多家企业)以外,其他国家/地区的主要发表机构仍是学术机构和大学。

除了美国和中国(排名靠前的有多家企业)以外,其他国家/地区的主要发表机构仍是学术机构和大学。

6

结论

点击阅读原文,直达NeurIPS小组~

登录查看更多

相关内容

神经信息处理系统年会(Annual Conference on Neural Information Processing Systems)的目的是促进有关神经信息处理系统生物学,技术,数学和理论方面的研究交流。核心重点是在同行会议上介绍和讨论的同行评审新颖研究,以及各自领域的领导人邀请的演讲。在周日的世博会上,我们的顶级行业赞助商将就具有学术意义的主题进行讲座,小组讨论,演示和研讨会。星期一是教程,涵盖了当前的问询,亲和力小组会议以及开幕式演讲和招待会的广泛背景。一般会议在星期二至星期四举行,包括演讲,海报和示范。

官网地址:http://dblp.uni-trier.de/db/conf/nips/

Arxiv

0+阅读 · 2020年11月26日