重磅 | 清华刘洋与邓力合著338页新书《Deep Learning in NLP》(附下载)

来源:专知

本文约5800字,建议阅读10+分钟。

本书系统介绍DL在NLP常见问题中的应用,是目前研究领域最新、最全面的综述。

[ 导读 ]邓力博士及刘洋博士等人合著的 Deep Learning in Natural Language Processing 一书系统介绍深度学习在 NLP 常见问题中的应用,而且是目前对此方面研究最新、最全面的综述。 本书还对 NLP 未来发展的研究方向进行了探讨,包括神经符号整合框架、基于记忆的模型、先验知识融合以及深度学习范式(如无监督学习、生成式学习、多模学习、多任务学习和元学习等)。

后台回复“181110” 获取本书下载链接

图书介绍

本书由全球知名的 Deep Learning 和 NLP 专家邓力博士领导的一组最活跃的研究人员撰写,全面介绍了深度学习解决 NLP 中的基本问题,而且是目前对此方面研究最新、最全面的综述。此外,面对高质量和前沿教科书和研究参考文献的需求急剧上升的今天,本书的出版是对 NLP 中深度学习应用方面的巨大进步所作出的迅速反应。本书为各行各业从业人员提供了一个独特的参考指南,特别对于互联网和人工智能创业领域,NLP 技术正在成为一个关键的推动因素和核心竞争因素。

—— 张宏江,前金山软件 CEO

Source Code Capital 创始人

本书提供了深度学习在自然语言处理中的一个全面介绍。它由一群经验丰富的深度学习和自然语言处理专家写成,并涵盖了NLP领域中的绝大部分任务。这本书结构清晰,详细介绍了包含主流应用到最新的深度学习技术,并阐述了它们的局限性以及未来的发展方向。 鉴于本书自成体系,精心的算法介绍,以及详尽的案例说明,这本书向那些正在从事关于深度学习自然语言处理工作和研究人员提供了宝贵的指导。

—— 王海峰,百度副总裁

前ACL主席

本书主要为大家全面呈现了深度学习在 NLP 领域应用的最新进展,并且特别介绍了卓有成效地应用了深度学习的 NLP 相关领域,比如语音翻译、对话系统、词法分析、语法分析、知识图谱、机器翻译、问题回答、情绪分析、社会计算以及(来自图像的)自然语言生成。本书所面向的读者包含有计算背景的研究生、博士生、教师、工业研究者,以及对 NLP 领域深度学习感兴趣的任何人。

—— 主编邓力

本书由全球知名的 Deep Learning 和 NLP 专家邓力博士领导国内外一篇活跃的NLP研究人员撰写全面介绍了深度学习解决 NLP 中的基本问题。

Chapter 1: 深度学习与自然语言简介(邓力,刘洋)A Joint Introduction to Natural Language Processing and to Deep Learning

Chapter 2: 对话理解系统中的深度学习(Gokhan Tur, Asli Celikyilmaz,何晓冬, Dilek Hakkani-TÜr, 邓力)Deep Learning in Conversational Language Understanding

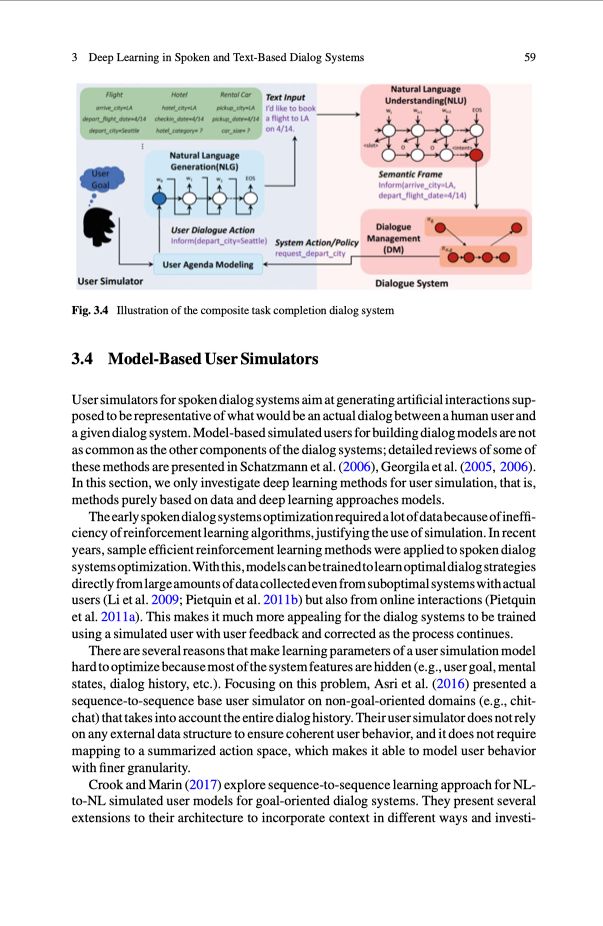

Chapter 3: 语音与文本对话系统中的深度学习((Asli Celikyilmaz, 邓力, and Dilek Hakkani-TÜr))Deep Learning in Spoken and Text-based Dialogue Systems

Chapter 4: 语法与词法分析中的深度学习(车万翔 张岳)Deep Learning in Lexical Analysis and Parsing

Chapter 5: 知识图谱中的深度学习(刘知远,韩先培)Deep Learning in Knowledge Graph

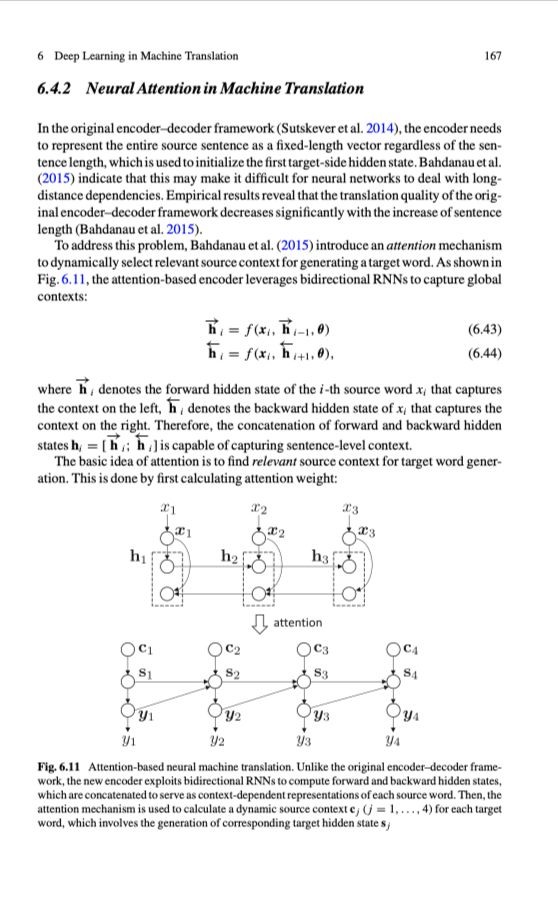

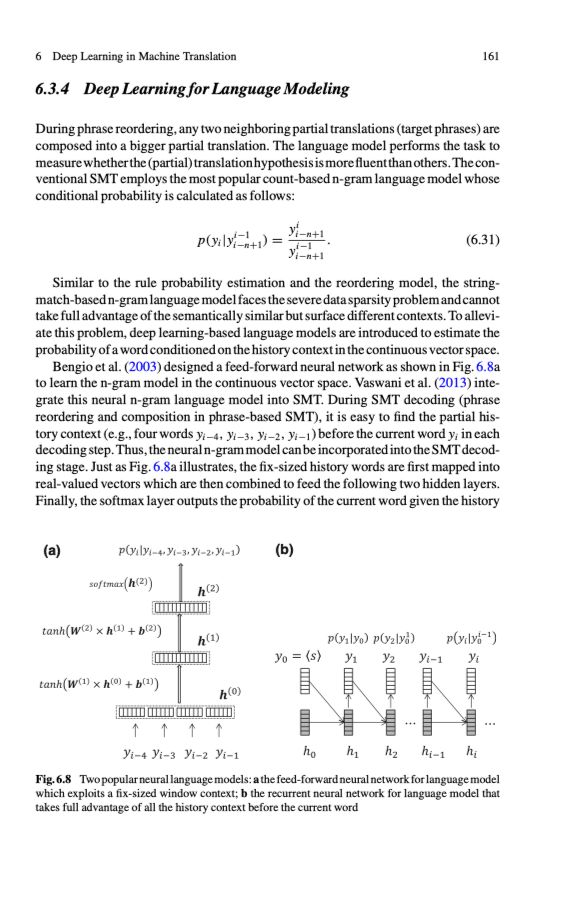

Chapter 6: 机器学习中的深度学习(刘洋,张家俊)Deep Learning in Machine Translation

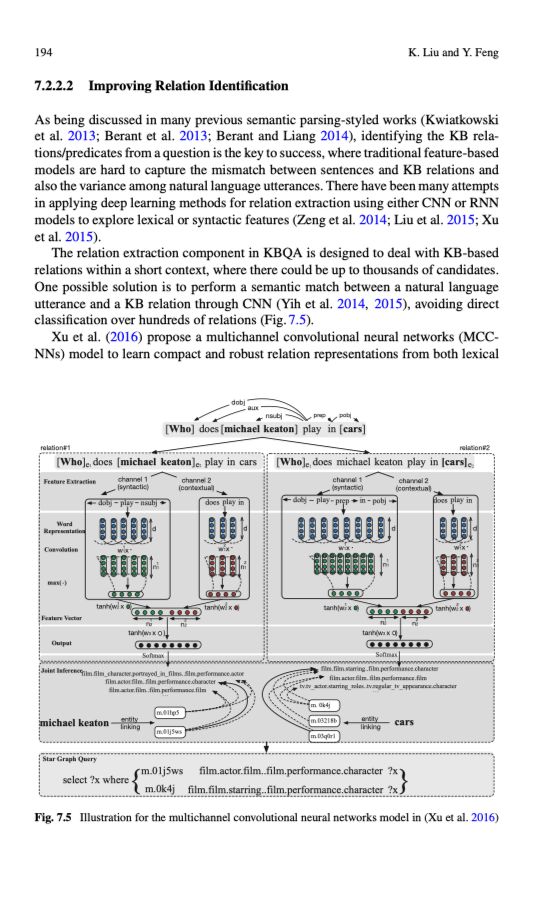

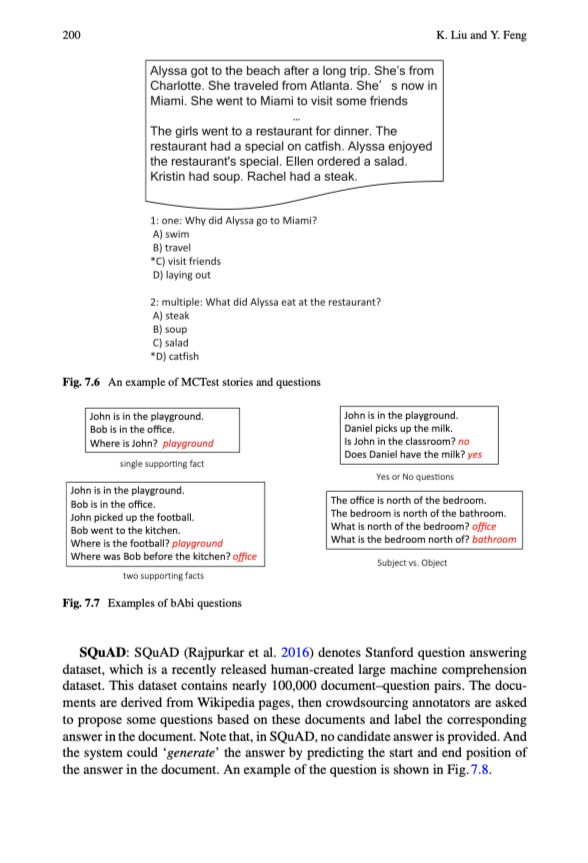

Chapter 7: 问答系统中的深度学习(刘康,冯岩松)Deep Learning in Question Answering

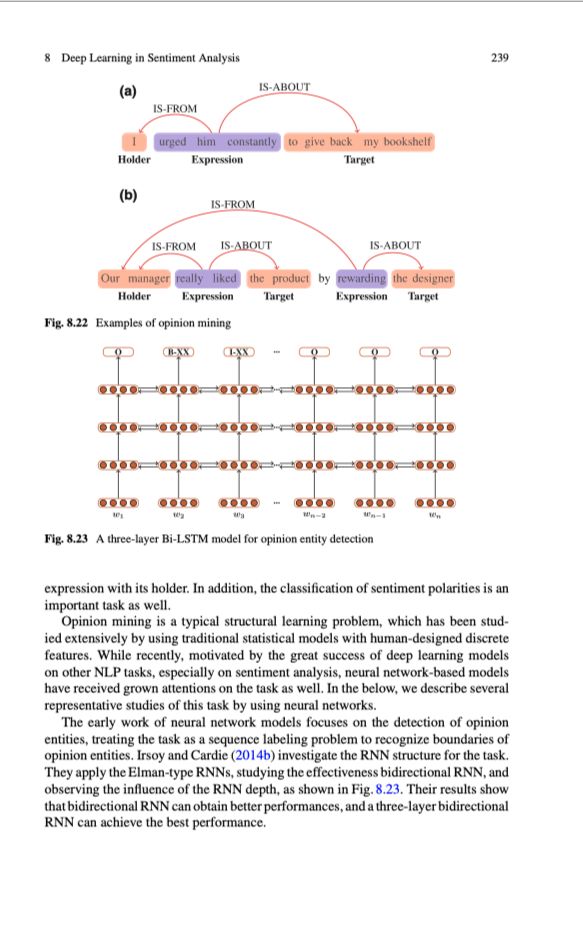

Chapter 8: 情感分析中的深度学习(唐都钰,张梅山)Deep Learning in Sentiment Analysis

Chapter 9: 社交计算中的深度学习(赵鑫,李晨亮)Deep Learning in Social Com-puting

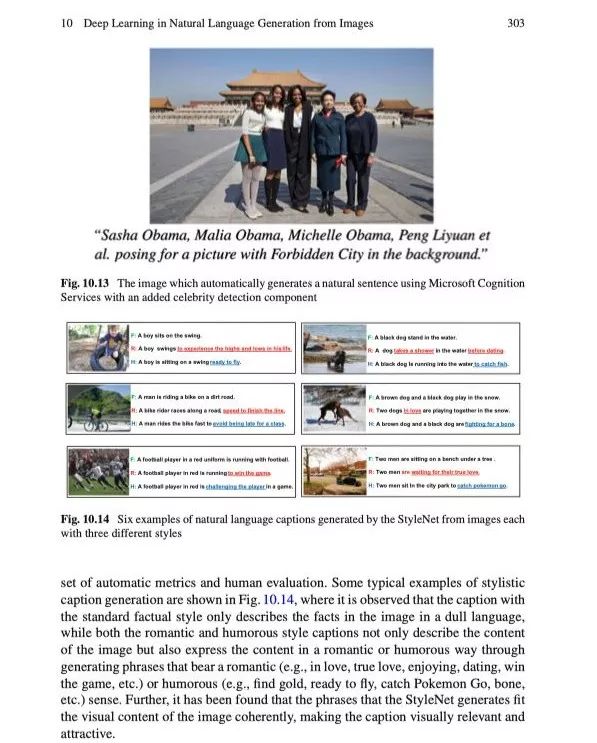

Chapter 10: 看图说话中的深度学习(何晓冬,邓力)Deep Learning in Natural Language Generation from Images

Chapter 11: 后记(邓力,刘洋)Epilogue

主要内容

深度学习 (Deep Learning) 是一个处理端到端学习和信息提炼所需的大量计算和数据的有力工具。因为深度学习具有更复杂的分布式表示、更精细的功能块模块化设计(如:层级注意力机制)和基于梯度的高效学习方法,它已经成为解决越来越多自然语言处理 Natural language processing (NLP) 问题的主要范式和先进方法。深度学习的新思路与 NLP存在着微妙的联系。

首先,尽管符号处理在人类认知领域发展较晚,但它具有高效逻辑推理能力和易于解释两个特点,这在许多 NLP 应用领域均不可或缺。可微分编程使用类似于张量积的编码方式实现神经网络和语言结构的统一表示,为复杂、灵活和动态的结构化神经网络带来了高效的学习效率,这是符号处理和神经网络两大领域的福音。

其次,正如本书各章中所证实: NLP 模型的动态特性正在逐渐被大众所接受。

一方面, NLP 究对象的本质是语言和文字,它们本身就有维度变化大的特点,比如文档、句子或词汇的(输入)长度及结构是动态变化的。另一方面,在支持动态变化的神经网络结构中,目前的深度学习框架已经可以实现可变维度的文本输入。语言离散性的特点使它不能利用可微分编程实现端到端的学习,但通过一类基于模型逼近的松弛技术有望能够解决这个难题,这为使用自然出现的语言数据来提升机器学习和 NLP 提供了更多的可能性。

在本书中我们汇总了大多数深度学习方法应用于 NLP 领域的最新进展(包括2017下半年的最新研究进展)。在此基础上,我们拓展了关于 NLP 前沿研究领域的五个发展方向:

自然语言重组的泛化

NLP 的无监督学习

NLP 的强化学习

NLP 的元学习

基于深度学习的 NLP 系统的神经符号整合和可解释性

近期有很多关于深度学习(尤其是 NLP 方面)拓展到更为通用领域的热点话题,在全书的最后一部分,我们对此进行简要概述。泛化的本质是将深度神经网络(如:参数化功能块的计算图表)从静态转为动态。这意味着泛化可以使由许多可微分模型组成的网络架构以数据相关的方式进行实时创建。正如本书很多章节中使用逻辑表达式、条件、赋值和循环等进行程序化编程,在可微分编程模型中,涉及到存储、注意、堆栈、队列和指针模块的深度神经网络架构亦如此实现。

实际上,当前的深度学习框架(如: PyTorch, TensorFlow, Chainer, MXNet, CNTK等)更要追求模型的灵活性,因为一旦高效的编译器被开发出来,我们将需采用一个全新的软件实现方式。以循环和条件判断为主的传统编程逻辑将被淘汰,取而代之的是由神经网络实现的参数化功能模块的组装图表。其中的关键技术在于,基于模型的可微分性,使用高效的梯度优化方法,通过端到端的反向传播学习从数据中自动训练出组装图表中的所有参数,比如神经网络的权重以及定义网络非线性和存储模块的参数。

总之,我们相信在不久的将来,以广义深度学习或可微分编程框架所创建的更加强大、更加灵活、更加先进的学习架构可以解决本书中所列举的 NLP 前沿研究领域的遗留问题。不止于本书中所提及的研究成果,新的成就将会像雨后春笋般涌现,这一切都将会使我们越来越接近通用人工智能实现的日子。那时, NLP 将会成为通用人工智能的一个重要组成部分呈现在大家面前。

作者介绍

主编:邓力博士 (人工智能科学家)

邓力,2017年5月至今任对冲基金公司 Citadel 首席人工智能官(Chief Artificial-Intelligence Officer)。之前任微软人工智能首席科学家。邓力在2009 年就同 Geoffrey Hinton 教授合作,首次提出并将深度神经网络应用到大规模语言识别中,显著提高了机器对语音的识别率,极大推动了人机交互领域的发展与进步。

目前,邓力的研究方向主要为应用于大数据、语音、文本、图像和多模态处理的深度学习和机器智能方法,以及人工智能和深度学习在金融领域的应用。在语音、NLP、大数据分析、企业智能、互联网搜索、机器智能、深度学习等领域,邓力曾获 70 多项美国或国际专利。

同时,他还获得过 IEEE、国际言语通讯协会、美国声学协会、亚太信号与信息处理协会、微软等组织授予的多项荣誉。2015 年,凭借在深度学习与自动语音识别方向做出的杰出贡献,邓力获 IEEE 技术成就奖。

主编:刘洋博士

刘洋,清华大学计算机科学与技术系长聘副教授、博士生导师、智能技术与系统实验室主任,国家优秀青年基金获得者。研究方向是自然语言处理,在自然语言处理和人工智能领域重要国际刊物Computational Linguistics和国际会议ACL、EMNLP、IJCAI和AAAI上发表50余篇论文,获ACL 2017杰出论文奖和ACL 2006优秀亚洲自然语言处理论文奖。

承担10余项国家自然科学基金、国家重点研发计划、国家863计划、国家科技支撑计划和国际合作项目,2015年获国家自然科学基金优秀青年项目资助。获得2015年国家科技进步二等奖、2014年中国电子学会科学技术奖科技进步类一等奖、2009年北京市科学技术奖二等奖和2014年中国中文信息学会钱伟长中文信息处理科学技术奖汉王青年创新奖一等奖等多项科技奖励。

担任或曾担任国际计算语言学学会亚太分部执委会委员、SIGHAN Information Officer、中国中文信息学会青年工作委员会主任兼计算语言学专业委员会秘书长、Computational Linguistics编委、ACM TALLIP副编辑、ACL 2015组织委员会共同主席、ACL 2014讲习班共同主席、ACL 2017/2018与EMNLP 2016/2018程序委员会机器翻译领域共同主席、IJCAI 2016/2018和AAAI 2019资深程序委员会委员。

个人主页:

http://nlp.csai.tsinghua.edu.cn/~ly/index_cn.html

主要参与作者:

何晓东

何晓东博士是京东AI研究院常务副院长、深度学习及语音和语言实验室主任。他于 1996 年获得清华大学(北京)学士学位, 1999 年获得中国科学院(北京)硕士学位, 并于2003获哥伦比亚大学博士学位。他的研究兴趣主要集中在人工智能领域,包括深度学习,自然语言,计算机视觉,语音, 信息检索和知识表示。

加入京东之前,何晓冬博士就职于美国微软雷德蒙德研究院,担任主任研究员(Principal Researcher)及深度学习技术中心(DLTC)负责人,同时在位于西雅图的华盛顿大学兼任教授、博士生导师。微软在2018年1月推出的人工智能绘画机器人正是出自何晓冬团队的作品。

车万翔

哈尔滨工业大学计算机学院副教授、博士生导师。斯坦福大学访问学者,合作导师Christopher Manning教授。现任中国中文信息学会计算语言学专业委员会委员、青年工作委员会副主任;中国计算机学会高级会员、YOCSEF哈尔滨主席。主要研究领域为自然语言处理,在ACL、EMNLP、AAAI、IJCAI等国内外高水平期刊和会议上发表学术论文40于篇,其中AAAI 2013年的文章获得了最佳论文提名奖,出版教材 2 部,译著 2 部。

目前承担国家自然科学基金、973等多项科研项目。负责研发的语言技术平台(LTP)已被600余家单位共享,提供的在线“语言云”服务已有用户1万余人,并授权给百度、腾讯、华为等公司使用。2009年,获CoNLL国际多语种句法和语义分析评测第1名。2016年获黑龙江省科技进步一等奖;2015和2016连续两年获得Google Focused Research Award(谷歌专注研究奖);2012年,获黑龙江省技术发明奖二等奖;2010年获钱伟长中文信息处理科学技术奖一等奖、首届汉王青年创新奖等多项奖励。

张岳

新加坡科技设计大学助理教授。获清华大学计算机科学与技术学士学位,牛津大学计算机科学硕士和博士学位。2012年加入新加坡科技设计大学之前,曾在英国剑桥大学担任博士后研究员。对自然语言处理、机器学习和人工智能有浓厚的研究兴趣,主要从事统计句法分析、文本生成、机器翻译、情感分析和股票市场分析的研究。任ACM/IEEE TALLIP副主编及COLING 2014、NAACL 2015、EMNLP 2015、ACL 2017和EMNLP 2017的程序委员会领域主席和IALP 2017的程序委员会主席。

刘知远

刘知远,清华大学计算机系副教授、博士生导师。主要研究方向为表示学习、知识图谱和社会计算。2011年获得清华大学博士学位,已在ACL、IJCAI、AAAI等人工智能领域的著名国际期刊和会议发表相关论文60余篇,Google Scholar统计引用超过2700次。承担多项国家自然科学基金。曾获清华大学优秀博士学位论文、中国人工智能学会优秀博士学位论文、清华大学优秀博士后、中文信息学会青年创新奖,入选中国科学青年人才托举工程、CCF-Intel青年学者提升计划。担任中文信息学会青年工作委员会执委、副主任,中文信息学会社会媒体处理专委会委员、秘书,SCI期刊Frontiers of Computer Science青年编委,ACL、COLING、IJCNLP领域主席。

韩先培

韩先培,博士,中国科学院软件研究所基础软件国家工程研究中心/计算机科学国家重点实验室副研究员。主要研究方向是信息抽取、知识库构建、语义计算以及智能问答系统。在ACL、SIGIR等重要国际会议发表论文20余篇。韩先培是中国中文信息学会会员,中国中文信息学会语言与知识计算专业委员会秘书长及中国中文信息学会青年工作委员会委员。

张家俊

张家俊于中科院自动化所获得博士学位,现任中科院自动化所模式识别国家重点实验室副研究员,中国科学院青年创新促进会会员。研究方向为自然语言处理、机器翻译、跨语言文本信息处理、深度学习等。现任人工智能学会青年工作委员会常务委员、中文信息学会计算语言学专委会和青年工作委员会委员。在国际著名期刊IEEE/ACM TASLP、IEEE Intelligent Systems、ACM TALLIP与国际重要会议AAAI、IJCAI、ACL、EMNLP、COLING等发表学术论文40余篇。曾获PACLIC-2009、NLPCC-2012(2017)和CWMT-2014最佳论文奖。2014年获中国中文信息学会“钱伟长中文信息处理科学技术奖”一等奖(排名第三)。2015年入选首届中国科协“青年人才托举工程”计划。

刘康

刘康,博士,现任中科院自动化所模式识别国家重点实验室副研究员,西安电子科技大学客座教授。研究领域包括信息抽取、网络挖掘、问答系统等,同时也涉及模式识别与机器学习方面的基础研究。在自然语言处理、知识工程等领域国际重要会议和期刊发表论文九十余篇(如TKDE、ACL、IJCAI、EMNLP、COLING、CIKM等),获得KDD CUP 2011 Track2 全球亚军,COLING 2014最佳论文奖,首届“CCF-腾讯犀牛鸟基金卓越奖”、2014年度中国中文信息学会“钱伟长中文信息处理科学技术奖-汉王青年创新一等奖”、2015、2016 Google Focused Research Award等。

冯岩松

冯岩松,北京大学计算机科学与技术研究所讲师。2011年毕业于英国爱丁堡大学,获得信息科学博士学位。主要研究方向包括自然语言处理、信息抽取、智能问答以及机器学习在自然语言处理中的应用;研究小组已连续三年在面向结构化知识库的知识问答评测QALD中获得第一名;相关工作已发表在TPAMI、ACL、EMNLP等主流期刊与会议上。作为项目负责人或课题骨干已承担多项国家自然科学基金及科技部863计划项目。分别在 2014 和 2015 年获得 IBM Faculty Award。

唐都钰

唐都钰,微软亚洲研究院自然语言计算组研究员,主要从事包括智能问答、语义理解、常识推理等在内的自然语言处理基础研究。唐都钰博士论文题目为《基于表示学习的文本情感分析研究》获2016年中国中文信息学会优秀博士学位论文奖。

张梅山

张梅山,新加坡科技与设计大学,博士后研究员。张梅山博士分别于2004年、2008年和2014年获得中国地质大学(武汉)物理学学士、中科院软件所计算机应用技术硕士和哈尔滨工业大学计算机应用技术博士学位,目前任职新加坡科技与设计大学博士后研究员。近年来发表各类论文23篇,其中,AAAI、ACL、EMNLP、COLING等领域顶级会议论文11篇。目前的主要研究兴趣为自然语言处理、情感分析和深度学习。

赵鑫

赵鑫,中国人民大学信息学院副教授,近五年内在国内外著名学术期刊与会议上发表论文近60篇,其中包括信息检索领域顶级学术期刊ACM TOIS和学术会议SIGIR、数据挖掘领域顶级学术期刊IEEE TKDE/ACM TKDD和学术会议SIGKDD、自然语言处理顶级会议ACL/EMNLP/COLING。

所发表的学术论文取得了一定的关注度,据Google Scholar统计(搜索 Wayne Xin Zhao),已发表论文共计被引用近1800次。担任多个重要的国际会议或者期刊评审。目前承担国家自然科学基金青年项目一项和北京市自然科学基金面上项目一项,以及横向项目多项。

李晨亮

李晨亮,男,博士,副教授, 硕士生导师,2013年毕业于新加坡南洋理工大学计算机工程学院,获博士学位。同年由武汉大学计算机学院引进,获得优秀青年骨干教师启动资金。2015年入选武汉大学珞珈青年学者。研究兴趣包括信息检索、数据挖掘(文本挖掘)、自然语言处理、机器学习和社交媒体分析。

其主要科研成果已先后发表在国际顶级学术期刊和会议上;担任中国中文信息学会青年工作委员会委员、社交媒体专委会委员、信息检索专委会委员。作为骨干成员参与新加坡教育部科学基金项目1项,新加坡国防部科技项目1项。2016年指导硕士生在CCF-A类会议SIGIR2016上发表长文论文一篇,并获大会最佳学生论文提名奖(Best Student Paper Award Honorable Mention)

参考:

https://mp.weixin.qq.com/s/5A1L_DCOMvfNDwnTd95fug

https://mp.weixin.qq.com/s/ai8cnrwAXr3m1CWRc8BDVw

https://www.springer.com/gp/book/9789811052088

部分内容

后台回复“181110” 获取本书下载链接

参考链接:

https://www.springer.com/gp/book/9789811052088