图灵奖得主Yann LeCun万字访谈:DNN“史前文明”、炼金术及新的寒冬

来源:数据实战派

本文约10349字,建议阅读10分钟

本文介

绍了 Yann LeCun 对深度学习的发展历史、关键问题的解决方案(特别是自监督学习)、Facebook 的 AI 研究,以及对人工智能未来发展的一些看法。

Yann LeCun,现任 Facebook 副总裁兼首席 AI 科学家,纽约大学教授,曾在 Facebook 内领导开启了 AI 研究,并领导建设了纽约大学的数据科学中心。Yann 以其在上世纪八九十年代率先将卷积神经网络(CNNs)用于图片处理而闻名,被认为是对深度学习理论发展构成重大影响的人物之一,也由此获得了计算机领域最高奖项图灵奖。

近日,斯坦福博士生 Andrey Kurenkov 与 Yann LeCun 进行了一次深度对话,主要涉及深度学习的发展历史、关键问题的解决方案(特别是自监督学习)、Facebook 的 AI 研究,以及对人工智能未来发展的一些看法,内容非常有启发性。作为 Facebook 的首席 AI 科学家, Yann LeCun 希望在自己退休前,能够看到机器实现猫狗级别的智能。

深度神经网络不为人知的“史前文明”

1、在 CNNs 和深度学习真正出现之前,您是怎样注意到 AI 领域,并开始对它的探索和研究?

Yann LeCun:我一直都对各种科学和物理学,尤其天体物理学,抱有兴趣。我发现那些有关智慧或智能的问题真的很引人入胜,比如智慧是怎样在人类和动物身上出现的。

老实说,我对很多问题都很感兴趣,但我发自内心地认为我更像是个工程师,我喜欢构建各种各样的东西,所以在上大学时我选学了工程学。但也正是在我学习工程学期间,我发现相比常规的工程学我更喜欢做科研。比如我经常会思考很多有关‘智能’的问题,并深信‘学习’是‘智能’的关键组成部分。

我当时恰巧读到了几本谈及机器学习这一概念的书,那会这类概念还没有‘机器学习’这个专有名词,而我读的其中一本书其实也是一本哲学书。

那本哲学书主要是关于发生在上世纪 70 年代末的一场辩论,辩题为“人类的语言能力究竟是天生的还是后天培养的”,辩论的双方为著名语言学家 Noam Chomsky 和著名发展心理学家 Jean Piaget。

Piaget 主张人的语言能力是后天习得,站在 Piaget 一边的还有 MIT 的 Seymour Papert,他在论证中提到了感知器(Perceptron)的概念,并认为机器很明显具备能学习复杂概念的能力。我是通过阅读这本书,得知了“原来人们以前就有思考过机器是否能学习的问题”,并深深的被这一问题所吸引。

大概是在我大二或者大三的时候,我开始大量阅读相关的书籍和资料,但发现这一领域内的文献几乎在上世纪六十年代末戛然而止了。

Papert 应该是要为此负部分责任的,毕竟他写了本书来终结这一问题。

那本书写的也蛮好的,书名为 Perceptron ,由 Papert 和 Marvin Minsky 共同撰写。然后到了上世纪八十年代初期,逻辑类系统开始在 AI 领域内兴起,或许是因为我比较懒,或许是我对自己的能力和看法太过自信,我当时曾认为这是个错误的方向,因为其中并不包含学习,而如果没有学习,我们又如何能构建智能呢,所以,我当时不认为人们能通过工程设计来设计出一个智能,觉得人工智能更应该是一个机器不停地在学习并自己构建自己。

那会我对‘自洽系统’类的概念特别感兴趣。关于神经网络,我知道日本有一些相关的研究,后来我也是在那些研究的基础上继续进行研究,但当时我并不知道美国也有一些人在研究此事,比如 Geoff Hinton,Terry Sejnowski,James McClelland 和 David Rumelhart。后来我跟他们都有接触,并开始了我的毕业项目,当时找不到能做我项目导师的人,因为谁对这方面的内容都没有懂很多。

那段时间真的是有点单打独斗的感觉,而这也是我 AI 领域研究的起点。

2、所以,你是从 AI 领域最早的发展里程碑之一——Perceptron 的概念中受到启发,并在上世纪八十年代发现没人在做‘学习机器’的情况下,想要试一试看行不行?

Yann LeCun:当时,我跟巴黎的一个小的独立实验室取得了联系,那个实验室并非一个正规的实验室,而是一群在大学里有职位的人聚在一起,构思一种他们称为automaton networks(自动机网络)的设想的场所。

自动机网络,指的是能由大量基本构成单位间的交互导致复杂现象的概念,与我们现在所熟知的神经网络异曲同工。而因为我们都对‘学习机器’有着浓厚的兴趣,所以他们帮我推荐了一些研究生学院之类的资源。

3、这些是在上世纪八十年代发生的事。八十年代末时Backpropogation 兴起,在你毕业时,这对你来说是一件正在发生的事吗,还是你其实也参与到了其中?

Yann LeCun:是的,我是其中的一份子,我很早就意识到了关于学习机器的探讨在上世纪六十年代停止的原因,人们在寻找多层网络的构建准则,而他们最终徒劳而归,但我当时在某种意义上算是找到了这么一个“准则”在现在以“Target Prop”的名字被熟知,主要是说为每个运算节点逆流虚拟运算目标(Virtual Target)。由此,我们便可能构建一个多层网络。

比如,对于网络内的每个运算节点的结果,都可以通过解决“如果我想让最终结果是这样的,之前的运算节点应该取什么值”这一问题来获得,也就是从我们想要的结果出发,一层层地将运算目标逆流回每个运算节点,构建运算网络。我自己构建了这么一个网络,但那时的电脑还不能快速地运算乘法,所以这个网络由二元运算节点构成,仅处理加法运算。

不过我意识到,如果网络内的过程是连续的,我们就能逆流梯度而不是运算目标了,于是我将这一想法与经典算法里的一些理论联系了起来,比如上世纪六十年代的优化控制论(optimal control)。

而在我能有时间去将这种联系付诸实践并发表前,记得是 1985 年,在我刚发表了我的 Target Prop 算法那会,我遇到了 Geoff Hinton。他告诉我他也在做同样的事。

Geoff Hinton 能看到我的论文,是因为他在法国参加一个会议,我们在那里见了面,他告诉了我他正在做什么。他给我介绍他最近的工作内容的过程中,我经常能在他还没说完一个句子前,就帮他补全那个句子。我也因此受到了一些‘说教’,但也是由于我们的这次交谈,他后来为我提供了一个博士后机会。

4、我记得在我了解深度学习发展史的过程中,还惊讶于你在 1986 年发表那篇著名的 Backpropogation 算法前,就已经发表过在原理上类似的东西(Target Prop 算法),我记得是以法文发表的,感觉这可能是为何那篇论文并不怎么为人所知的原因。

Yann LeCun:是的,当时 Geoff Hinton 所在的那个会议是讲法语的。我的那篇 Target Prop 算法的论文写得很烂,很多部分都还很‘外行’,但它包含了‘逆流’的概念。

我于 1986 年发表第二篇论文(Backpropogation 算法)时,正好是在Rumelhart,Hinton 和 Williams 的那篇论文发表之前,但对的,我当时在那次会议上通过跟时 Geof f交谈得知了他正在做的事。

5、所以,尽管那篇 Target Prop 算法的论文并不是很为人所知,它帮你与时 Geoff 建立了联系,然后你们及其他许多人在后来推动了深度学习的发展。记得最早关于卷积神经网络的论文应该是上世纪八十年代末出现的,那么,卷积神经网络这一概念最早是什么时候进入你脑海的?因为你从八十年代初期就有了“认知元(Cognitron)”的概念。

Yann LeCun:其实还蛮早的,当时我将大量的空闲时间都用在了‘泡图书馆’上,阅读了大量上世纪六十年代关于 AI 的文献,也读了一些计算神经科学和理论神经科学的资料,比如 Eric Kandel 在合成适应(synthetic adaptation)上和 Hubel 及 Wiesel 在建筑视觉皮层(architectural visual cortex)上的研究。

从神经科学的研究中我了解到了认知元的概念,然后,我觉得在信号处理中这一概念也应该能通用才对,比如“信号过滤(Filtering)”就是一个卷积过程。

所以,如果我们想构建一个能‘感知’的神经网络,尤其是能‘感知视觉’的那种,这种构建网络所需的基础计算单元间的关联性,即在生物学中有所体现,也在数据处理中有所体现,同时也是基于图像信息本身的强局部相关性。而由于在统计学上数据都是差不多的,这种关联性随后也引出了各计算单元‘等比重’的概念。

这一在神经认知系统学里非常为人所熟知的概念,也在一篇早期的 Target Prop 算法论文中有被提及,记得应该是 Geoff Hinton 关于 TC 问题的一篇论文,里面呈现了关于这一概念的简单示例。

Geoff 同时也进行了一些与 TNN(可以看作是一种与时间挂钩的 CNN)有关的工作。在这里领域里有很多想法都涌现了出来,人们都在思考该怎么实现这么一种网络。

我博士毕业的约六个月前,那会我还在写我的博士毕业论文,我遇见了当时也正在修完他的工程学学位的 Leon Bottou,并发现他同样也想进行一些与神经网络有关的工作。我们于是一起搭建了一个神经网络模拟器,这个模拟器现在应该算是一个深度学习框架。

2000 年的时候,我们把这一系统命名为了 Lush 并开了源,它本质上是一个基于神经网络的数值预测引擎,虽然不是第一个,但它后来演变成了一个 Tensor 引擎。

我们是用一种前端语言写的这个程序,其实算是 Lisp 语言的解析器,因为当时像 Python 什么的这种还没出现,我们只能自己写一个语言出来。这个项目是在我博士毕业前开始的,然后我搬到了多伦多并完成了这个项目。

我最初想进行这个项目的原因是,我想构建一个条件网络(Conditional Net),我在我的博士论文中就已经谈到了这一概念。在这个网络被搭出来后,我有了一个有局部关联性的网络,但其运算节点的比重还不是相关的,所以它还不能算是一个能实现 Target Prop 的架构,但我当时想做的是实现一个 Target Prop 的架构,能实现循环网络(Recurrent Net)和条件网络,并最终实现 Shadow Weights。

我搬到多伦多后又在这个项目上忙了 6 个月,然后靠着这个网络实现了第一个条件网络,并在一个我自己收集的小数据集上进行了测试。后来在 1988 年底,在我加入贝尔实验室后不久,我在那里的一个包含数千个样本的数据集上也进行了测试,那在当时来说真的是很大的一个数据集了,然后在两个月内我就得到了当时无人能比的结果。”

6、所以你当时没有现在这些方便的库和工具,可以说是需要自己搭一个PyTorch 和 TensorFlow?

Yann LeCun:对,其实意外的是,现在的许多库都可以算是我当时自己写的那些东西的后代或衍生,比如 Torch,PyTorch,TensorFlow,Caffe 和 Caffe2。可以说现在的这些库中有很多都有受到我当时写的东西的启发。

我那会一直有这种想法,就是如果能把对象(Objects)在一张图上连起来,那么就能通过在这张图上倒着往回推自动微分(automatic differentiation),而这张图的背后则是一个 Tensor 引擎。如此操作,再将这个流程在项目中标准化,我们就得到了一个能调控网络的前端语言。

深度学习的正在进行时

1、自监督学习,这也是你之前有大量讨论过的一个概念。你在 2019 年跟 Lex Fridman 的一次访谈中有说,自监督学习目前虽然能在线性规划中能起作用,但在计算机视觉领域还不行。所以,现在你觉得自监督学习能在计算机视觉领域发挥些作用了吗?

Yann LeCun:现在,自监督学习确实能在计算机视觉领域里起到一些作用了。我的意思是,当下在计算机视觉领域内的自监督学习应用的发展上,有很多有趣的进展正在发生。虽然目前在计算机视觉领域里,自监督学习能生成的结果,还远比不上有监督学习能生成的结果。

但这主要是因为,在图像识别领域,我们有庞大的有标记的数据集,而在一些其它的领域里,比如语音识别,自监督学习已经能发挥决定性的作用,比如用一段只有 10 分钟长的有标记的语音数据就训练出一个语音识别系统。

但话说回来,将自监督学习用于计算机视觉领域的最大挑战,应该还是我们要如何让算法能通过自己看视频来自己学习。”

2、请您再回顾一下您是怎么定义自监督学习的,以及为什么您认为这个方向很有前途?

Yann LeCun:我在过去的五六年里就这个话题做了很多讲座。但简单来说,如果是用强化学习来训练一个系统,你只需要偶尔给机器一些反馈就行,而且这种反馈一般是以单个标量值的形式体现的。

从这个思路想的话,任何一个纯强化学习过程的复杂度都是高的吓人的,我们可能需要数万年的实时训练才能让算法学会一个东西,这在实际应用上是不现实的。

我知道最近有一篇由 DeepMind 那边有分量的人撰写的论文,而且 AlphaGo 的 David Silver 也曾公开表示说‘光是理论上自监督学习能为我们带来的奖励,就已经足够我们相信这一方向的前景了’,但我完全不这么认为,我认为这样的想法真的是大错特错,但现在看访谈的进度可能还不是时候深入讨论这一点。

当前在有监督学习中,我们只用给算法每个样本一点点数据就行,而无监督学习也会涉及有监督学习,但是用有监督学习来让算法学习如何从‘部分输入’推测输入的其它部分。这种推测也并非重构,因为它是基于对输入的不同部分之间的联系进行建模来实现的。

举例来说,我可以喂给算法一张图片的左半边和一张图片的右半边,然后算法能告诉我这两个半张图是否能组成一张图。还比如一个视频,我可以给算法该视频的初始部分,然后再给它一个后续部分,让它判断这个后续部分是否与前面的初始部分匹配。

如果一个算法能做到这些,那说明它已经抓住了分析对象之间的依存性,而如果它能在视频中看到一段不符合物理定律的运动轨迹,它能反馈出说那段轨迹不符合物理定律,这便是自监督学习的基础概念。其实就是以某种方式使用有监督学习,然后再让算法能从输入的部分信息判断剩余的输入信息。

因此,直到约一年前那会,或许还比这更早一些,我还是个生成模型(Generative Models)的忠实拥护者,这里我并不是指那些概率模型,而是那些真的能根据部分信息生成预测剩余信息的模型。

就比如刚才举过的视频分析的例子,你喂给算法一个片段,它能返回下一帧或者下几帧的图像。但在计算下几帧的图像时,有太多的可能都能与初始给定的片段相匹配,所以这里的问题在于该如何处理预测中的不确定性。

符合逻辑的表述不确定性的方法,是将可信的预测集合参数化为一个潜变量,而当我们改变这个潜变量时,输出就会在一个相应的集合上发生变化。

这种方式实际上表示的是预测的集合,而非某单个预测结果。举图像分析例子来说,这就好比是先喂给算法一个图像,然后再喂给它这张图像被扭曲后的版本,然后训练它从扭曲版推测原版,我们会需要通过一个能预测扭曲版本的编码器来运行这个算法,而如果我们喂给它除扭曲参数外的其它更多参数,它的表现可能也会有所提升,但事实证明这种方法的实际效果很不理想。

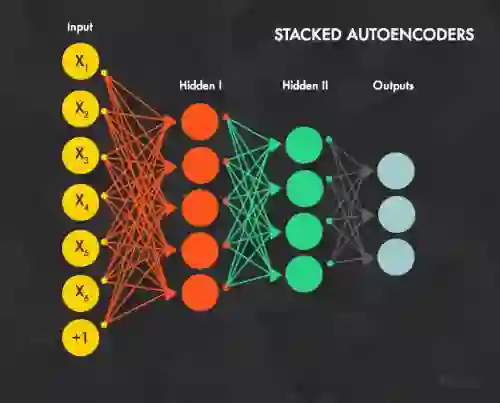

事实上,自动编码器、GANs,人们尝试了许多方法试图来寻找更好的表示图片信息的方式,但结果都不是很理想,或者说不够理想。

真正有效的方法是我和 Geoff 在上世纪九十年代初研究的东西,叫联合嵌入(Joint Embedding)或公制绘图(Metric Drawing)。

这种方法基本上就是你先准备两个神经网络,然后给它‘举个例子’,就是喂给它需要观察的信息和需要预测的信息,然后训练算法到能告诉你这两段信息是否兼容,也就是能生成一个预测信息。这还是简单的部分,难的部分是要确保它们对不同的输入能产生不同的输出。

有一种情况的专用名词是Collapse(崩溃),常规 Collapse 或者信息性Collapse,呈现出来就是两个神经网络会直接忽视你的输入,不停地输出一样的东西。但该怎样避免这一情况其实也很明显。

有两种方法能解决这个问题。

我在 1992 和 1993 年提出的一个方法是一篇关于 Siamese networks 的论文,这种方法基本上就是要求要有负的样本,然后我们给神经网络展示两张标记为不相似的图像,再以某种函数将两个输出向量推开。

Geoff Hinton 也提出了类似的想法,但他使用的是两个输出间信息上的一些度量,记得应该是他和 Becker 于上世纪九十年代初在 Nature 上发表的一篇论文,还挺有意思的。但后来这种想法渐渐被人遗忘了,知道 2000 年中旬那会才又被重新翻了出来。重新把它翻出来的人也是我和 Geoff,但我们当时因为一些原因并没有沟通我们在这方面上的工作,当时正好也是深度学习重新被人们拎出来的边缘,所以重新再过一遍那个想法应该是个好主意。

到了现在,一大堆不同的算法在过去的几年里被人们提了出来,其中就有名为对比性联合嵌入(Contrastive Joint Embedding)的方法,基于给算法两张标记为相似的图像,以及两张标记为不相似的图像,记得提出这种方法的一个研究小组还是 Geoff 在谷歌的团队,好像是叫 SimCLR。对,然后除了他们,还有其它很多人,Facebook,Pearl,MoCo,MoCo V2,Simsiam 等等。

但这种方法仍是一种基于对比的方法,个人来说我不喜欢它,因为它没法应对高维运算,原因是你很难在高维运算中将两个输出向量推开。”

3、所以,基本上这种方法的问题在于,我们有正向反馈的正数对,也有负向反馈的负数对,但负数对的组合可以有很多种?

Yann LeCun:对,有很多方法能让图像彼此不同。而且即使是嵌入(Embedded)类方法,一个空间怎样都会有一个具有维度的组成部分。因此,拿 SimCLR 来说,它就需要很长时间来训练,同时你还得辅以各种如 negative mining 的技巧。

所以后来有一些更好的方案冒了出来,有的纯粹是偶然,有的是有些人的直觉更好。举例来说,我们可以有一个预测器(Predictor),但两个神经网络的权重并不是均分的,而是通过使用运算的指数速度作为参数让其中一个变为另一个的‘慢速’版本。记得有好多人都发了论文,DeepMind ,BYOL 和 Bring Your Own Latent。基本上就是说我们不用非要负样本了,不通过对比性的方法也能确保算法对不同的输入能产生不同的输出。

4、最近还有很多关于深度学习正在变成炼金术的讨论,你之前在这方面的很多言论都很有意思,可有什么新想法?

Yann LeCun:记得这个话题是由 Eddie Rahimi 几年前在 Net Nerds 的一次演讲所引发的,当时他们赢得了 Test of Time 奖,声称深度学习是炼金术,机器学习中除深度学习外的其他方法才在理论上更合理,更容易理解。

当时我真的是有点被这种说法给激怒了,所以后来我跟他在各种社交平台上都有所交流,这些交流我个人认为也都是非常有趣和有建设性的交流和讨论。

我的论点是,历史上有很多技术发展快于理论的例子,因为事实上,人们通过理论来真正设计出一个什么有用的东西的情况是非常罕见的,更多的情况是一些东西在工程或者实践上率先发生了,然后相关的科学才想去寻找一个理论来解释它。

关于这个,最好的例子应该就是蒸汽机了。蒸汽机在 16 世纪末以各种各样的形式被发明了出来,然后在接下来的一个世纪内得到了发展,而用于解释蒸汽机工作原理的热力学则是直到 19 世纪初才逐渐变成我们今天所熟知的那个版本,这么看来的话,热力学这个理论实际上是花了大概一个世纪才追上了技术的脚步,解释了热力发动机的原理和局限。

这种例子在光学里也有,比如望远镜和显微镜就是在牛顿发现衍射定律前被发明出来的,而实际上发现衍射定律的人也并不是牛顿,而是Snailor,甚至也有人说阿拉伯世界在中世纪时也有类似的工作,但只是其表述方法有所不同。

总的来说,技术比理论先行,然后人们因为好奇才去探索背后原理的例子实在是太多太多了。在人们探索原理的过程中,那些通用的理论才被提了出来。

热力学和生物学就是所有东西的基础,类似那种科学里的科学。

所以,我想说的是,对于智能来说,什么才算是这种科学里的科学呢?另外,支持人工智能和自然智能的这种科学里的科学是否又一样呢?这个问题对于人工设计出来的学习过程和自然形成的学习过程也同样适用。答案是否会是经典的统计学习理论呢,还是一些与学习有关的理论呢,还是其他的什么东西?

5、这其实是个很难的问题。我觉得,我们一直想造出来一些能用的东西,比如我们其实已经在深度学习领域这么做了好多年,没人真的期待说神经网络背后有什么真正决定性的支撑理论?

Yann LeCun:也不能这么说,我们中有些人还是有这种愿景和期待的。

6、但之前也没有关于为什么神经网络配上庞大的随机数据集就能起作用,与此相关的理论也是最近才出现,或者说最近才开始出现。

Yann LeCun:现在肯定是已经出现了。其实我们早在上世纪九十年代初就已经知道了,只是当时没法真正的把它们以理论的形式真正写出来,但就这种现象来说,比如任何统计学教科书都会告诉你,让训练网络变大是属于过度参数化一个模型,根本不会起作用的,但在实践中却是,网络做的越大模型表现越好。

还有一种教科书里的说法是如果你你有一个 non-convex subjective function(非凸性的主体函数),那它永远也不会收敛,但事实上我们并不能确定这件事,而解决这个问题办法也是整一个更大的网络出来。

后来事实也证明,网络变大以后,局部最小值就不再是个问题了,系统总能找到一个最小值,虽然每次输出的结果不同,但由于它们本质上是一样的,所以我们也并不在乎。

人们开始尝试在理论上去理解这些现象,比如双重下降(double descent),就是你不断增加一个很小的神经网络的大小,总有一个点的测试误差不会变的更大,但这只是网络的大小正好与它所需解决的问题相匹配了,而如果我们有一个比需要大小大得多的神经网络,它不会对其他模型起作用,而范化误差(generalization error)也会下降。所以,大小是把双刃剑,而这与平常所有统计教科书里的内容都不符。

但这又是为什么呢?

我们直到最近才知道了其中的一些原因,很多人都选择不信,而这则体现了一些对启发式看待问题的方法非常重要的东西,那就是,能在理论上理解你在做什么是非常重要的,但能从直觉上理解你正在做的事要更为重要。

如果你限制自己仅用那些你在理论上能理解的模型,那基本上就是限制了自己,只是因为你还不能在理论上理解就不去碰很多东西,而我认为这基本上与自取灭亡无异。

所以,我们不应该只是因为有的东西理论上还解释不了,或者我们还理解不了就不做了。当然这种想法也会有一些不适用的时候,但那都是些非常普遍的道理。

上世纪九十年代中旬到 2010 年初的机器学习领域基本就是这样的,教科书上说过度参数化不会起作用,非凸函数不会起作用,但就像我所有的理论最后所证明的那样,它们就是能起作用。

当然,我们也要注意方法的简洁性,就是你不能随便整一些乱七八糟的东西,然后发现结果有了 0.2% 的提升就觉得“哦,我发了一个新方法”,这种程度的修修补补过多就不好了,结果就是你真的会变成个炼金术从业者。

新的寒冬已经不太可能降临?

1、我们意识到了深度学习是可行的,并且它在各个领域里的表现也都越来越好了,比如计算机视觉领域里的无监督学习应用。您作为 Facebook AI 研究所(FAIR)的主任,我很好奇,在学术研究之外,您觉得深度学习最令人兴奋的是什么?

Yann LeCun:首先要做一个更正,我已经不是 FAIR 的主任了,我现在是首席科学家,这意味着我不需要管理别人,能将时间都用在做自己的研究上,当然,我也会给公司里的各种团队提供各种研究项目上的建议,但我并不需要实际管理什么东西。

我当 FAIR 的主任当了三年半,强烈感受到的就是‘时间在流逝’,因为我还有很多想去研究的想法和东西,但 FAIR 的管理工作真的让我没有时间去做研究,这也是我换工作的一个决定性原因。

另一个主要原因其实也是因为我真的不擅长管理,我真的不想把生命和时间浪费在管理上,这种工作还是让适合的人来做比较好。

所以,现在 FAIR 的主任是 Joelle Pineau 和 Antoine Bordes,他们俩实际上是在分别领导 FAIR 的两个独立部分,这是因为 FAIR 其实最近进行了一次重组,分成了一个实验室部分,负责进行一些非常科研类型的研究,还有一个叫 FAIR XL 的部分,更多进行一些指定的工作。

实际上,我们很多的那种大项目都不一定是要以最终被应用为导向的,那都是些‘野心勃勃’的项目,需要很多资源的支持。

Facebook 在 FAIR 外其实还有一个叫“Facebook 应用 AI 研究所”的组织,他们更注重于说 AI 应该怎样在 Facebook 内部被应用起来。

而且在 Facebook AI 中也还有另外两个团队,一个是 AI Experience(AI 体验)团队,它基本上就是以 AI 技术为主导提出各种新的想法,设计各种新的产品,另一个是Responsible AI(负责任的 AI)团队,主要负责确保我们的AI工具是安全的、是公平的。

所以 Facebook 与 AI 相关的组织其实是由这四个分部构成的,一共大概一千多人,FAIR 本身仅有四五百人。

近年深度学习在 Facebook 里的应用可以说是突飞猛进,已经变成了公司不可分割的一部分,因为如果你突然把深度学习抽出来,不让用了,Facebook 这个公司基本上也就要运作不下去了。

这个现象还是很有意思的,谷歌,YouTube 等等,大家现在都是这样,以深度学习为主导,所有的内容和新闻推送都要被算法过一遍,分类垃圾邮件,翻译,OCR(光符识别,Optical Character Recognition)等等。基本上这些都是在靠深度学习在做了。

建立在深度学习之上的还有很多其他东西,但其本质依然是深度学习的使用,比如在 Facebook 和 Instagram上,你需要识别一张图片或者一段视频是不是一个恐怖组织或者极端组织的宣传内容,比如一些斩首视频和图片,你不想这些信息被传播,所以当算法没能识别出的时候,我们就会在发现时人工给这些视频或图片做标记,让算法能在以后识别出这种它以前不知道的模式。

Facebook 内其实是有大量资源都导向了这方面的工作的,而这也正是外界因为不知道,所以常常指责 Facebook 说 Facebook 没有做的那些它应该做的事。

这都是些很难解决的问题,而 AI,深度学习,正在帮我们解决它们。虽然我们达不到一个完美的程度,但对比之前我们在这些方面真的已经取得了很大的进步,比如检测识别仇恨言论。

三年前,还不是所有的仇恨言论都能被识别出来。那会我们已经有了一个检测系统,算法会识别出来或者把它标记为需要人工识别,但有的根本识别不出来的就这样被放过去了,然后用户会对那些之前没能识别出来的内容进行标记,标记的内容再返回进行人工判断。

三年前仅有约 20% 到 25% 的内容能在审核中被自动识别出来,现在这一数字已经是差不多 97.5%了。而这都是得益于深度学习技术和应用的进步。

2、虽然现在人们还在说,可能每过一段时间 AI 领域就会迎来一次寒冬,但从目前谷歌和 Facebook 等非常依赖深度学习的情况来看,应该是不太可能了?

Yann LeCun:对,确实是,虽然没准会有那种特别短的“冬天”,但也不是说对所有人来说都是这样,比如对于那些知道自己在做什么,并且没有宣称过荒谬的AI说法的人来看,肯定不是这样。

而对于那些宣称说,“哦,通用人工智能马上就要出现了……五年内我们就能实现真正的人工智能”,或者“真正的人工智能现在已经是个算法问题,我们只需扩大训练网络的规模就行”的人来说,就肯定会是一个“寒冬”。

就我个人来说,我并不喜欢 AGI 这个词,它或许根本就不存在。

事实上,在我退休前,如果我们能实现猫狗那样的智能我就已经很满足了,而人类水平的智能在那之后也还有很长的一段路要走,因为人的智力是专攻性非常强的,所以我并不相信所谓的那种通用的、普适智能的概念。

3、但目前来说,我们还是在往那个方向前进。

Yann LeCun:对,但我们现在真的需要在无监督学习上有些突破,比如让算法有能力去运行跟贴近真实世界的东西。

智能的本质就是一种预测能力,特别是预测即将会发生什么,然后以此为起点,根据你不同的行为会有什么样不同的结果,来计划你要做什么。

所以,如果能让算法也做到这一点,我们将向实现某种程度上的智能迈进一大步,造出有一些常识的系统,能拥有接近猫和狗的那种水平的智能。

10月25日 报名截止