论文自由,EMNLP2020论文打包收藏!

写在前面

还记得之前我们分享过的ACL2020论文全集吗,论文自由,ACL2020论文打包收藏!网盘可能对文件数量有限制,链接一直失效。考虑到不时还是会有小伙伴问链接的情况,这次干脆就上传到github上了,大家需要的自行下载。链接地址如下,点击文末左下角阅读原文也可到达:

-

AI-Conference-Papers: https://github.com/KaiyuanGao/AI-Conference-Papers

上述仓库里还整理了根据官方放榜目录down下来的EMNLP2020论文全集,持续更新AI会议论文

想要便捷下载的小伙伴,也可以关注NewBeeNLP后台回复『EMNLP』获取打包好的论文。

EMNLP(Conference on Empirical Methods in Natural Language Processing)是计算机语言学和自然语言处理领域的顶级国际会议,由ACL旗下SIGDAT组织,每年举办一次,Google Scholar计算语言学刊物指标中排名第二,是CCF-B类推荐会议。

EMNLP 2020原计划将于2020年11月8日-11月12日在多米尼加共和国的蓬塔卡纳举办,由于受到新冠疫情影响,改为线上进行。本次会议共收到投稿3114篇,录用754篇,录用率为24.82%。此外,因为高质量的论文超出了EMNLP会议本身所能容纳的范围,今年EMNLP新增了Findings这一子刊,其将接纳那些未被主会录用但是被程序委员会评价为值得出版的文章,此次会议共接收Findings论文520篇。

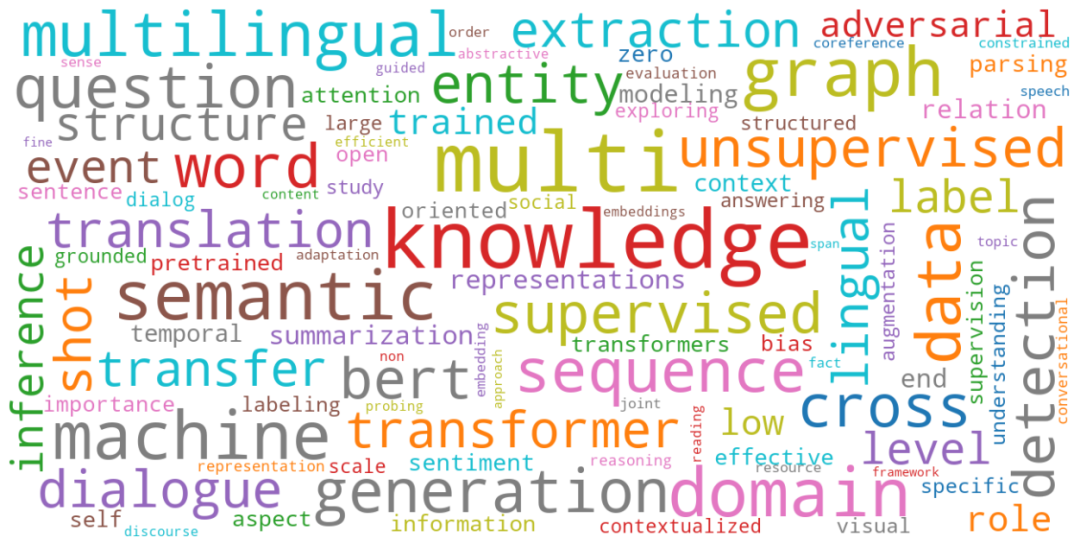

EMNLP 2020 词云

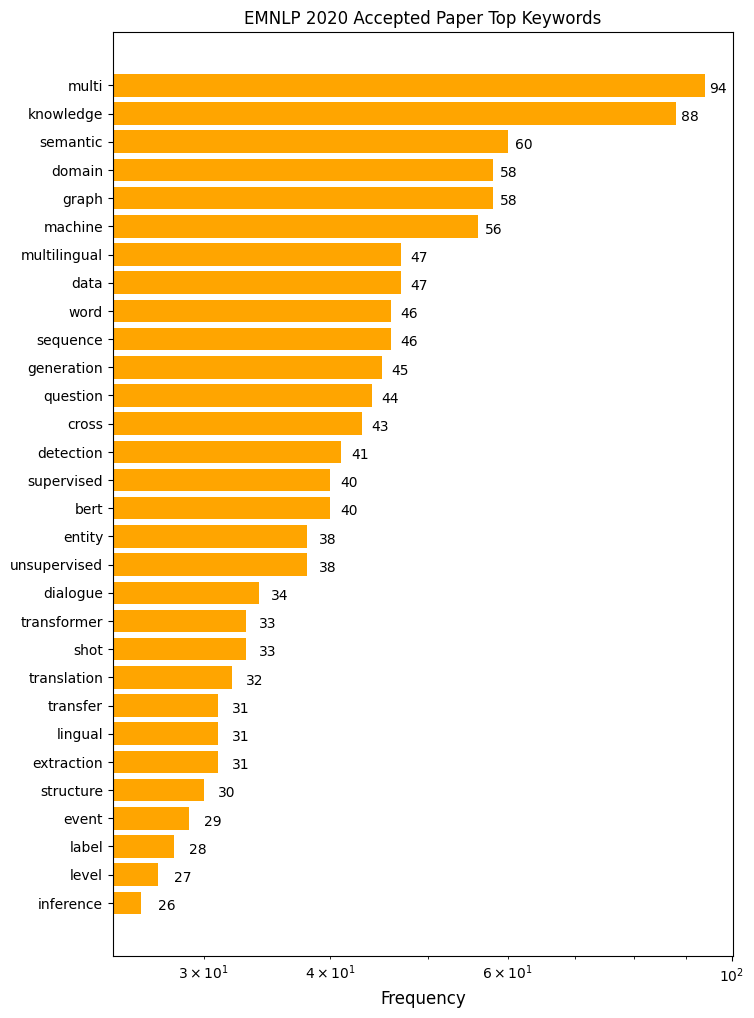

EMNLP 2020 关键词

Long Papers

-

A Bilingual Generative Transformer for Semantic Sentence Embedding -

A Centering Approach for Discourse Structure-aware Coherence Modeling -

A Computational Approach to Understanding Empathy Expressed in Text-Based Mental Health Support. -

A Dataset for Tracking Entities in Open Domain Procedural Text. -

A Diagnostic Study of Explainability Techniques for Text Classification. -

A Joint Multiple Criteria Model in Transfer Learning for Cross-domain Chinese Word Segmentation. -

A Knowledge-Aware Sequence-to-Tree Network for Math Word Problem Solving. -

A Knowledge-driven Generative Model for Multi-implication Chinese Medical Procedure Entity Normalization. -

A Massive Collection of Cross-Lingual Web-Document Pairs. -

A Matter of Framing: The Impact of Linguistic Formalism on Probing Results.

Short Papers

-

A Dual-generator Network for Text Style Transfer Applications. -

A Preliminary Exploration of GANs for Keyphrase Generation. -

A Simple and Effective Model for Answering Multi-span Questions. -

A Simple Approach to Learning Unsupervised Multilingual Embeddings. -

A Simple Yet Strong Pipeline for HotpotQA. -

A Streaming Approach For Efficient Batched Beam Search. -

Ad-hoc Document Retrieval using Weak-Supervision with BERT and GPT2. -

Adversarial Semantic Decoupling for Recognizing Open-Vocabulary Slots. -

AIN: Fast and Accurate Sequence Labeling with Approximate Inference Network. -

An Effective Framework for Weakly-Supervised Phrase Grounding.

BERT-Related

另外根据论文title简单地筛选了跟BERT以及Transformer相关的论文

NewBeeNLP后台回复"EMNLP"快捷下载,迈向论文自由之路吧!

- END -

由于微信平台算法改版,公号内容将不再以时间排序展示,如果大家想第一时间看到我们的推送,强烈建议星标我们和给我们多点点【在看】。星标具体步骤为:

(1)点击页面最上方"AINLP",进入公众号主页。

(2)点击右上角的小点点,在弹出页面点击“设为星标”,就可以啦。

感谢支持,比心

推荐阅读

征稿启示| 200元稿费+5000DBC(价值20个小时GPU算力)

完结撒花!李宏毅老师深度学习与人类语言处理课程视频及课件(附下载)

模型压缩实践系列之——bert-of-theseus,一个非常亲民的bert压缩方法

文本自动摘要任务的“不完全”心得总结番外篇——submodular函数优化

斯坦福大学NLP组Python深度学习自然语言处理工具Stanza试用

关于AINLP

AINLP 是一个有趣有AI的自然语言处理社区,专注于 AI、NLP、机器学习、深度学习、推荐算法等相关技术的分享,主题包括文本摘要、智能问答、聊天机器人、机器翻译、自动生成、知识图谱、预训练模型、推荐系统、计算广告、招聘信息、求职经验分享等,欢迎关注!加技术交流群请添加AINLPer(id:ainlper),备注工作/研究方向+加群目的。

阅读至此了,分享、点赞、在看三选一吧🙏