北邮王啸:做科研要触及本质性问题

自 1956 年“人工智能”概念首次被提出,70 多年时光浇筑和岁月雕刻,以至今天“AI 无处不在”的繁荣景象。其中离不开的,更是一代代科研工作者的博积耕耘。

今年 1 月,AMiner 团队推出 AI 2000 榜单,旨在通过 AMiner 学术数据在全球范围内遴选过去十年间,人工智能学科最有影响力、最具活力的顶级学者,赞扬他们对于人工智能研究领域的卓越贡献。本次学术头条有幸对入围这一名单的北京邮电大学计算机学院副教授王啸进行了采访。

热门视频推荐

更多精彩视频,欢迎关注学术头条视频号

winter

【学术头条】持续招募中,期待有志之士的加入

登录查看更多

相关内容

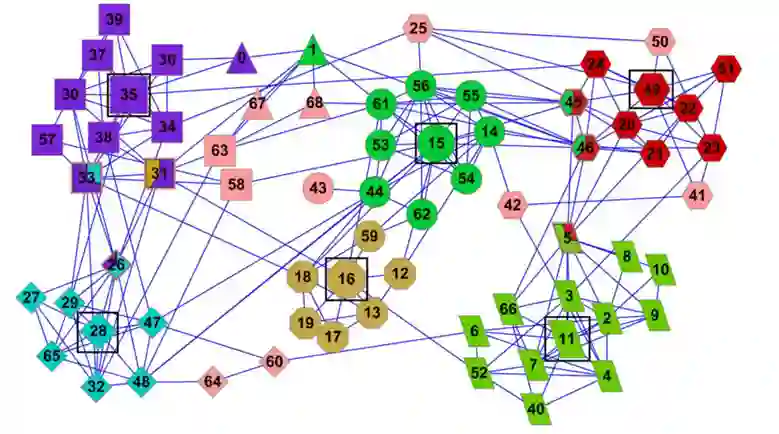

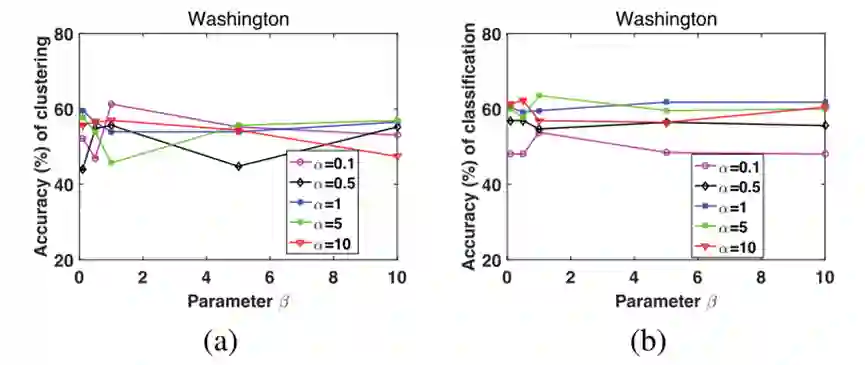

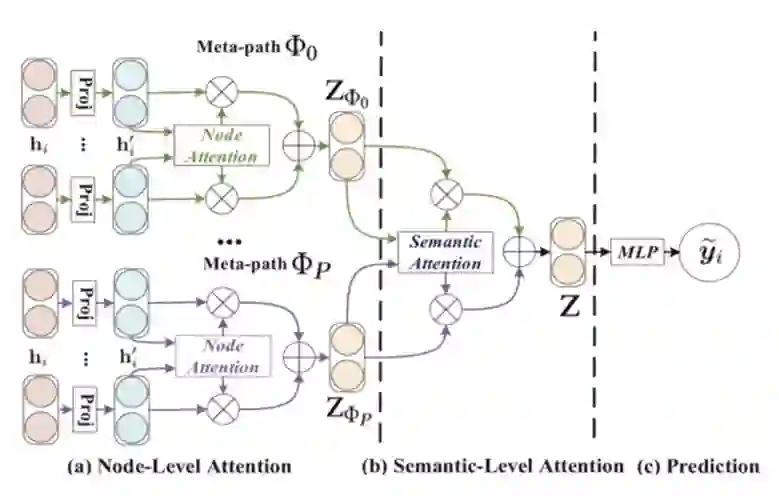

王啸,现任北京邮电大学计算机学院助理教授,硕士生导师。研究方向为图神经网络、数据挖掘与机器学习。曾任清华大学计算机系博士后研究员,天津大学博士,美国圣路易斯华盛顿大学联合培养博士,入选2020年微软亚洲研究院铸星学者。在IEEE TKDE, KDD, WWW, AAAI, IJCAI等领域内国际顶级期刊和会议上发表学术论文50余篇,其中一作/通讯/共一的CCF A类论文24篇,ESI高被引论文1篇,1篇提名WWW 2021 best paper awards, 3篇入AAAI2017/WWW2019,2020最有影响力论文榜单,成果被主流图计算平台DGL等集成。主持国家自然科学基金和CCF-腾讯犀牛鸟科研基金。担任IEEE TKDE, KDD, AAAI, IJCAI等多个权威期刊审稿人和顶级会议的(高级)程序委员会成员。

Arxiv

0+阅读 · 2022年6月9日

Arxiv

14+阅读 · 2021年1月29日