Hinton组力作:ImageNet无监督学习最佳性能一次提升7%,媲美监督学习

机器之心报道

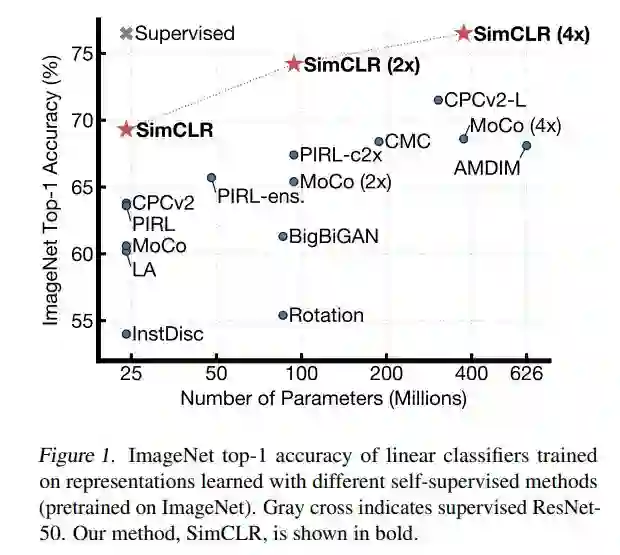

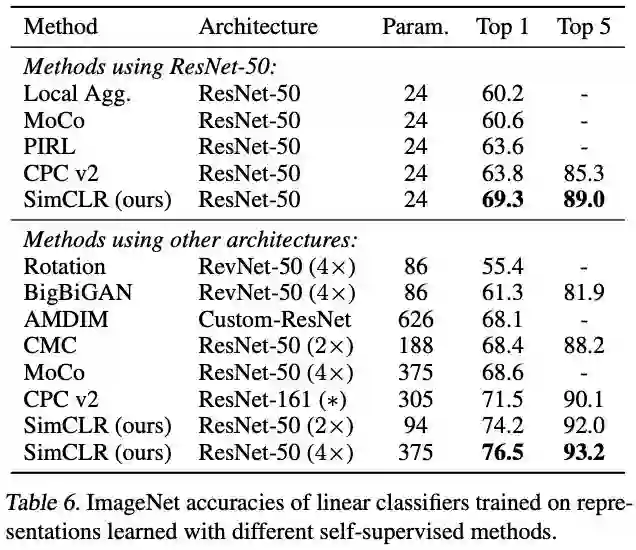

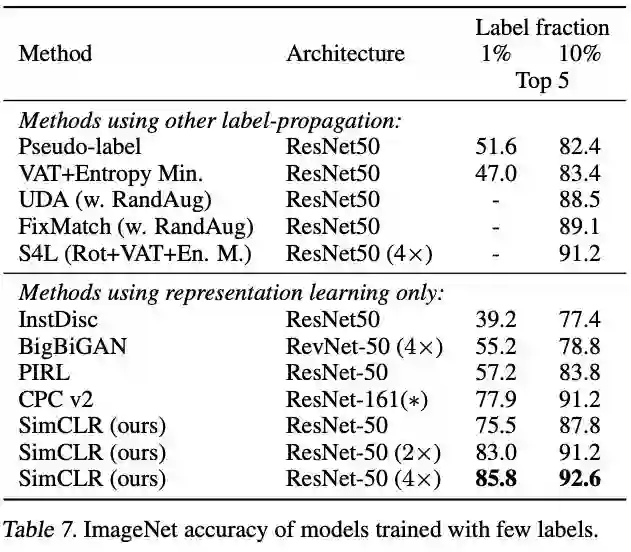

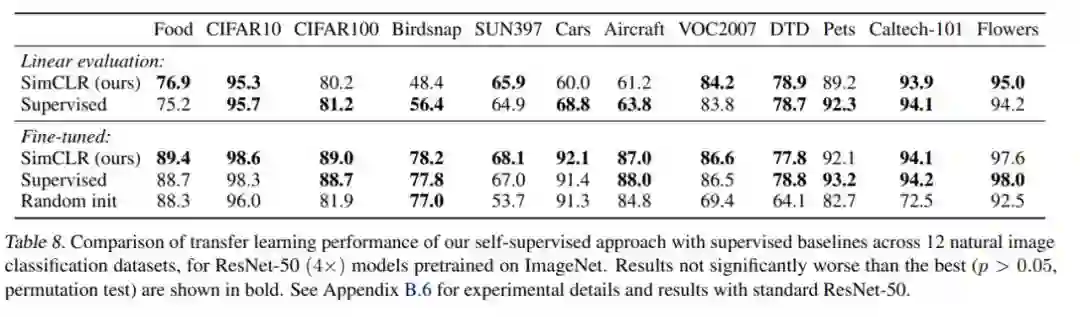

如今,在 ImageNet 上的图像识别准确率的性能提升每次通常只有零点几个百分点,而来自图灵奖获得者 Geoffrey Hinton 等谷歌研究者的最新研究一次就把无监督学习的指标提升了 7-10%,甚至可以媲美有监督学习的效果。

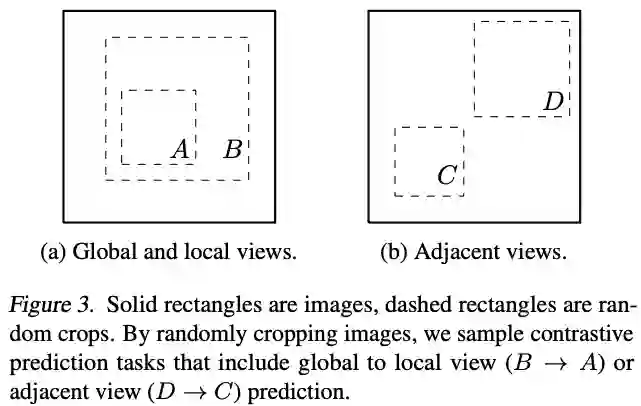

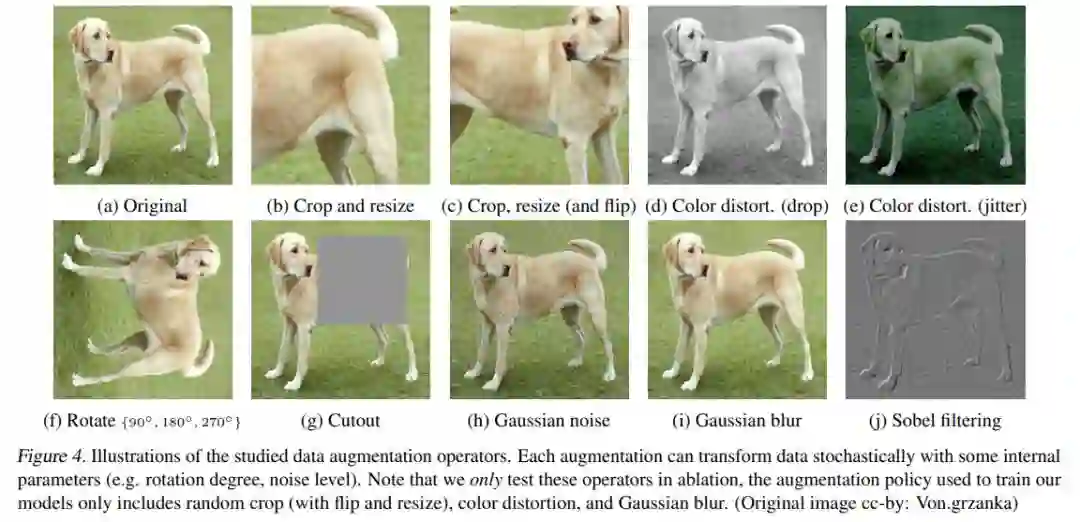

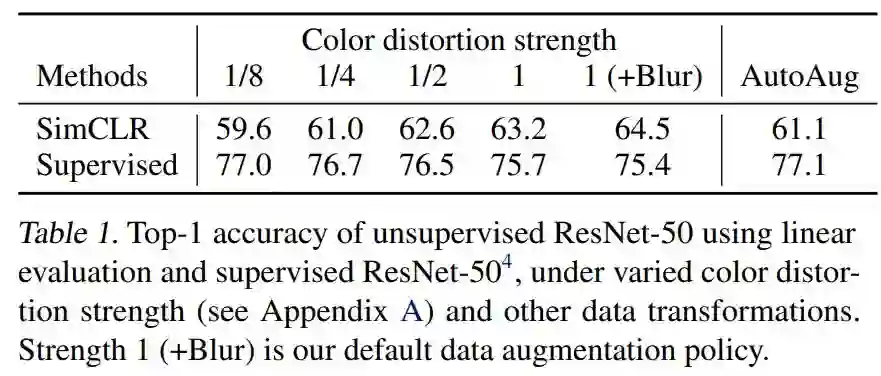

多个数据增强方法组合对于对比预测任务产生有效表示非常重要。此外,与有监督学习相比,数据增强对于无监督学习更加有用;

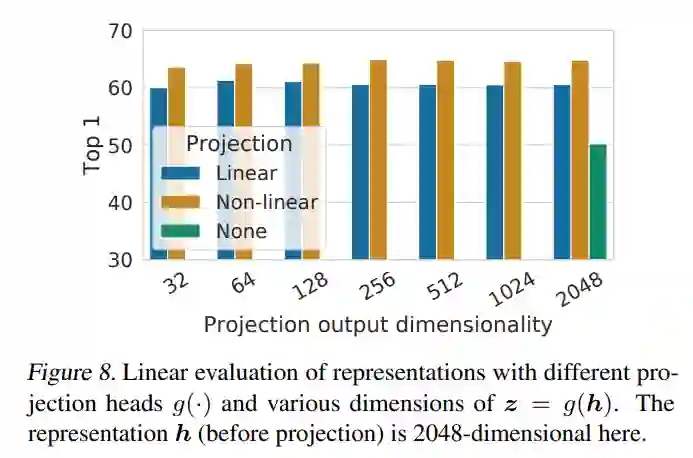

在表示和对比损失之间引入一个可学习的非线性变换可以大幅提高模型学到的表示的质量;

与监督学习相比,对比学习得益于更大的批量和更多的训练步骤。

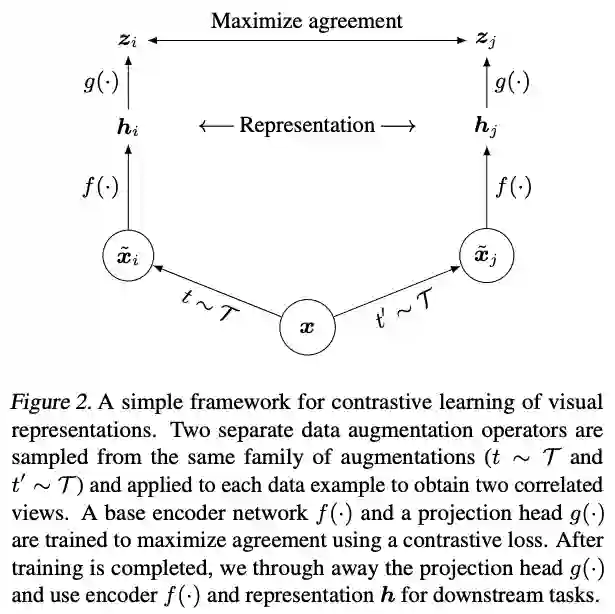

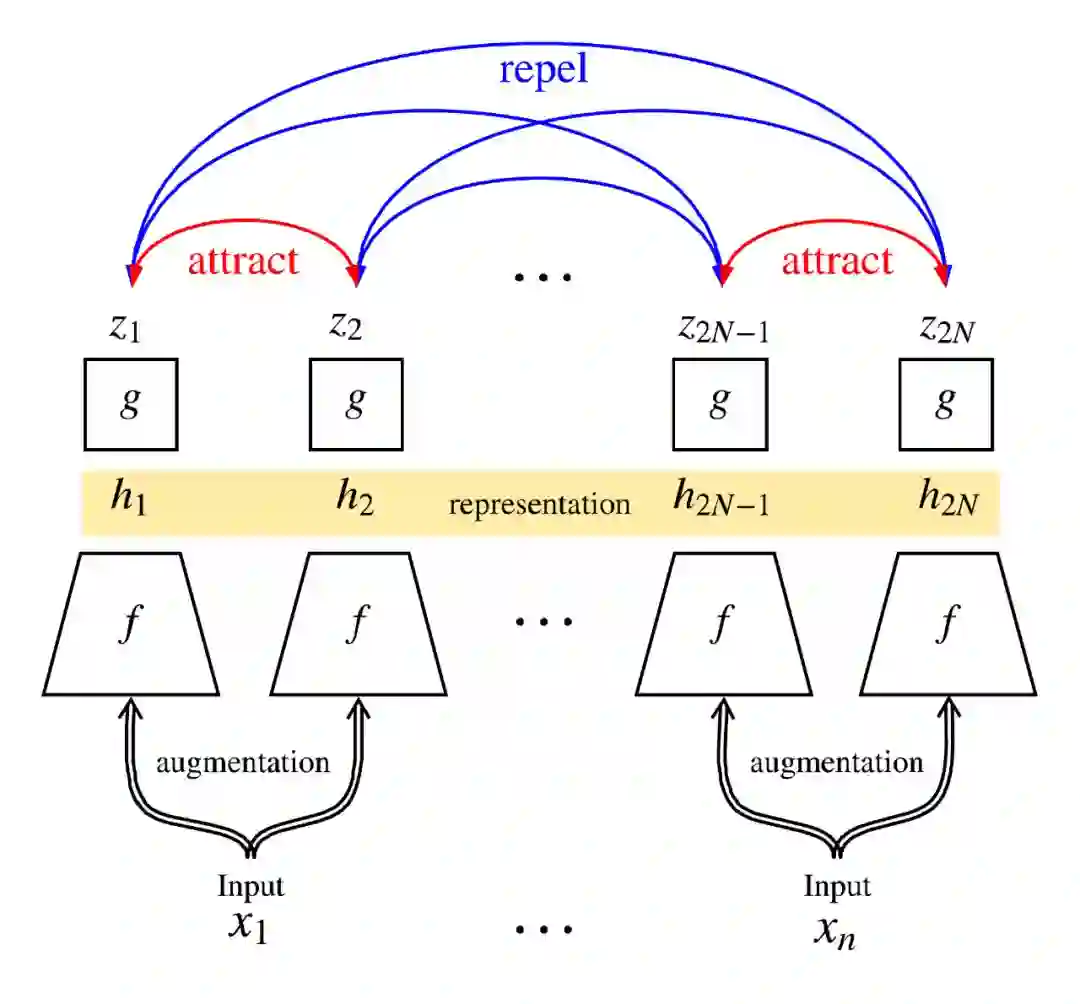

随机数据增强模块,可随机转换任何给定的数据示例,从而产生同一示例的两个相关视图,分别表示为 x˜i 和 x˜j,我们将其视为正对;

一个基本的神经网络编码器 f(·),从增强数据中提取表示向量;

一个小的神经网络投射头(projection head)g(·),将表示映射到对比损失的空间;

为对比预测任务定义的对比损失函数。

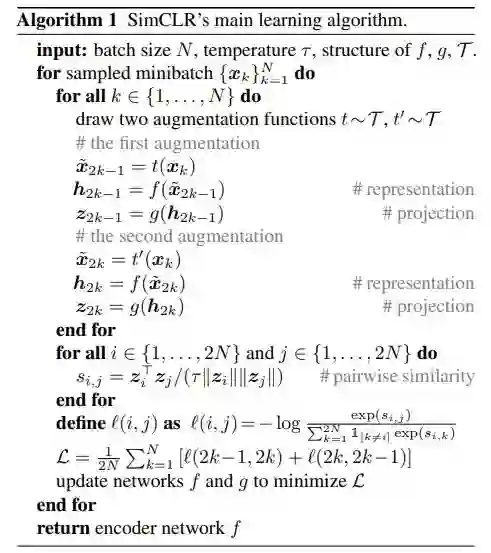

随机抽取一个小批量

给每个例子绘制两个独立的增强函数

使用两种增强机制,为每个示例生成两个互相关联的视图

让相关视图互相吸引,同时排斥其他示例

登录查看更多

相关内容

Arxiv

4+阅读 · 2018年9月23日