面试数百名NLP工程师发现:90%以上是不合格的

在过去几年时间里,NLP领域取得了飞速的发展,这也推动了NLP在产业中的持续落地,以及行业对相关人才的需求。

但这里我们要面对的现实是,行业上90%以上的NLP工程师是“不合格的”。

在过去几个月时间里,我们面试过数百名已经在从事NLP的工程师后发现,他们中的绝大部分对技术深度和宽度的理解是比较薄弱的,大多还是只停留在调用现有工具比如BERT、XLNet等阶段。

我们一直坚信AI人才的最大壁垒是创造力,持续地为变化的业务带来更多的价值。但创造的前提一定是对一个领域的深度理解和广度认知,以及不断对一个事物的追问比如不断问自己为什么。

对于二分类,我应该选择交叉熵还是Hinge Loss?BERT模型太大了,而且效果发现不那么好比如next sentence prediction, 能不能改一改? 为什么CRF要不HMM在不少NLP问题上效果更好? 文本生成效果不太好,如何改造Beam Search让效果更好呢?训练主题模型效率太慢了,如果改造吉布斯采样在分布式环境下运行呢? 数据样本里的标签中有一些依赖关系,能不能把这些信息也加入到目标函数里呢?

除了创造力之外,有必要保持对前沿技术的敏感性。但事实上,很多人还是由于各种原因很难做到这一点。

基于上述的目的,贪心学院一直坚持跑在技术的最前线,帮助大家不断地成长。今天要给大家推荐的是一门非常有挑战的NLP的课程——《自然语言处理三大技术训练营》。

☑ 对话系统 ☑ 知识图谱 ☑ 文本生成

对课程有意向的同学

扫描二维码咨询

三大技术深度剖析

站在NLP领域最前沿

《自然语言处理三大技术训练营》是一门同时具备知识广度与深度的稀缺课程资源。学习之后不仅可以系统掌握自然语言处理核心技术,还能灵活应用在自己的工作中,为后续的科研打下基础,拒绝纸上谈兵。

课程涵盖当今应用和科研领域最热门的三大技术方向:对话系统,文本生成,知识图谱。

- 课程大纲 -

第一阶段:文本生成技术

第一周:Seq2Seq模型与机器翻译

第二周:文本摘要生成(1)

第三周:文本摘要生成(2)

第四周:Creative Writing

第五周:多模态文本生成

第六周:对抗式文本生成与NL2sql

第二阶段:对话系统技术

第一周:对话系统综述(1)

第二周:对话系统综述(2)

第三周:自然语言处理理解模块

第四周:对话管理和对话生成

第五周:闲聊对话系统

第六周:对话系统进阶

第七周:开源对话系统架构RASA详解

第三阶段:信息抽取与知识图谱

第一周:知识图谱与图数据模型

第二周:知识图谱的设计

第三周:关系抽取和预测

第四周:低资源信息抽取和推断

第五周:结构化预测模型

第六周:图挖掘的热门应用

☑ 对话系统 ☑ 知识图谱 ☑ 文本生成

对课程有意向的同学

扫描二维码咨询

蓝振忠

课程研发顾问

ALBERT模型的第一作者

西湖大学特聘研究员和博士生导师

Google AI实验室科学家

美国卡耐基梅隆大学博士

先后在NIPS, CVPR, ICCV, IJCAI等会议发表30篇以上论文,1000+引用次数

李文哲

贪心科技CEO

美国南加州大学博士

曾任独角兽金科集团首席数据科学家、美国亚马逊和高盛的高级工程师

金融行业开创知识图谱做大数据反欺诈的第一人

先后在AAAI、KDD、AISTATS、CHI等国际会议上发表过15篇以上论文

郑老师

清华大学计算机系(计算机科学与人工智能研究部)博士后

美国劳伦斯伯克利国家实验室访问学者

美国亚利桑那大学访问学者

主要从事自然语言处理,对话领域的先行研究与商业化

先后在AAAI,NeurIPS,ACM,EMNLP等国际会议及期刊上发表过10篇以上论文

杨栋

推荐系统,计算机视觉领域专家

香港城市大学博士,加州大学美熹德分校博士后

主要从事机器学习,图卷积,图嵌入的研究

先后在ECCV, Trans on Cybernetics, Trans on NSE, INDIN等国际顶会及期刊上发表过数篇论文

王老师

毕业于QS排名TOP20名校

先后任职于亚马逊,华为,平安科技等AI研发部门

主要从事机器阅读理解,信息检索,文本生成等方向的研究

先后在AAAI, ICLR等发表数篇论文,拥有多项国家发明专利

☑ 对话系统 ☑ 知识图谱 ☑ 文本生成

对课程有意向的同学

扫描二维码咨询

每个模块中,在指定的论文列表中选择至少2篇文章,并把summary发布在内部论坛中。

对于每个模块,以小组为单位,完成一个完整的项目或者课题,分几个阶段完成:

1页课题计划 & 线上报告

课题成果展示 & 最终答辩

完整的课题Report

每一期的训练营都有严谨科学的安排,每周伴随着理论、实战、案例分享、项目讲解等课程一系列课程内容。

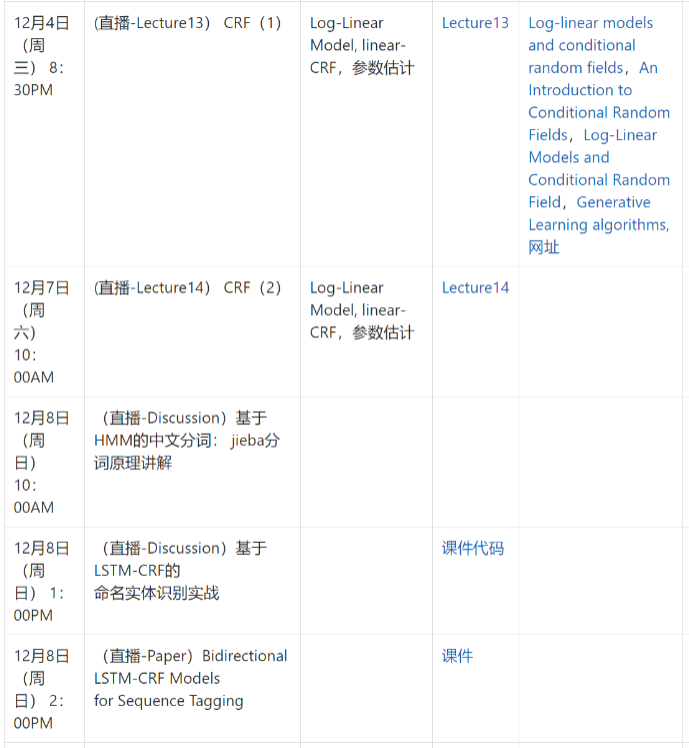

▲节选往期部分课程安排

训练营最终的目的是帮助学员完成项目,理解项目中包含核心知识技能,训练营中会花大量的时间帮助学员理解项目以及所涉及到的实战讲解。

▲节选往期部分课程安排

作为AI工程师,阅读论文能力是必须要的。在课程里,我们每1-2周会安排一篇经典英文文章供学员阅读,之后由老师帮助解读。

▲节选往期部分论文安排

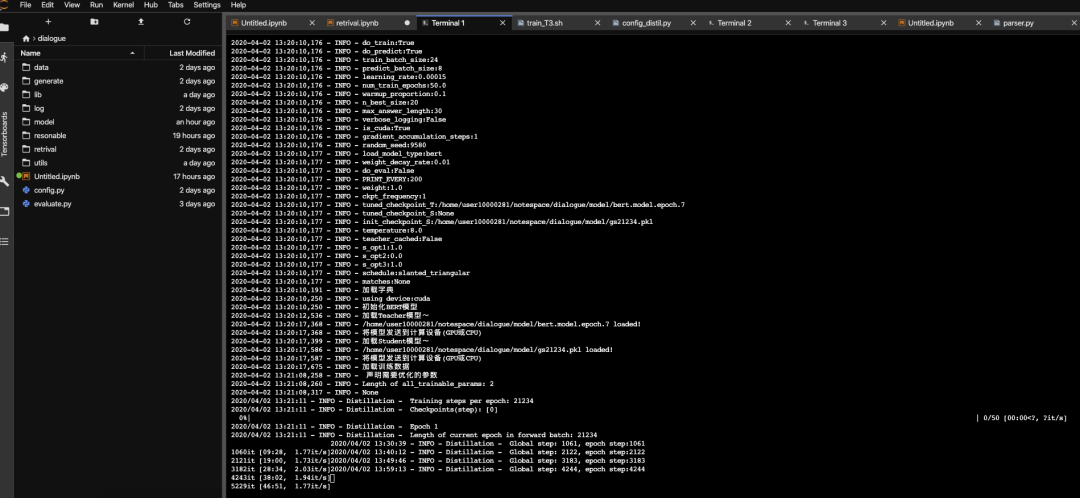

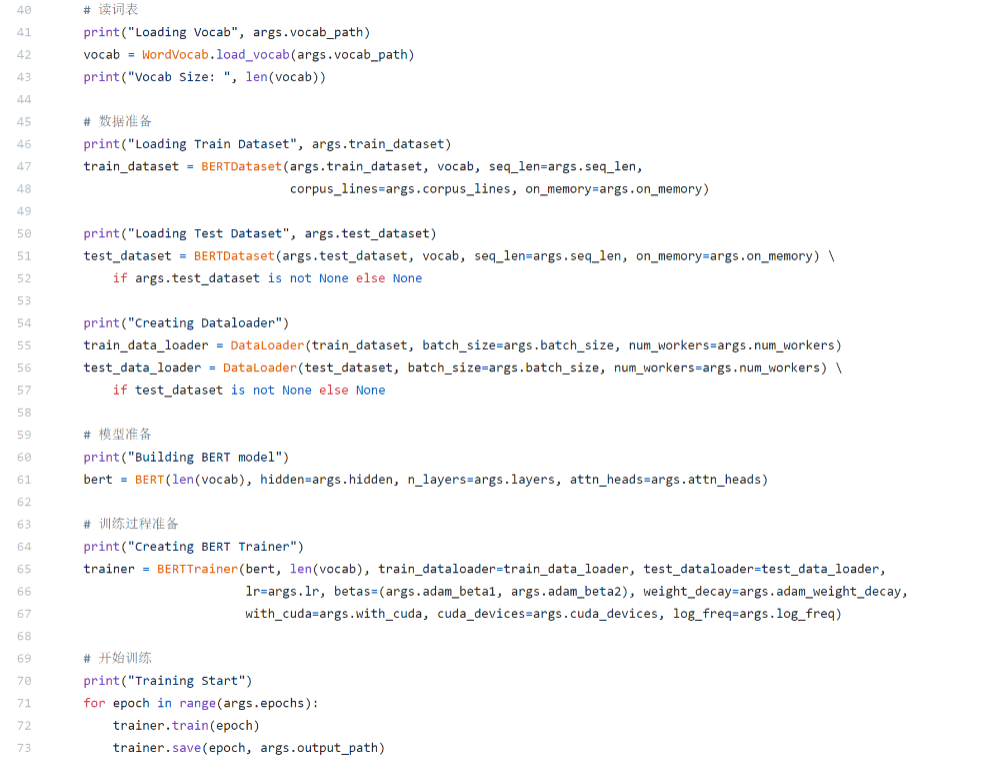

对于核心的模型如BERT,XLNet都会精心安排代码解读和实战课,帮助学员深入理解其细节并有能力去实现。

▲BERT模型代码实战讲解

训练营过程中会邀请合作的专家来分享行业案例以及技术解决方案,如知识图谱的搭建、保险领域的客服系统等。

▲专家分享

《Google YouTube 基于深度学习的视频推荐》

嘉宾简介:曾博士

计算机视觉,机器学习领域专家

先后在CVPR,ACMMM,TPAMI,SCI 期刊,EI 会议等发表超过30篇论文。

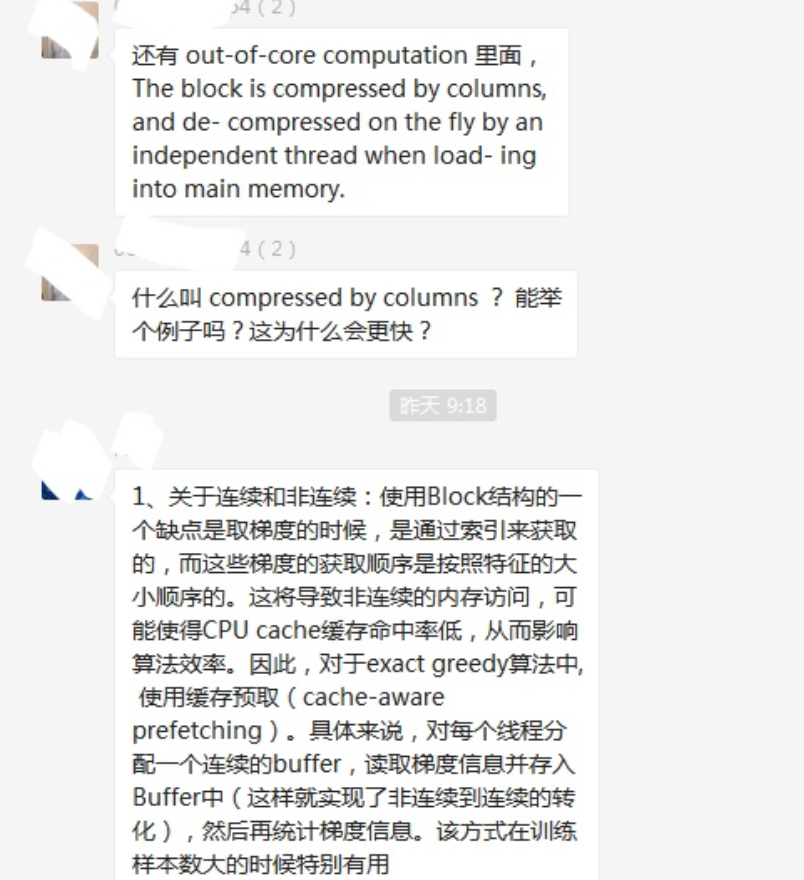

为了帮助解决学员遇到的问题,专业助教会提供全天社群答疑服务。我们的助教均来来自于一线AI公司和国内外名校,扎实的理论和工业界应用也是我们选拔助教老师的重要标准,拒绝空谈理论。

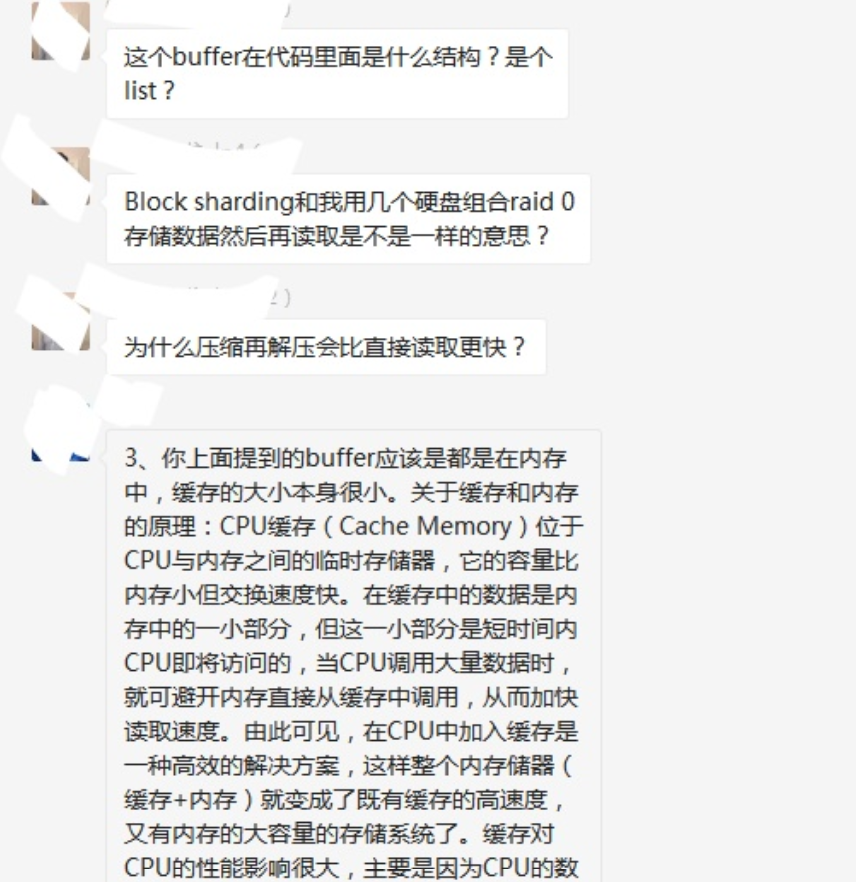

▲社群内老师专业的解答

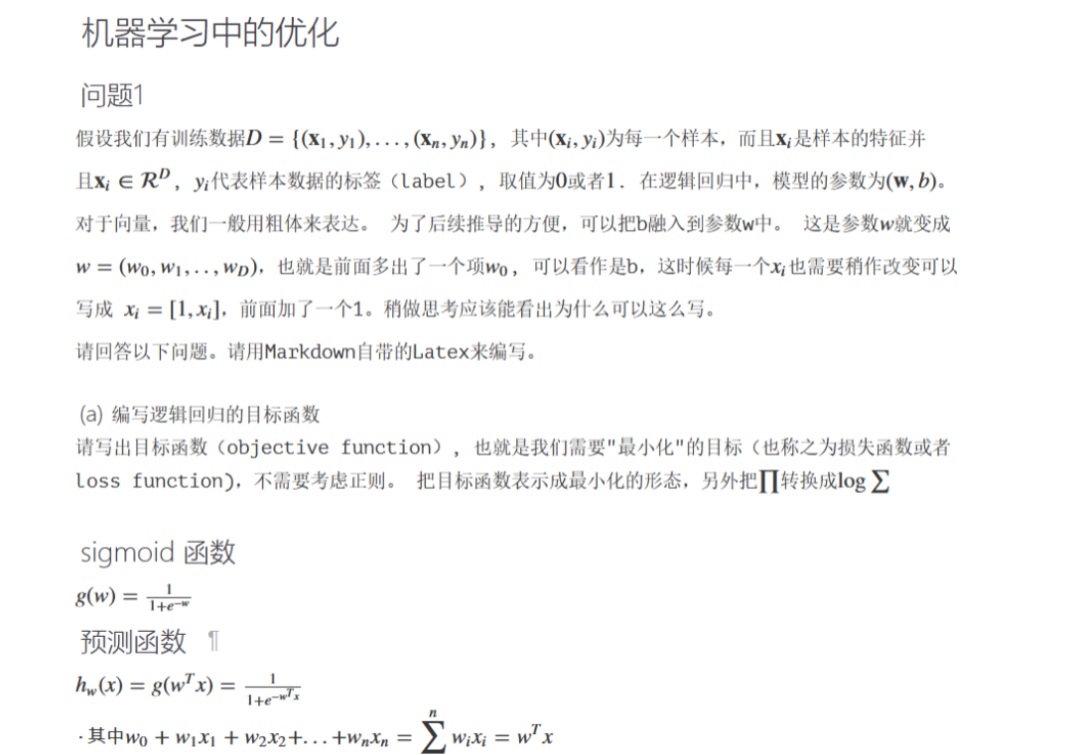

为了巩固对一些核心知识点,学员除了大项目,也需要完成日常的小作业。之后助教会给出详细的解答。

▲课程学习中的小作业

☑ 对话系统 ☑ 知识图谱 ☑ 文本生成

对课程有意向的同学

扫描二维码咨询