Jeff Dean撰文:谷歌AI 2018研究成果汇总

作者:Jeff Dean 来源:Google AI ,新智元等

谷歌AI团队负责人Jeff Dean今天发布博客文章,总结了谷歌的研究团队在2018年的主要研究成果。内容包括:

AI道德原则与以人为本的AI

辅助技术

量子计算

自然语言理解

感知研究

计算摄影

算法和理论

软件系统

AutoML

TPU

开源软件和数据集

机器人技术

人工智能在其他领域的应用

医疗AI

研究推广

在过去的几年里,我们观察到人工智能的重大进步及其对我们的产品和数十亿用户日常生活的积极影响。我们认识到,AI是一种造福世界的力量,它应该被合乎道德地应用,也应该应用于对社会有益的问题。今年我们发布了《谷歌人工智能原则》(Google AI Principles),提出一系列负责任的人工智能实践,并概述了实施的技术建议。

AI用于解决现实社会问题的潜力是显而易见的。一个例子是谷歌在洪水预测方面的工作。这项研究旨在提供关于洪水可能的程度和范围的准确、及时的细粒度信息,使那些在洪水易发地区的人们能够更好地决定如何最好地保护他们自己和他们的财产。

第二个例子是我们在地震余震预测方面的工作,我们展示了机器学习模型可以比传统的基于物理的模型更准确地预测余震的位置。更重要的是,由于ML模型的设计是可解释的,科学家们已经能够对余震的行为做出新的发现,这不仅可以得到更加准确的预测,而且对余震的理解理解也达到了新的水平。

我们还看到大量的外部研究者,有时与谷歌的研究人员和工程师合作,使用TensorFlow等开源软件应对广泛的科学和社会问题,例如使用卷积神经网络识别座头鲸,检测新的系外行星,识别病变的木薯植物等等。

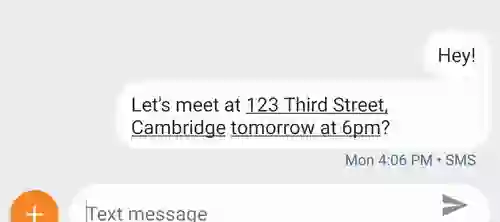

我们的大部分研究集中在使用ML和计算机科学来帮助用户更快、更有效地完成任务。通常,研究团队与不同的产品团队协作,研究成果被应用于不同的产品特性和设置中。一个例子是Google Duplex,这个系统需要研究自然语言和对话理解、语音识别、文本到语音转换、用户理解和有效的UI设计等。

其他的例子包括Gmail的Smart Compose工具,使用预测模型给出关于如何撰写邮件的相关的建议;以及声音搜索技术Sound Search,能够让用户快速、准确地搜索到正在播放的歌曲;等等。

量子计算是一种新兴的计算范式,它能够解决经典计算机无法解决的具有挑战性的问题。在过去的几年里,我们一直在积极地进行这一领域的研究,我们相信该领域正在展示在至少一个问题上的尖端能力(所谓的量子霸权),这将是该领域的一个分水岭事件。

在过去的一年里,我们取得了许多令人兴奋的新成果,包括开发了一种新的72量子比特的量子计算设备:Bristlecone,它可以扩大量子计算机可解决的问题的范围。

研究科学家 Marissa Giustina 在 Santa Barbara 在圣芭芭拉的量子AI实验室安装Bristlecone芯片

我们还发布了面向量子计算机的开源编程框架Cirq,并探索了如何将量子计算机用于神经网络。最后,我们分享了我们在理解量子处理器性能波动方面的经验和技术,并分享了一些关于量子计算机作为神经网络的计算基础的想法。我们期待2019年在量子计算领域取得激动人心的成果!

谷歌的自然语言研究在2018年取得了令人兴奋的成果,既有基础研究,也有以产品为重点的合作。我们对2017年提出的Transformer架构进行了改进,开发了一种名为Universal Transformer的新的实时并行版本,该版本在翻译和语言推理等自然语言任务中显示出强大的优势。

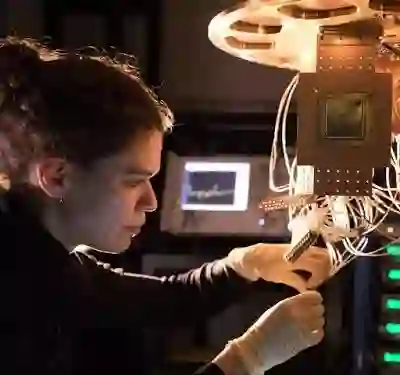

我们还开发了BERT,这是第一个深度双向、无监督的语言表示模型,只使用纯文本语料库进行预训练,然后可以使用迁移学习对各种自然语言任务进行微调。BERT在11个自然语言任务上比以前的最先进的结果有了显著的改进。

BERT在非常具有挑战性的GLUE基准测试中将最优结果提高了7.6%

感知研究致力于解决让计算机理解图像、声音、音乐和视频的难题,并为图像捕获、压缩、处理、创造性表达和增强现实提供更强大的工具。

2018年,我们的技术提高了Google Photos中组织用户最关心的内容的能力,比如人和宠物。Google Lens和Google Assistant 让用户了解自然世界,实时回答问题,并能在谷歌图像中使用Google Lens做更多事情。

Google Lens可以帮助你了解你周围的世界

在音频领域,我们提出了一种用于语义音频表示的无监督学习方法,以及对富有表达性的语音合成的显著改进。多模态感知成为一个越来越重要的研究课题。Looking to Listen将输入视频中的视觉和听觉线索结合起来,以隔离和加强视频中所需的说话者的声音。这项技术可以支持许多应用,从视频中的语音增强和识别、视频会议,到改进的助听器,尤其是可以应用于多人讲话的场景。

在计算资源有限的平台上实现感知变得越来越重要。MobileNetV2是谷歌的下一代移动计算机视觉模型,被广泛应用于学术界和工业界。MorphNet提出了一种学习深度网络结构的有效方法,在计算资源限制的条件下,可以全面提高图像和音频模型的性能。最近有关自动生成移动网络架构的研究也表明,继续提高性能是可能的。

在过去的几年里,手机摄像头的质量和功能都有了显著的提高。部分原因是手机中实际使用的物理传感器有所改进,但更大的原因是计算摄影这一科学领域的进步。

我们的研究团队发布了最新研究技术,并与谷歌的Android团队和消费硬件团队紧密合作,将最新技术应用在最新的Pixel和Android手机及其他设备中。2014年,我们提出了HDR+技术,通过该技术,摄像机捕捉到一组帧,然后在软件中对齐这些帧,并将它们与计算软件合并在一起。HDR+的工作最初是为了使图片具有比单次曝光更高的动态范围。然而,通过捕获大量的帧,然后对这些帧进行计算分析成为了一种通用的方法,这种方法在2018年使相机中的许多进步成为可能。例如,它允许在Pixel 2中开发动态照片功能,在Motion Stills中实现增强现实模式。

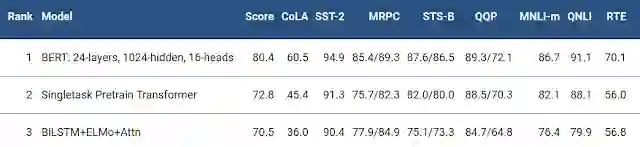

Pixel 2 拍摄的运动照片

Motion Stills 的AR模式

今年,我们在计算摄影研究方面的主要工作之一是创造一种称为“夜视”( Night Sight)的新能力,它使 Pixel 手机相机能够“在黑暗中观看”。

左:iPhone XS(全分辨率)。右: Pixel 3 的夜视能力(全分辨率)

算法是谷歌系统的支柱,触及我们所有的产品,从Google trips背后的routing算法到Google cloud的consistent hashing 算法。在过去的一年里,我们继续在算法和理论方面进行研究,涵盖了从理论基础到应用算法,从图挖掘到隐私保护计算的广泛领域。

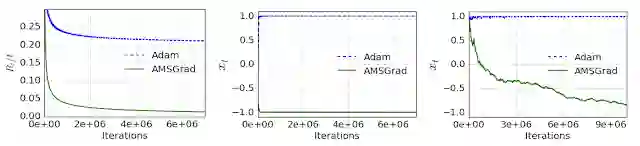

我们在优化方面的工作涉及从机器学习的连续优化到分布式组合优化的各个领域。在前者,我们研究用于训练神经网络的随机优化算法的收敛性(获得了ICLR 2018年最佳论文),展示了流行的基于梯度的优化方法(如ADAM的一些变体)存在的问题,为新的基于梯度的优化方法提供了坚实的基础。

ADAM和AMSGRAD在一个简单的一维凸问题上的性能比较

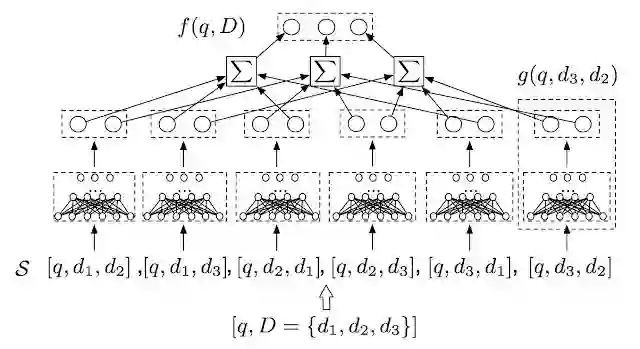

我们在软件系统方面的大部分研究仍然与构建机器学习模型有关,特别是与TensorFlow有关。例如,我们发表了TensorFlow 1.0动态控制流的设计和实现。我们的一些新研究引入了一个称为Mesh TensorFlow的系统,它使得使用模型并行性来指定大规模分布式计算变得很容易。另一个例子是,我们发布了一个使用TensorFlow的可扩展深度神经排序库TF-Ranking library。

TF-Ranking库

我们还发布了JAX,这是一个加速器支持的NumPy变体,支持Python函数按照任意顺序自动区分。虽然JAX不是TensorFlow的一部分,但它利用了与TensorFlow相同的底层软件基础结构(例如XLA),它的一些思想和算法对TensorFlow项目很有帮助。

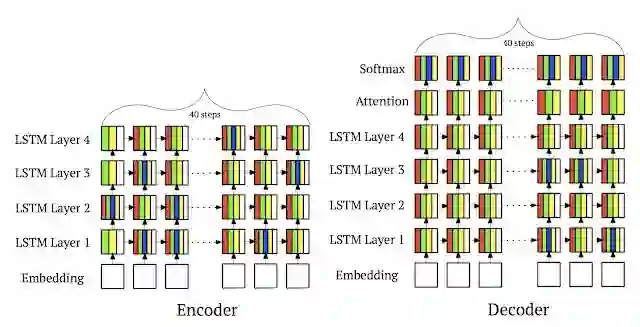

另一个重要的研究方向是ML在软件系统中的应用。例如,我们继续使用分层模型将计算部署到设备上,并有助于学习内存访问模式。我们还继续探索如何使用学习的索引来替代数据库系统和存储系统中的传统索引结构。正如我去年所写的,我们认为在计算机系统中使用机器学习方面,我们只是触及了皮毛。

在一个NMT模型(4层)中Hierarchical Planner的放置

AutoML,也称为meta-learning,是利用机器学习来自动化机器学习的某些方面的方法。我们已经在这个领域进行了多年的研究,我们的长期目标是开发一种学习系统,这种系统能够利用从以前已经解决的其他问题中获得的见解和能力,自动地解决一个新问题。

我们在这个领域的早期工作主要是使用强化学习,但我们也对进化算法的使用感兴趣。去年,我们展示了如何使用进化算法为各种视觉任务自动发现最先进的神经网络架构。

我们也探讨了强化学习如何应用于神经网络架构搜索之外的其他问题,我们的研究证明它可用于1)自动生成图像变换序列,以提高各种图像模型的准确性;以及2)寻找新的符号优化表达式,比常用的优化更新规则更有效。我们在AdaNet上的工作展示了如何得到具有学习能力的快速灵活的AutoML算法。

AdaNet自适应地生成神经网络的集合。在每次迭代中,它都度量每个候选者的集成损失,并选择最佳的一个进行下一次迭代。

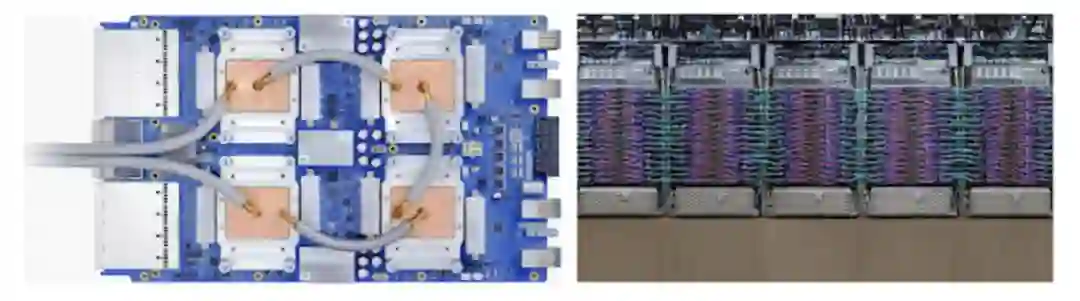

张量处理器(TPU)是谷歌内部开发的ML硬件加速器,从一开始就设计为支持大规模的训练和推理。TPU帮助谷歌的研究取得许多突破性进展,例如BERT(前面已经讨论过),同时也使世界各地的研究人员能够通过开放源码在谷歌的研究基础上进行构建,并追求自己的新突破。例如,任何人都可以通过Colab在TPU上免费调优BERT, TensorFlow Research Cloud让成千上万的研究人员有机会从更大量的免费云TPU计算能力中获益。

单个TPU v3设备(左)和TPU v3 Pod的一部分(右)

发布开源软件和创建新的公共数据集是我们为研究和软件工程社区做出贡献的两种主要方式。我们在这个领域最大的努力之一是TensorFlow,这是2015年11月发布的一个非常流行的ML计算系统。我们在2018年庆祝了TensorFlow的三周年,在这段时间里,TensorFlow的下载量已经超过3000万次,超过1700个贡献者增加了4.5万个提交。在2018年,TensorFlow发布了8个主要版本,并增加了一些主要功能,如eager execution。随着TensorFlow Lite、TensorFlow.js和TensorFlow Probability的推出,TensorFlow生态系统在2018年有了大幅增长。

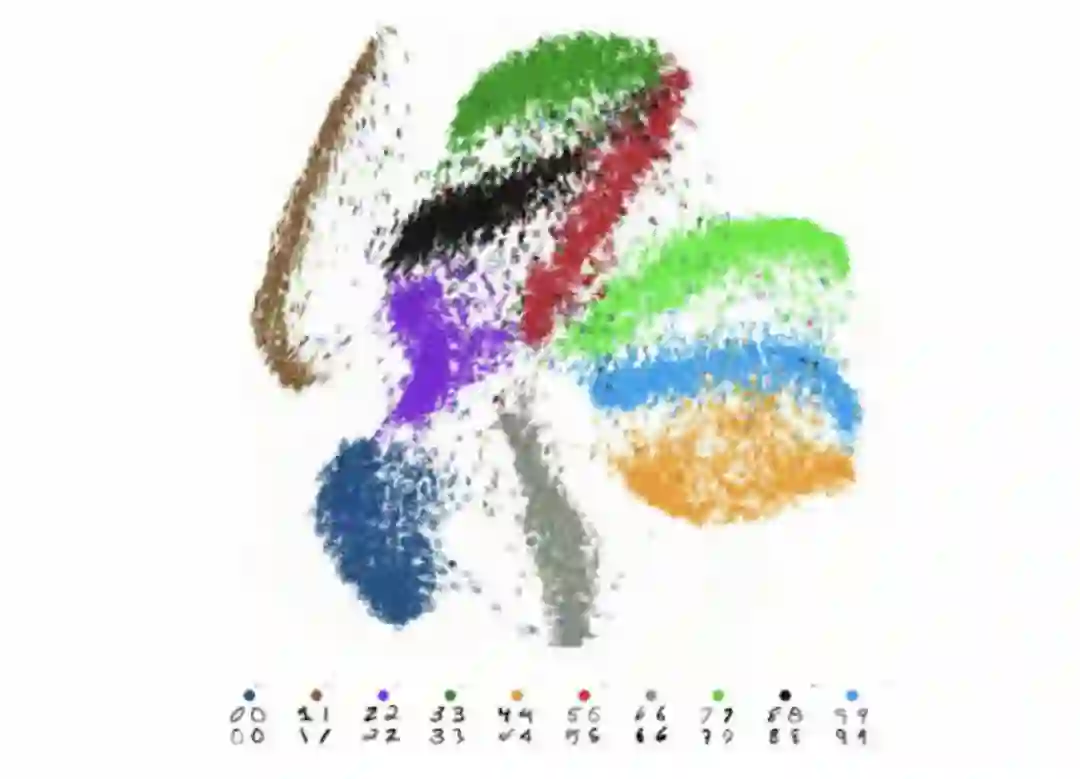

除了继续开发现有的开源生态系统,在2018年,我们还开发了一个用于灵活、可复现的强化学习研究的新框架,一个用于快速理解数据集的特征的新可视化工具(无需编写任何代码),一个使用TensorFlow.js在浏览器中进行实时t-SNE可视化的库,以及用于处理电子医疗数据的FHIR工具和软件等。

完整 MNIST 数据集的 tSNE 嵌入的实时演变,该数据集包含60000个手写数字的图像

我们发布了Open Images V4,这是一个包含1540万个边界框的数据集,包含600个类别的190万张图像,以及19794个类别的3010万个经过人工检查的图像级标签。

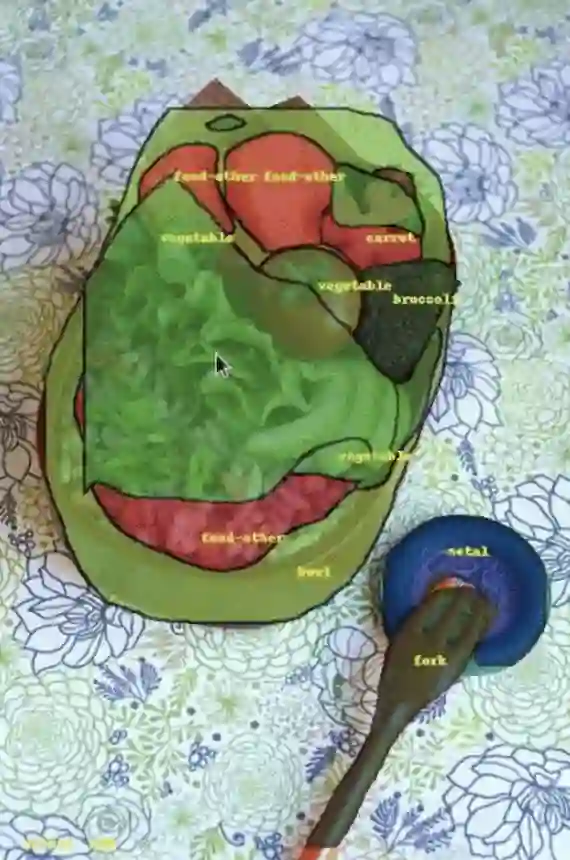

我们还探索了一些技术,可以使用Fluid Annotation更快地创建可视化数据集。

COCO数据集图像上的Fluid Annotation界面

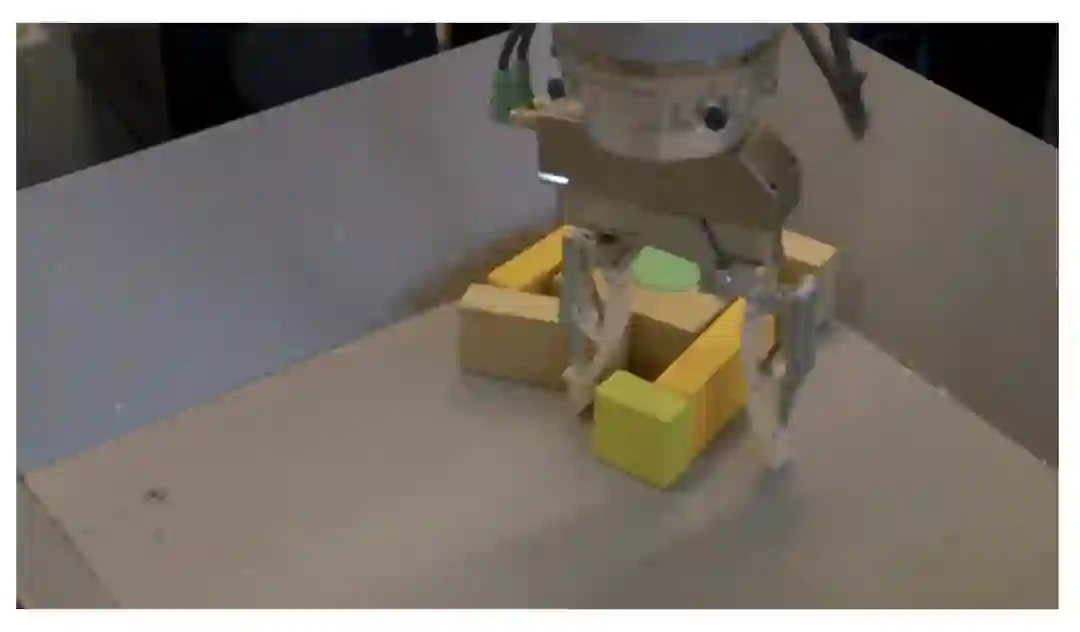

2018年,我们在理解 ML 如何教会机器人在现实世界里行动方面取得了重大进展,该研究教机器人抓取从来没见过的物体,相关论文获得CoRL’18最佳论文。我们还通过结合ML和基于采样的方法(ICRA'18 最佳论文),在学习机器人运动方面取得了进展。我们第一次能够在真实机器人上成功地在线训练深度强化学习模型,并且正在寻找新的、基于理论的方法,来学习稳定的机器人控制方法。

2018年,我们已经将ML应用于物理和生物科学中的各种问题。使用ML,我们可以为科学家提供相当于数百或数千名研究助理的数据挖掘,从而解放科学家,使他们变得更有创造力和生产力。

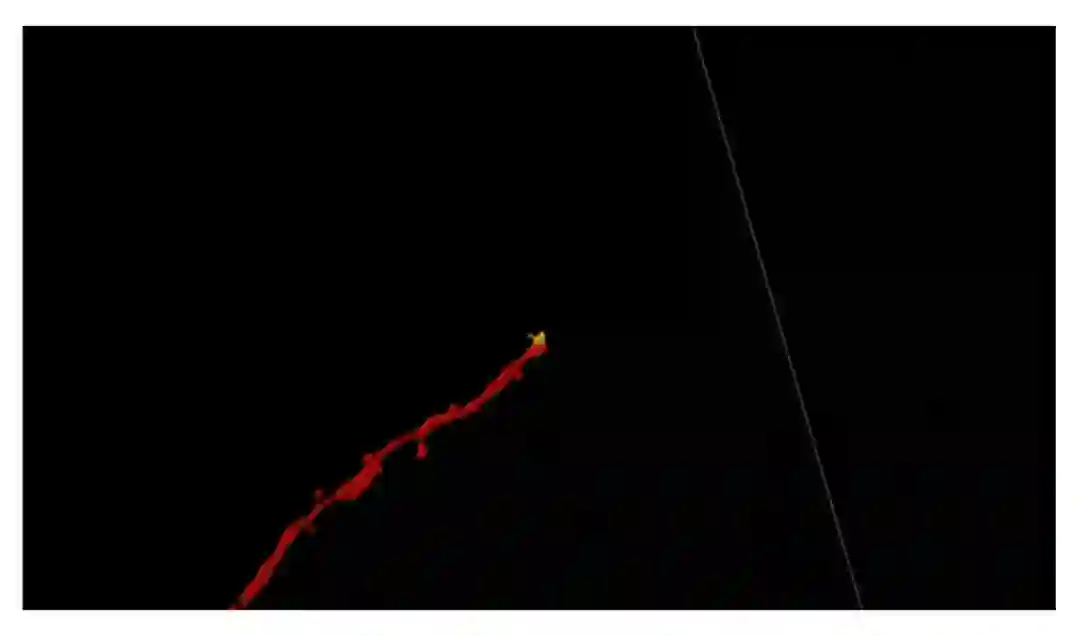

我们在Nature Methods上发表的一篇关于神经细胞高精度自动重建的论文提出了一种新的模型,与以往的深度学习技术相比,该模型将连接组学数据自动解释的准确性提高了一个数量级。

我们的算法在鸣禽大脑中追踪单个神经突的 3D 过程

将 ML 应用于科学的其他一些例子包括:

通过数据挖掘恒星的光曲线,寻找新的太阳系外行星

认识到短DNA序列的起源或功能

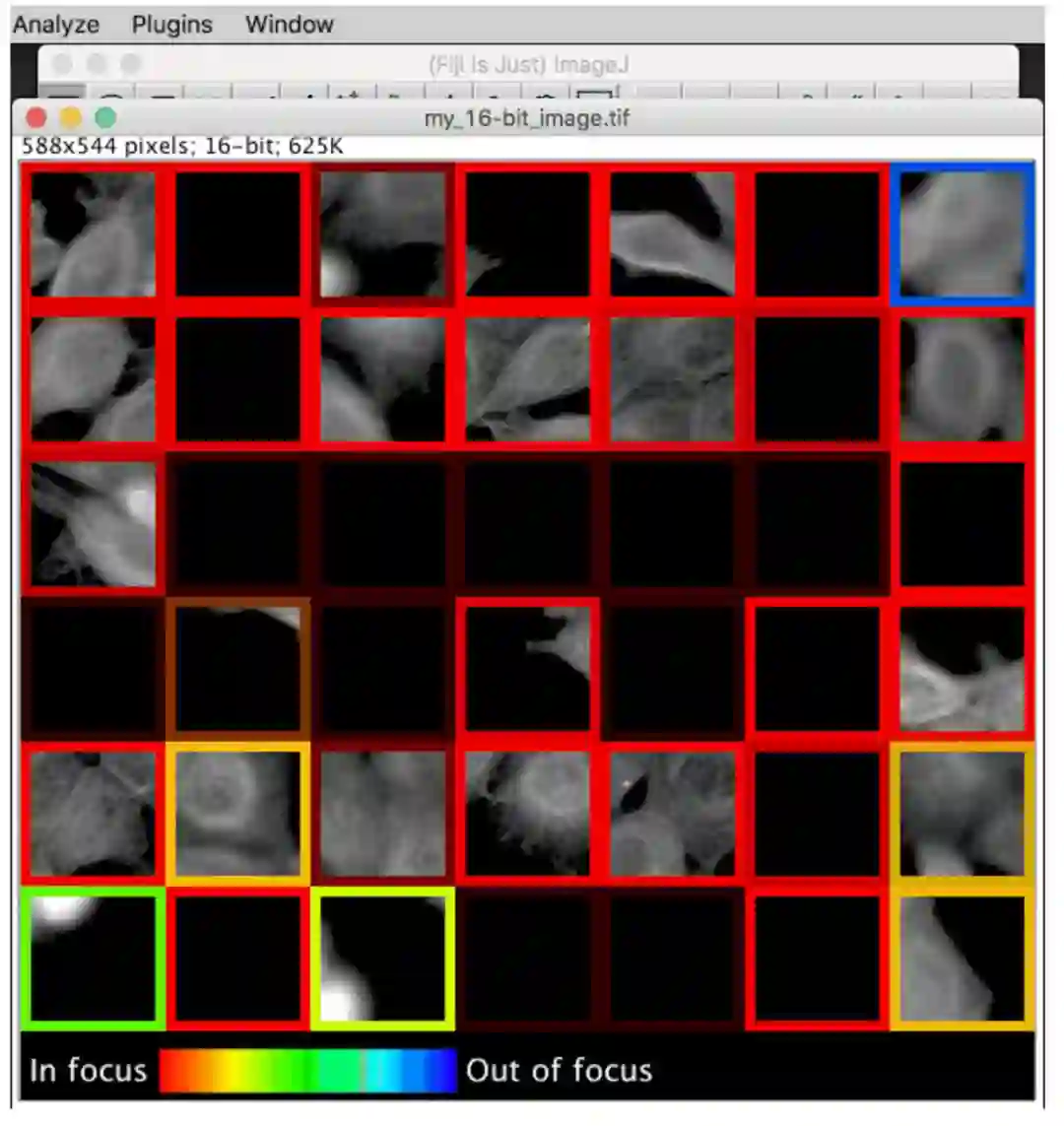

自动检测失焦显微镜图片

自动将质谱输出映射到肽链

经过预训练的 TensorFlow 模型可以对Fiji (ImageJ)细胞显微镜图像斑块的蒙太奇进行聚焦质量评估。

在过去的几年里,我们一直致力于将ML应用于医疗领域,这是一个影响我们每个人的领域,也是一个我们相信ML可以通过增强医疗专业人员的直觉和经验而产生巨大影响的领域。我们在这个领域的一般方法是与医疗机构合作解决基础研究问题(利用临床专家的反馈使我们的结果更加可靠),然后将结果发表在科学和临床杂志上。一旦该研究得到临床和科学验证,我们将进行用户和HCI研究,以了解如何将其应用于实际的临床环境。2018年,我们将工作范围扩大到计算机辅助诊断和临床任务预测。

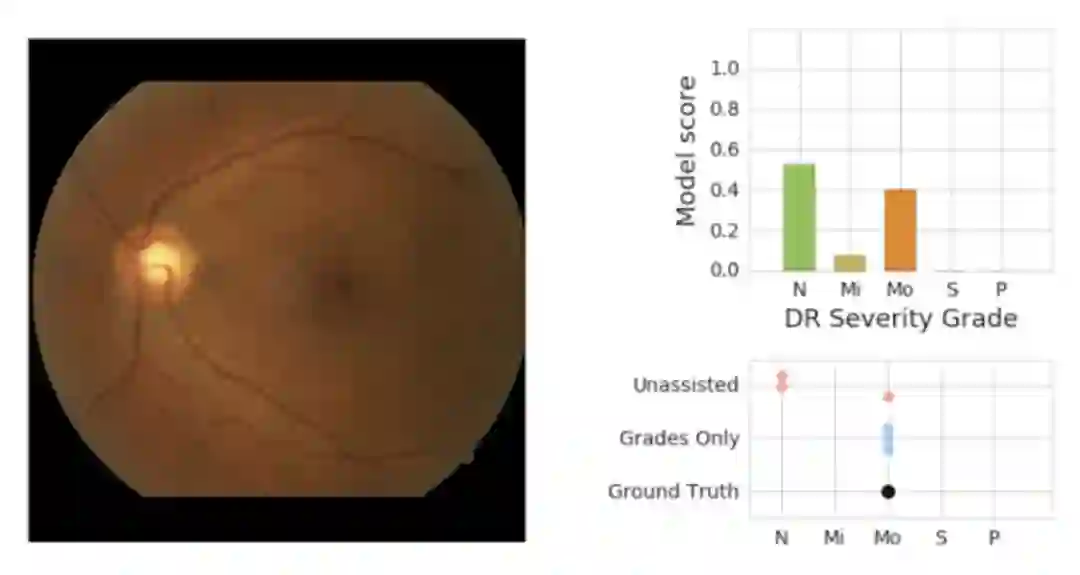

在2016年底,我们发表的一项研究表明,经过训练的用于评估视网膜眼底图像以检测糖尿病视网膜病变迹象的模型,其表现与美国医学委员会认证的眼科医生相当,甚至略好于后者。

2018年,我们进一步表明,通过使用由视网膜专家标记的图像进行训练,模型的表现已经与视网膜专家相媲美。后来,我们发表了一项评估,显示了眼科医生与ML模型协同判断,如何比单独做决定更准确。我们与Verily的同事合作,在印度的Aravind眼科医院和泰国卫生部下属的Rajavithi医院等10多个地方部署了这个糖尿病视网膜病变检测系统。

ML评估糖尿病视网膜病变

我们还发表了一项关于机器学习模型通过视网膜图像评估心血管风险的研究,这是一项医学专家和眼科专家都认为相当了不起的研究。这为一种新的、非侵入性的生物标志物提供了早期有希望的迹象,这种标志物可以帮助临床医生更好地了解患者的健康状况。

我们今年也继续病理学,展示了如何使用ML提高前列腺癌分级的准确度、利用深度学习检测转移性乳腺癌,并开发了一个原型的增强现实显微镜,可以通过来自计算机视觉模型的视觉信息帮助病理学家和其他科学家。

在过去的四年里,我们进行了一项重大的研究,利用电子健康记录来进行临床相关的预测。2018年,我们与芝加哥大学、加州大学旧金山分校和斯坦福大学合作,在Nature Digital Medicine上发表了一篇论文,展示了ML模型如何应用于识别电子病历,能够对各种临床相关任务做出比当前临床最佳实践准确性更高的预测。作为这项工作的一部分,我们开发了一些工具,使得即使在完全不同的任务和完全不同的基础EHR数据集上创建这些模型变得非常容易。我们还改进了基于深度学习的变量调用DeepVariant的准确性、速度和实用性。该团队最近在《自然-生物技术》杂志上发表了一篇同行评议的论文。

我们以多种不同方式与外部研究社区进行交流,包括教师参与和学生支持。我们很荣幸在本学年招收了数百名本科生、硕士生和博士生作为实习生,并为北美、欧洲和中东的学生提供多年的博士生奖研金(Ph.D. fellowships)。

作为这个奖学金项目补充的是Google AI Residency项目,这个项目允许想要进入深度学习研究的人在谷歌与研究人员一起工作并接受他们的指导。如今,Google AI Residency已进入第三个年头,学员们被安插在谷歌全球的各个团队中,从事机器学习、感知、算法和优化、语言理解、医疗保健等领域的研究。

每年,我们也通过Google Faculty Research Awards program支持一些教师和学生进行研究项目。

我们认为,公开地为更广泛的研究社区作出贡献是支持健康和富有成效的研究生态系统的关键部分。除了开源和公开数据集之外,我们的许多研究都在顶级会议和期刊上公开发表,并积极参与、组织和赞助各种不同学科的会议。

原文链接:

https://ai.googleblog.com/2019/01/looking-back-at-googles-research.html

广告 & 商务合作请加微信:kellyhyw

投稿请发送至:mary.hu@aisdk.com