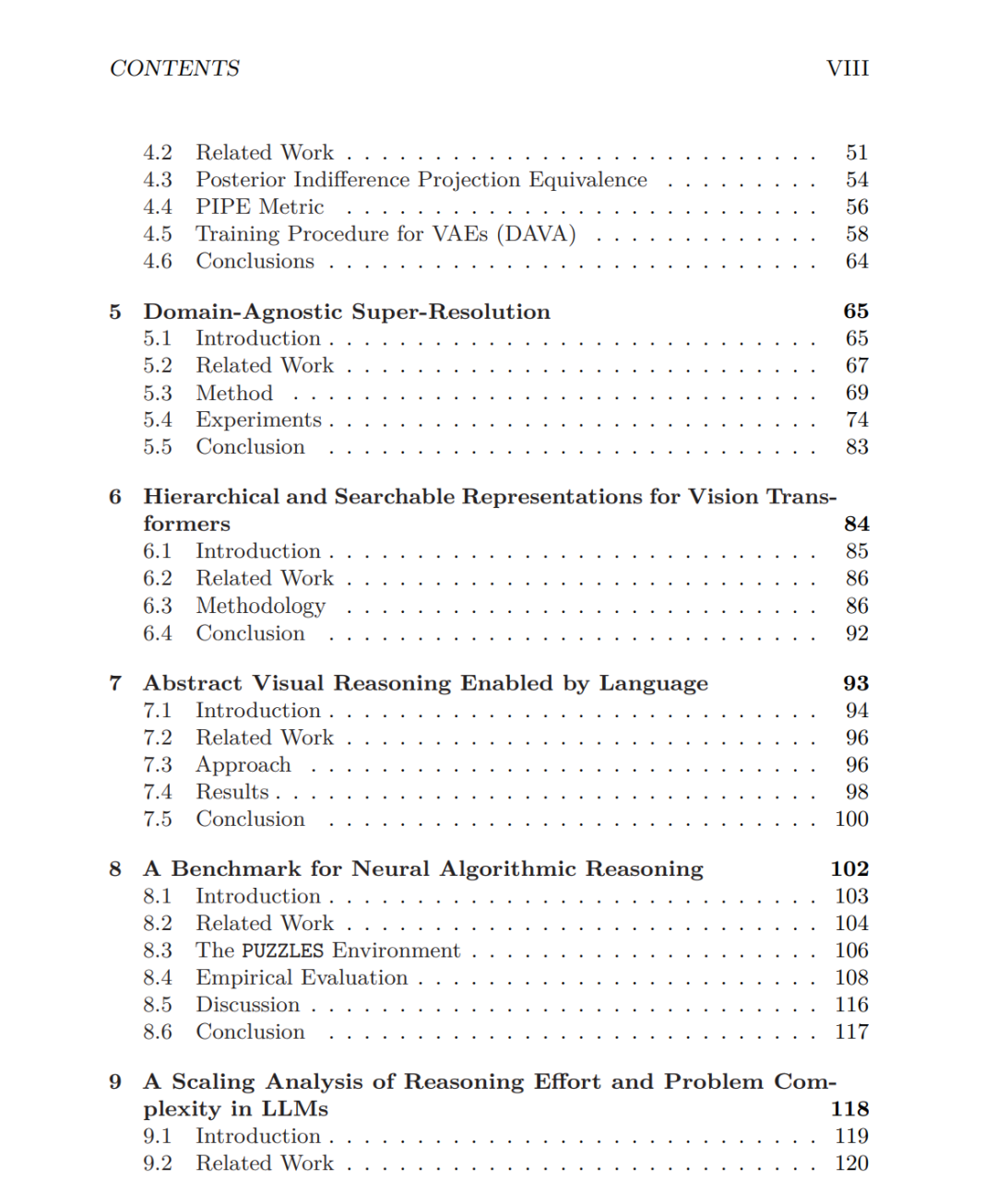

本论文探讨了表征学习在提升深度神经网络在多种应用场景中的性能所发挥的多重作用。我们深入研究了主动学习(active learning)范式,考察其在迭代式组合拍卖中的应用,以及在自监督预训练模型背景下融合多样性与基于不确定性的采样策略的方法。我们的研究还延伸至可分解(disentangled)表征学习,提出了一种新的变分自编码器(VAE)训练流程,该方法克服了超参数选择的挑战,并能够实现一致性的可分解表征学习。 此外,我们利用隐式神经表征(implicit neural representations)实现了与领域无关(domain-agnostic)的超分辨率重建,展示了对任意数据类型进行放大的能力。我们还通过提出一种分层的基于树结构的架构来解决 Transformer 在处理大规模输入时的可扩展性问题。 最后,我们研究了大型语言模型(LLMs)的推理能力:首先展示语言可用于抽象视觉任务中的推理;随后构建了一个用于评估算法式推理能力的基准,并分析了推理型语言模型在复杂逻辑谜题上的规模化行为(scaling behavior)。通过这些多维度的探索,本论文加深了对表征学习的理解,并展示了其在推动更稳健、高效与智能的 AI 系统发展中的潜力。

成为VIP会员查看完整内容