深度卷积神经网络的训练很难,方法很多,有没有可能从中提炼出一条指导性原则呢?加州大学的研究者抛弃暴力搜索方法,试图回归网络最核心简洁的性质。研究作者之一、加州大学伯克利分校马毅教授表示:这应该是真正按原理设计而得到的深度网络。

初始化、归一化和残差连接(skip connection)被认为是训练深度卷积神经网络(ConvNet)并获得最优性能的三大必备技术。

最近,来自加州大学伯克利分校和圣迭戈分校的研究者发布一项研究,

提出不使用归一化和残差连接的深度 ConvNet 在标准图像识别基准上也能实现优异的性能

。其实现方式是:在初始化和训练期间,令卷积核具备近似保距性(near isometric);使用 ReLU 激活函数的变体,实现保距性。

![]()

研究人员进行了大量实验,结果表明此类近似保距网络与残差连接结合后,在 ImageNet 数据集上的性能与 ResNet 相当,在 COCO 数据集上的性能甚至超过 ResNet。而前者甚至都没有应用归一化。

该研究作者之一计算机视觉学者、加州大学伯克利分校马毅教授表示:

这应该是真正按原理设计而得到的深度网络…… 我们这个工作应该是为把深度网络与低维结构密切结合起来的第一步 — 提供了令人信服的实验证据。

靠暴力土豪 trial and error 的方式寻找网络结构的风气,应该会很快过去。

![]()

训练深度 ConvNet 的方法那么多,是否存在指导性原则?

卷积神经网络在计算机视觉领域获得了巨大成功。而深度卷积神经网络能够学习实际复杂数据的决策规则,因而往往能够获得优异性能。

但是深度 ConvNet 的训练本质上是比较有难度的。从最初的权重初始化、特征图归一化和残差学习技术,到后来的大量网络架构组件,如新型非线性激活函数、权重正则化等,深度 ConvNet 训练方法层出不穷。这些技术受到不同角度的启发,如预防死亡的神经元、增强自归一化、减少滤波器冗余、提升泛化性等。

现有的大量架构组件及其多样化的设计原则使得 ConvNet 架构设计成为一项困难的任务。到底结合哪些组件来构建网络呢?

对于非常深层的 ConvNet 的训练,是否存在核心的指导性原则?

Isometric Network (ISONet)

对此,该研究给出的答案是:保距(isometry)。

保距性,即网络中每一层保存前向传播和反向传播的内积,这在深度 ConvNet 的训练中起到关键作用。

为了说明这一点,该研究采用最简方法表明,只要卷积层和非线性激活函数具备近似保距性,则原版深度 ConvNet 网络(即仅由交替卷积和非线性层构成的网络)也可以训练成功。

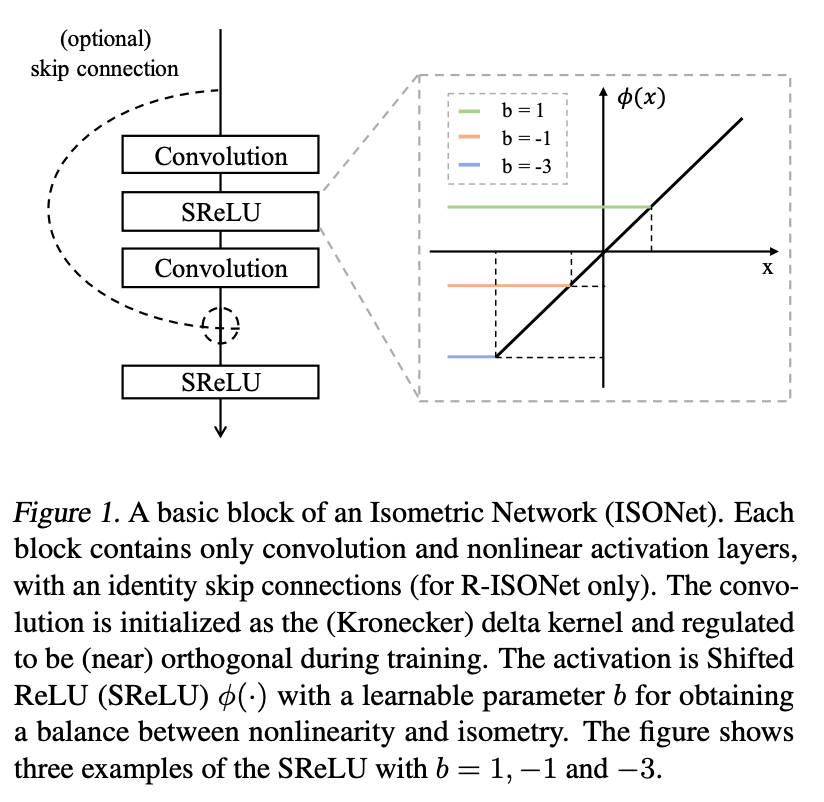

具体而言,该研究设计了 Isometric Networks (ISONet),即在训练过程中将卷积层初始化为 identity,将其正则化为近似正交。此外,非线性层是,将 ReLU 函数围绕原点以可学习参数移动得到的 Shifted ReLU (SReLU),具体架构如下图 1 所示:

![]()

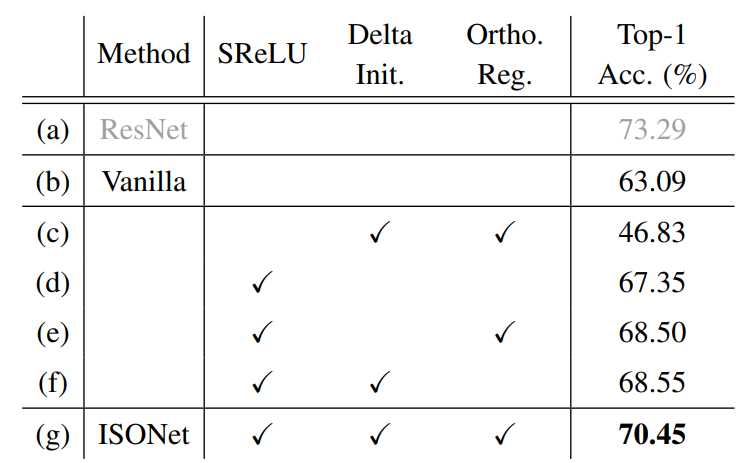

如下表 1 所示,使用 SReLU、Delta 初始化和正交正则化的 Isometric 学习能够在 ImageNet 上训练 ISONet,并且不需要 BatchNorm 和残差连接。可以看到,ISONet 的 Top-1 准确率接近 ResNet。

![]()

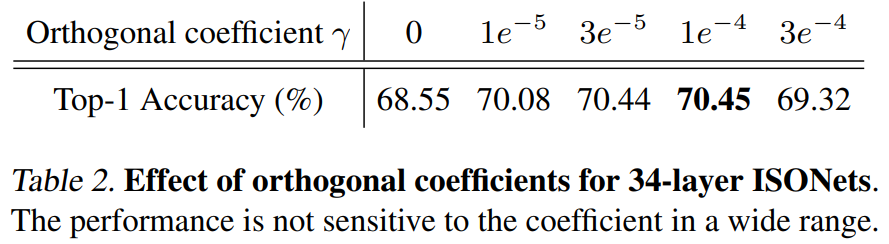

下表 2 为正交稀疏对 34 层 ISONet 的影响,可以看到,当正交系数γ为 1e^-4 时,Top-1 准确率数值最大。

![]()

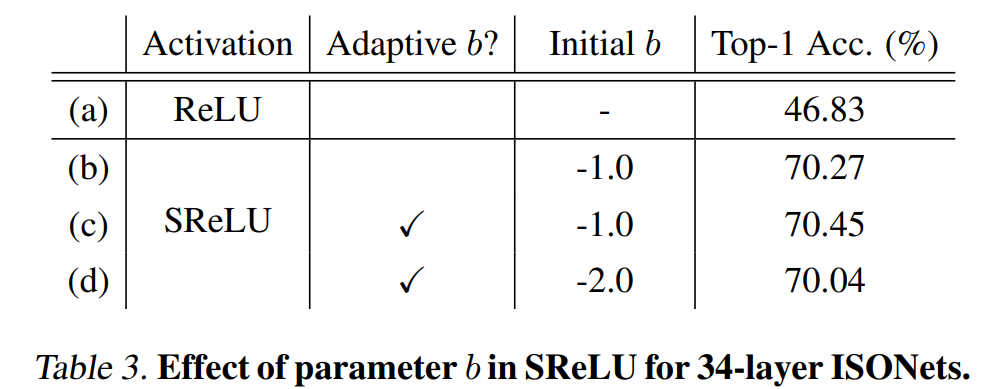

为了验证 SReLU 的设计思路,研究者对 SReLU 中参数 b 对 34 层 ISONet 的影响进行了控制变量研究,结果如下表 3 所示:

![]()

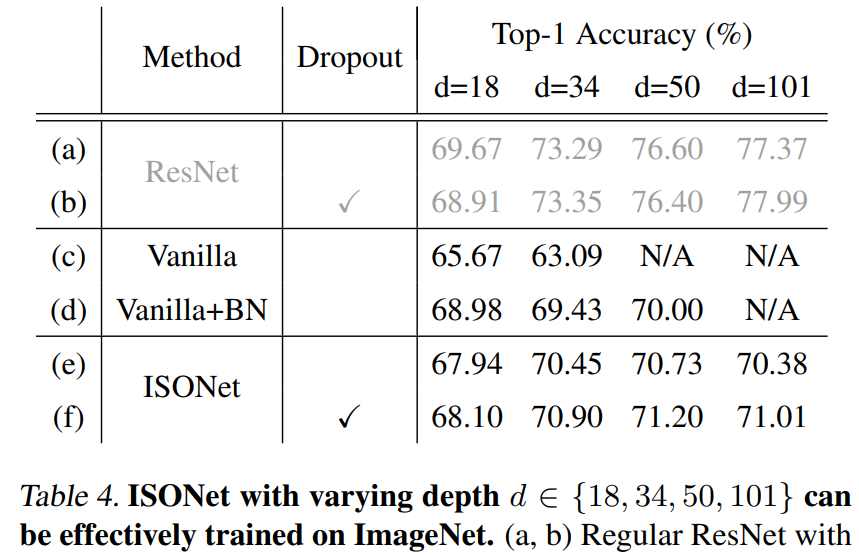

为了验证 isometric 原理在训练深度网络时的有效性,研究者探究了不同层数(18、34、50 和 101)时 ISONet 在 ImageNet 上的 top-1 准确率,结果如下表 4 所示:

![]()

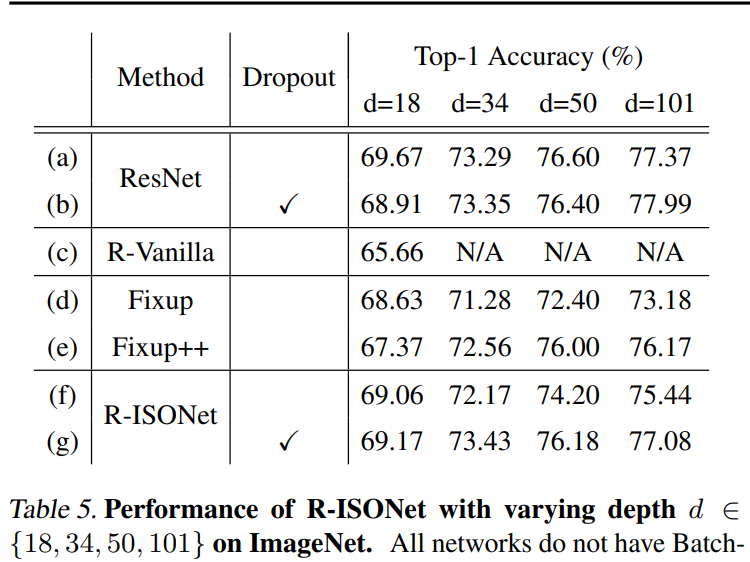

下表 5 展示了不同层数(18、34、50 和 101)时 R-ISONet 与其他方法在 ImageNet 上的 top-a 准确率,结果表明 R-ISONet 性能与使用有 dropout 的 ResNet 相当,并且优于使用混合正则化(mixup regularization)的 Fixup。

![]()

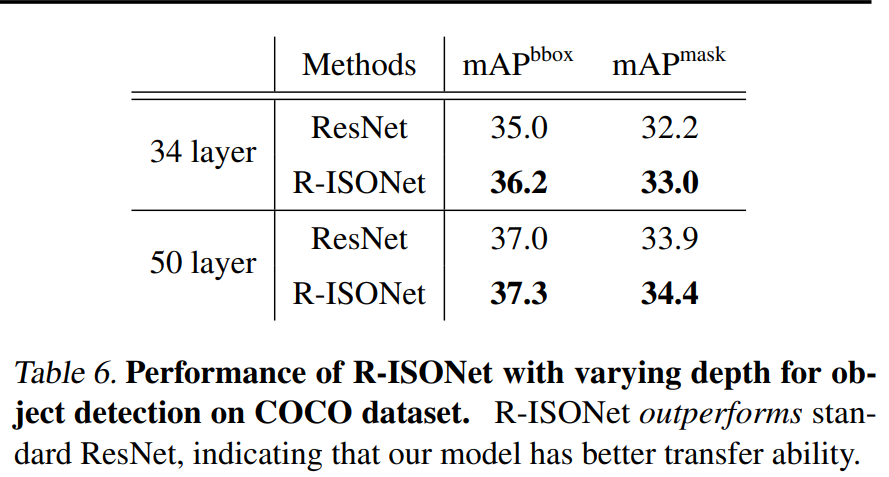

最后,研究者进一步在 COCO 数据集上评估了该方法在目标检测和实例分割任务中的性能,结果如下表 6 所示:尽管在相同深度下 R-ISONet 的分类准确率低于 ResNet,但 R-ISONet 的检测和实例分割性能更优。

这表明 R-ISONet 模型具有更好的特征迁移能力并且可以减轻 BatchNorm 带来的劣势。

![]()

7 月 11 日 09:00-12:00,机器之心联合百度在 WAIC 2020 云端峰会上组织「开发者日百度公开课」,为广大开发者提供 3 小时极致学习机会,从 NLP、CV 到零门槛 AI 开发平台 EasyDL,助力开发者掌握人工智能开发技能。扫描图中二维码,加机器之心小助手微信邀您入群。

![]()