随着我们开始与人工智能系统进行交互,这些系统需要能够以四维(4D)的方式理解视觉世界——也就是说,感知世界中的几何结构和运动。然而,图像空间中像素的差异可能由几何变化(如相机运动)或场景中的运动引起。要从单个视频中分离这两种来源是一项极具挑战性的欠约束问题。在本文中,我构建了多个系统,用于从有限的图像观测中恢复场景表示。具体而言,我研究了一系列问题,逐步解决4D单目恢复问题中的不同方面,每个问题都针对该问题的欠约束特性提出解决方案。首先,我研究了在没有场景运动的情况下,从欠约束输入中恢复形状的问题。具体来说,我提出了pixelNeRF,这是一种从单视图或少量视图合成静态场景新视角的方法。通过在多个场景中训练基于图像特征的三维神经表示,我们学习了一个场景先验。这种学习到的场景先验使得可以从单个或少量图像的欠约束输入中完成三维场景重建。接着,我研究了在没有三维形状的情况下恢复运动的问题。特别是,我提出了Deformable Sprites,一种从输入视频中提取动态场景持久元素的方法。我们将每个元素表示为在视频中变形的二维图像层。最后,我提出了两项关于从单个视频中联合恢复四维世界中形状和运动的研究。首先,我研究了动态人类的特殊情况,并提出了SLAHMR,通过该方法,我们可以从单个视频中恢复所有人的全局姿态以及世界坐标系中的相机位置。然后,我转向从单个视频中恢复任意动态对象的通用情况,在Shape of Motion中,我们将整个场景表示为四维高斯分布。这种表示可以用于动态新视角合成和三维跟踪。

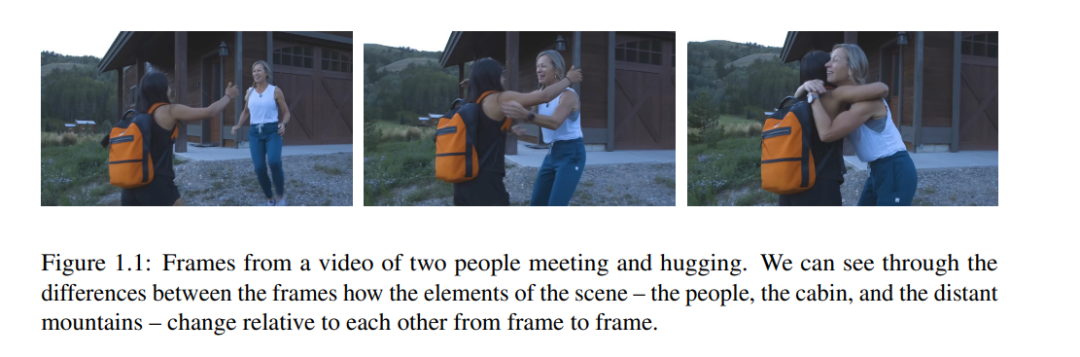

当我们拍摄视觉世界的视频时,所得到的视频是一系列时间切片中该世界的快照。当人们观看此类视频时,他们会感知到被捕捉的世界的四维(4D)特性。也就是说,观众能够理解场景中的元素如何在三维空间和时间上相互关联。 例如,考虑图1.1中的视频,展示了两个人见面并拥抱的场景。观众可以看到穿白衣女子表面上各点在三维空间中的相互关系——这些关系形成了她表面几何形状的整体。观众还可以观察到白衣女子和背橙色背包女子在拥抱时身体各部分的空间关系,这些关系定义了场景中实体的布局。此外,观众还可以看到所有这些关系——无论是她们各自身体表面点之间的关系,还是彼此之间的关系——在时间上的变化,随着两人在山间一座房子前见面并拥抱。 观众能够从单个视频中感知这些四维关系。然而,对于机器来说,视频只是像素的流动。那么,我们是否可以让机器也理解这些关系呢?

1.1 单目4D恢复问题

我们将恢复捕捉场景的时空关系的问题称为4D重建问题。我们将一个四维场景概念化为由三个主要元素组成:静态环境(例如建筑物、街道、田野)、运动的主体(例如人、动物、汽车)以及相机(可能也在移动)。这些元素各自具有其独特的三维几何和外观。此外,由于场景中的元素在移动,每个时间点它们相对于场景中的其他元素都会处于不同的位置。 对于一个静态场景来说,多个投影视角之间的二维像素变化可以用来通过三角测量方法恢复底层的三维形状 [56]。对于一个动态变化的场景,可以在每个时间点应用同样的关系,通过多个投影视角恢复三维形状。这种方法中,同时视角之间的像素变化仍然仅与三维形状相关。 然而,单个视频仅在每个时间点捕捉到这个演变中的四维世界的二维投影视图。这带来了一个根本性挑战:视角间的像素变化可能来自三维形状(由于视角变化),也可能来自场景运动。那么,我们如何将形状与运动分离? 尽管如此,视频观众却能够在每个时间点仅通过单个观测推断出场景元素的形状和运动。这种显而易见的模糊性下,观众却能轻松地理解这些四维关系。那么,我们如何设计系统,使其能够做到同样的事情?

1.2 研究贡献

在本文中,我构建了多个系统,从有限的图像观测中恢复场景表示。具体来说,我研究了一系列逐步解决单目4D恢复问题的恢复问题,每个问题针对该问题的欠约束特性提出了不同的解决方案。 在第二章中,我研究了静态场景的三维重建问题,即在没有运动的情况下恢复形状。具体而言,我们通过使用多视角数据训练一个基于图像条件的三维表示,学习如何合成静态场景的新视角。在第三章中,我研究了动态场景中运动的恢复问题,即在没有三维形状的前提下,恢复单个视频中的二维运动元素。我们将这些元素建模为随时间变形的持久二维图像层。 接下来,我重点研究从单个视频中同时恢复形状和运动的问题。在这一背景下,核心挑战在于从视频中观察到的像素变化中分离几何和运动的影响。在第四章中,我研究了动态人类这一特殊情况,以解决人类拍摄视频中最常见的复杂运动来源。我们直接使用参数化的人体形状和运动先验来指导三维形状和运动的恢复。在第五章中,我研究了从任意视频中恢复任意动态对象的问题。在这里,我们用单帧的单目深度估计和二维对应关系代替参数化先验,以指导形状和运动的分离。在这两个研究中,我们都通过全局优化恢复了场景的四维表示。