基于信息理论的机器学习-中科院自动化所胡包钢研究员教程分享03(附pdf下载)

点击上方“专知”关注获取专业AI知识!

【导读】专知于11月24日推出胡老师的基于信息理论的机器学习报告系列教程,大家反响热烈,胡老师PPT内容非常翔实精彩,是学习机器学习信息理论不可多得的好教程,今天是胡老师为教程的第三部分(为第四章内容)进行详细地注释说明,请大家查看!

▌概述

本次tutorial的目的是,1.介绍信息学习理论与模式识别的基本概念与原理;2.揭示最新的理论研究进展;3.从机器学习与人工智能的研究中启发思索。由于时间有限,本次只是大概介绍一下本次tutorial的内容,后续会详细介绍每一部分。

胡老师的报告内容分为三个部分:

引言(Introduction)

信息理论基础(Basics of Information Theory)

二值信道的理论进展(Theoretical Progress in Binary Channel)

分类评价中的信息度量(Information Measures in Classification Evaluation)

贝叶斯分类器和互信息分类器(Bayesian Classifiers and Mutual-information Classifiers)

总结和讨论(Summary and Discussions)

想了解基于信息理论的机器学习报告系列教程,请阅读专知以前推出的报道:

2. 基于信息理论的机器学习——中科院自动化所胡包钢老师教程分享02(附pdf下载)

胡包钢研究员个人主页:

http://www.escience.cn/people/hubaogang/index.html

胡包钢老师简介:

胡包钢老师是机器学习与模式识别领域的知名学者,1993年在加拿大McMaster大学获哲学博士学位。1997年9月回国前在加拿大MemorialUniversity of Newfoundland, C-CORE研究中心担任高级研究工程师。目前为中国科学院自动化研究所研究员。2000-2005年任中法信息、自动化、应用数学联合实验室(LIAMA)中方主任。

▌PPT

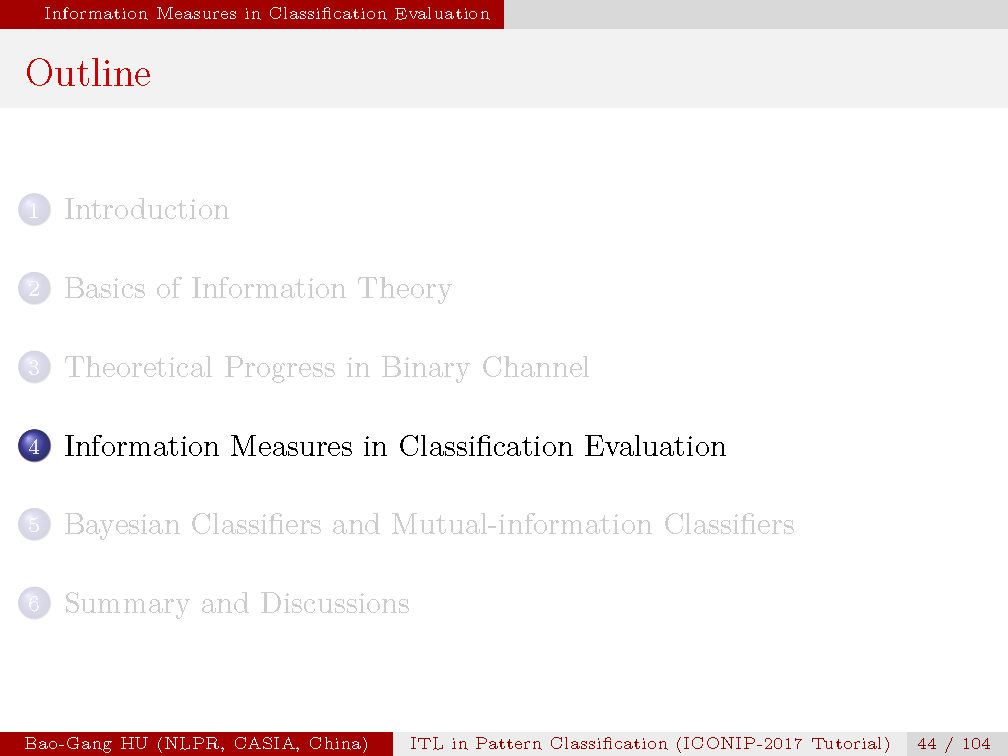

Mackay 2003年首次提议可以应用互信息来评价混淆矩阵优劣。他给出了二值分类中的两个混淆矩阵。矩阵最右一列代表了拒识类别。他没有给出具体计算公式与计算结果,但是他的例题以及提议已经表明只有互信息能够提供有效评价。我们这一章介绍的内容正是受该例题启发。在此也致谢当时课题组杨余久同学(博士)提供的该例题信息。

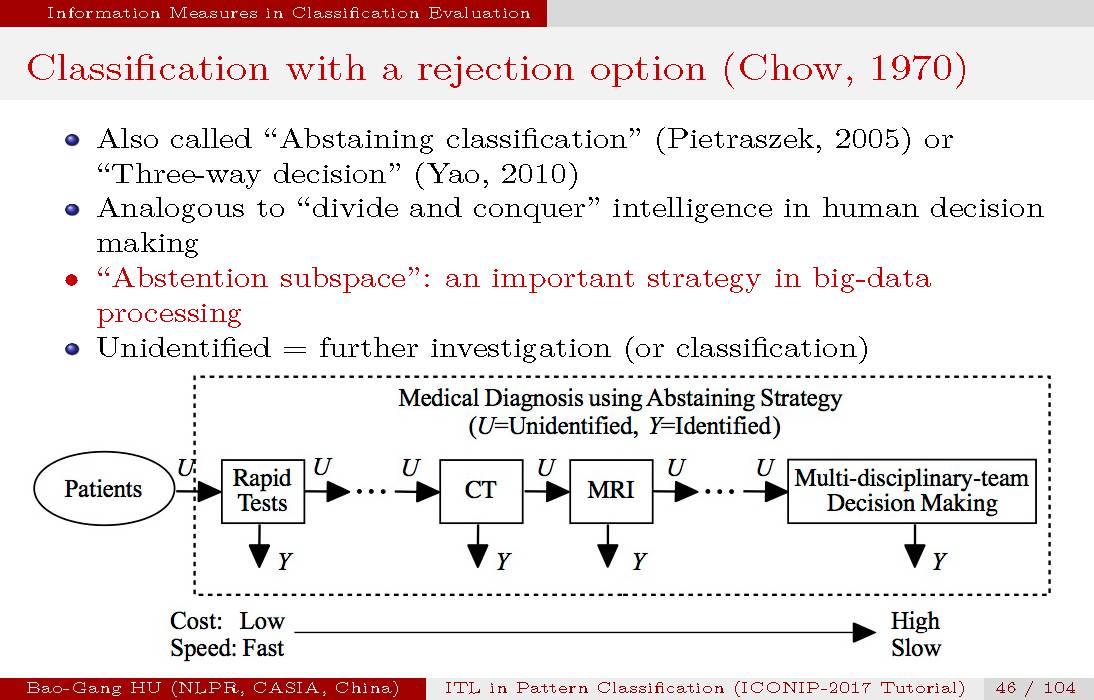

华人学者周绍康(Chow, C.K.)于1970年首次发展了拒识分类的基础研究工作。机器学习研究领域中又称为“弃权分类”,粗糙集研究领域中又称为“三支决策”。

拒识是人类智能中的重要决策方法之一,体现了大数据处理中的“分而治之”策略。如医学诊断中的“疑似病人”即对应了“拒识类别”。

机器学习应用中有所要考虑误差类别,特别是当小类概率很小时。为此,我们首次提出了误差类别与拒识类别同时考察的问题,并开展初步研究。

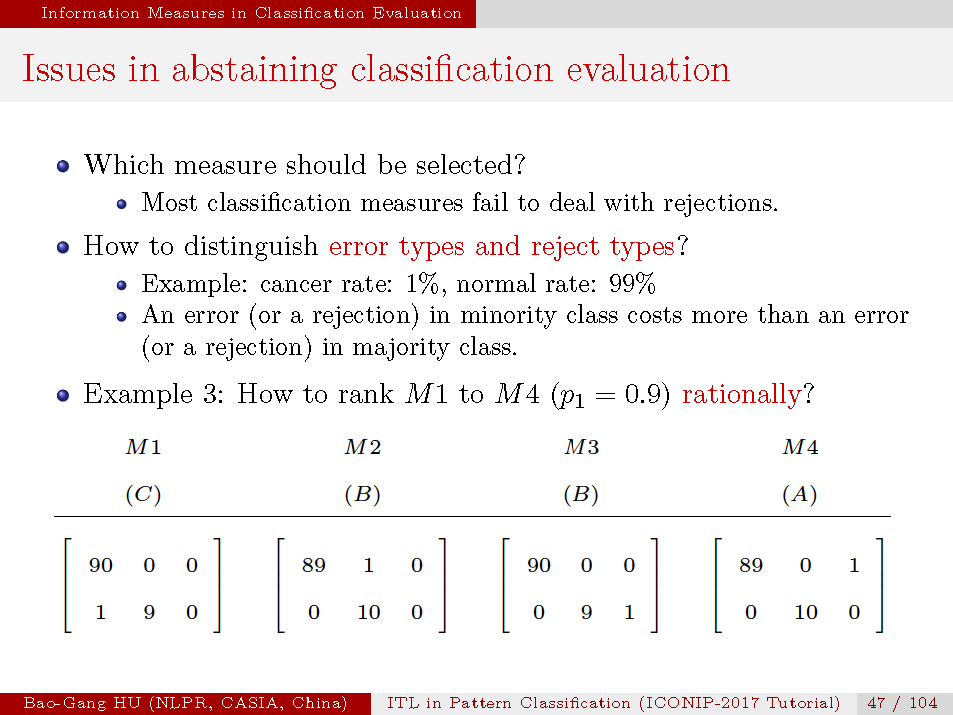

初始考察二值分类中的四个典型混淆矩阵。分别对应了不同误差与拒识类别。

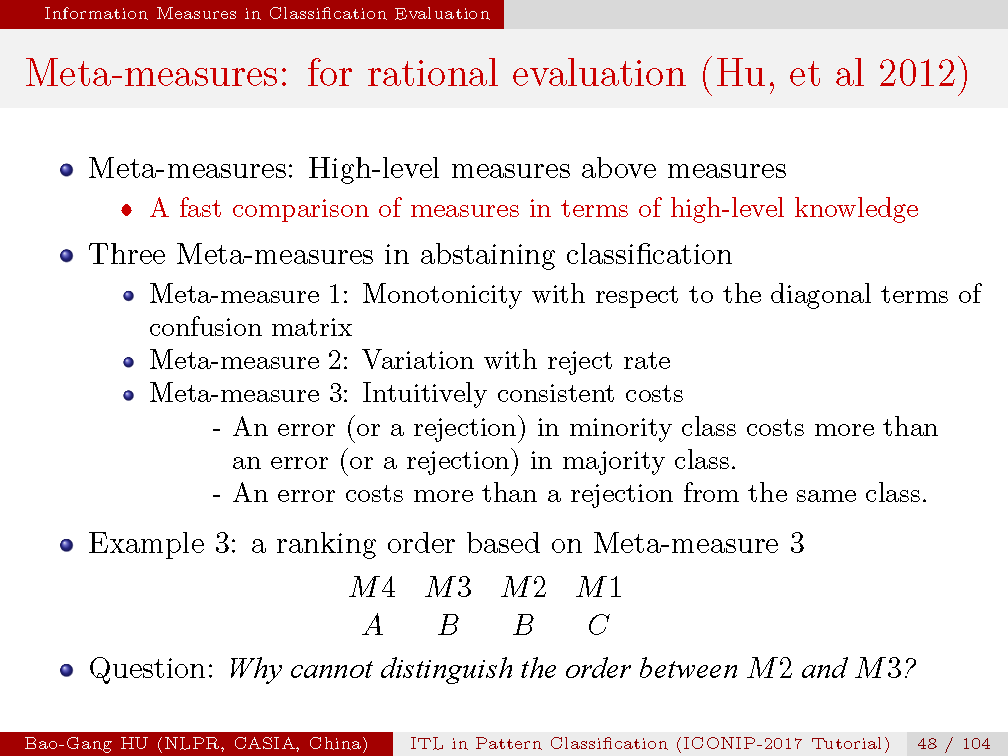

在分类结果评价中,我们首次提出了“元准则”的概念与具体内容。如果将分类结果评价准则视为底层准则,那么“元准则”是关于底层准则高层知识评价的准则。“元准则”将有利于快速比较底层准则在规定考察特征上的不同。

针对拒识分类,我们提出了三个具体“元准则”用于考察底层准则的三个特征内容。分别是:Meta1. 能够与混淆矩阵对角线元素呈现单调关系。Meta2. 与拒识率相关。Meta3. 与人类分类直觉以下内容相符:小类中的一个误差(或拒识)将比大类中的一个误差(或拒识)代价更高;同类中的一个误差将比一个拒代价更高。由M3可以对四个混淆矩阵进行排序。思考为什么M2与M3无法区分,列为同序B?“元准则”可以理解为是期待底层准则要尽量可以包容的特征。Meta3是对Meta2的进一步期待要求。

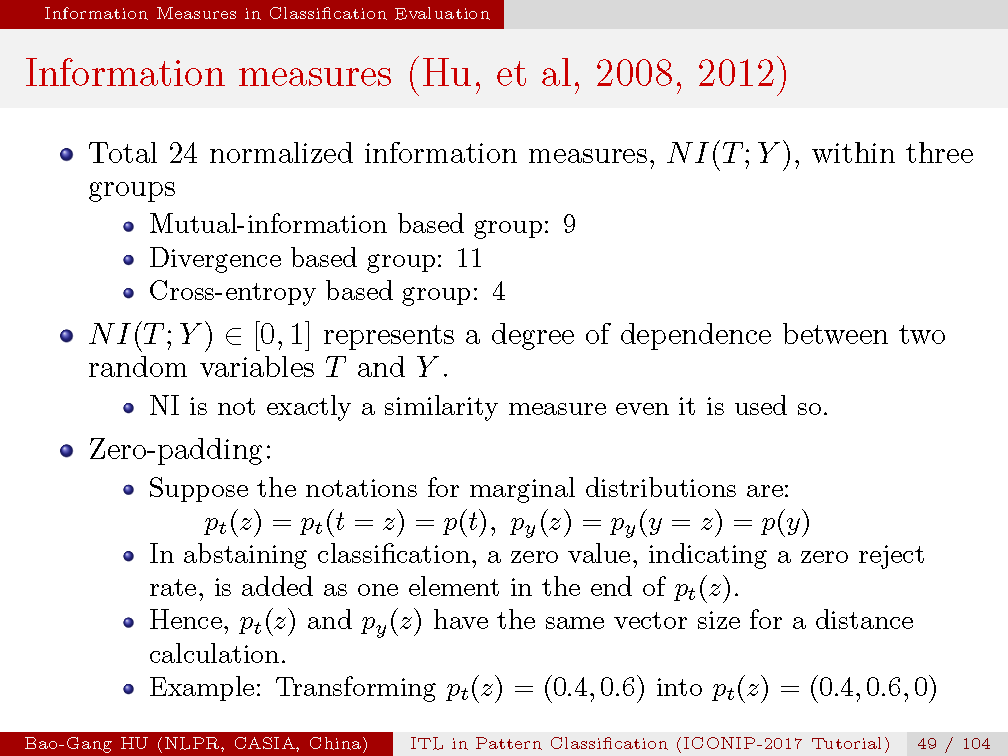

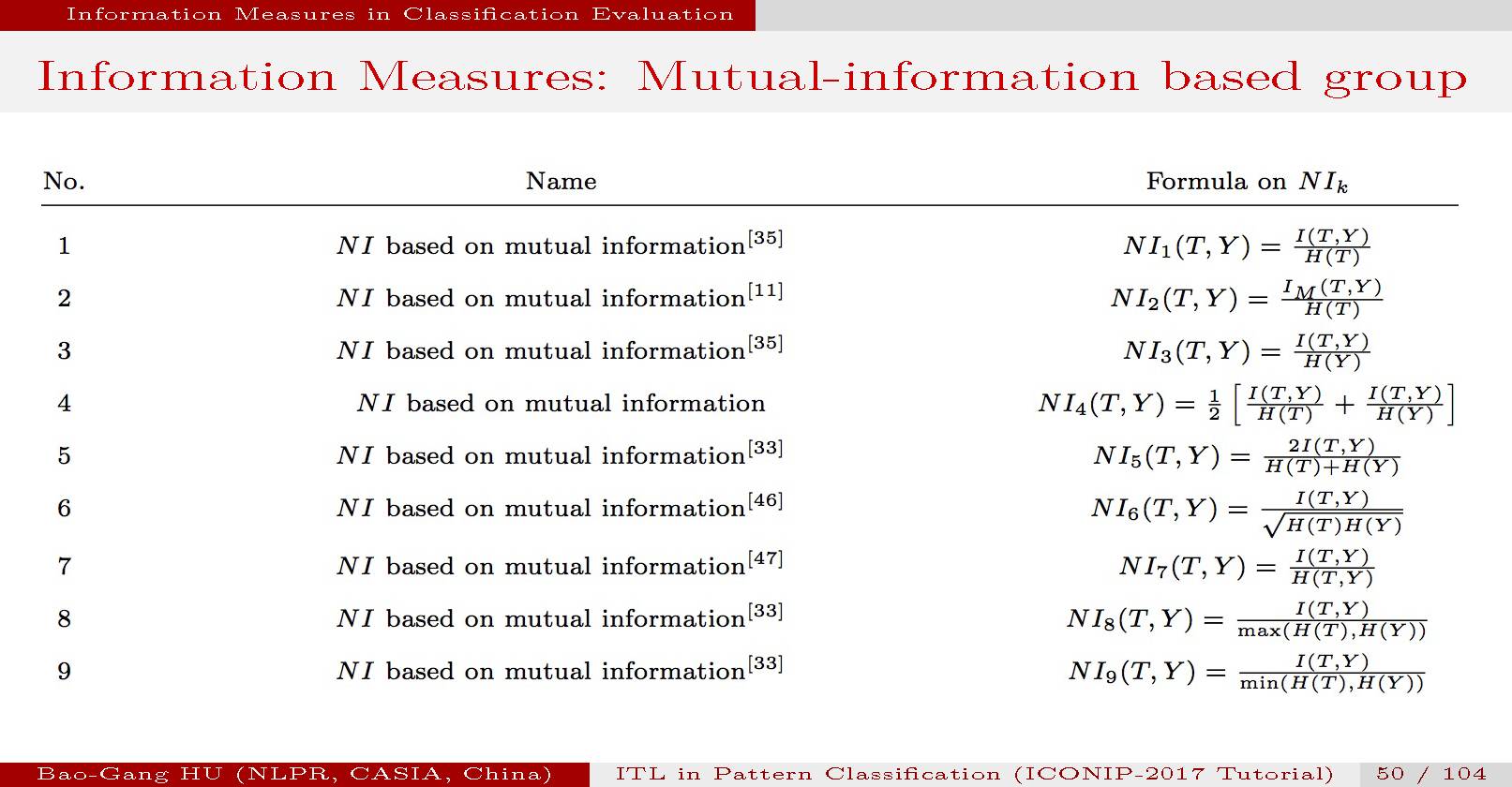

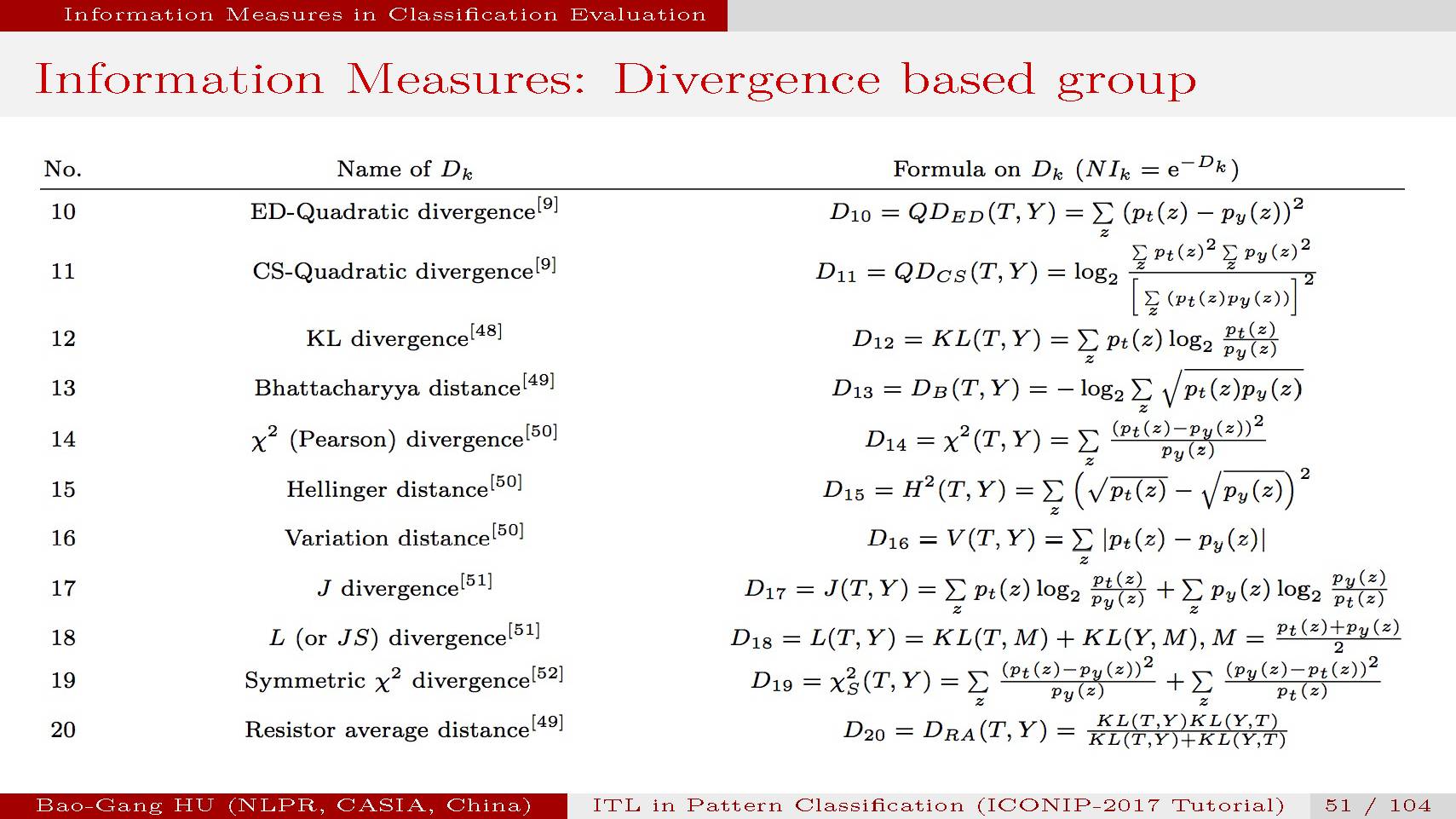

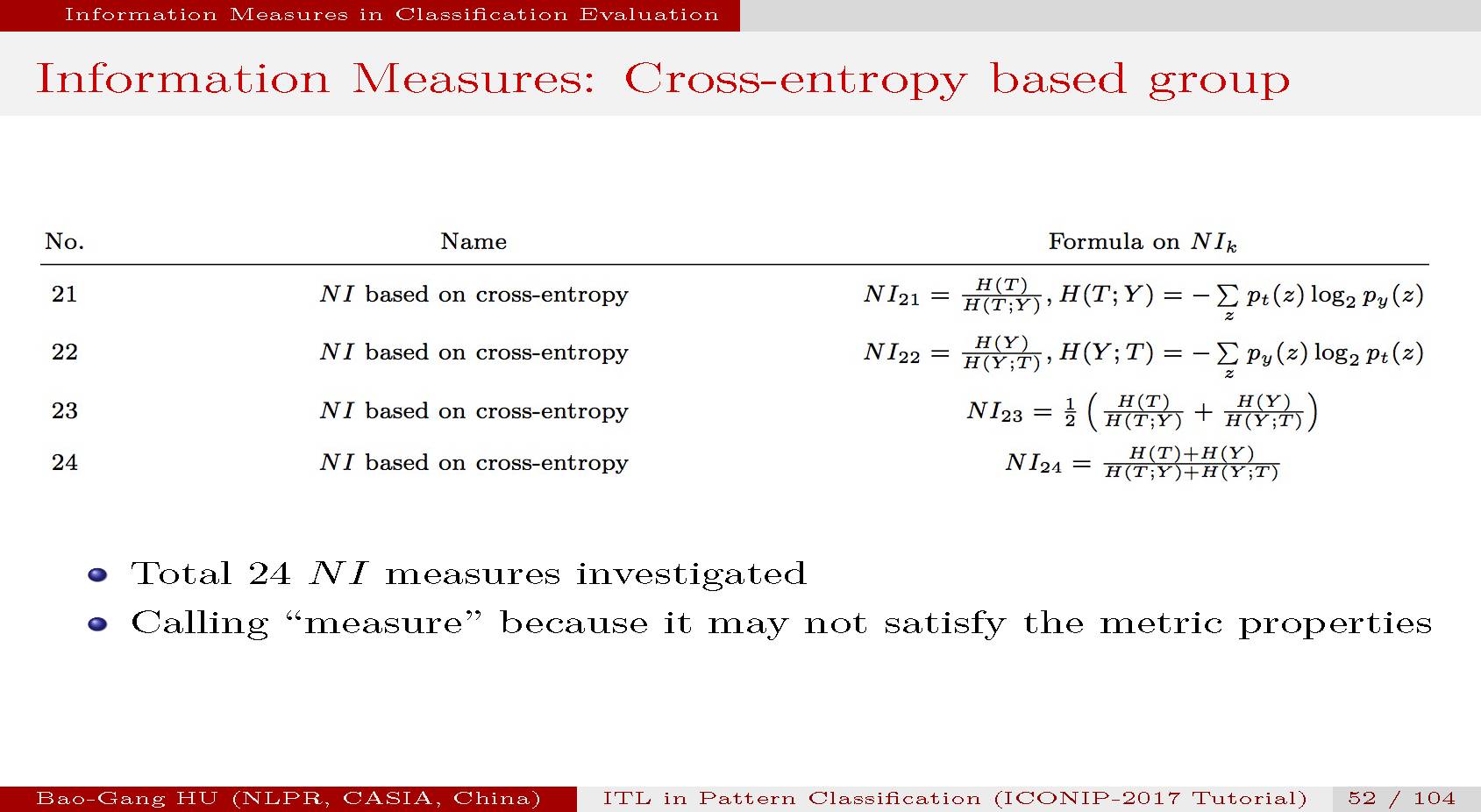

基于互信息,信息散度,交叉熵这三种定义,采用不同的归一化计算公式,我们构造并考察了24个信息论指标。NI(T;Y)=0代表两个变量为完全独立,NI(T;Y)=1为两个变量为完全相关。

NI虽然是相关性的考察,它也部分反映了两个变量之间的相似性程度。由于拒识分类中混淆矩阵不是方阵,它们的两个边缘概率会出现长度不同。为此,通过“加零”方式来获得相同长度的边缘概率。该操作是符合物理意义的。

分别给出了各个信息论指标的具体数学定义。

由于其中有些NI不满足度量的规定属性(如对称性),我们称题目为“指标”而非“度量”。

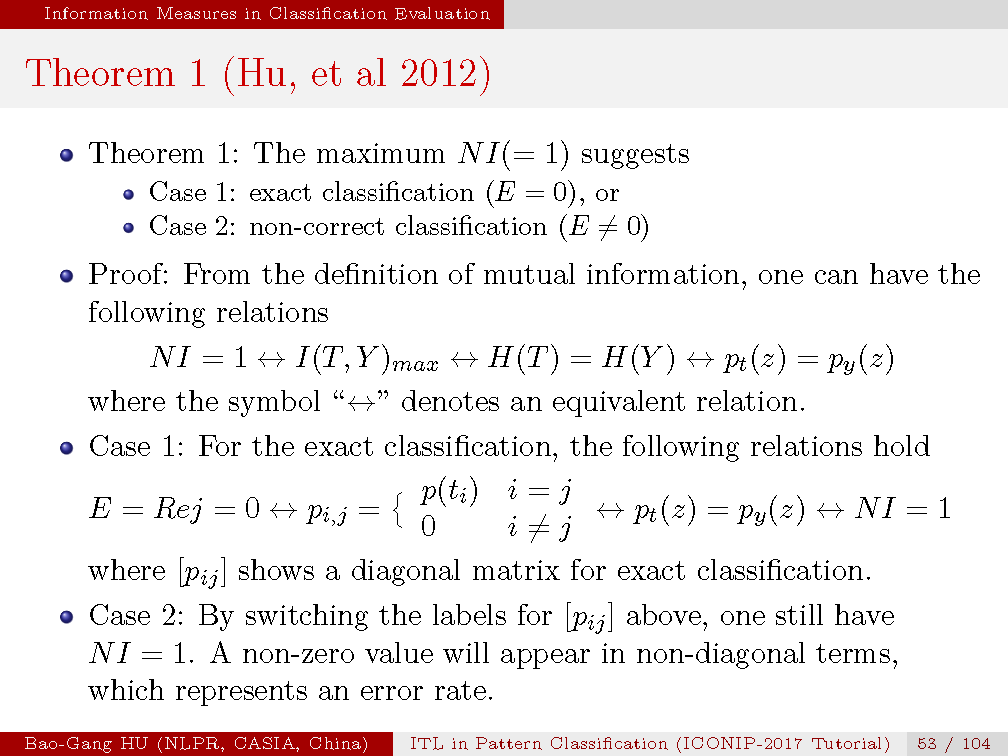

定理1:NI(T;Y)=1分别对应完全正确分类,或包含误差的特定分类。

这个特定分类是指调换类标能够获得完全正确分类。

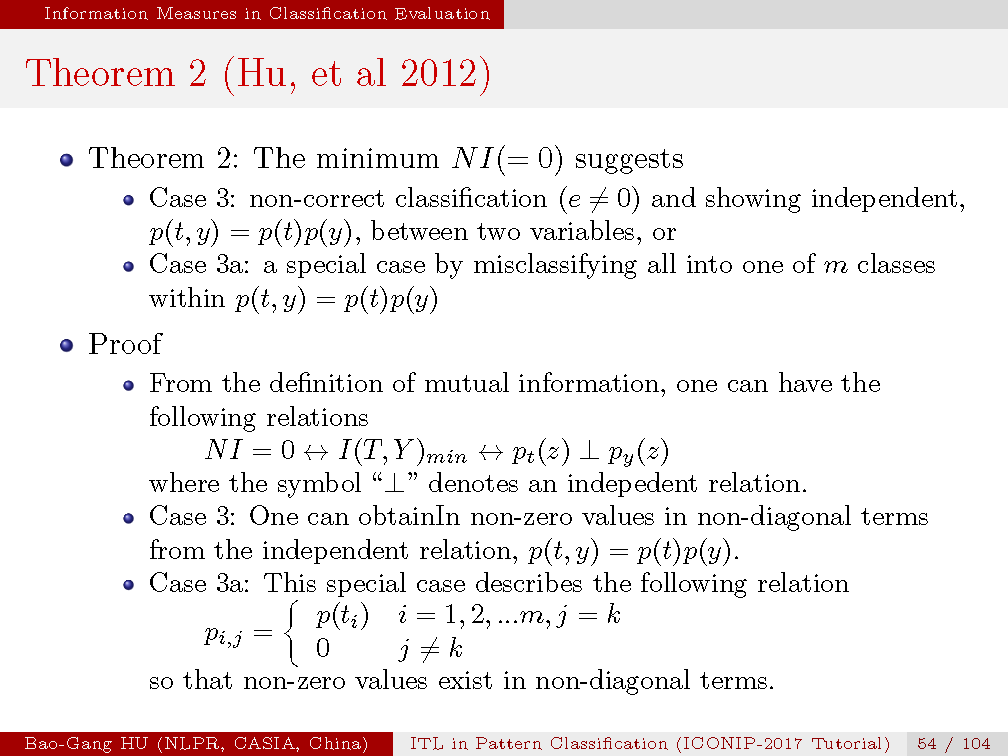

定理2:NI(T;Y)=0对应了两个变量为完全独立,并必然分类误差的分类结果。

其中一个分类特例是将全部样本分为某一类。

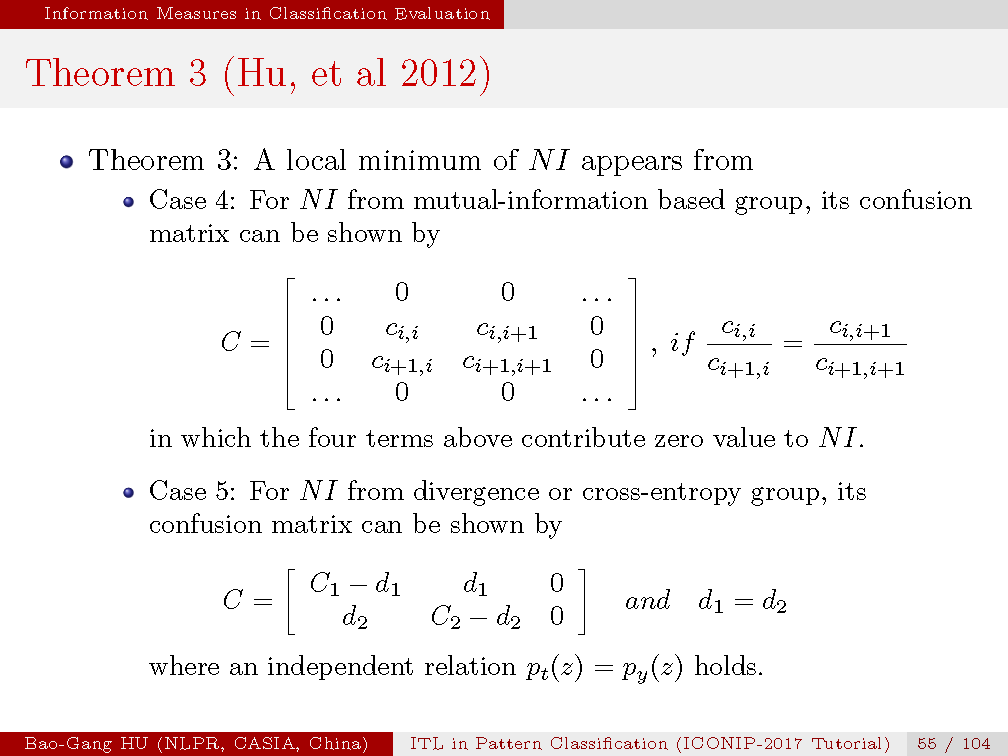

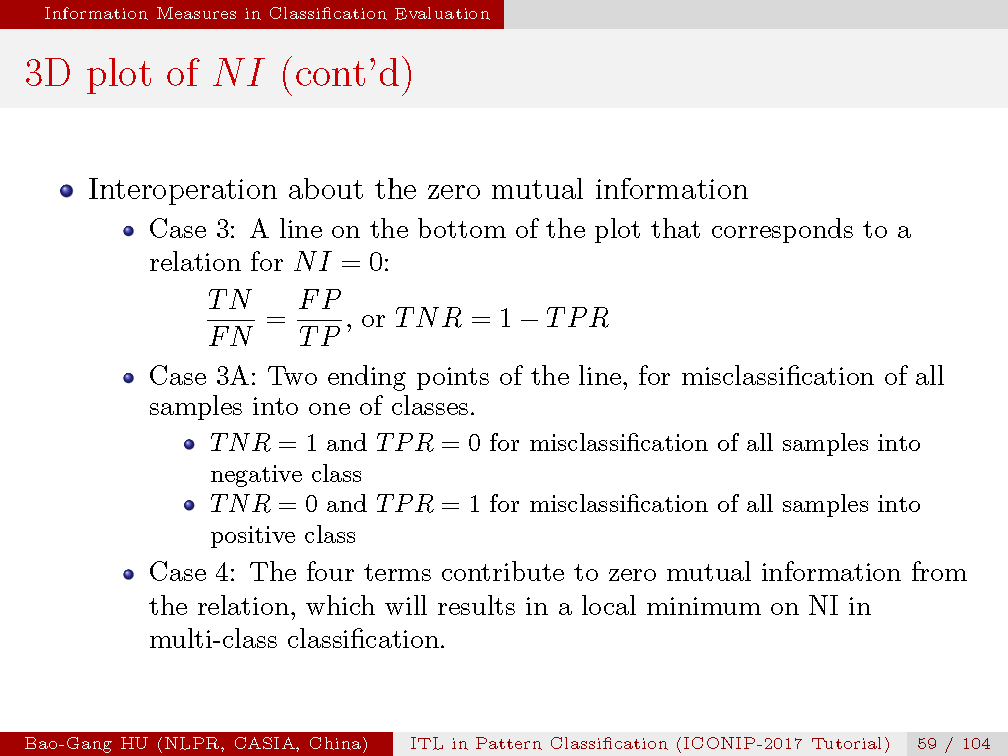

定理3:NI(T;Y)的局部性极值。对于互信息类指标,混淆矩阵中每个元素都应该对互信息值产生贡献。但是 Case 4 中混淆矩阵中若该四个元素有如此特定关系时,它们的互信息值贡献将为零。

由此产生互信息类指标的局部性极值。而对于信息散度与交叉熵类指标,我们给出了二值分类为特例说明,当两个边缘概率相同时,而混淆矩阵中误差不同,可以产生多种情况极值。

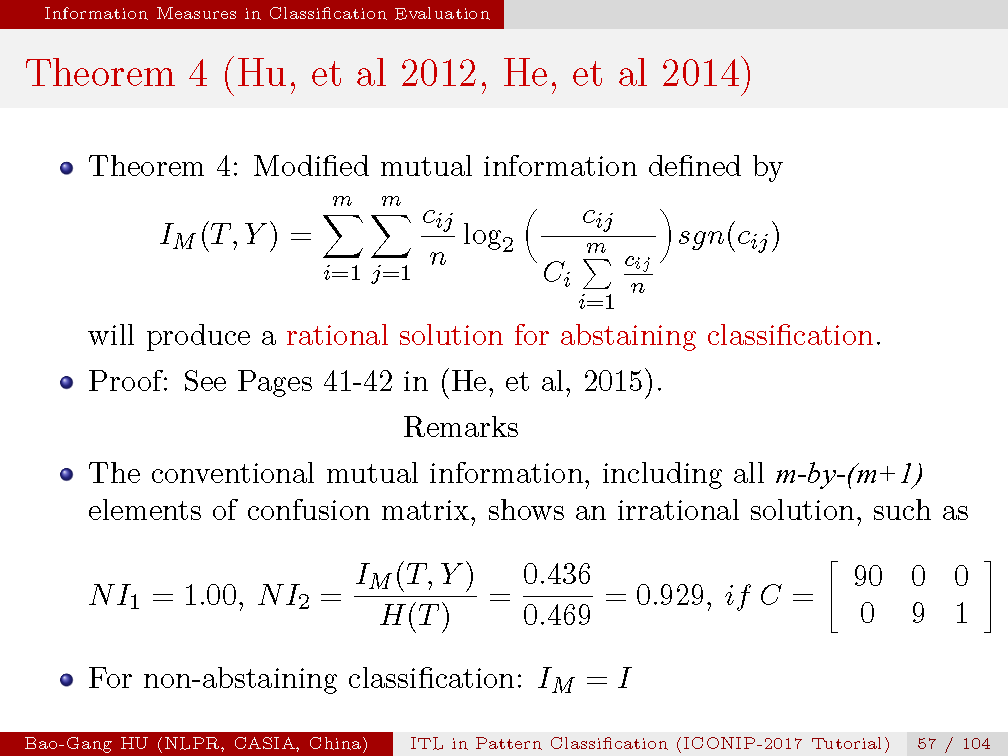

定理4:互信息的修正计算公式。拒识分类中混淆矩阵虽然是m乘m+1个元素,但是我们修正其互信息列单元元素计算中不包括最后一列(即拒识类别)。由此将会获得更为合理的分类评价结果。

我们给出了例题显示虽然有拒识,如果应用常规互信息计算公式NI=1(表明完全正确分类),而修正公式给出NI=0.929(表明非完全正确分类)。该例题也说明机器学习会对信息理论提出新的定理与应用需求。当混淆矩阵为方阵时, 互信息的修正计算公式等同于常规互信息计算公式。

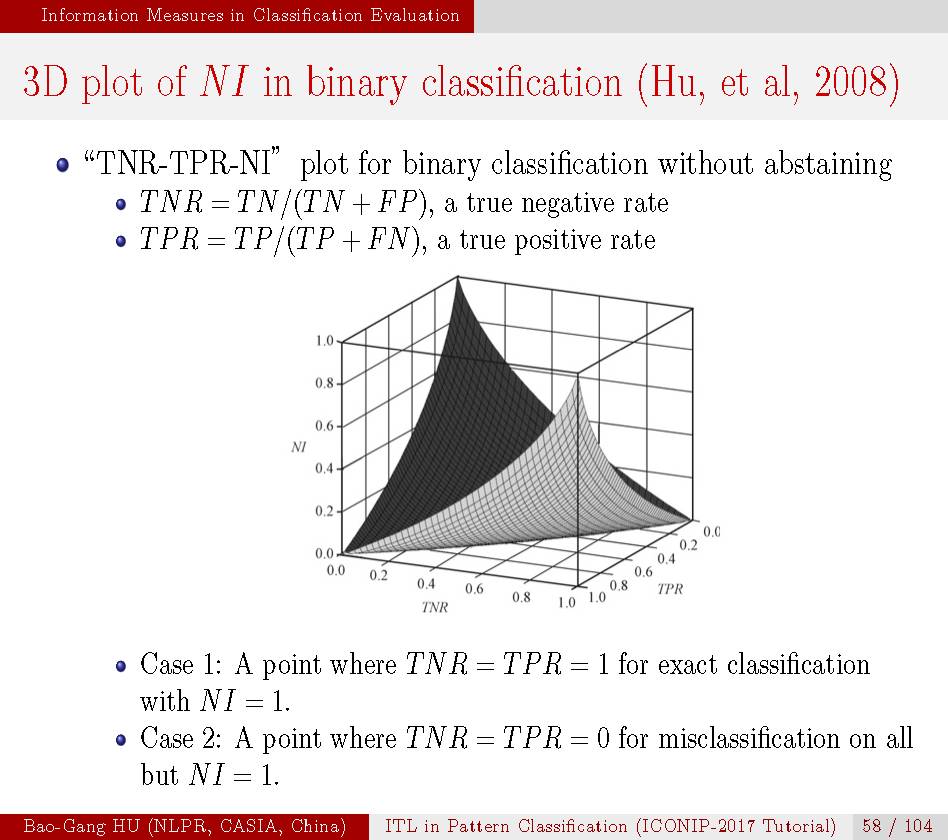

对二值分类中NI(TNR, TPR)函数作三维图。其中TNR是真阴性率,TPR是真阳性率。

图中明确显示了NI在两个点获得最大值,分别对应了完全正确分类与完全错误分类(但是调换类标可以获得完全正确分类,由此意味信息论指标与类标无关)。

NI(TNR, TPR)三维图中有NI=0,为三维图中的一条线,该线的数学关系式即由定理3中Case 4 给出。

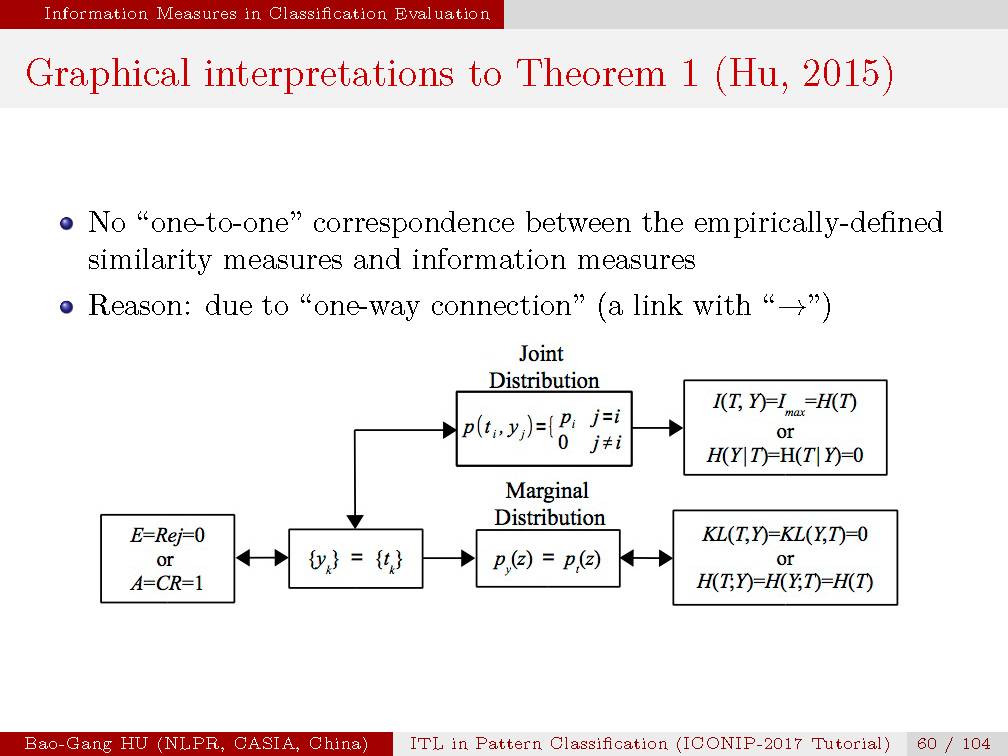

该图示意了完全正确分类与信息论指标的关联。理解它十分重要。完全正确分类必然导致信息论指标为极值。反之则不然。因为它们之间没有“一对一”的关系。

我们应用“双向连接”表示“一对一”关系,“单向连接”表示“无一对一”关系。应用本章中的定理可以看出“单向连接”发生的部位。该图说明了机器学习中简单的应用学习论指标不能够必然导致完全正确分类(或误差最小)。

定理3的内涵。该定理反映24个信息论指标都不符合元准则1,即评价指标函数应该能够与混淆矩阵对角线元素呈现单调关系。我们知道混淆矩阵对角线元素直接反映了两个变量直接的相似性度量。

该定理说明简单地将信息论指标作为相似性(或非相似性)度量是有问题的。事实上,机器学习中会发现大量应用互信息等信息论指标来实现相似性度量的研究工作。如图像配准,特征选取等。当我们应用这些指标时,应该知道它们的缺陷。

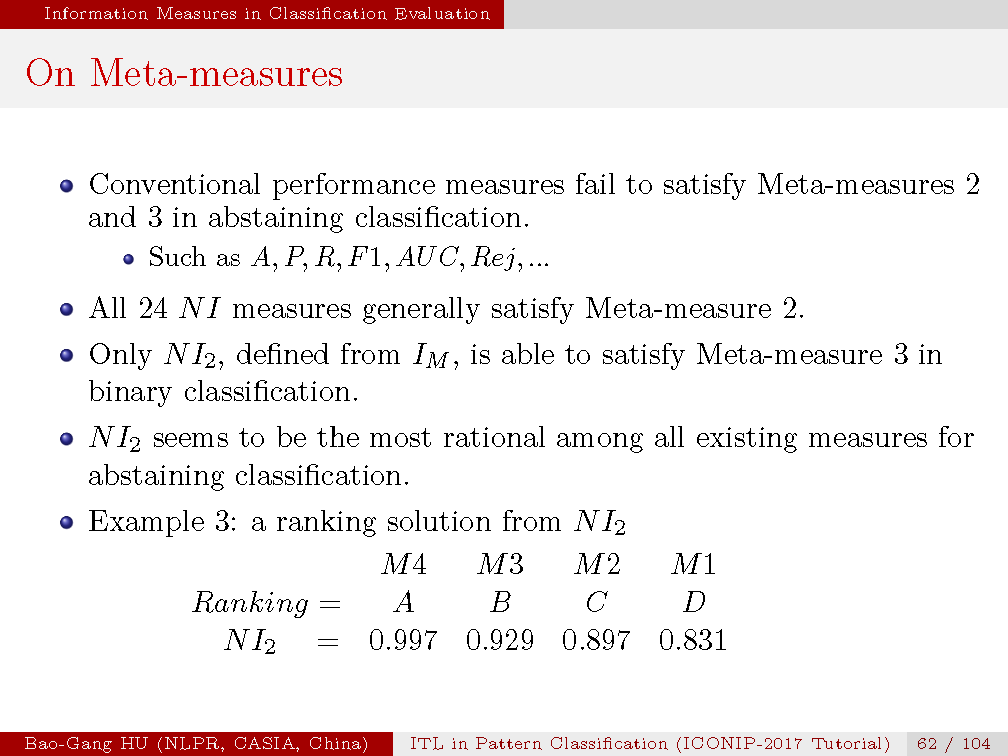

我们对48页中给出的四个混淆矩阵进行具体计算考察,其中常规的分类评价指标也与24个信息论指标一起应用。

我们发现第二个信息论指标应用了修正的互信息计算公式最为适用于拒识分类评价。

参见该指标对四个混淆矩阵的输出计算值,由此给出它们分类质量的排序符合元准则3。而其它任何指标基本不适用于拒识分类评价。

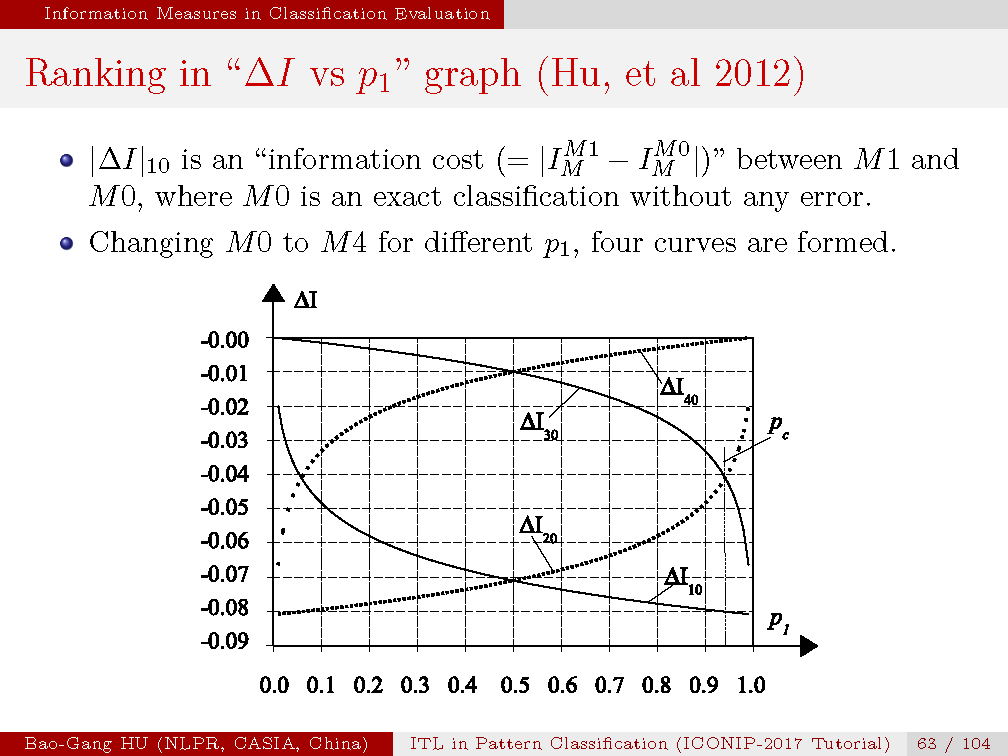

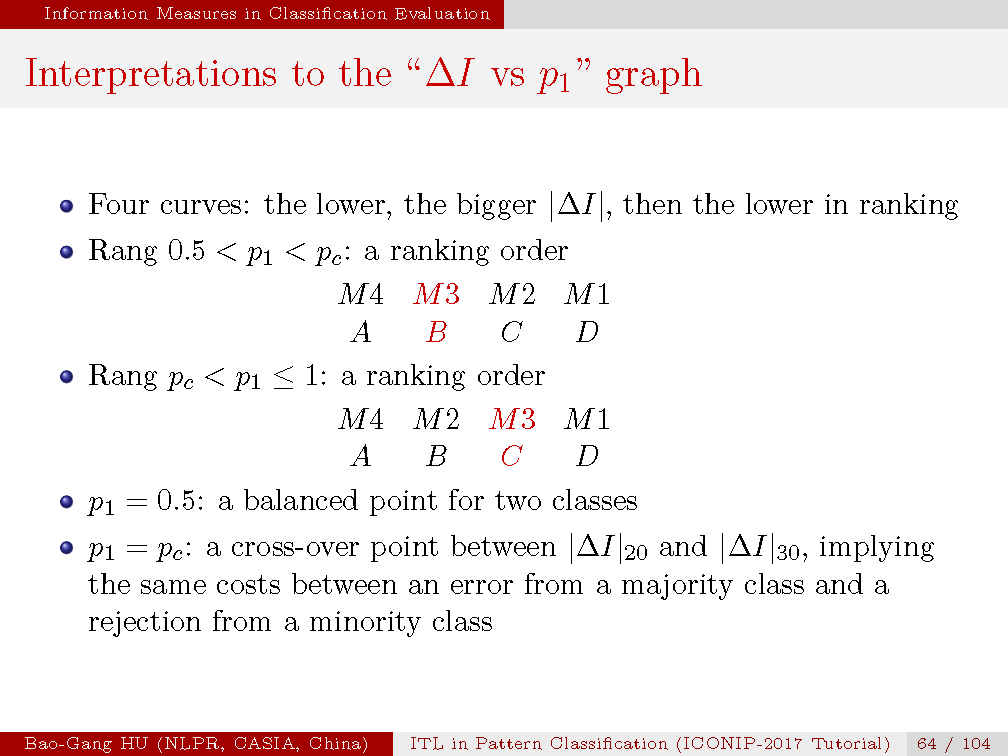

为此我们对第二个信息论指标进行了排序变化的考察。图中横坐标为一类样本的概率p1,纵坐标为互信息差,我们以完全正确分类的互信息值为基点(对应图中的顶端横线),四个混淆矩阵的互信息值与基点的差值的绝对值我们可以称为“信息代价”, 对四个混淆矩阵我们同时改变样本的概率p1,可以作出四条曲线。

越为远离基点的曲线“信息代价”越大。p1=0.5为类别样本平衡点。我们可以观察到在p1=pc处,小类一个拒识与大类一个误差具有等同的“信息代价”。

当p1<pc时,小类一个拒识的“信息代价”低于大类一个误差的的“信息代价”

当p1>pc时,小类一个拒识的“信息代价”高于大类一个误差的的“信息代价”

另两个曲线产生的排序不发生变化

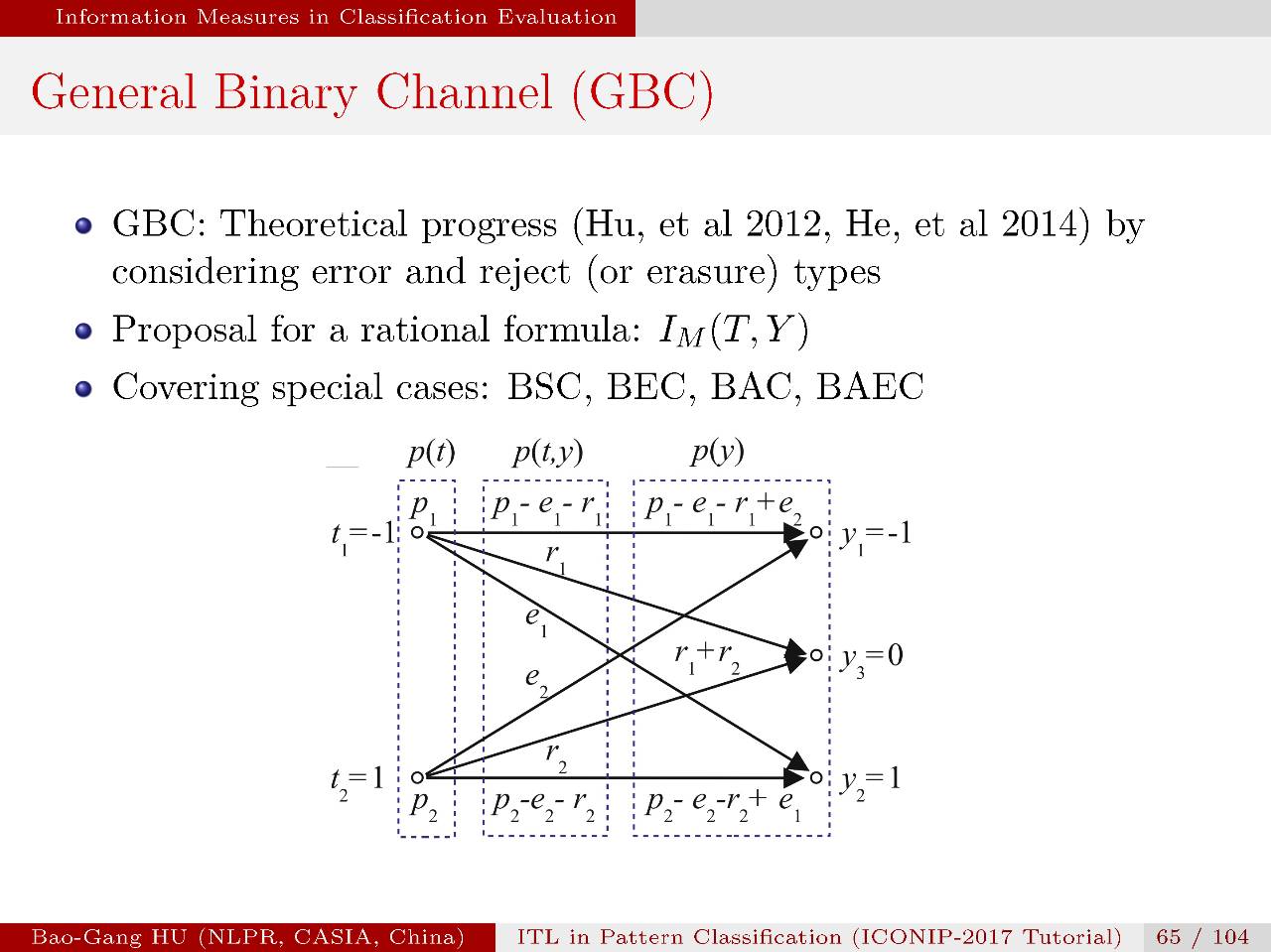

信息论或通信理论中将分类学习中拒识类别称为“擦除”,并有称呼“二值擦除信道”。对应“通用二值信道”我们提出了修正的互信息计算公式,能够给出更为合理的结果。

目前信息论或通信理论中定义的各种二值通道成为信息论或通信理论中的特例。这也成为机器学习对信息论发展的基础贡献。

第4章总结

不同于已有的“分而治之”各种方法,要理解拒识决策为机器学习带来了新的研究空间,而拒识子空间研究工作仍有不足。拒识分类方式符合人类的智能决策原理。先将好判断的快速筛选掉,留下“疑似”的来不断增加证据(如更多特征)或昂贵工具(如多专家会诊)获得更为可靠的结果。由此如何“合理”评价拒识分类是个理论与应用方面的问题。根据“丑小鸭定理”,我们首次提出了显式表达的“元准则”策略方法。该思想可以推广到机器学习其它问题研究中(如2015年我们在TKDE上发表的一篇文章,“元准则”特别适用于解决无监督排序学习中没有标准答案的问题)。本章在拒识决策中从“误差类别”与“拒识类别”同时考察的角度展开研究。这也是来源于应用中的问题。由于常规分类评价指标已经无法适用于拒识结果评价,我们对24个信息论指标进行系统性考察。其中包括推导了4个定理,分别对信息论指标的特征或局限性予以考察。我们发现只有一个指标更为适用,但是仍然存在缺陷。

本章关键要点:信息论指标与传统误差指标不存在“一对一”关系。这与第3章要点一致,但是本章的前三个定理对于理解信息论指标为优化目标的缺陷是十分重要的(包括对抗网络GAN中应用了KL散度指标)。

本章最后为有兴趣的研究者指出一个我们未能解决的的(挑战性?)问题:“在拒识分类中,如何设计或发展能够同时满足三个元准则的分类评价指标”?( 信息论或经验性指标都可以)。

第四部分的分类评价中的信息度量进展结束了,敬请期待下一期内容。

特别提示-信息论报告下载:

请关注专知公众号(扫一扫最下面专知二维码,或者点击上方蓝色专知),

后台回复“ITL” 就可以获取胡老师报告的pdf下载链接~

-END-

专 · 知

人工智能领域主题知识资料查看获取:【专知荟萃】人工智能领域25个主题知识资料全集(入门/进阶/论文/综述/视频/专家等)

同时欢迎各位用户进行专知投稿,详情请点击:

【诚邀】专知诚挚邀请各位专业者加入AI创作者计划!了解使用专知!

请PC登录www.zhuanzhi.ai或者点击阅读原文,注册登录专知,获取更多AI知识资料!

请扫一扫如下二维码关注我们的公众号,获取人工智能的专业知识!

请加专知小助手微信(Rancho_Fang),加入专知主题人工智能群交流!

点击“阅读原文”,使用专知!