【导读】可解释性是当前AI研究的热点之一。伦敦大学学院Pasquale Minervini博士在可解释AI研讨会做了关于可解释高效可验证表示的报告《Back to Seminars Explainable, Verifiable, Relational Representation Learning from Knowledge Graphs》,共62页PPT,涵盖知识图谱中链接预测,以及可解释可验证表示学习机制。

https://europe.naverlabs.com/research/seminars/explainable-verifiable-relational-representation-learning-from-knowledge-graphs/

Pasquale Minervini,英国伦敦大学学院统计自然语言处理和机器学习Senior Research Associate。

http://www.neuralnoise.com/

可解释、数据有效、可验证的表示学习

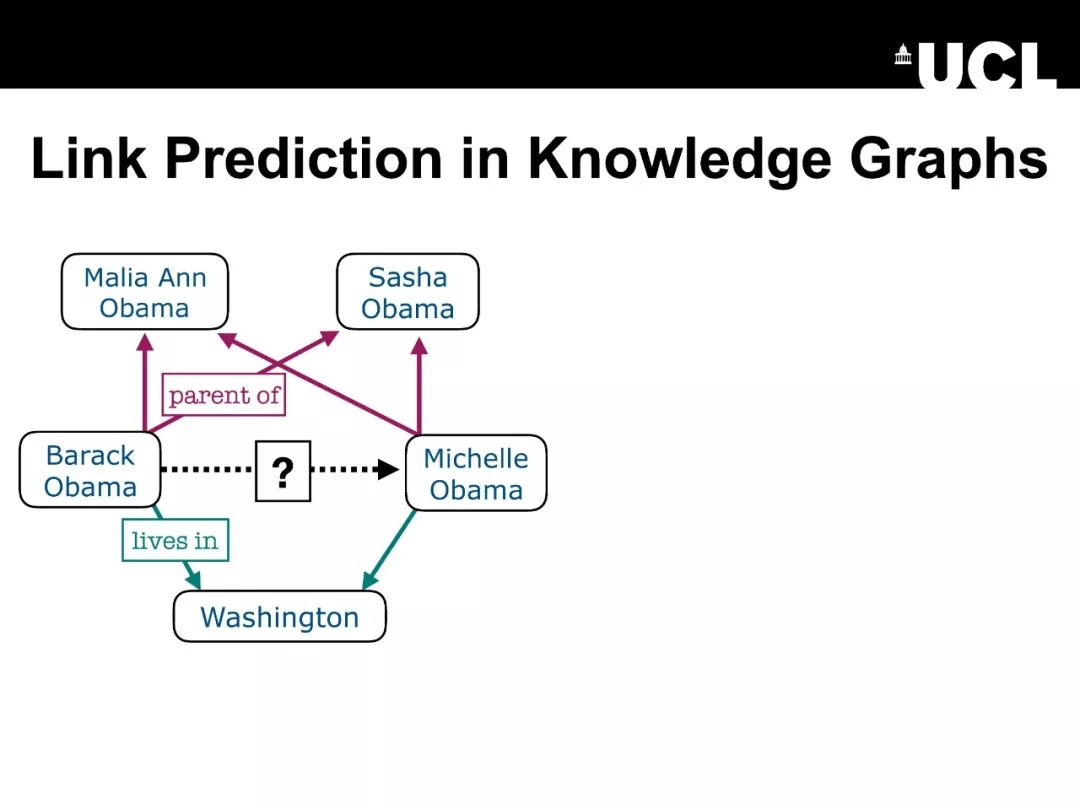

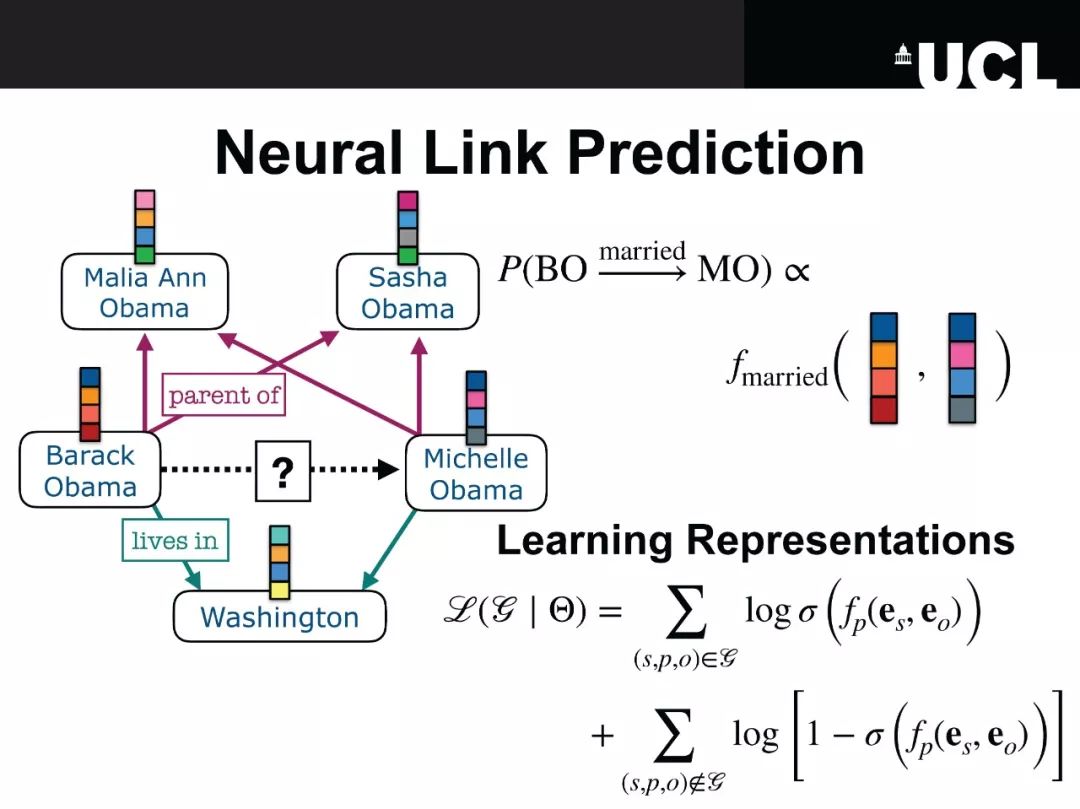

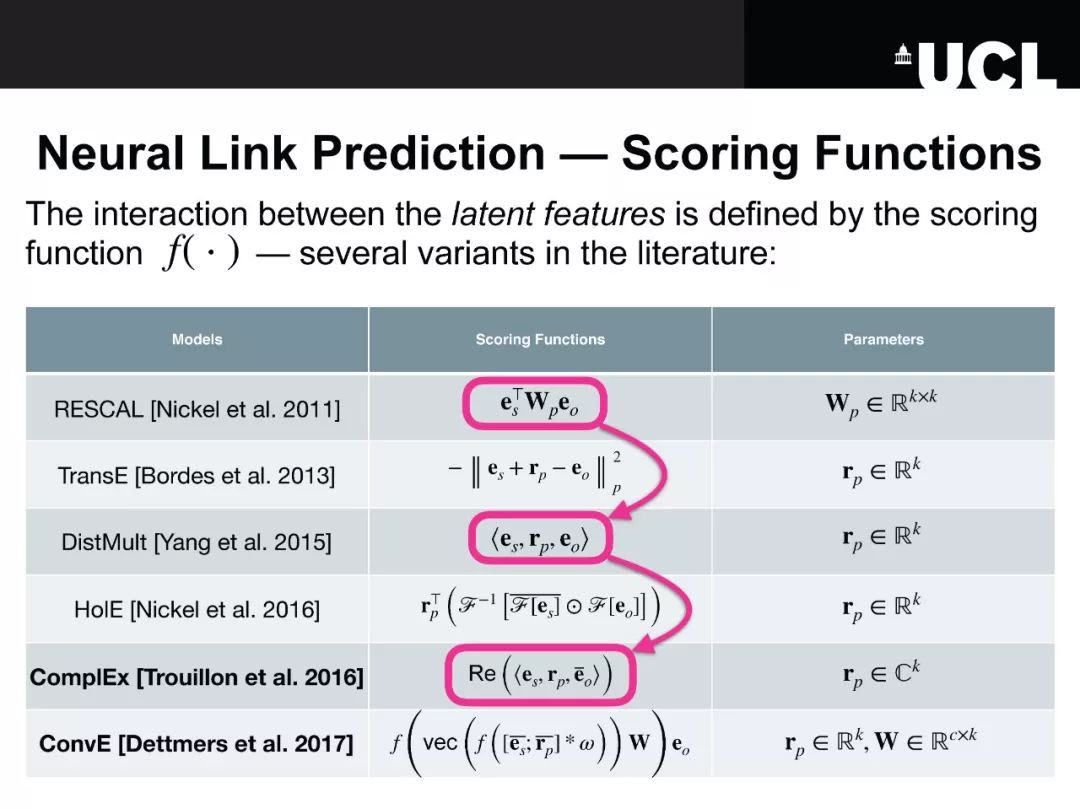

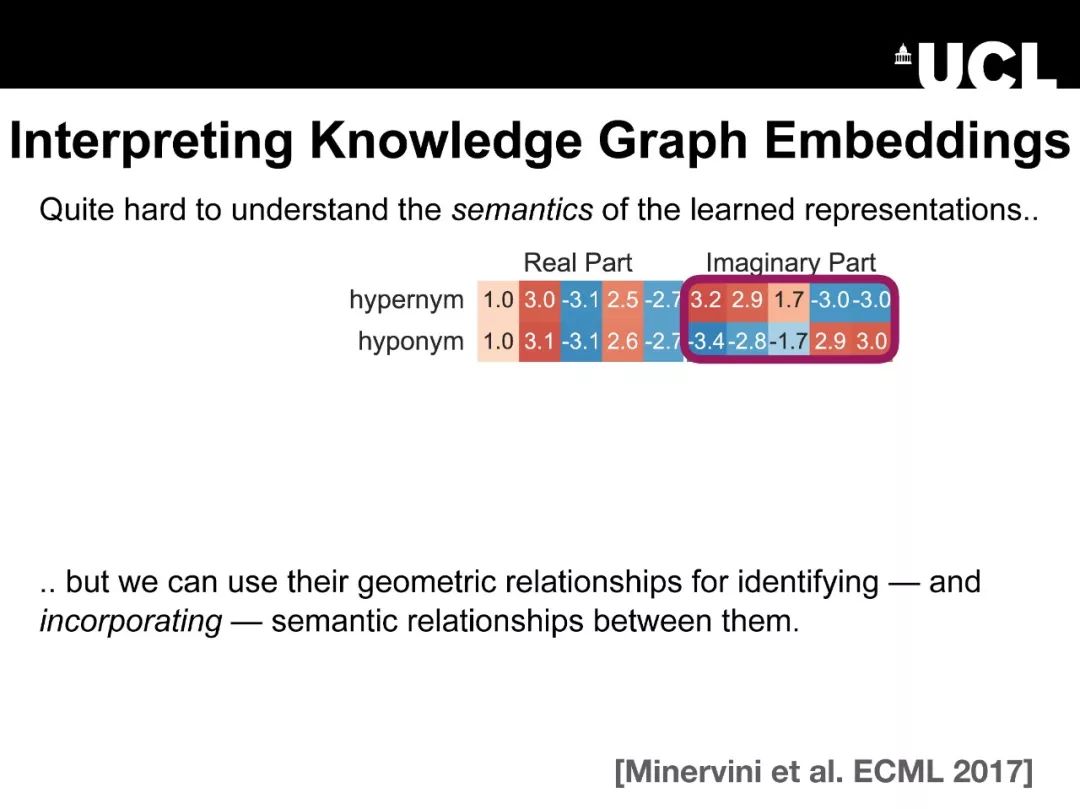

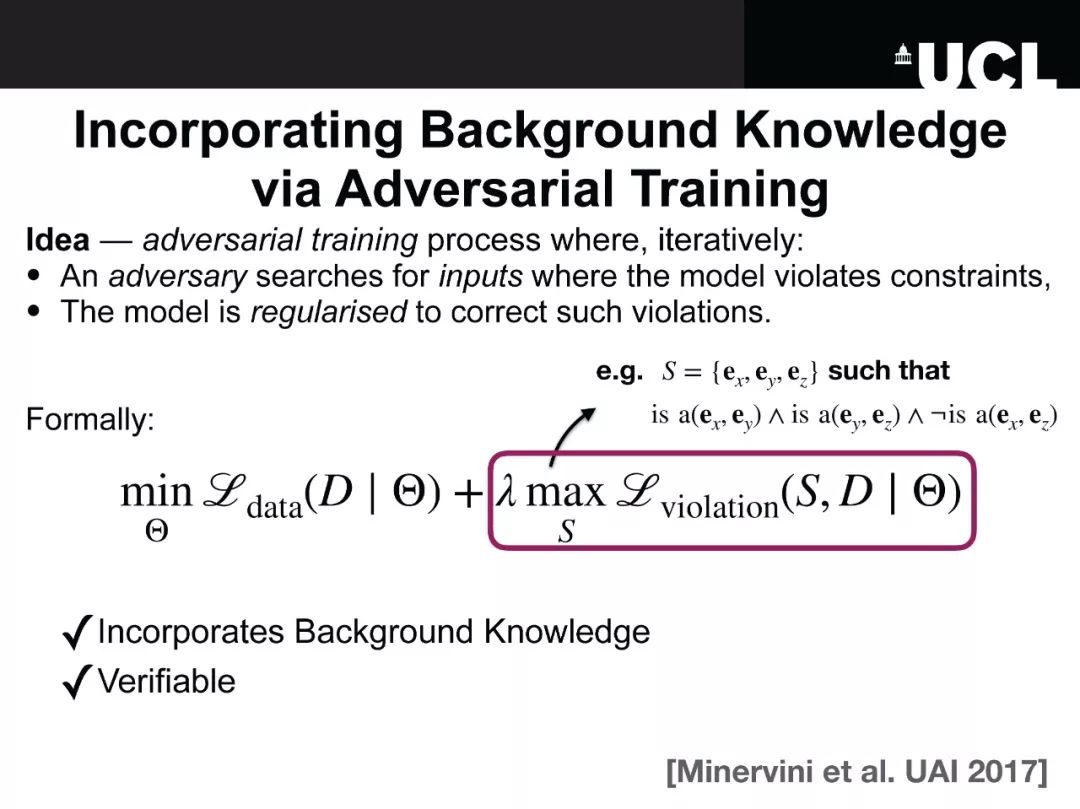

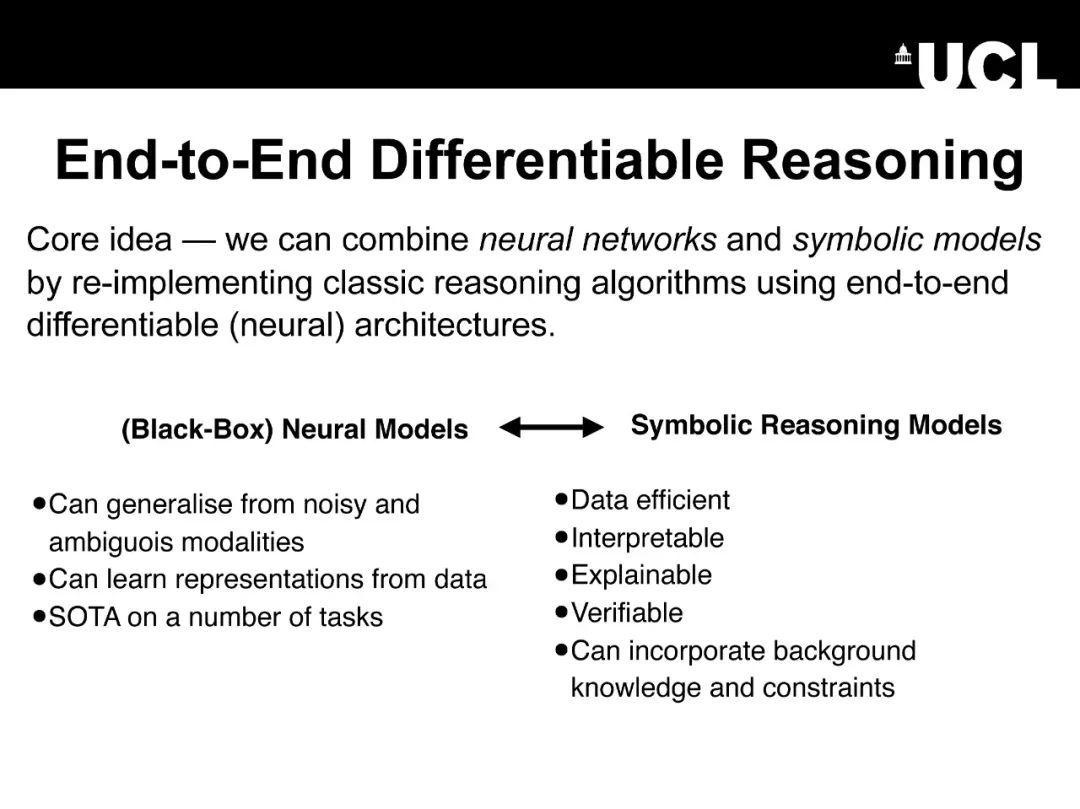

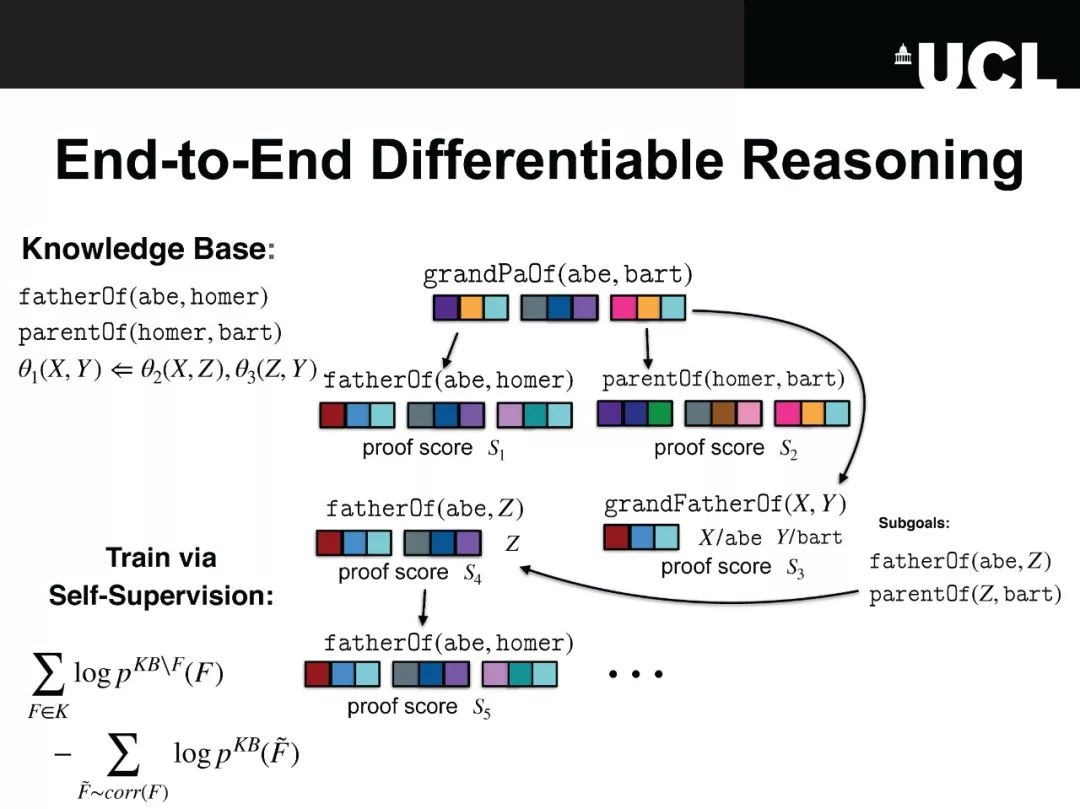

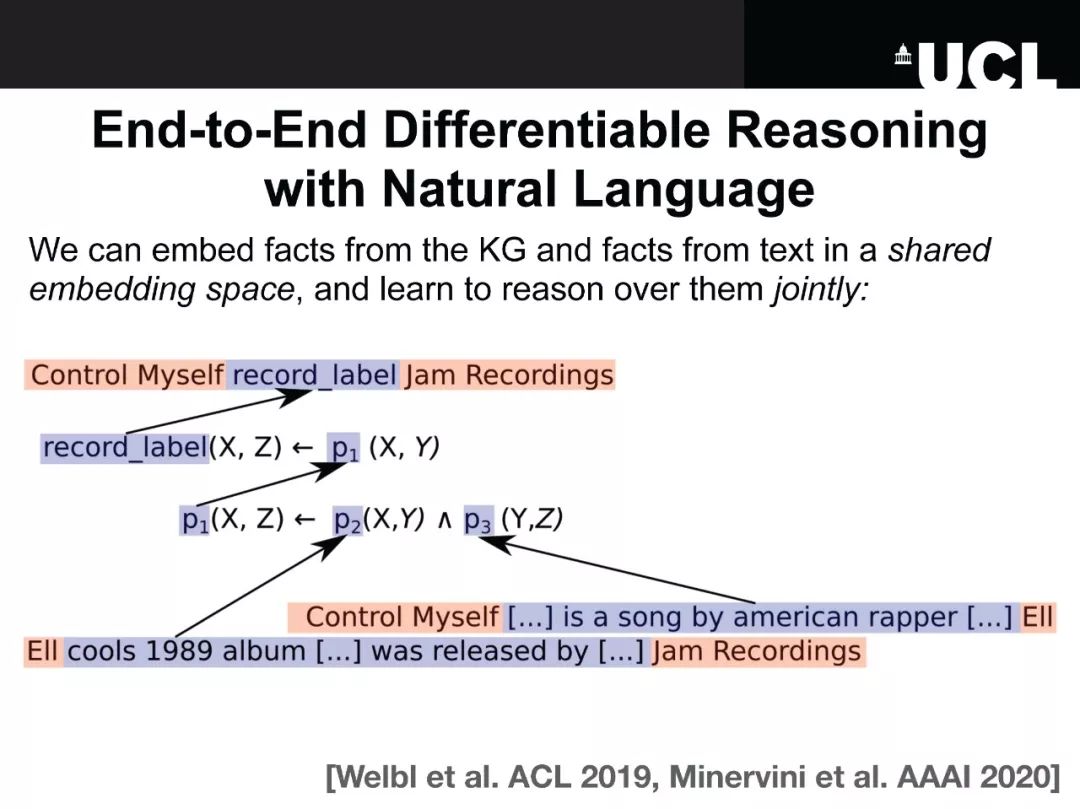

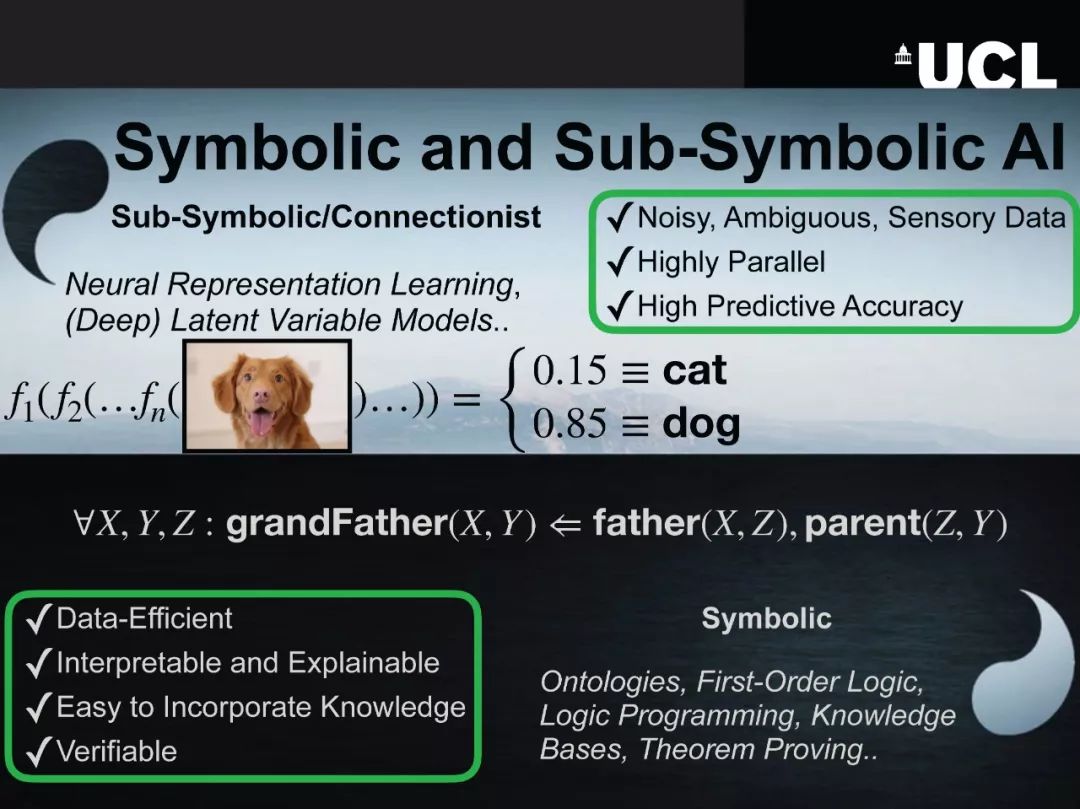

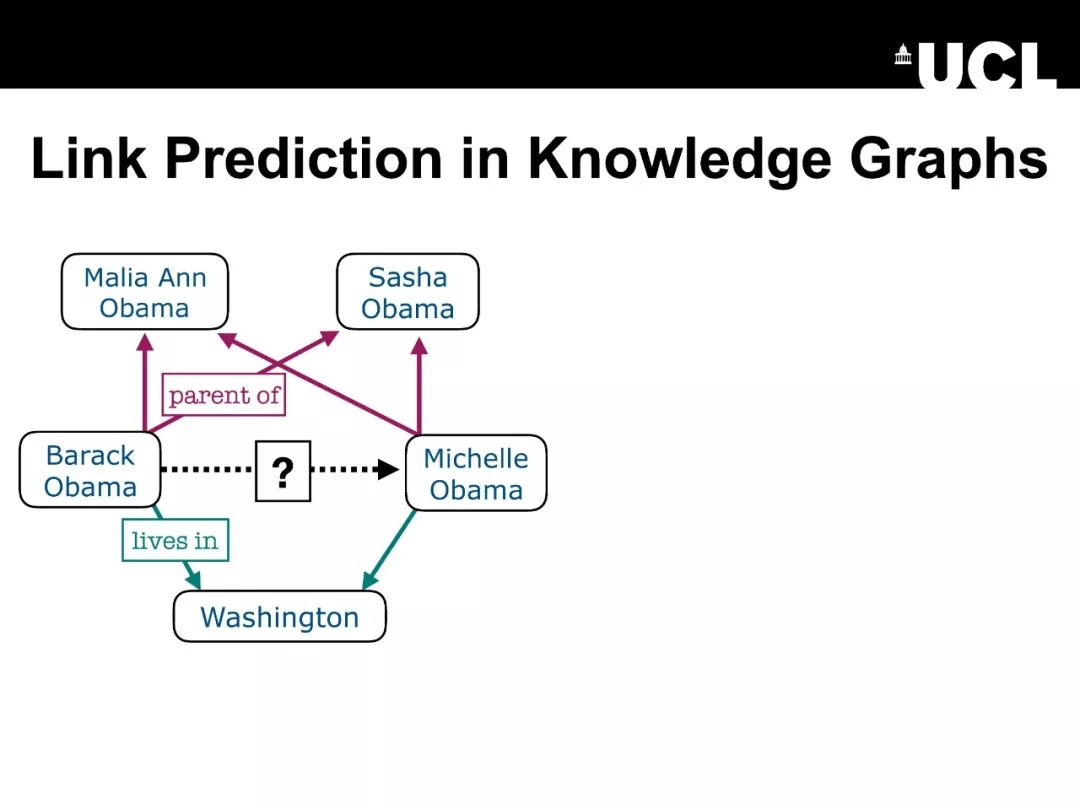

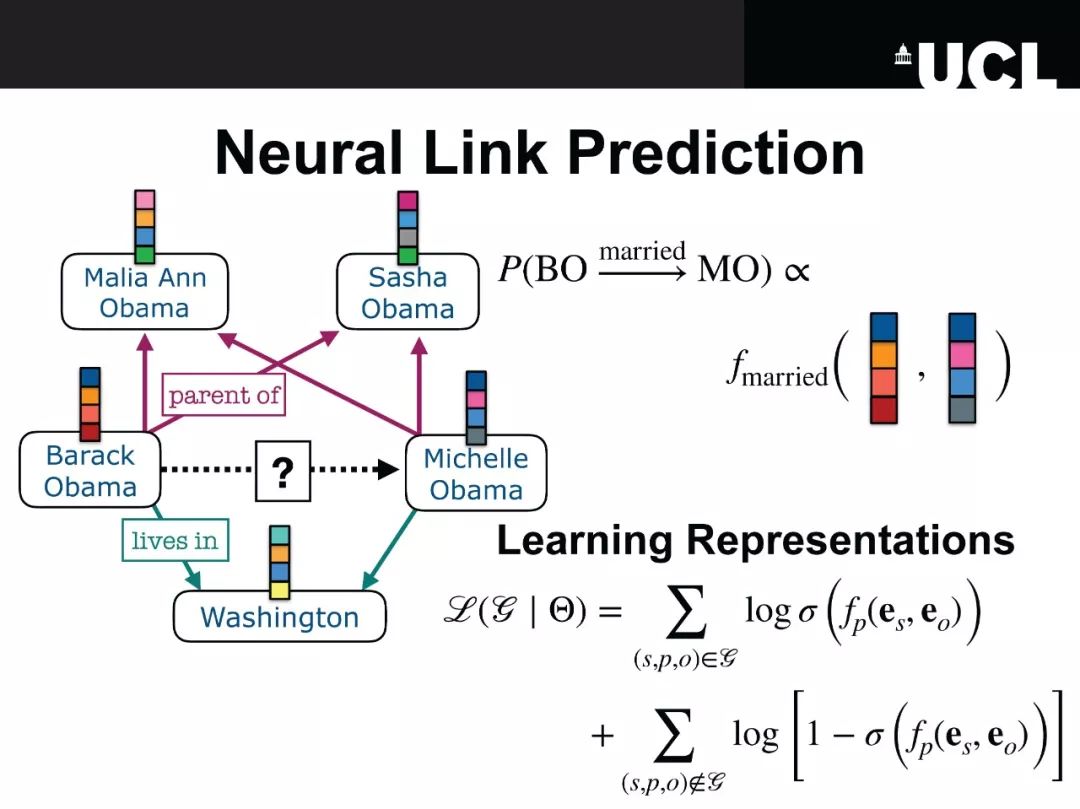

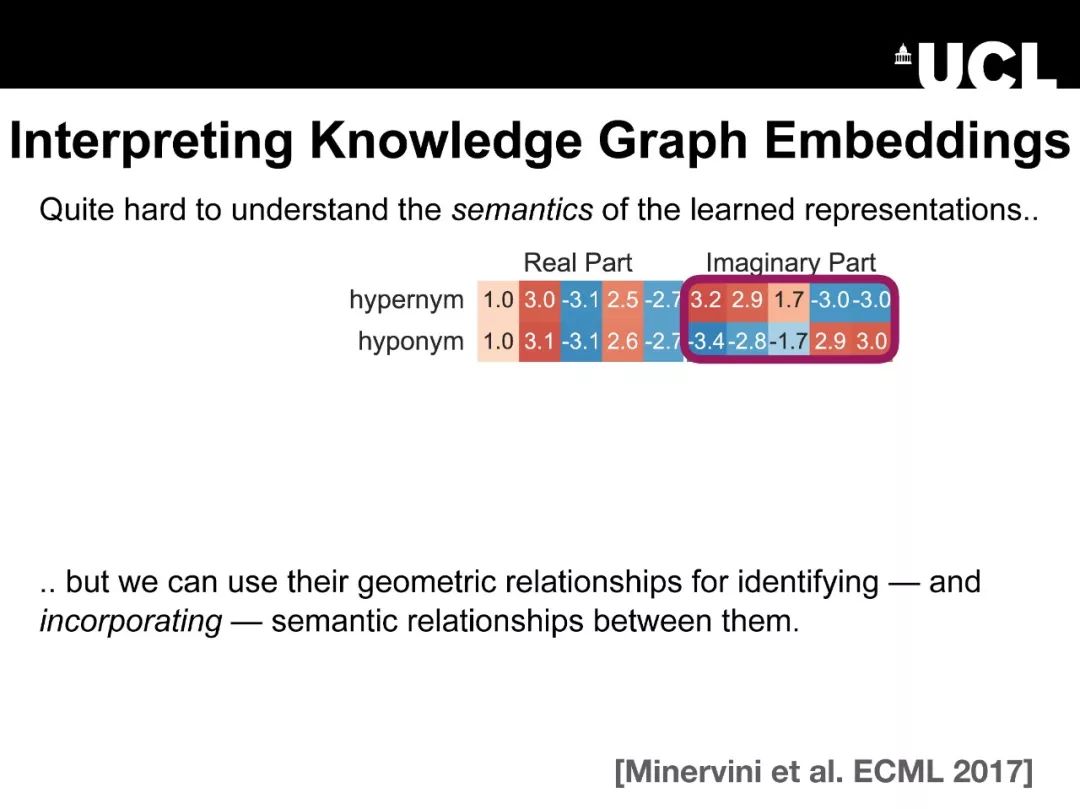

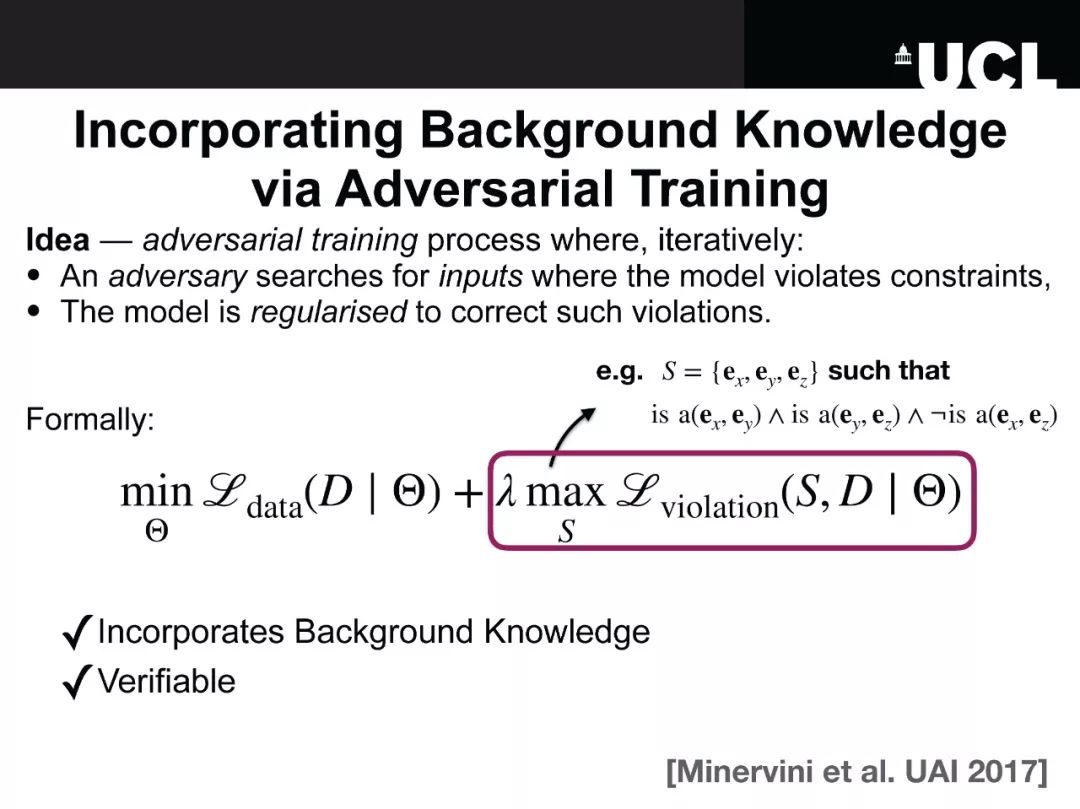

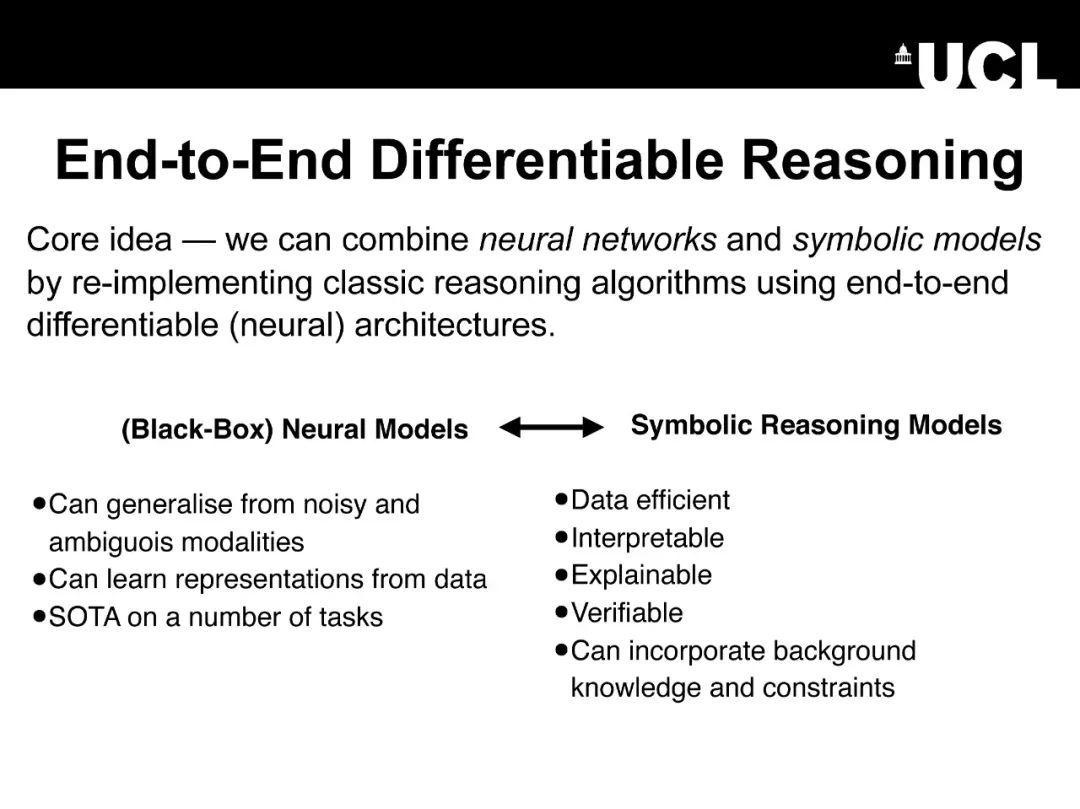

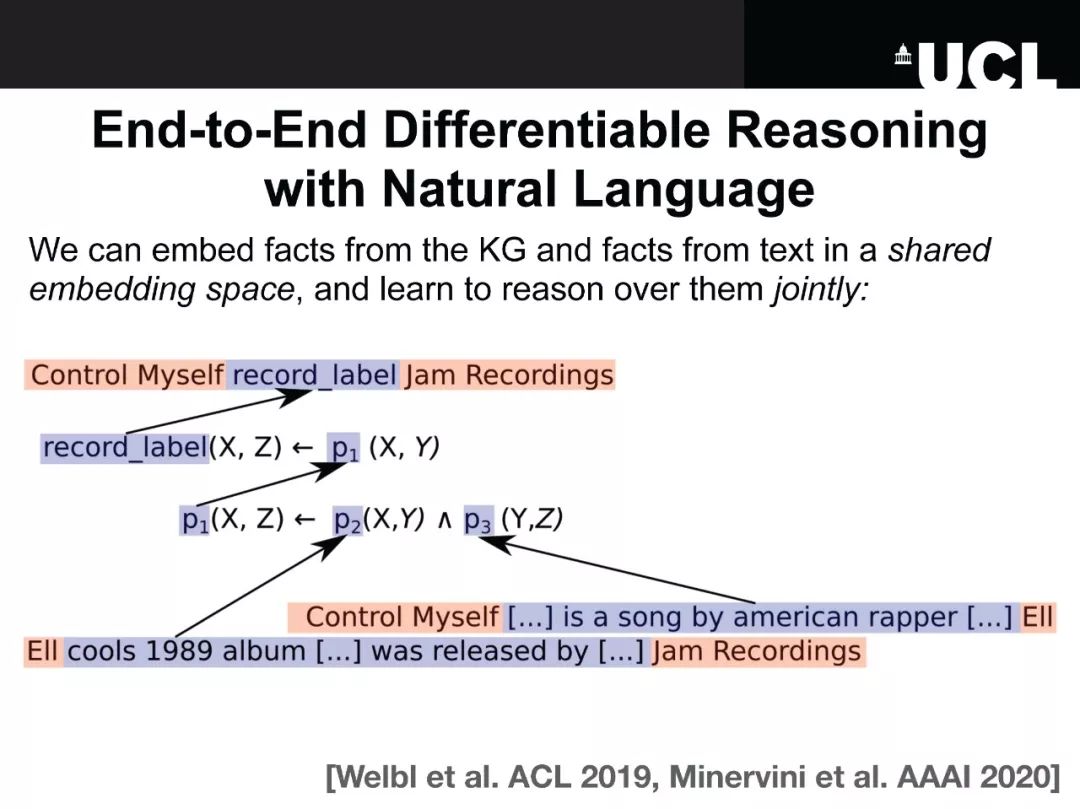

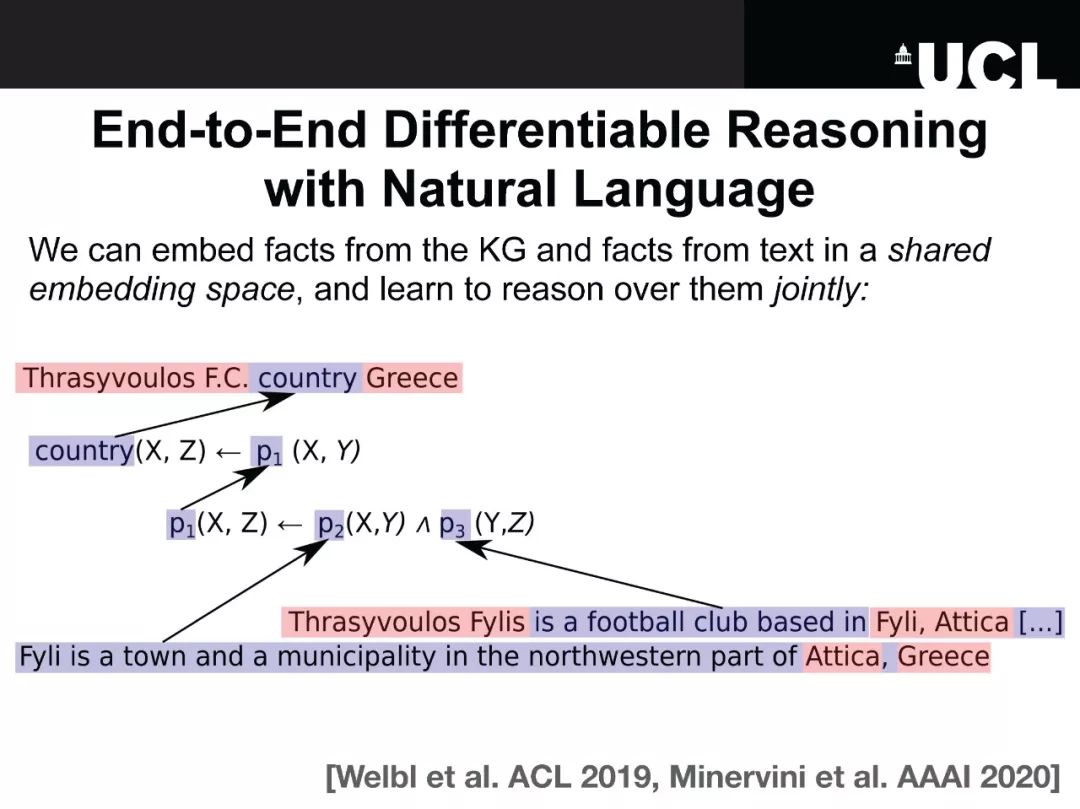

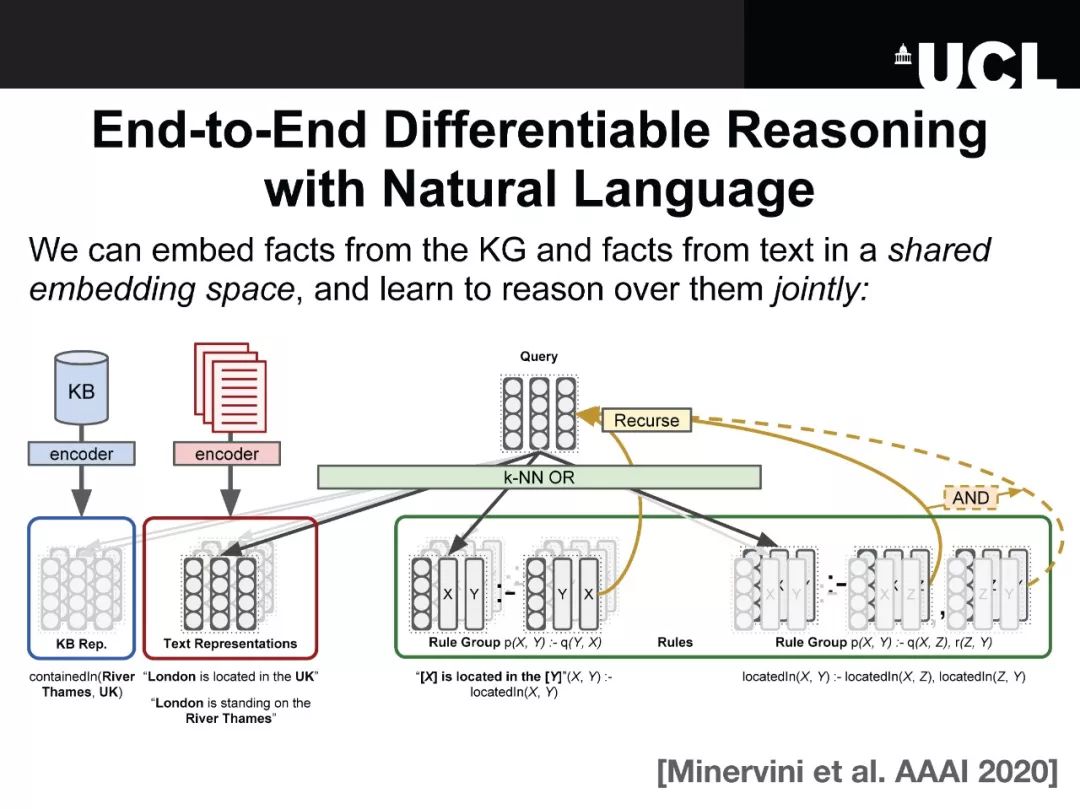

知识图谱是图结构化的知识库,其中关于世界的知识以实体之间关系的形式进行编码。我们将讨论在大规模知识图谱使用神经链接预测缺失链接的工作,以及如何结合背景知识——形式的一阶逻辑规则或约束——神经链接预测,从更少的数据归纳和整合。最后,我们将讨论如何通过端到端可微推理器共同学习表示和规则。

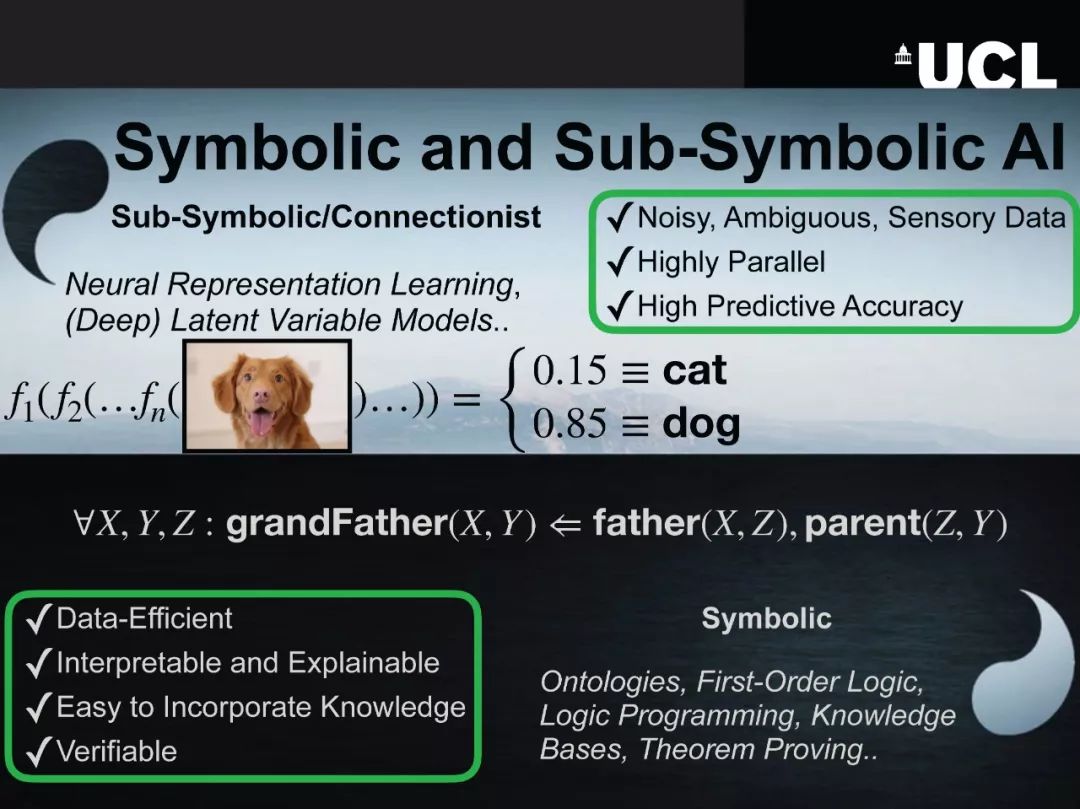

符号化的人工智能

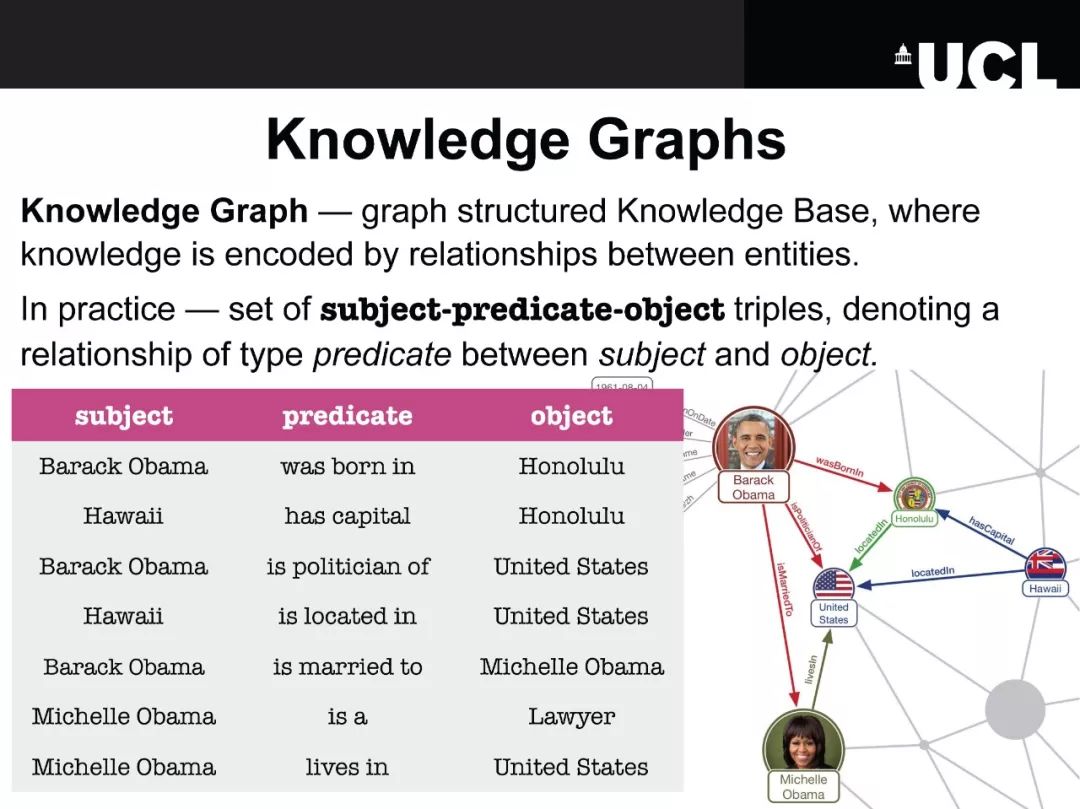

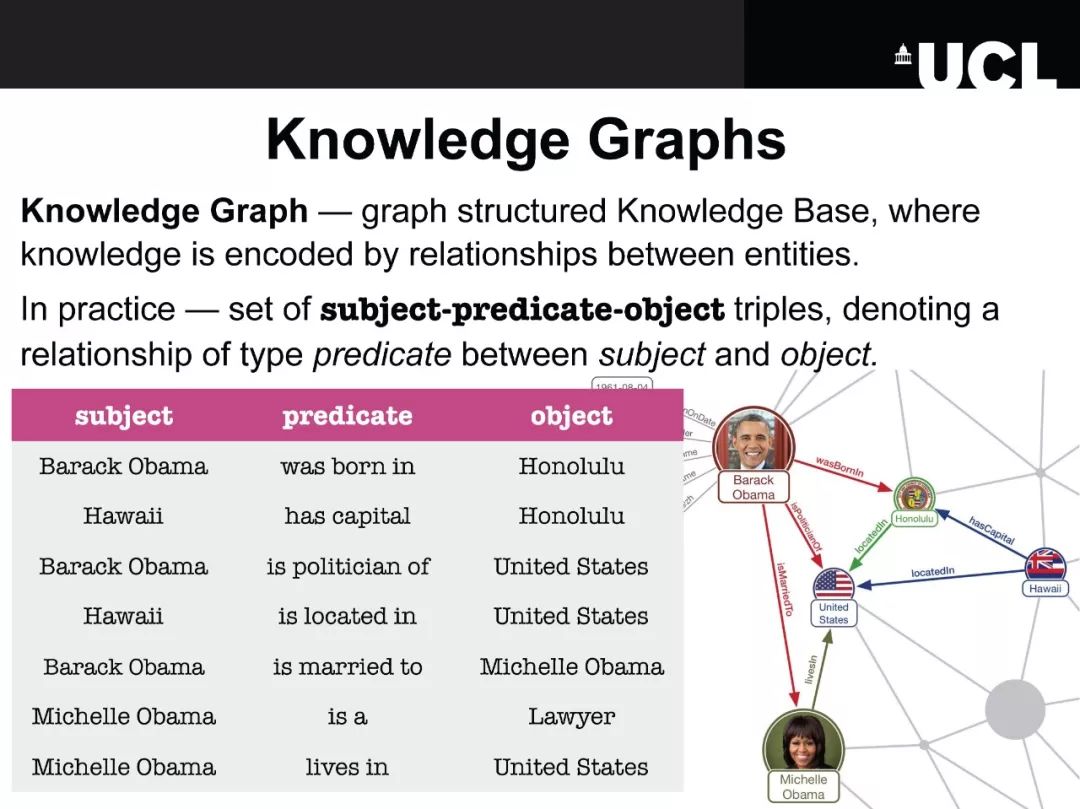

知识图谱

:图结构化知识库,其中的知识是由实体之间的关系编码的。在实践中,一组主语-谓语-宾语三元组,表示主语和宾语之间的类型谓语关系。

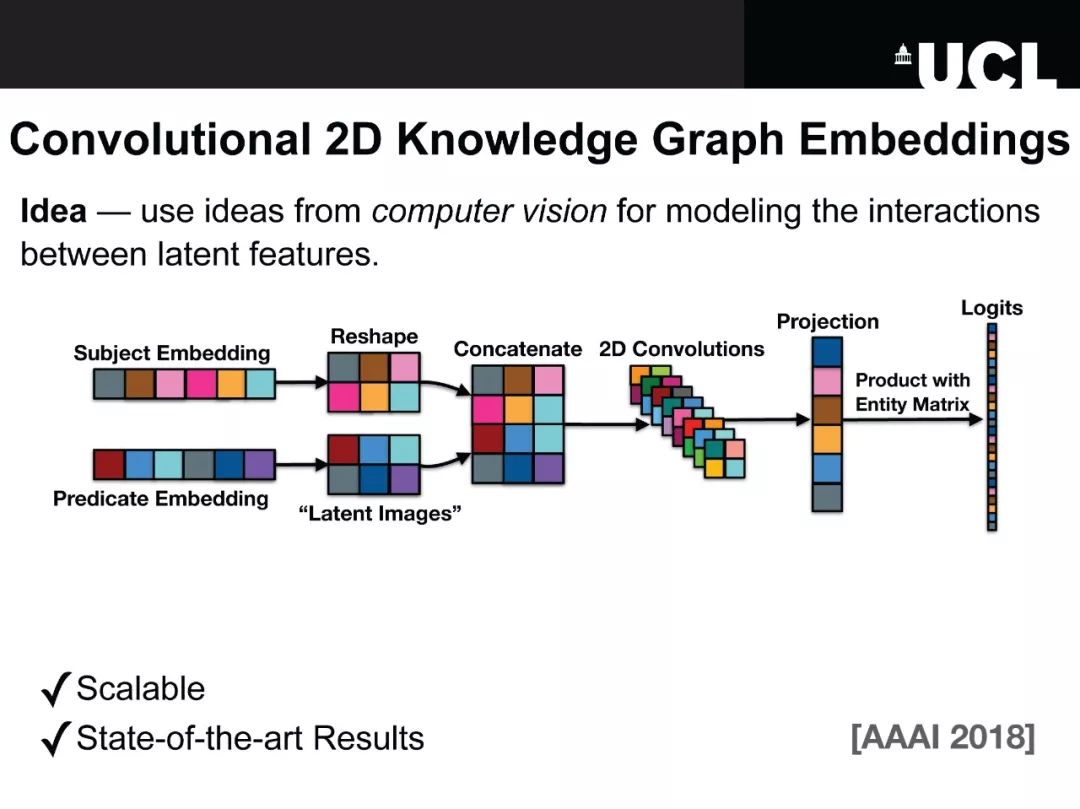

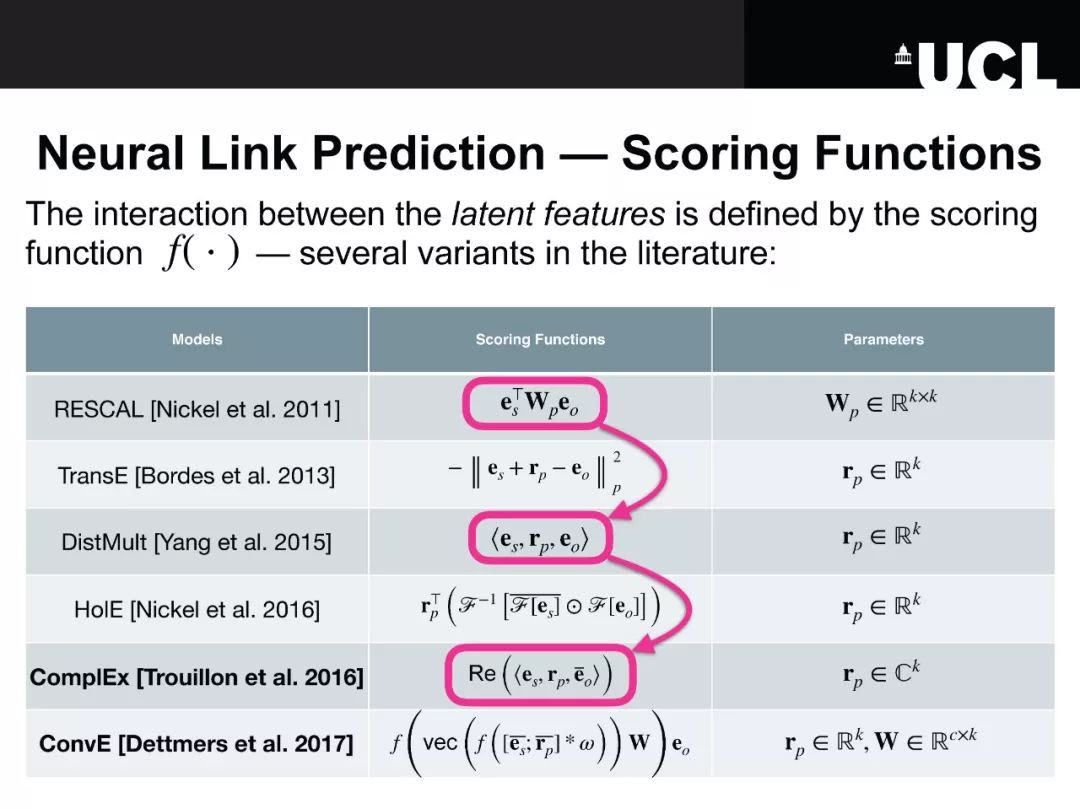

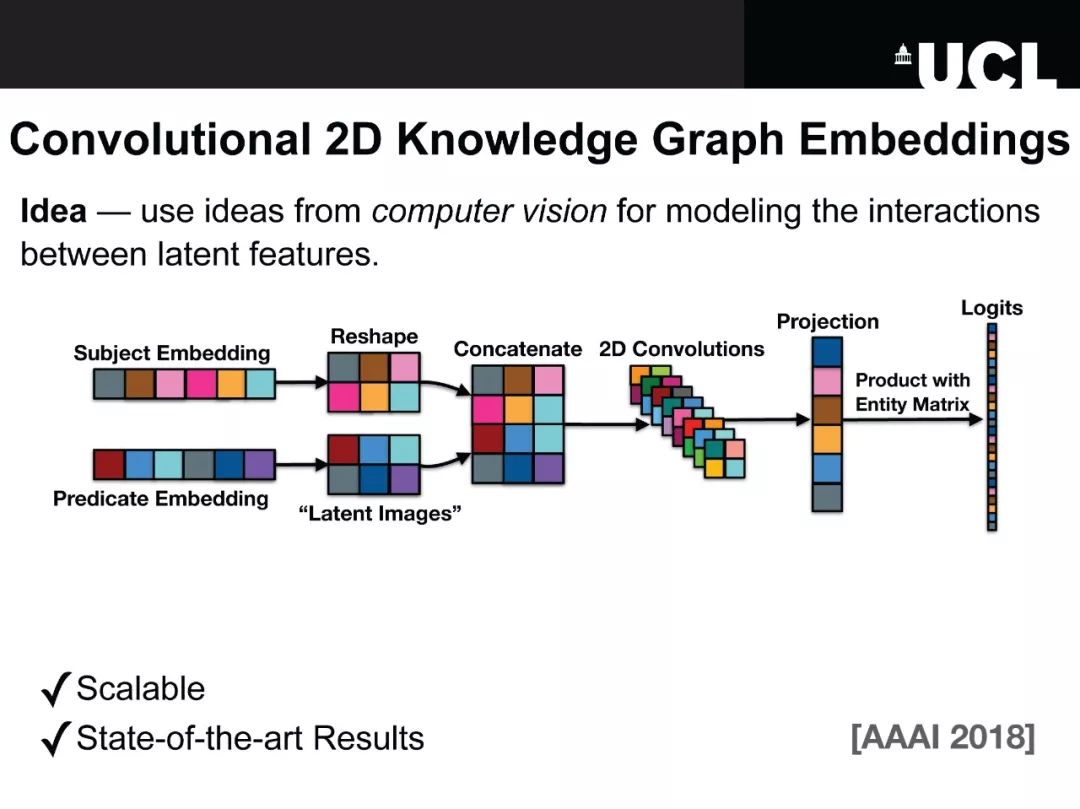

利用计算机视觉的思想来建模潜在特征之间的交互作用

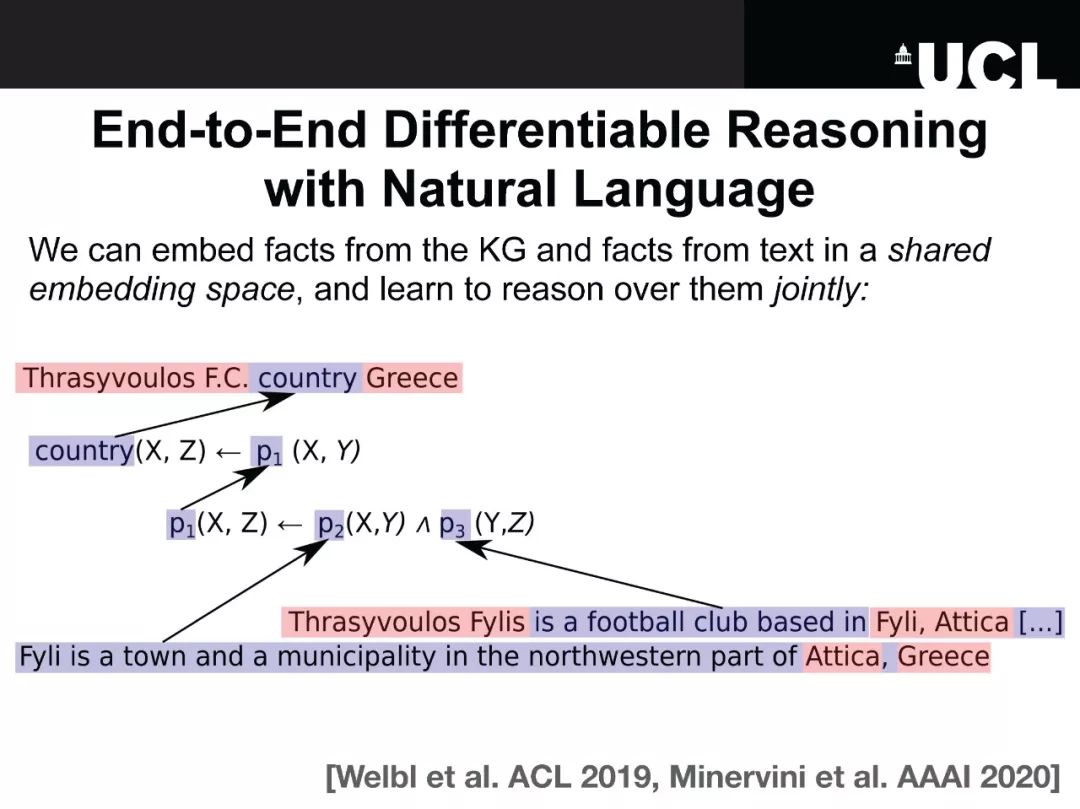

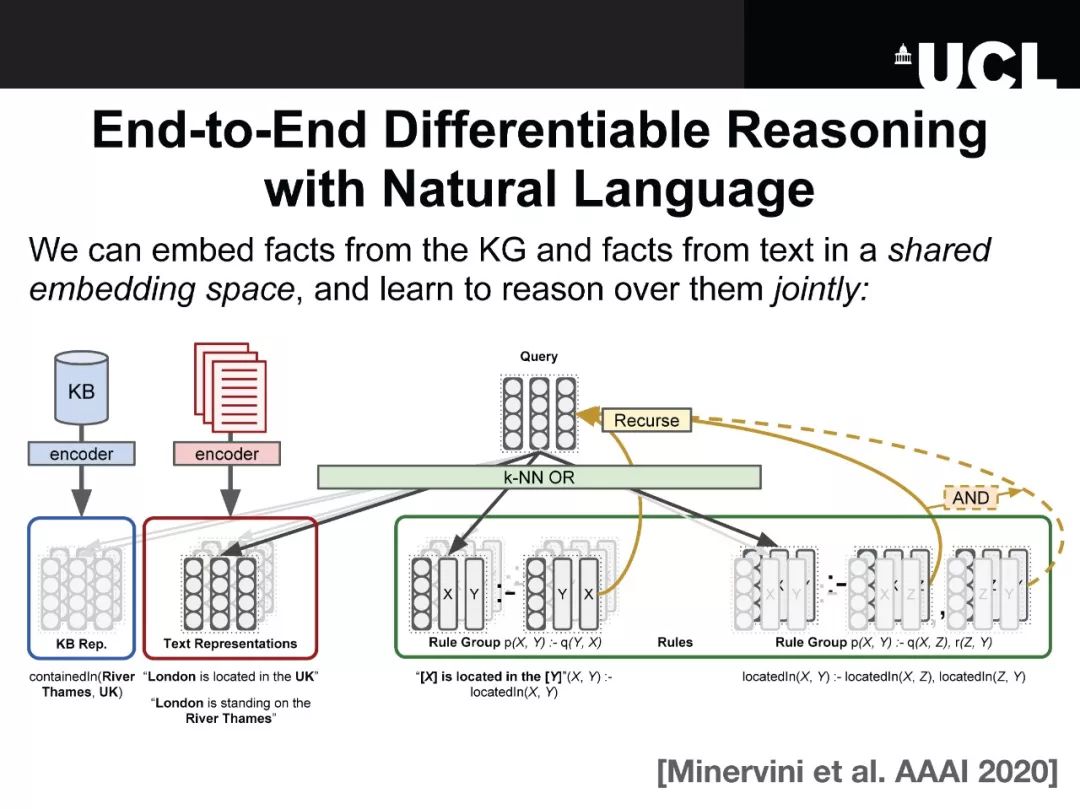

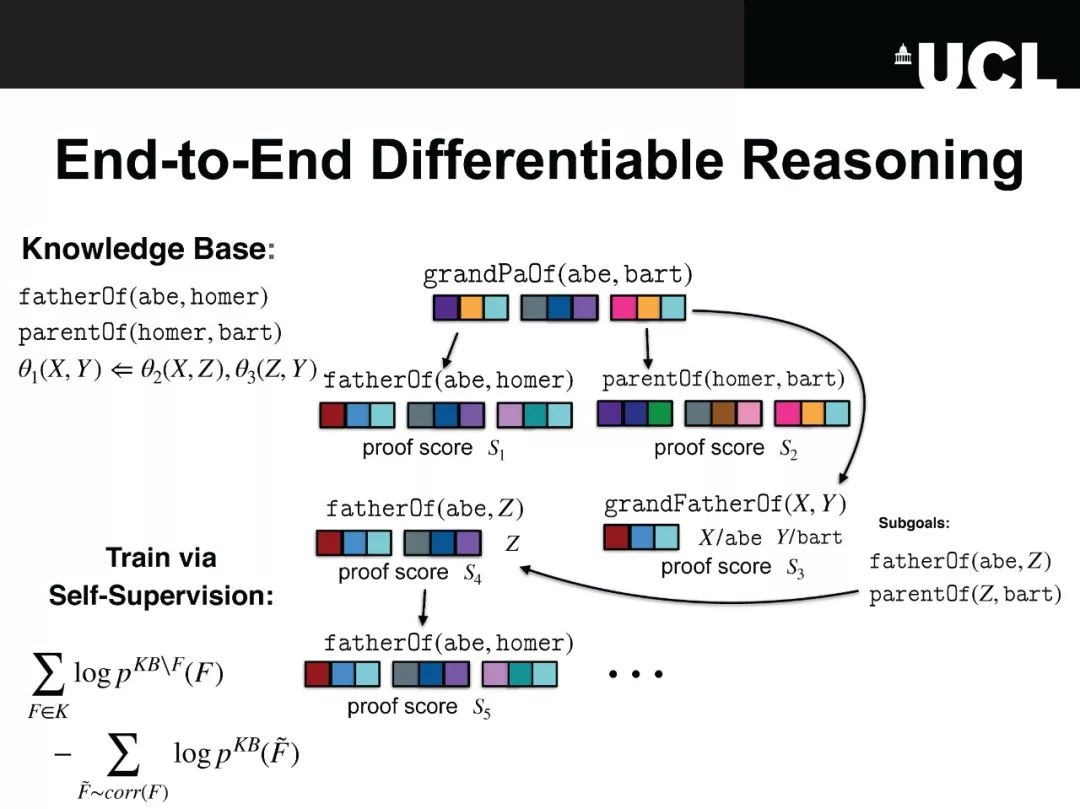

端到端的可微分推理

完整报告下载:关注专知公众号(点击上方蓝色专知关注)

更多“知识图谱”资料请上专知网站(www.zhuanzhi.ai )进行查看!

https://www.zhuanzhi.ai/topic/2001005380553956/awesome

专知,专业可信的人工智能知识分发,让认知协作更快更好!欢迎注册登录专知www.zhuanzhi.ai,获取5000+AI主题干货知识资料!

欢迎微信扫一扫加入专知人工智能知识星球群,获取最新AI专业干货知识教程视频资料和与专家交流咨询!

请加专知小助手微信(扫一扫如下二维码添加),

获取专知VIP会员码,

加入专知人工智能主题群,咨询技术商务合作~

点击“阅读原文”,了解使用专知,查看5000+AI主题知识资料