深度学习注意力机制-Attention in Deep learning-附101页PPT

导读

-

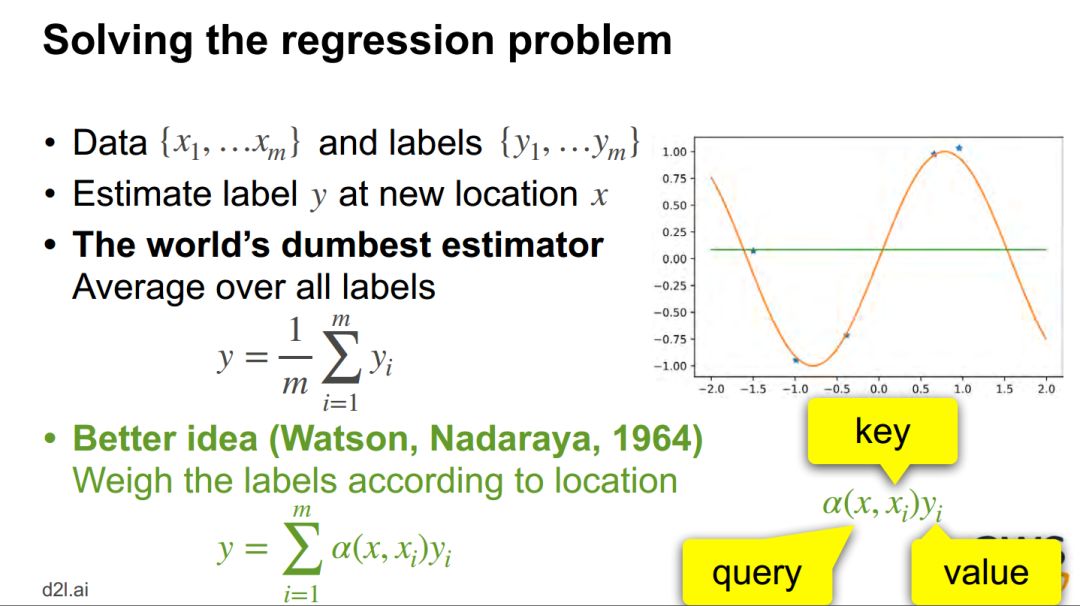

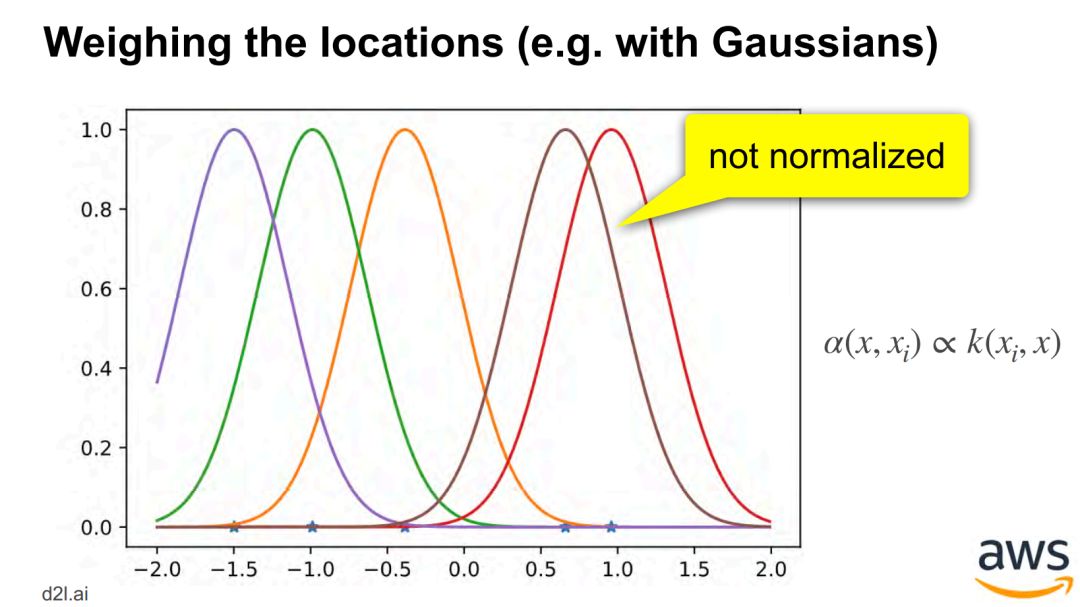

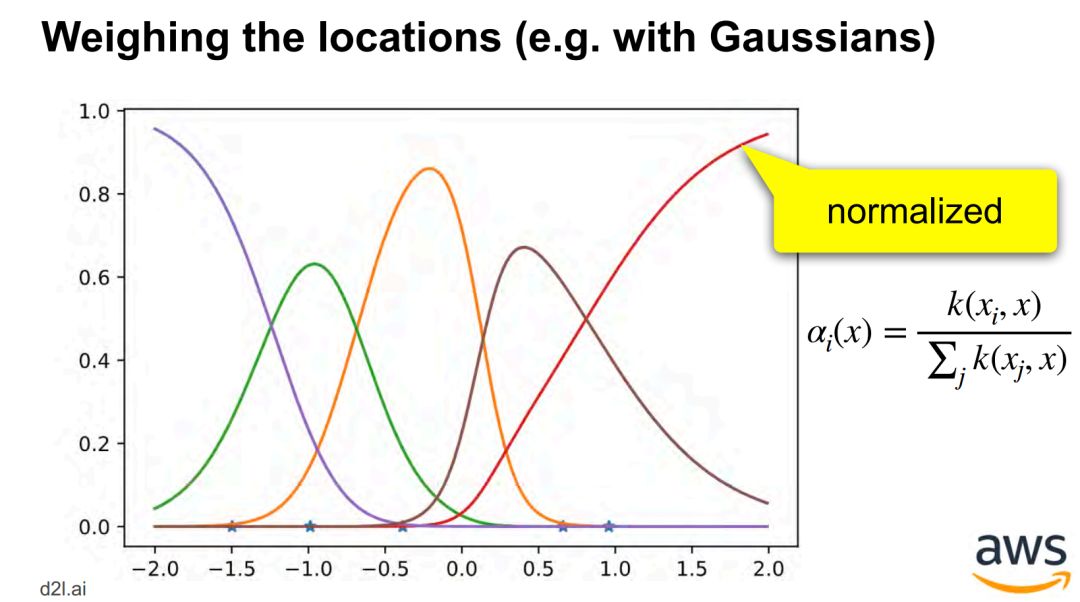

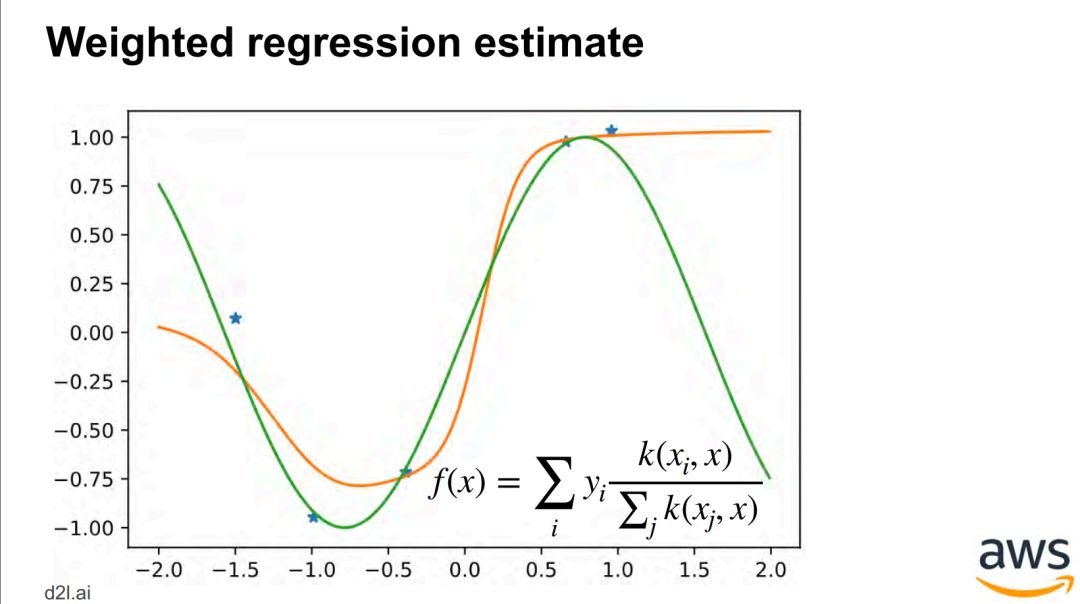

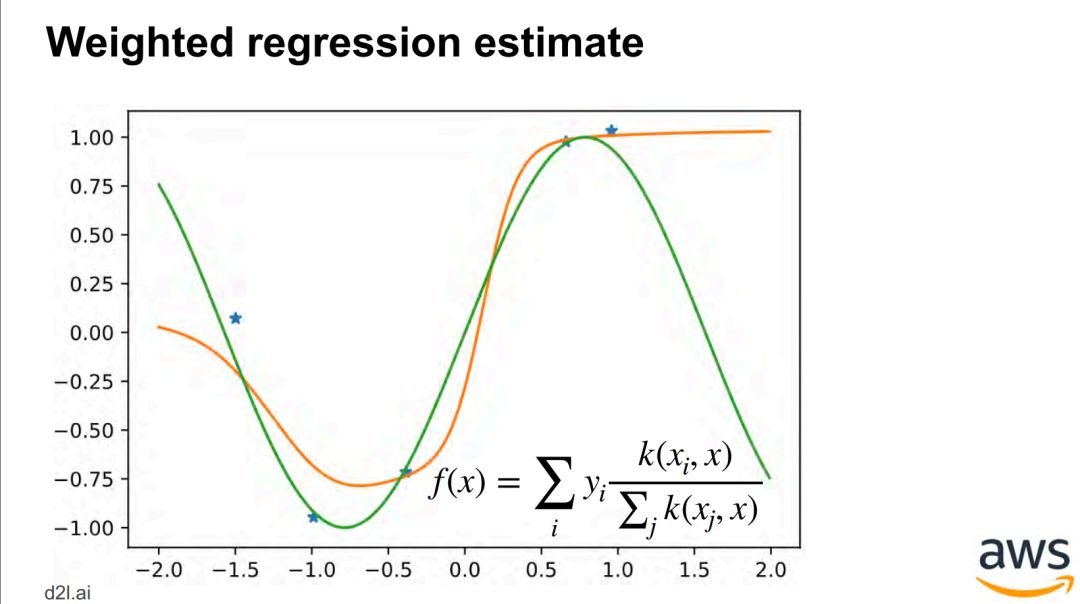

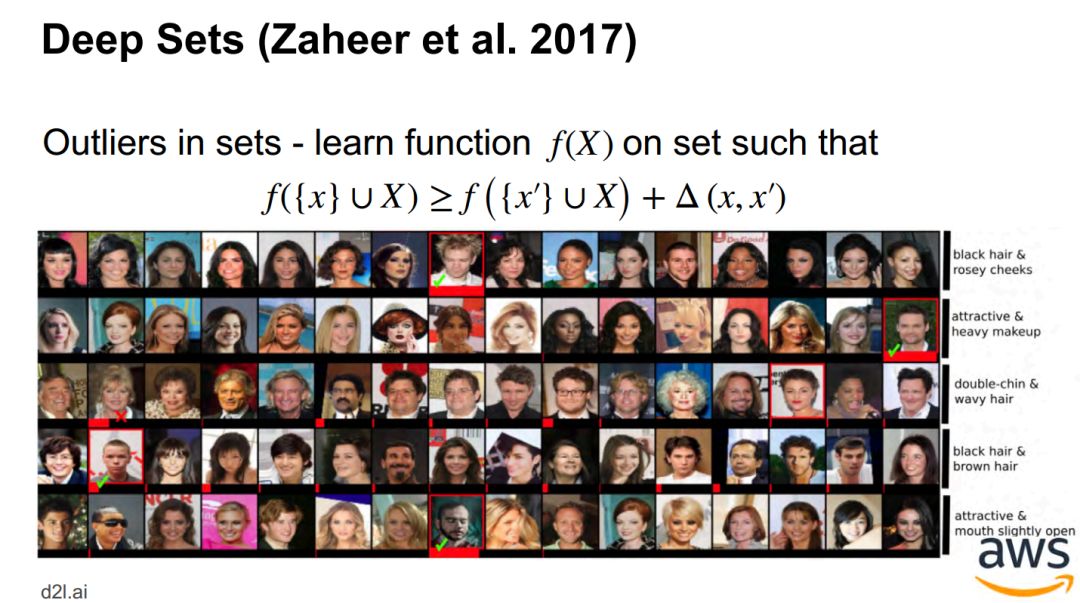

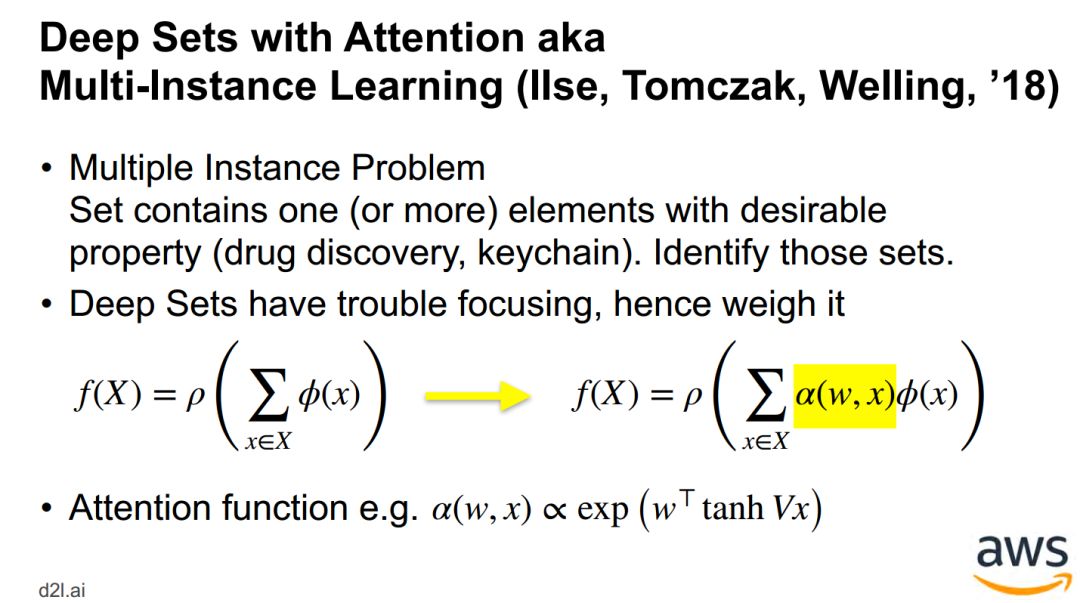

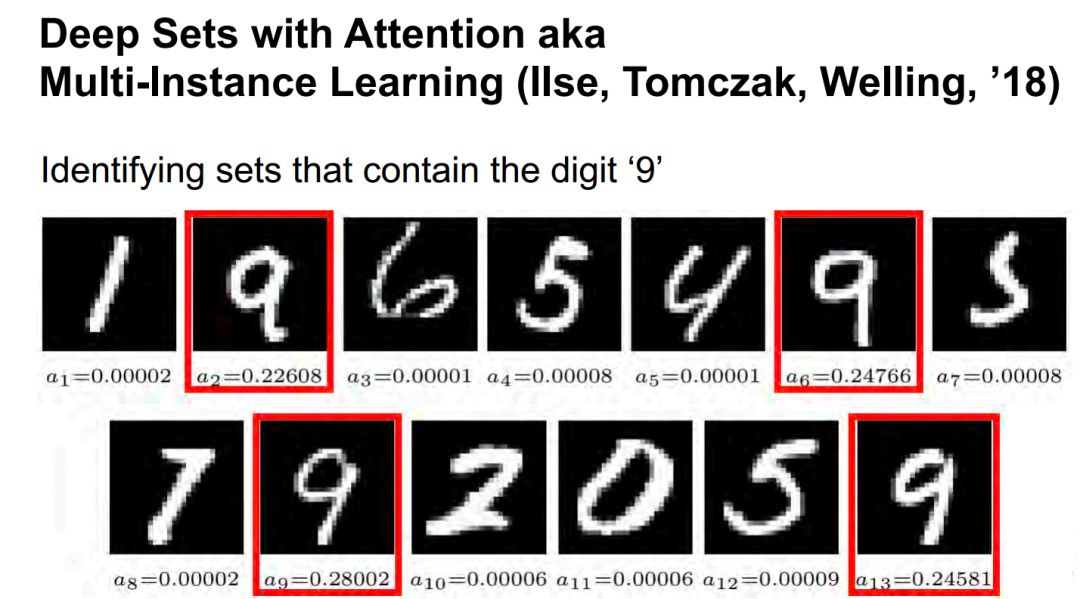

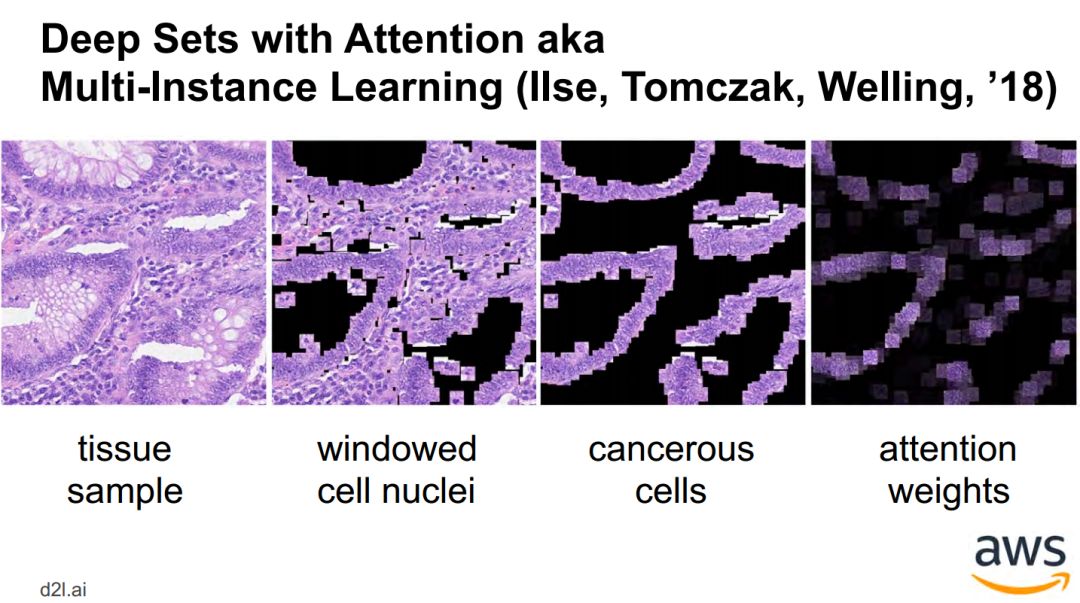

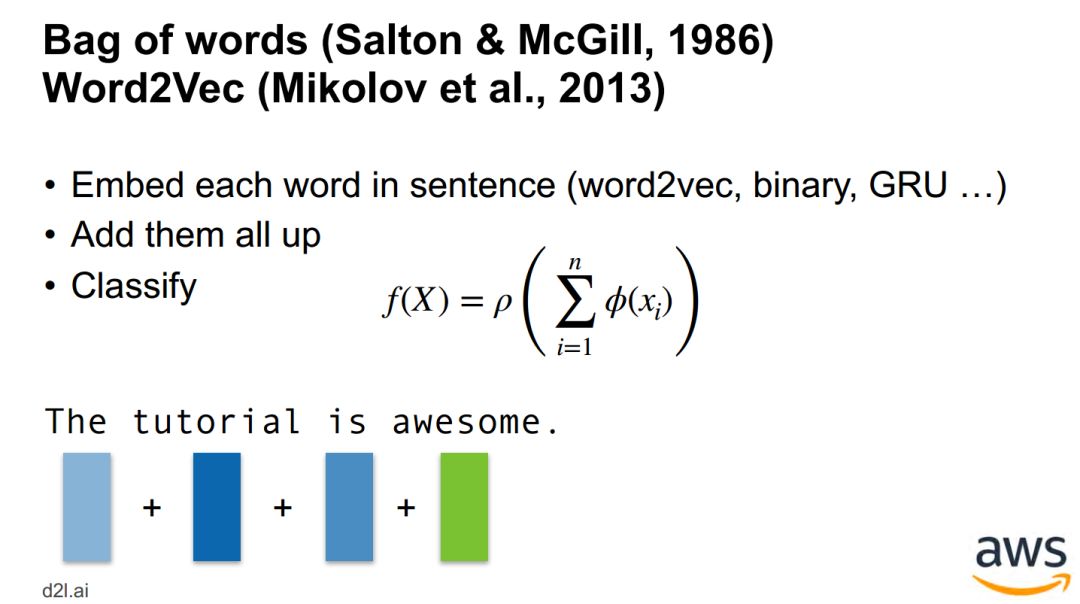

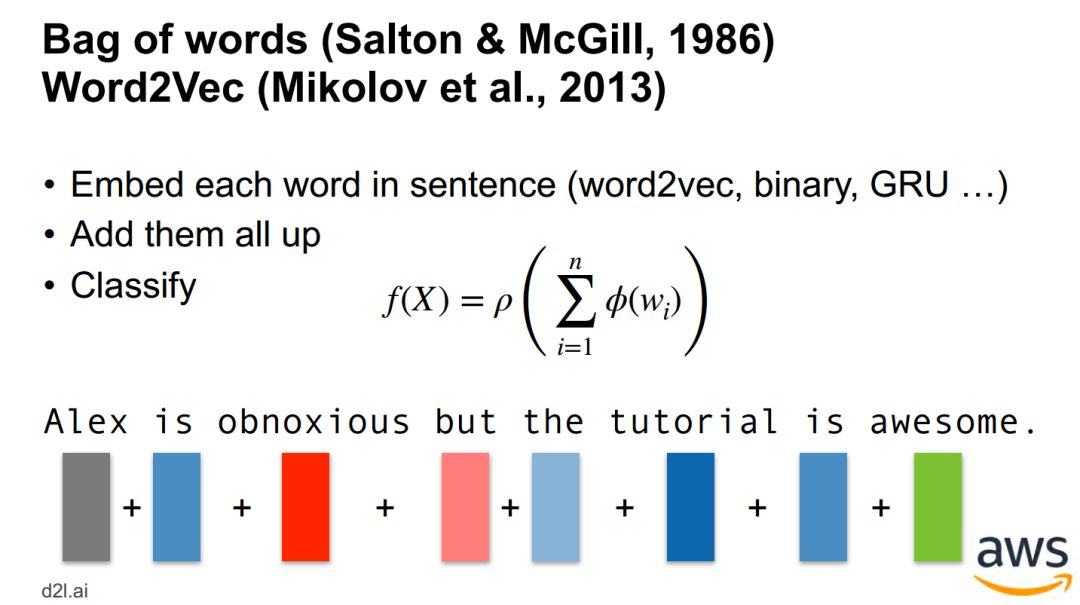

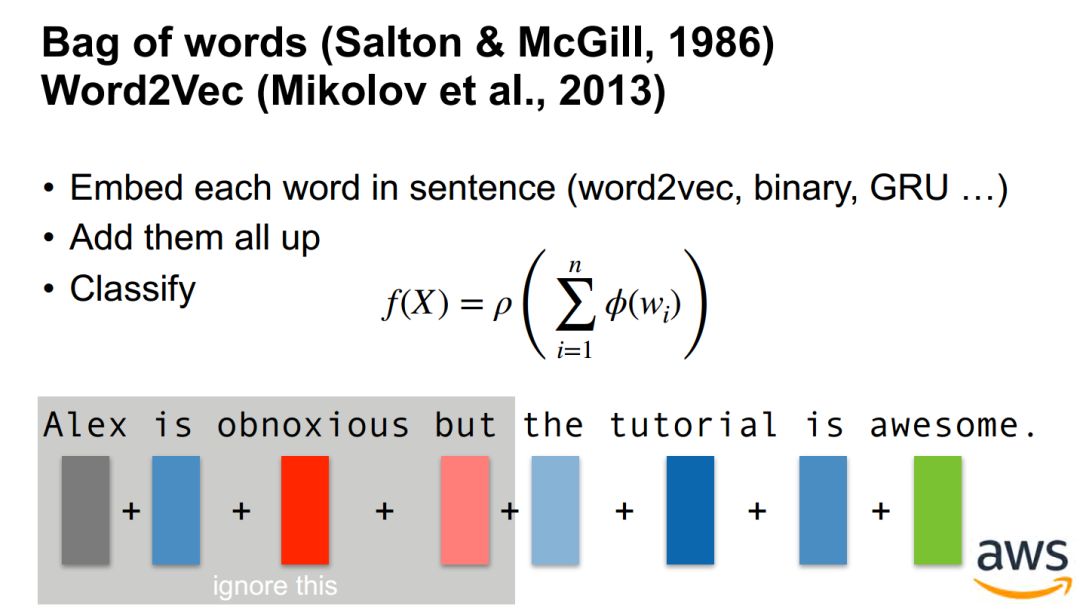

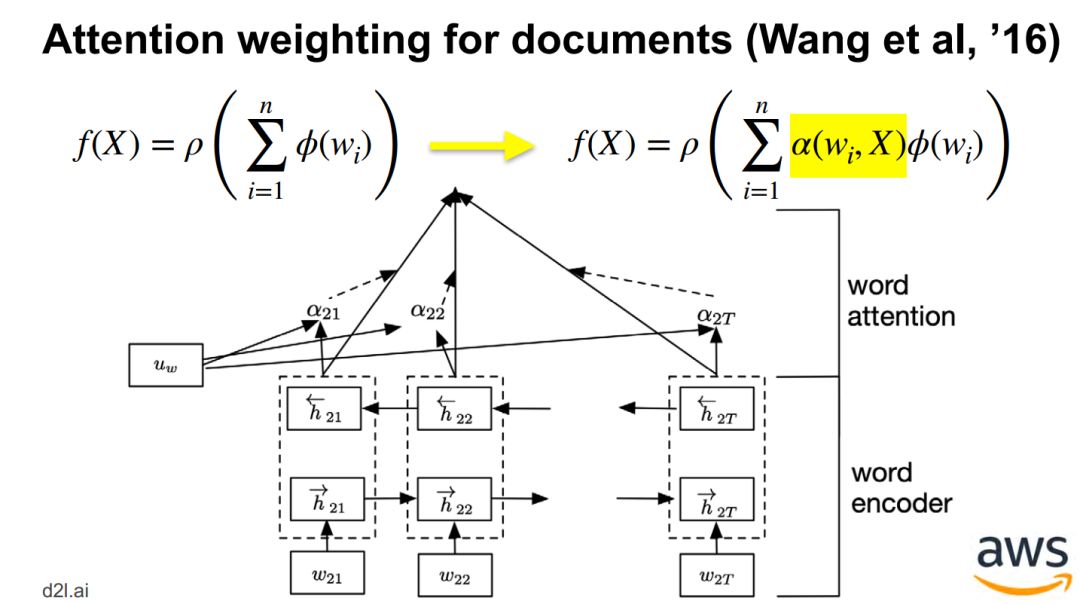

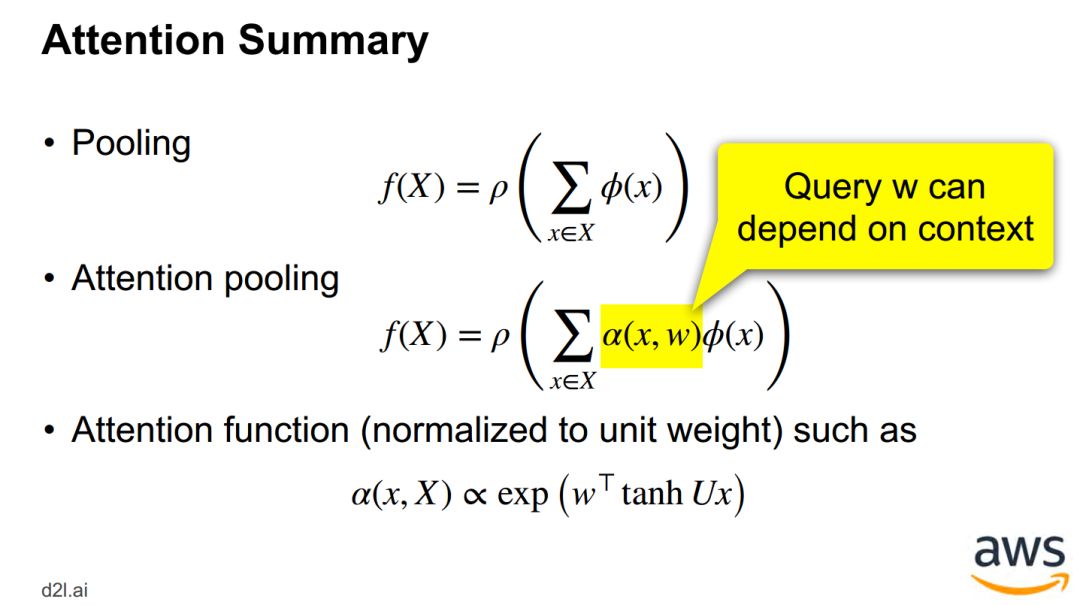

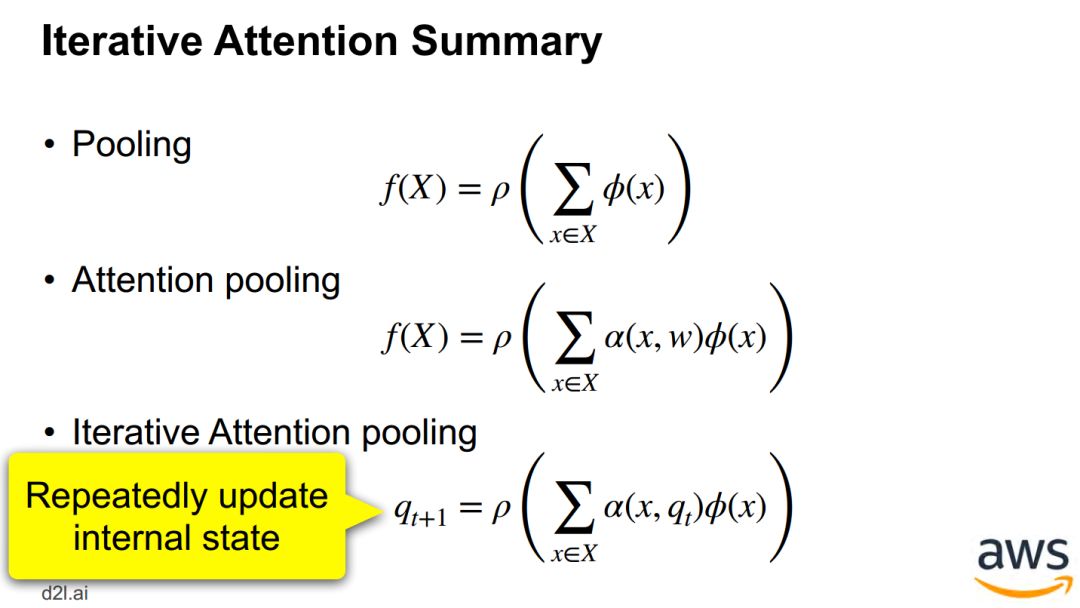

单目标 - 从池化 pooling 到注意力池化 attention pooling -

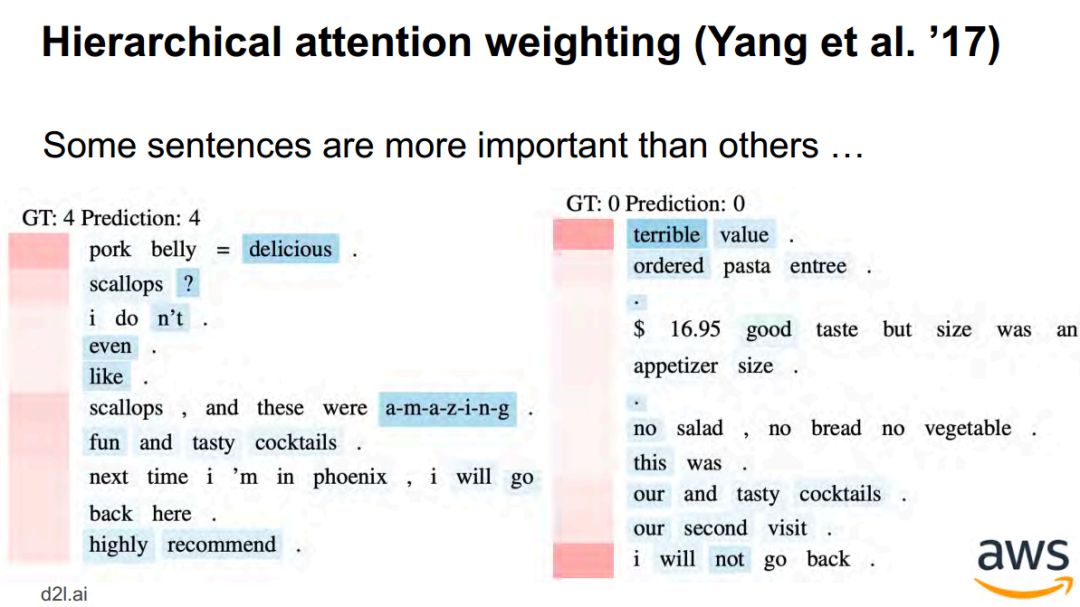

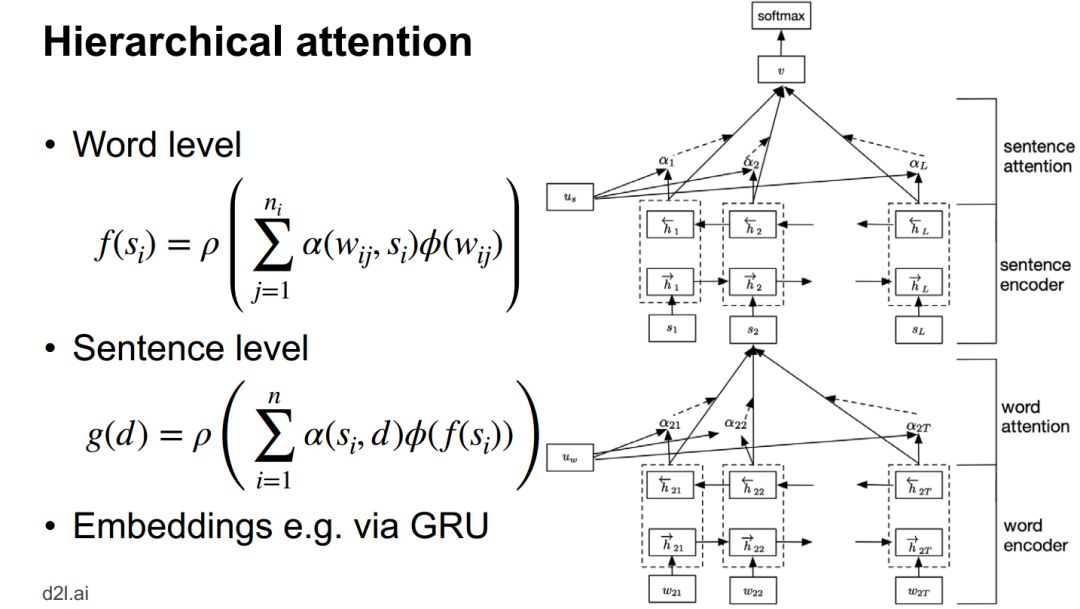

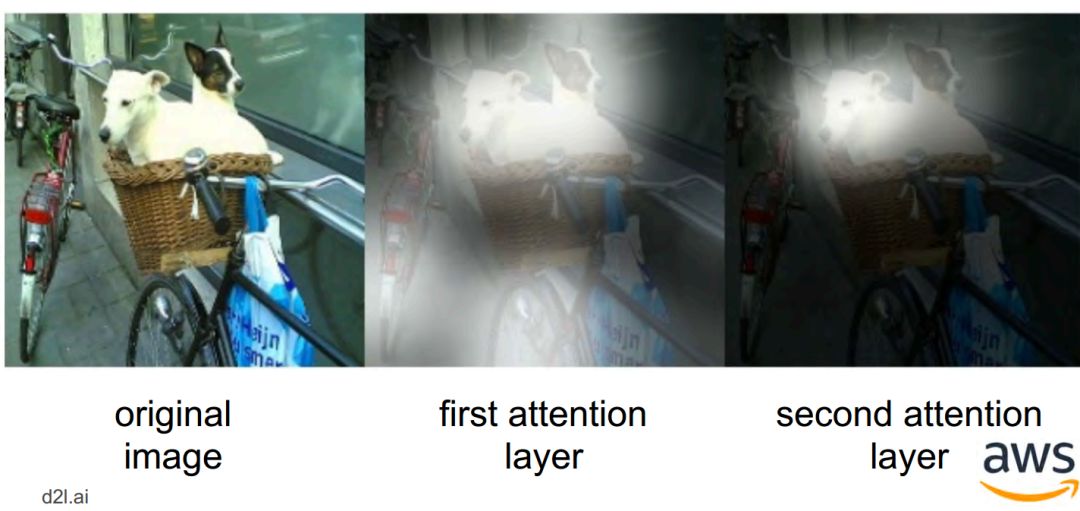

层次结构 - 分层注意力网络 Hierarchical attention network

-

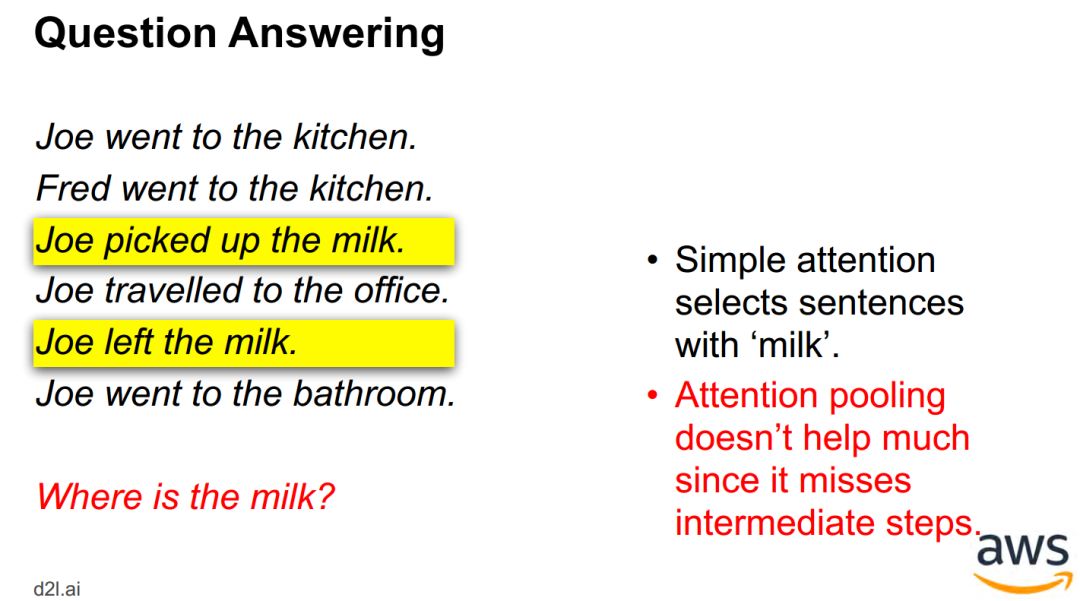

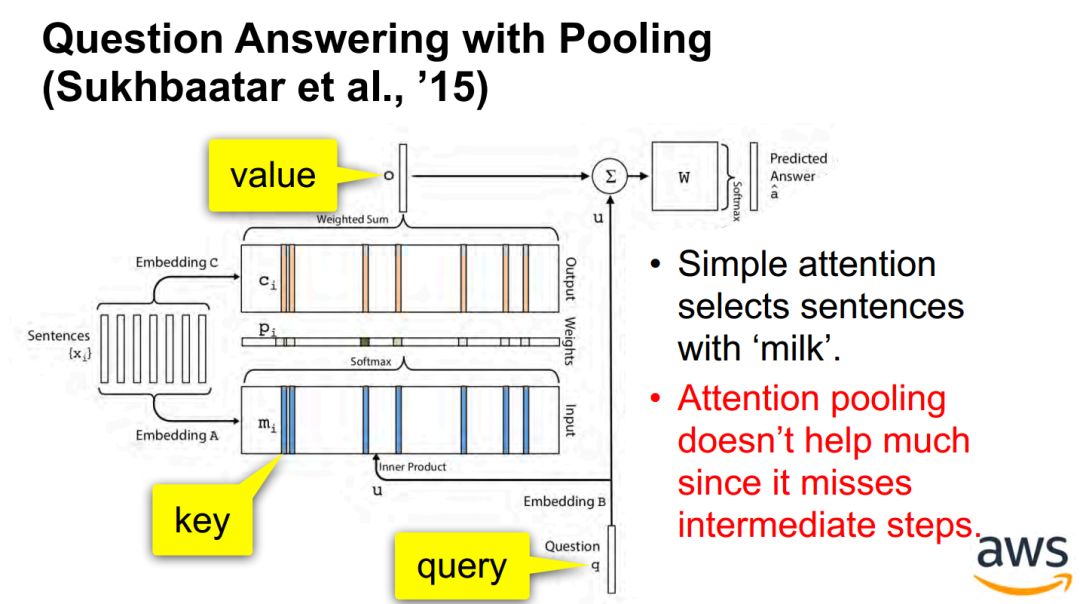

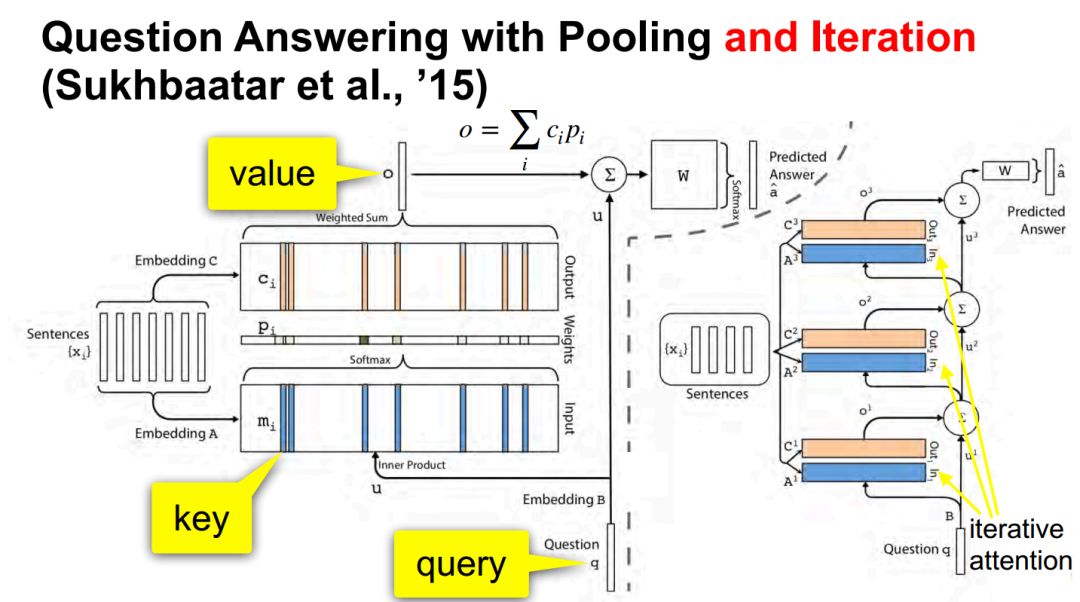

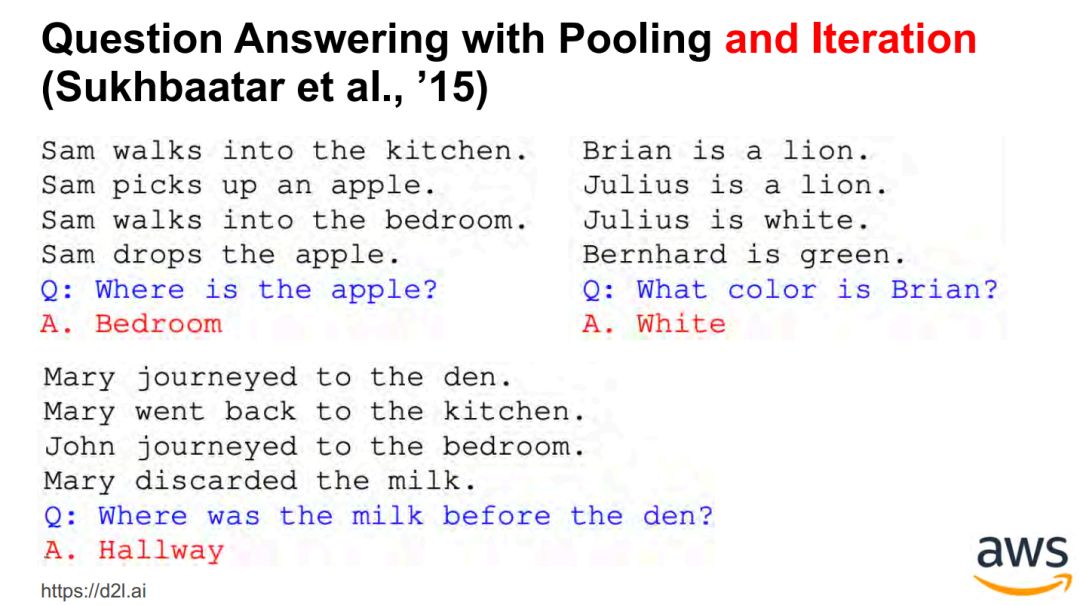

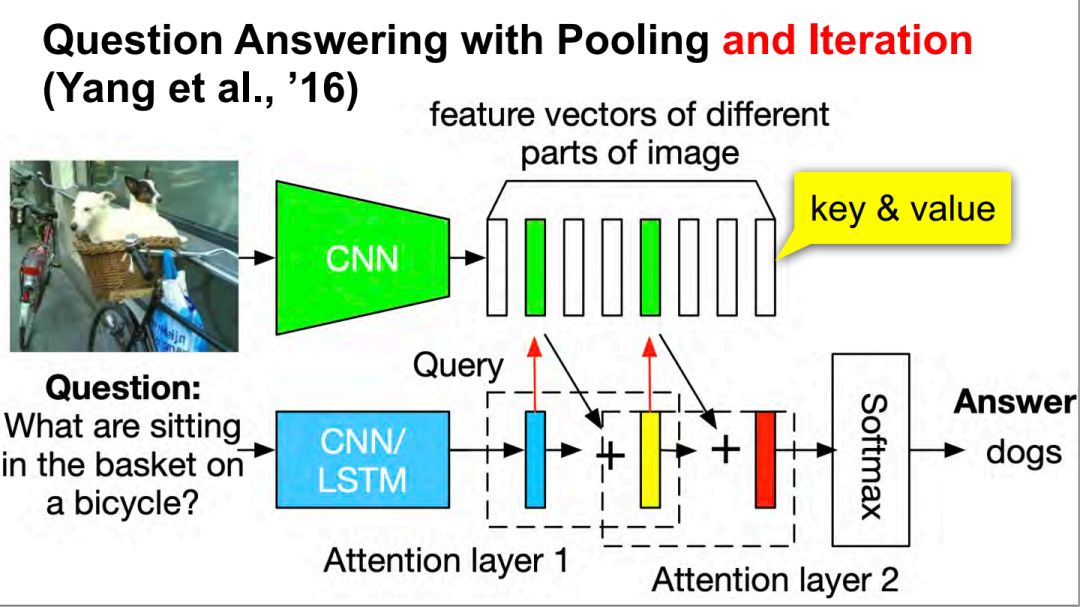

问答 Question answering / 记忆网络 memory networks

-

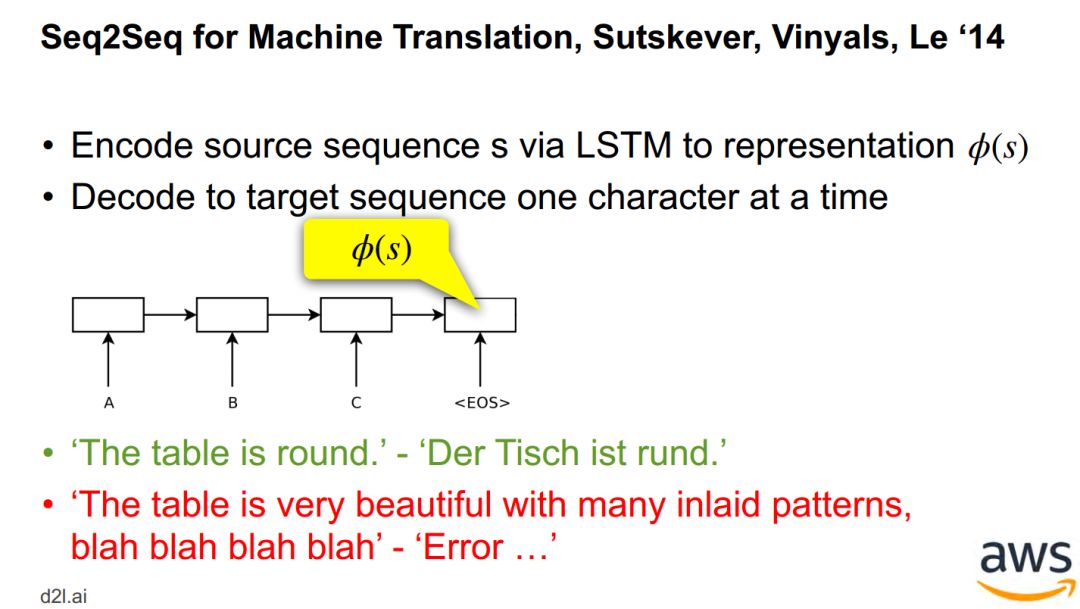

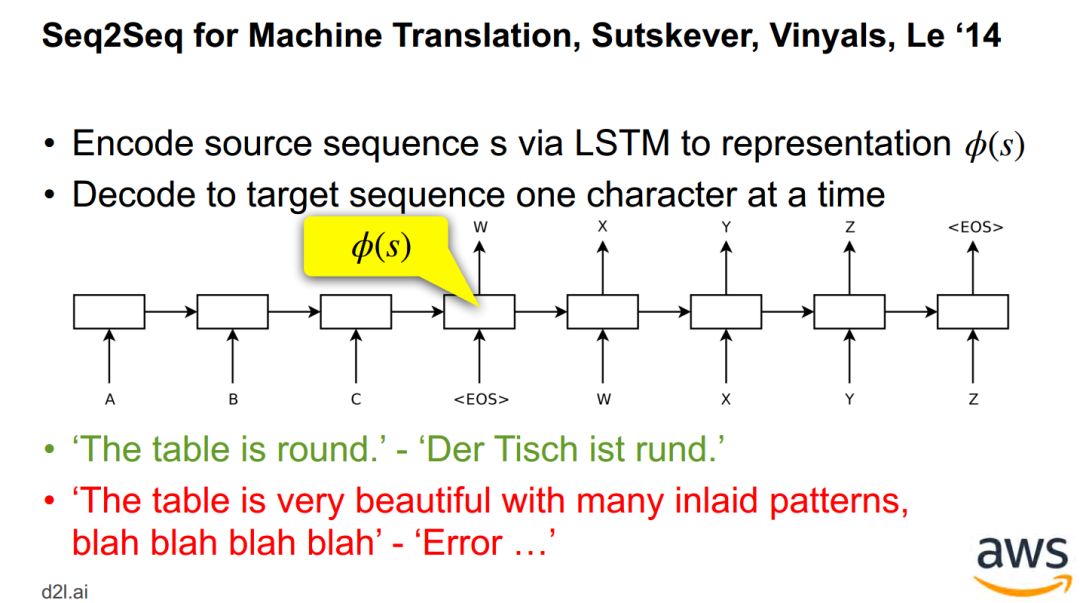

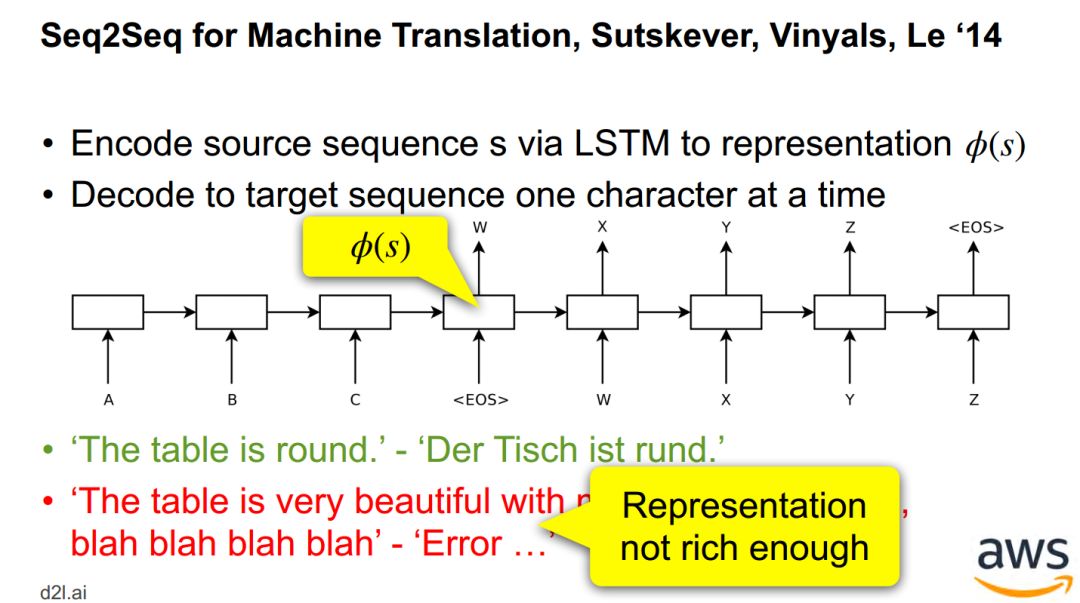

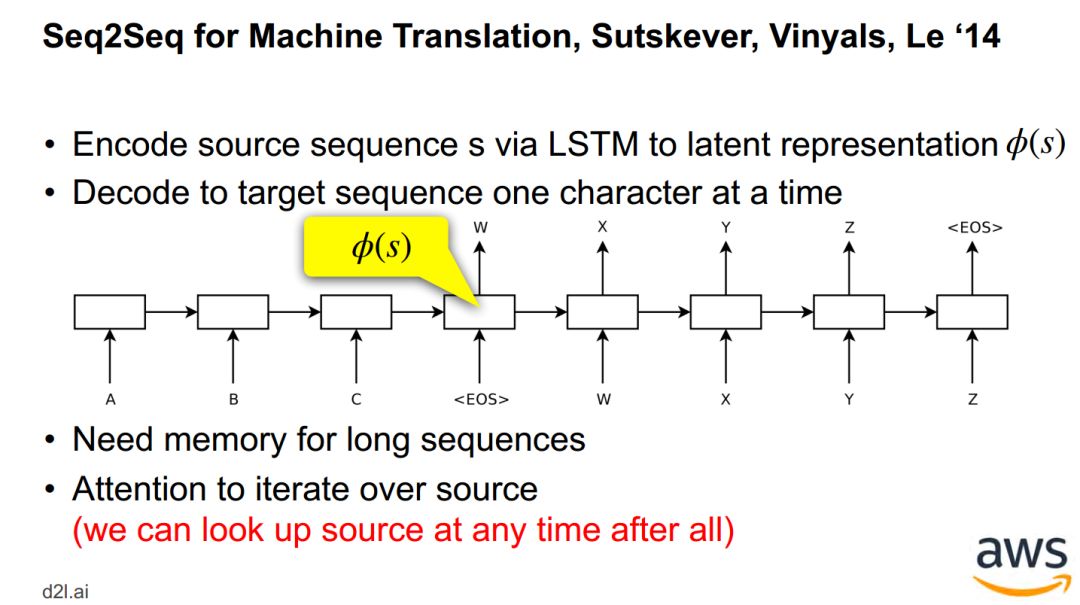

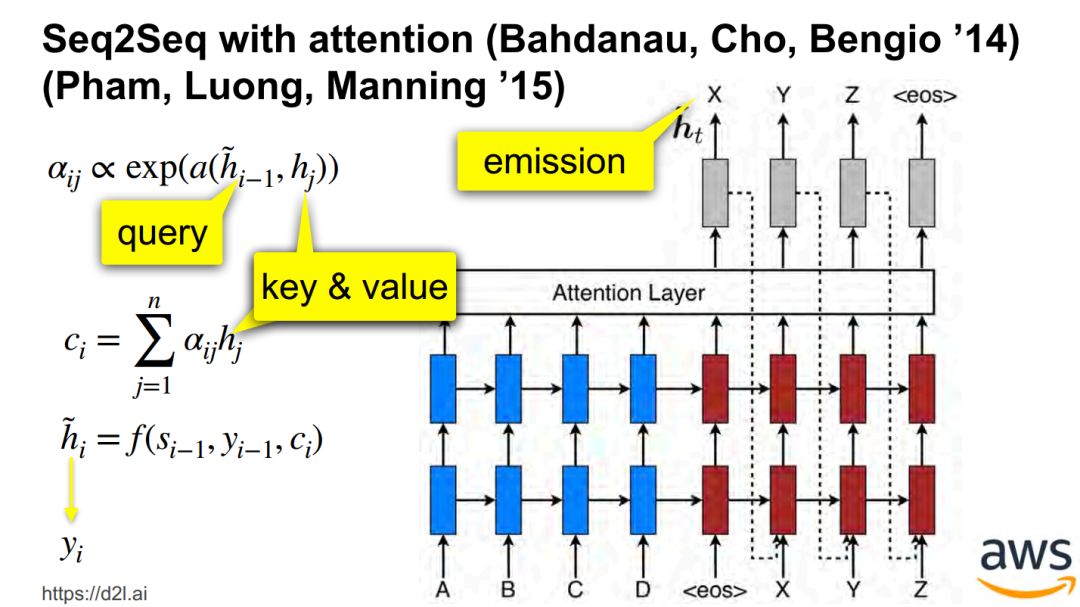

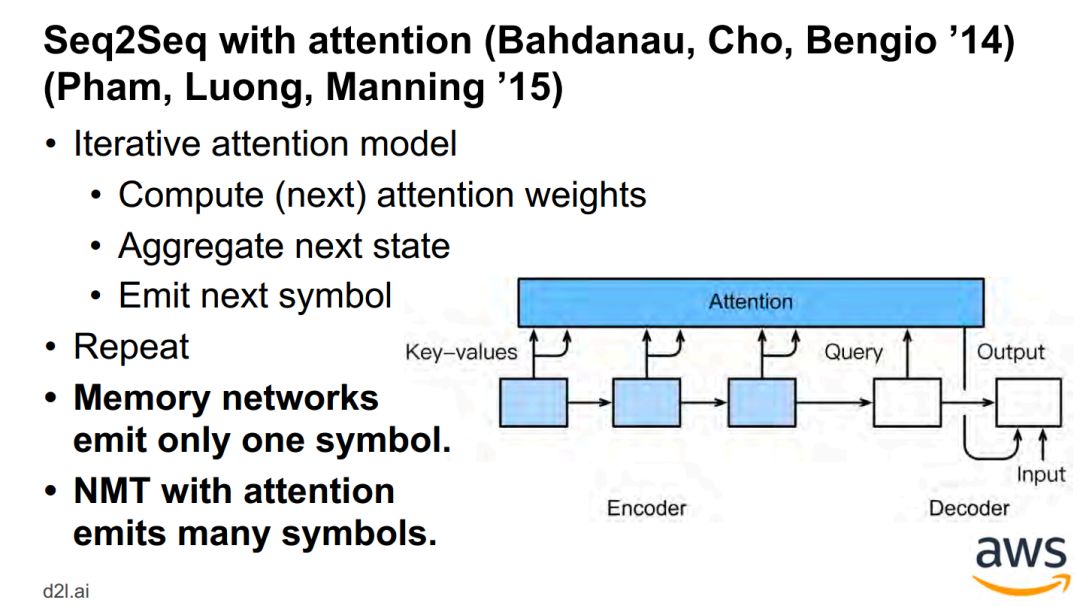

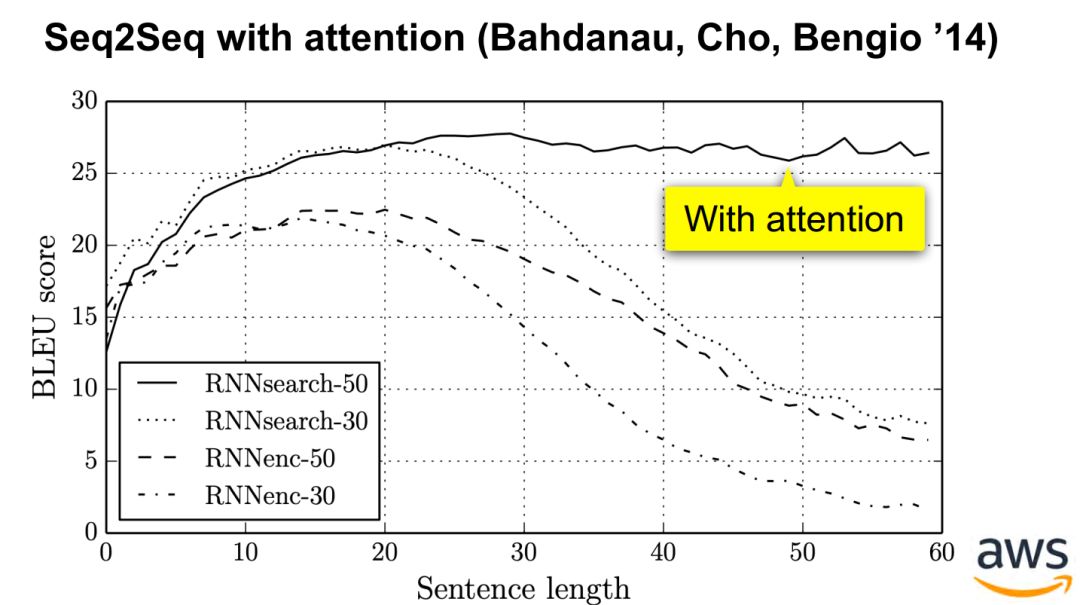

神经机器翻译

-

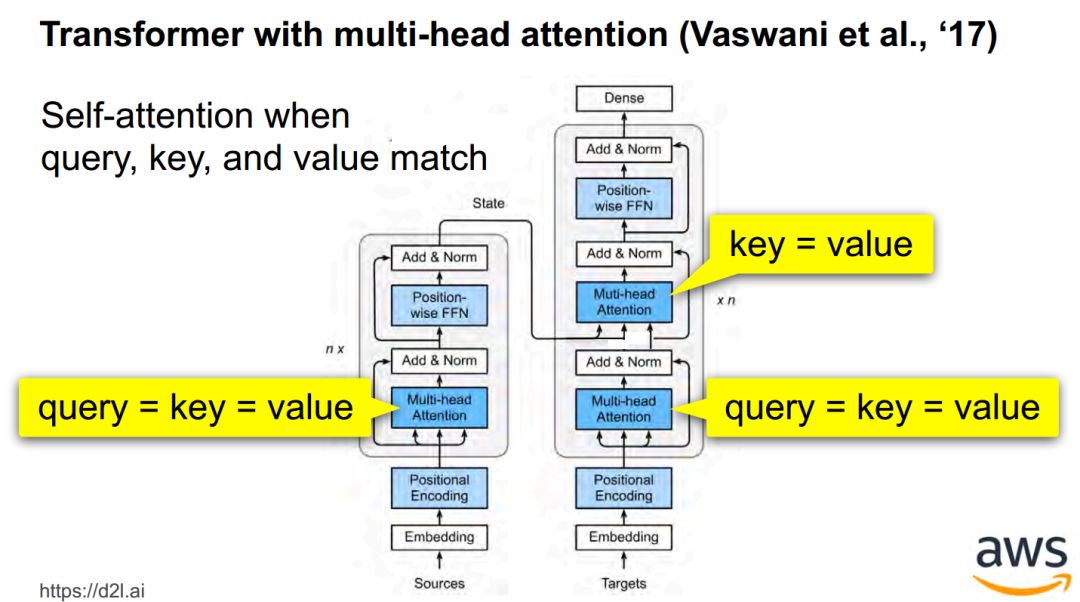

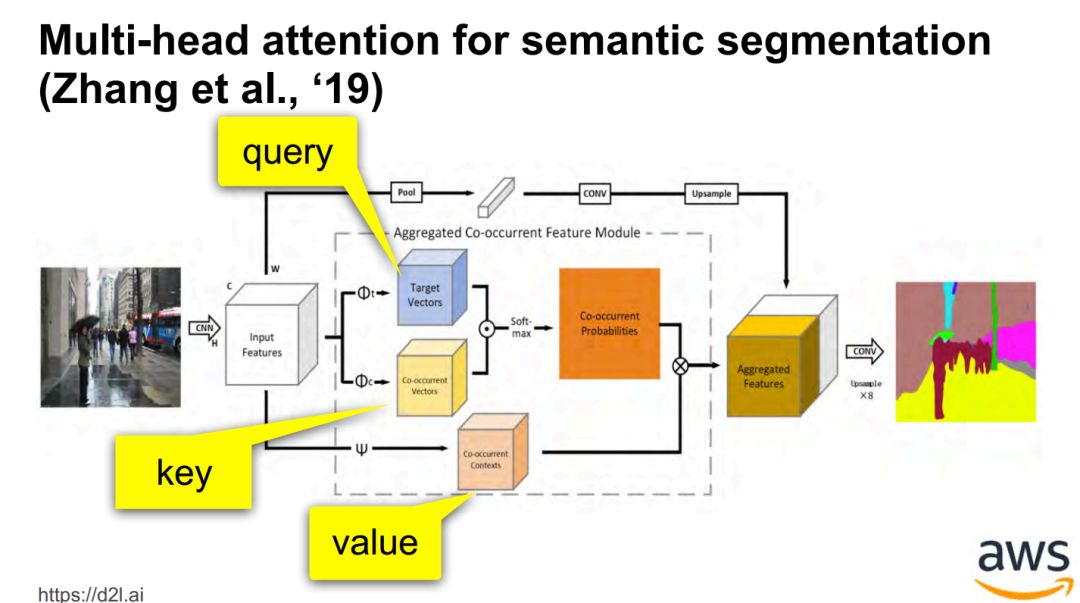

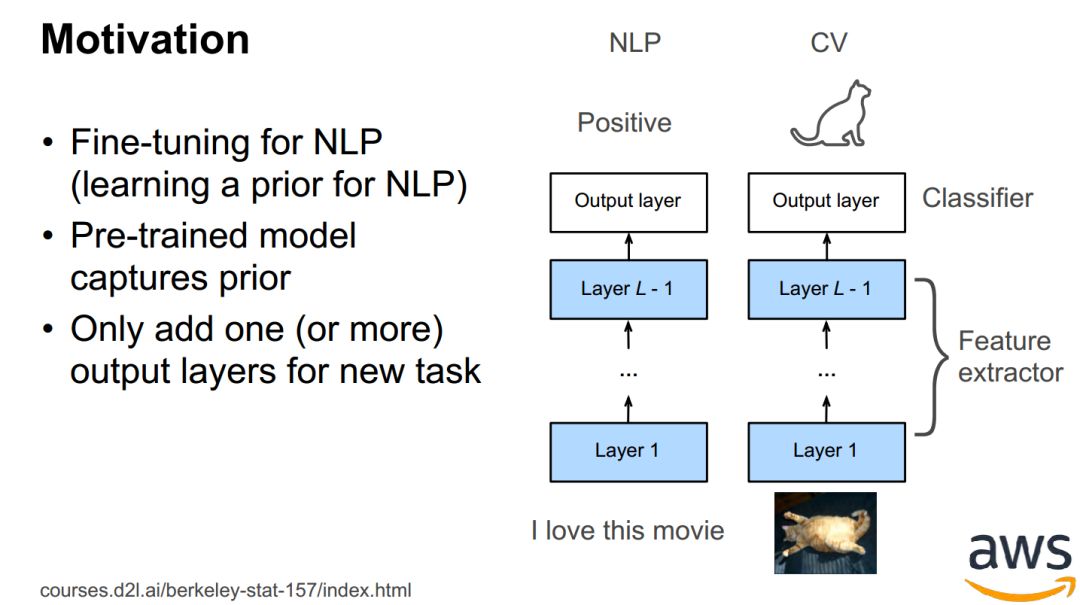

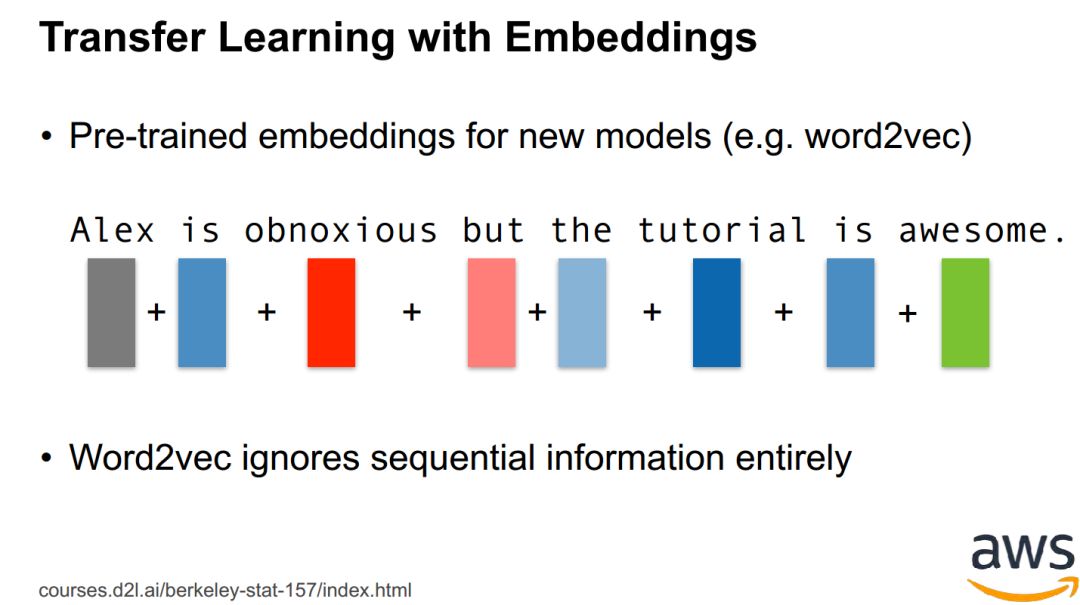

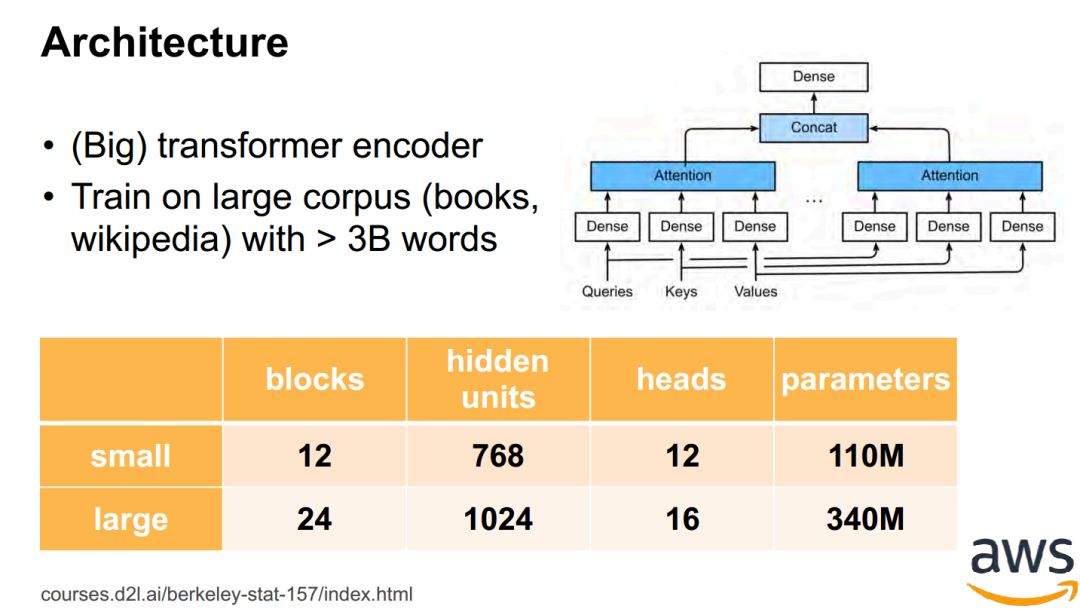

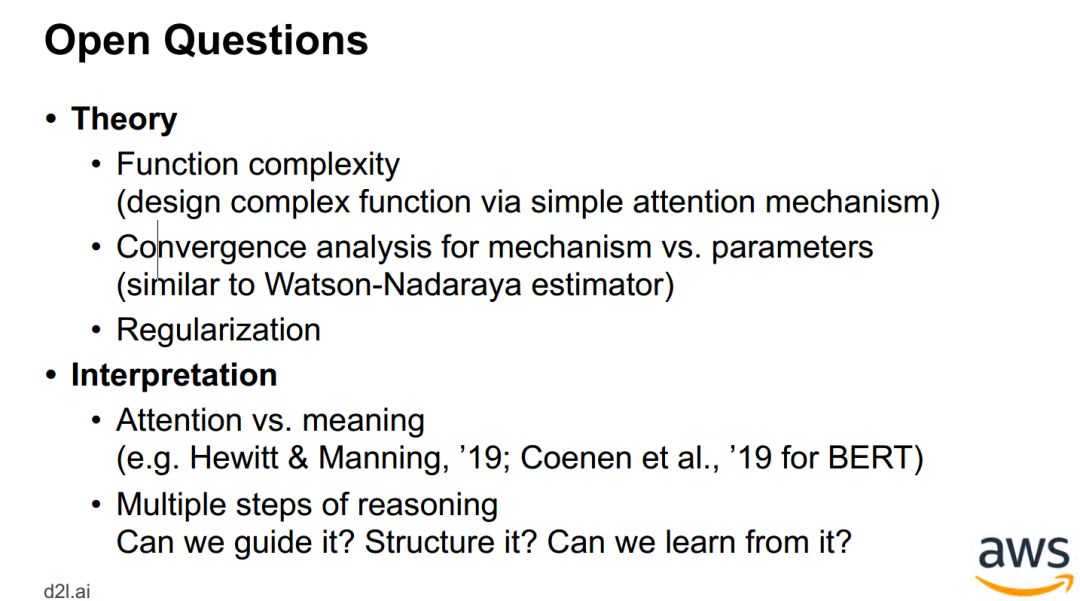

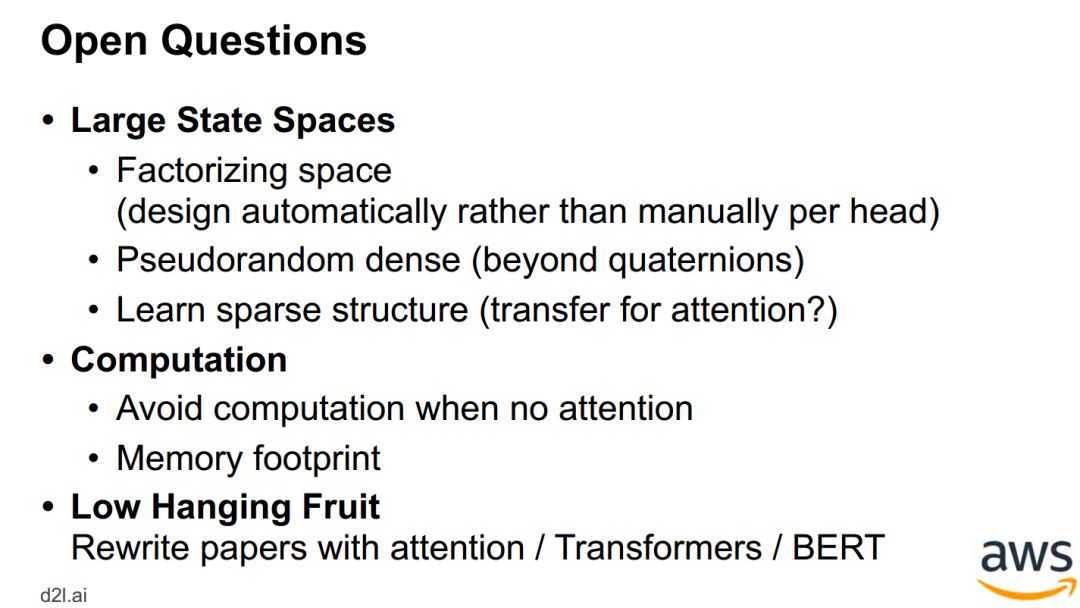

Transformers / BERT -

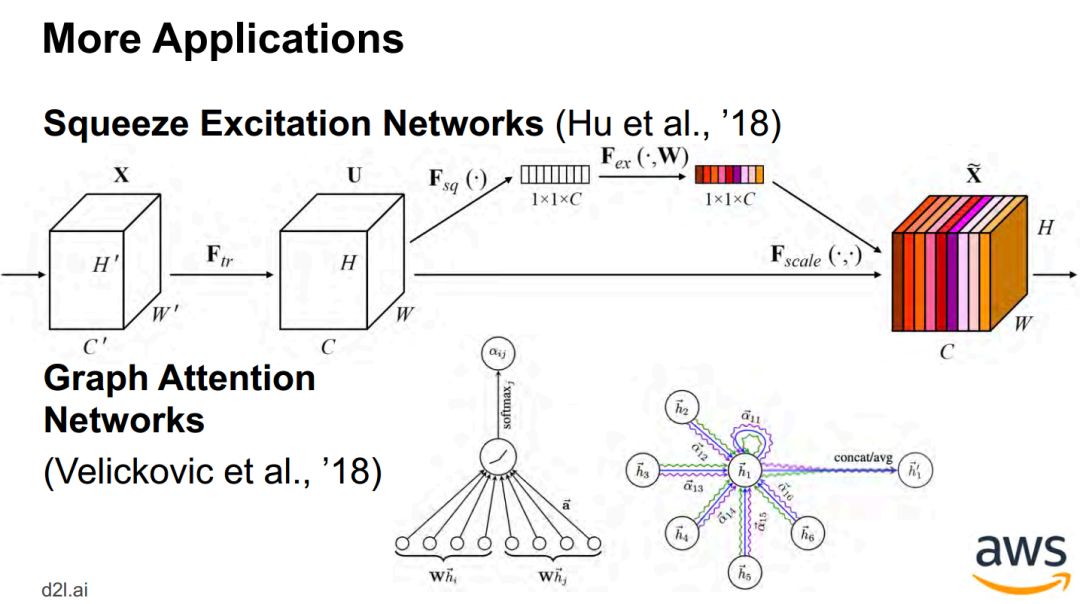

Lightweight, structured, sparse

-

后台回复“ADL” 就可以获取完整版《Attention in Deep learning》的下载链接~

-END-

专 · 知

专知,专业可信的人工智能知识分发,让认知协作更快更好!欢迎登录www.zhuanzhi.ai,注册登录专知,获取更多AI知识资料!

欢迎微信扫一扫加入专知人工智能知识星球群,获取最新AI专业干货知识教程视频资料和与专家交流咨询!

请加专知小助手微信(扫一扫如下二维码添加),加入专知人工智能主题群,咨询技术商务合作~

专知《深度学习:算法到实战》课程全部完成!560+位同学在学习,现在报名,限时优惠!网易云课堂人工智能畅销榜首位!

点击“阅读原文”,了解报名专知《深度学习:算法到实战》课程

展开全文