经典书《机器学习:概率视角》第二版Python代码,附1098页pdf下载

【导读】谷歌研究员Kevin Patrick Murphy撰写的经典机器学习图书,由MIT出版社出版,《Machine Learning: a Probabilistic Perspective》,自2012年发行以来就奉为经典机器学习书目。本书内容完整,讲解详细,便于阅读,方便工程使用。最近作者在Github上发布了关于本书的Python代码,更加方便使用!本文附带1098页pdf下载。

http://people.cs.ubc.ca/~murphyk/MLbook/

请关注专知公众号(点击上方蓝色专知关注)

后台回复“MLP” 就可以获取《机器学习:概率视角》1098页pdf下载链接~

机器学习:一种概率视角

这本书并没有描述一本关于不同启发式方法的烹饪书,而是强调了一种基于模型的机器学习方法。对于任何给定的模型,通常可以应用多种算法。相反,任何给定的算法通常都可以应用于各种模型。这种模块化,即模型与算法的区别,是一种很好的教学方法,也是一种很好的工程技术。

我们将经常使用图模型的语言以一种简洁和直观的方式来指定我们的模型。我们将看到,除了帮助理解之外,图结构还有助于开发有效的算法。然而,这本书主要不是关于图形模型的;它是关于概率建模的。

目录

Chapter 1: 引言 Introduction

Chapter 2: 概率 Probability

Chapter 3: 面向离散数据的生成式模型 Generative models for discrete data

Chapter 4: 高斯模型 Gaussian models

Chapter 5: 贝叶斯统计 Bayesian statistics

Chapter 6: 频率统计 Frequentist statistics

Chapter 7: 线性回归 Linear regression

Chapter 8: 逻辑回归 Logistic regression

Chapter 9: 广义线性模型和指数族 Generalized linear models and the exponential family

Chapter 10: 有向图模型(贝叶斯网络) Directed graphical models (Bayes nets)

Chapter 11: 混合模型与EM算法 Mixture models and the EM algorithm

Chapter 12: 隐式线性模型 Latent linear models

Chapter 13: 稀疏线性模型 Sparse linear models

Chapter 14: 核方法 Kernels

Chapter 15: 高斯过程 Gaussian processes

Chapter 16: 自适应基函数模型 Adaptive basis function model

Chapter 17: 马尔可夫模型和隐马尔可夫模型 Markov and hidden Markov Models

Chapter 18: 状态空间模型 State space models

Chapter 19: 无向图模型(马尔可夫随机域) Undirected graphical models (Markov random fields)

Chapter 20: 图模型精准推断 Exact inference algorithms for graphical models

Chapter 21: 变分推断 Variational inference

Chapter 22: 更进变分推断 More variational inference

Chapter 23: 蒙特卡洛推断 Monte Carlo inference algorithms

Chapter 24: 马尔科夫链蒙特卡洛推断 MCMC inference algorithms

Chapter 25: 聚类 Clustering

Chapter 26: 图模型结构学习 Graphical model structure learning

Chapter 27: 因变量 Latent variable models for discrete data

Chapter 28: 深度学习 Deep learning

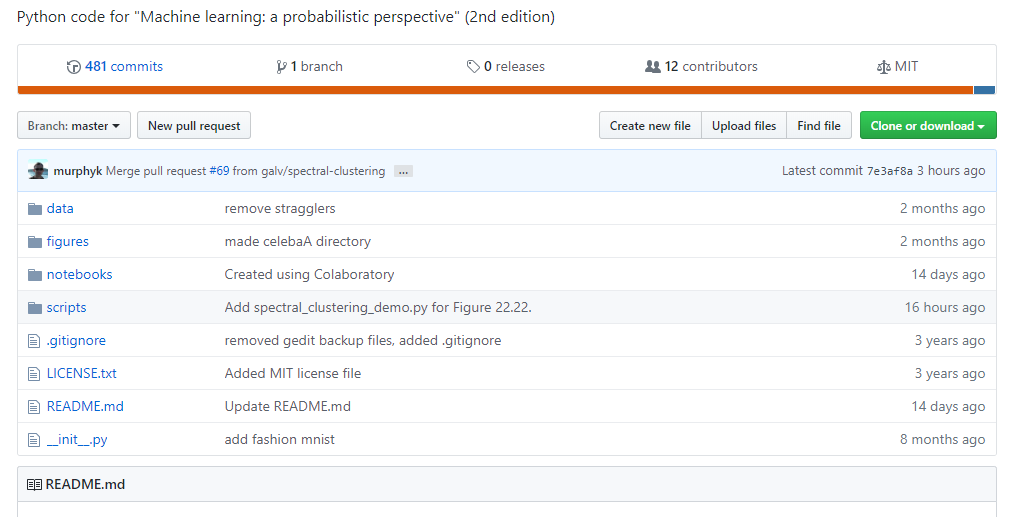

Python配套代码

《机器学习:概率视角》第二版的Python 3代码。这是正在进行的工作。

https://github.com/probml/pyprobml

Foundations

Introduction

Linear algebra

Calculus

Probability

Information theory

Bayesian statistics

Frequentist statistics

Statistical models

Algorithms

Optimization

Graphical model inference

Variational inference

Monte Carlo inference

Models

Generalized linear models

Deep neural networks

Graphical models

Visible generative models

Latent generative models

Gaussian processes

Models for graphs, manifolds and clusters

Reinforcement learning