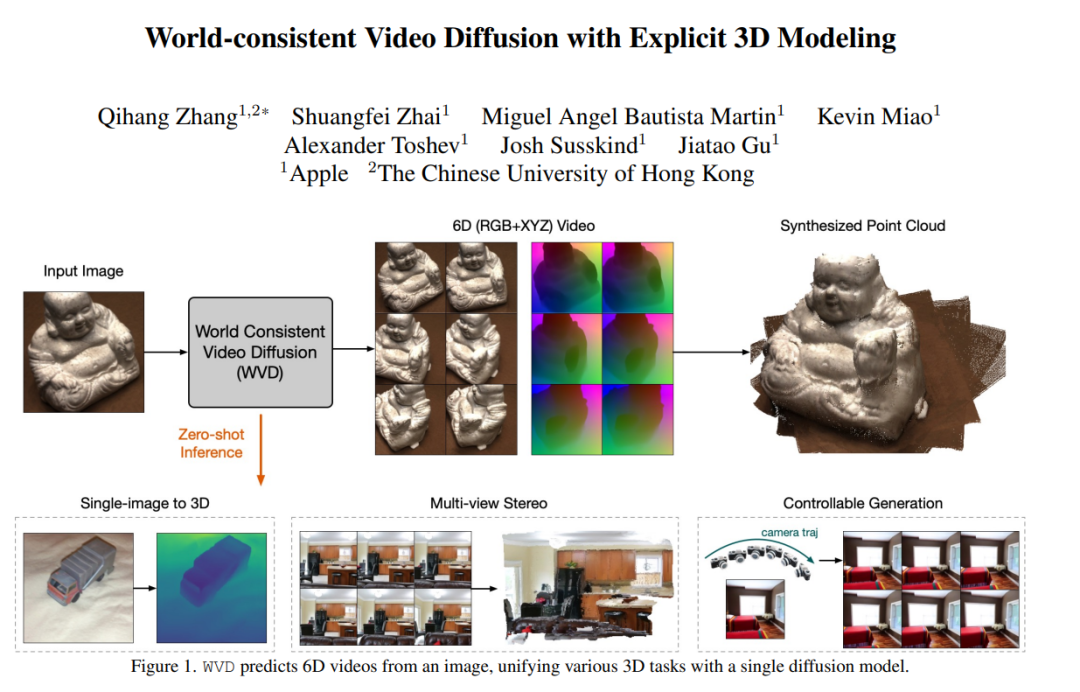

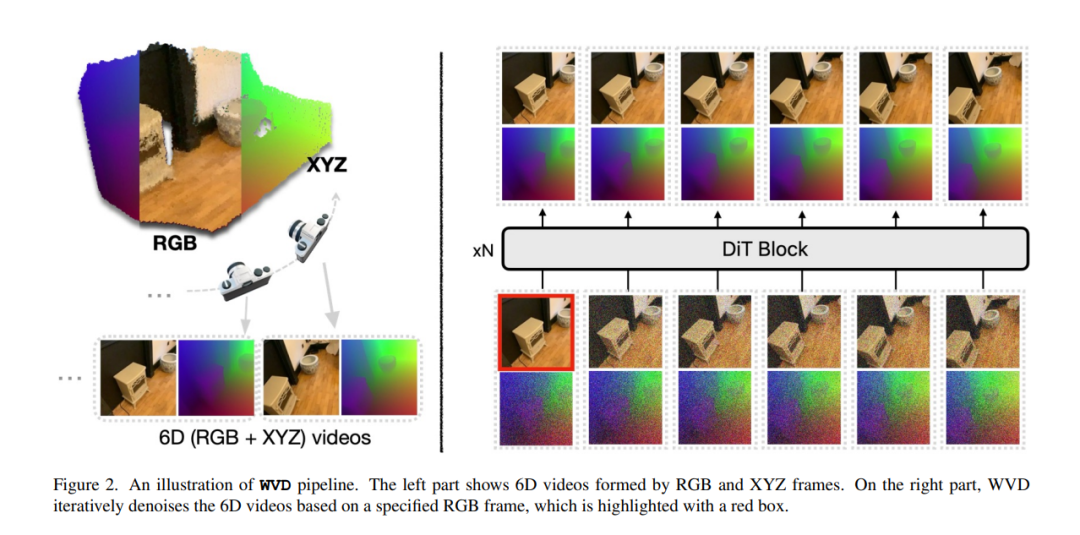

近期在扩散模型方面的进展设立了图像和视频生成的新基准,能够在单帧和多帧上下文中实现逼真的视觉合成。然而,这些模型仍然在高效且显式地生成3D一致性内容方面存在困难。为了解决这个问题,我们提出了世界一致性视频扩散(WVD)框架,这是一种新颖的框架,采用显式的3D监督,使用XYZ图像编码每个图像像素的全局3D坐标。 具体而言,我们训练了一种扩散变换器,来学习RGB和XYZ帧的联合分布。这种方法通过灵活的图像修复策略支持多任务适应性。例如,WVD可以从真实的RGB图像中估计XYZ帧,或者使用沿指定相机轨迹的XYZ投影生成新的RGB图像。通过这种方式,WVD统一了单图像到3D生成、多视角立体和相机控制的视频生成等任务。我们的方法在多个基准测试中表现出竞争力,提供了一个可扩展的解决方案,用于通过单一预训练模型生成3D一致性的视频和图像。我们的项目网站是 https://zqh0253.github.io/wvd。

成为VIP会员查看完整内容

相关内容

Arxiv

36+阅读 · 2023年4月19日

Arxiv

195+阅读 · 2023年4月7日

Arxiv

136+阅读 · 2023年3月29日