随着通用人工智能系统的迅速发展,使这些技术与人类价值、伦理与社会目标保持对齐已成为一项紧迫任务。传统方法通常将对齐视为一种静态的、单向的过程,而本教程将其重新定位为一种动态的、双向的关系:人在其中与 AI 系统不断相互适应。我们提出了一个结构化的人类–AI 对齐框架,并系统性地探讨如何在整个对齐流程中增强人类能动性。 本教程围绕三个核心领域展开:基础(AI 应与哪些价值对齐?)、方法(如何在系统各阶段赋予人类更大的对齐主导权?)、以及实践(AI 部署会带来哪些社会技术影响?)。课程最终将以一个跨学科专家小组讨论作为总结,四位领先学者将围绕新兴的挑战与未来研究方向展开对话。 本教程旨在为参与者提供关键的概念基础、实用的方法论,以及对不断演进的对齐生态的批判性视角。包括幻灯片、代码资源与录制内容在内的全部材料都将在我们的教程网站上公开获取。

https://hai-alignment-course.github.io/tutorial/

1 描述(Description)

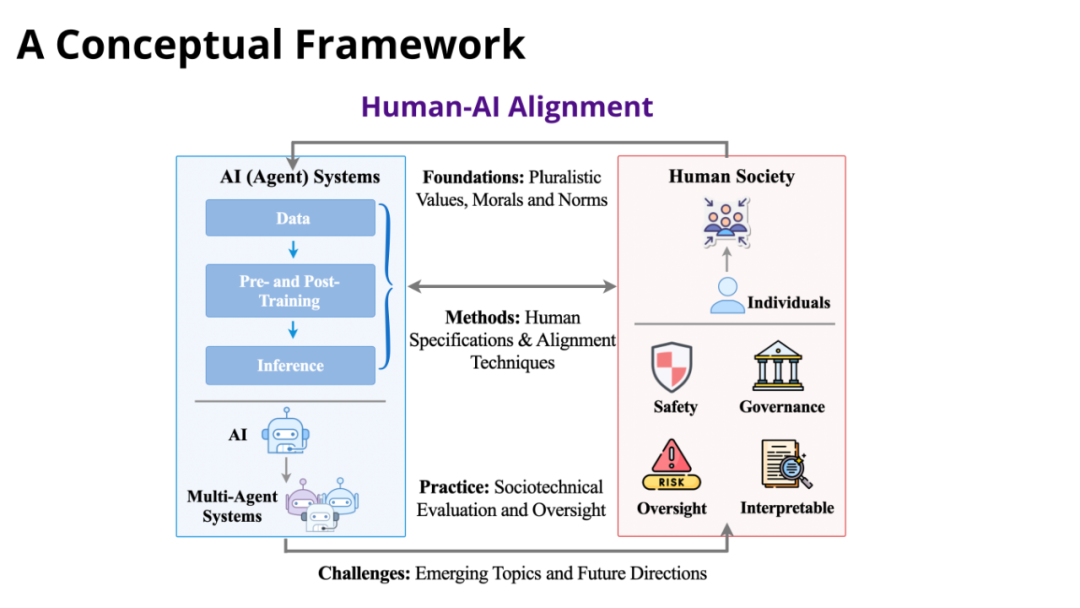

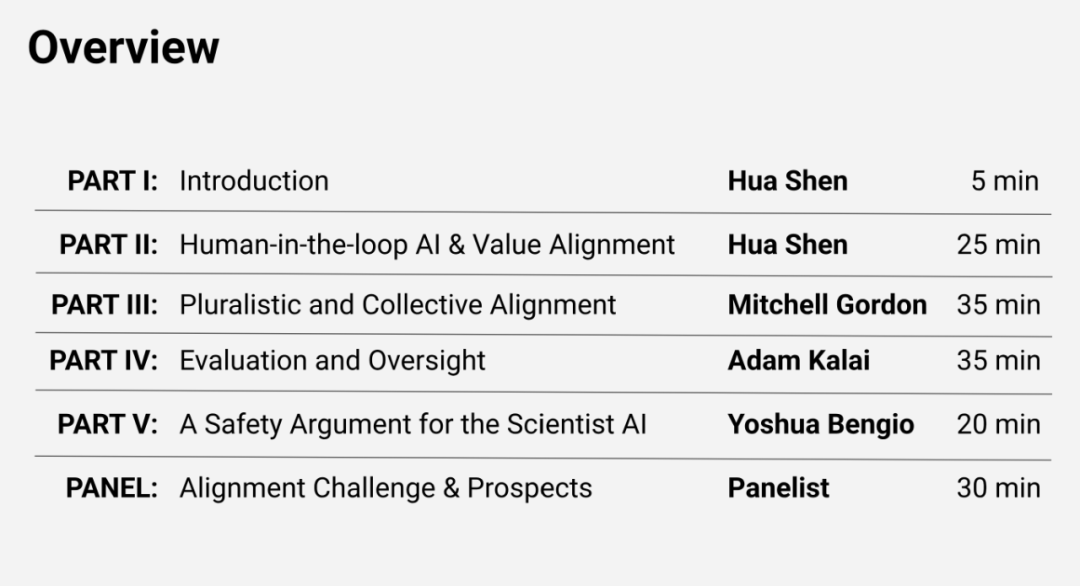

通用人工智能的快速发展带来了一个迫切需求:使这些系统与人类价值、伦理原则以及社会目标保持对齐。该挑战被称为 AI 对齐(AI alignment)[1],它对于确保 AI 系统既能有效运作,又能在最小化风险的同时最大化社会收益具有关键意义。传统上,AI 对齐常被视为一种静态的、单向的过程,旨在引导 AI 系统实现期望结果并避免不良后果[2]。然而,这种单向视角已难以满足需求,因为 AI 系统正以动态且难以预测的方式与人类交互,形成反馈循环,影响着 AI 的行为与人类的反应[3]。这种不断演化的互动关系要求我们从根本上转向一种认识——即人类与 AI 之间关系的双向性与适应性[4]。 尽管以往的对齐教程主要将 AI 对齐视为一种满足人类与机构预期的静态拟合过程,本教程则将对齐重新定义为人类与 AI 之间持续演化的互动过程。为阐明人类与 AI 在对齐中的动态角色,我们提出了一个人类–AI 对齐(Human-AI Alignment)概念框架(见图 1),并系统性地解释人类如何能够在对齐流程的各个阶段获得更强的作用能力。具体而言,本教程围绕三个核心问题展开探讨: 1. 基础(Foundations)——人类期望 AI 与哪些价值与规范对齐? 1. 方法(Methods)——如何在构建对齐 AI 的过程中赋能人类? 1. 实践(Practice)——AI 对人类与社会的社会技术影响是什么?

同时,为激发讨论并推动未来研究方向,本教程也将通过综合讨论的形式系统探讨第四部分: 4. 挑战(Challenges)——由三位主讲人与四位跨领域讨论嘉宾,从新兴议题与开放问题出发,对人类–AI 对齐的未来展开深入讨论。

目标(Goals)

本教程旨在通过以下四大目标为受众带来价值: 1. 全面概览(Comprehensive Overview):提供一个系统化的人类–AI 对齐整体视角,突出人类在对齐流程中的持续参与。 1. 知识与理解(Knowledge and Understanding):提供与人类价值、对齐技术以及 AI 社会影响相关的系统知识。 1. 实践技能(Practical Skills):通过交互式代码笔记本与动手练习,使参与者能够掌握可操作的工具,并在多类 AI 系统中实现基本的对齐策略。 1. 促进讨论(Facilitate Discussion):推动对未来挑战、开放问题与新兴机会的批判性讨论,为参与者未来的研究工作提供灵感。

重要性与影响(Importance and Impacts)

由于当前对齐框架难以充分应对现存的对齐挑战,对掌握人类–AI 对齐全景(包括技术基础与社会技术影响)的专业人才需求正不断上升。本教程旨在弥补这一缺口,使参与者能够在对齐研究、政策制定以及实际部署中发挥有意义的作用。 通过兼顾概念框架、技术方法与批判性讨论,本教程确保参与者能够全面理解当前对齐研究的真实状态,而不会将对齐视为一个已经解决的问题。互动式专家讨论环节进一步培养了受众分析快速演进领域所需的批判性视角与判断能力,使其能够在未来推动人类–AI 对齐方向的深化与创新。