摘要——边缘通用智能(Edge General Intelligence, EGI)代表了移动边缘计算的一种范式转变,即智能体能够在动态且资源受限的环境中自主运行。然而,将先进的智能体 AI 模型部署在移动端和边缘设备上仍面临显著挑战,主要源于有限的计算能力、能耗预算与存储资源。为应对这些限制,本文综述探讨了将知识蒸馏(Knowledge Distillation, KD)融入 EGI 的方法,并将 KD 定位为实现无线边缘高效、通信感知与可扩展智能的关键推动力。特别地,我们强调了为无线通信和移动网络专门设计的 KD 技术,如信道感知的自蒸馏、跨模型信道状态信息(Channel State Information, CSI)反馈蒸馏,以及鲁棒的调制/分类蒸馏。此外,我们回顾了天然适用于 KD 与边缘部署的新型架构,如 Mamba、RWKV(Receptance、Weight、Key、Value)以及跨架构蒸馏,它们能够增强模型的泛化能力。随后,我们讨论了多类应用,其中基于 KD 的架构在视觉、语音与多模态任务中实现了 EGI。最后,我们指出了 KD 在 EGI 中的关键挑战与未来方向。本文旨在为研究者在 EGI 时代探索面向移动智能体 AI 的 KD 驱动框架提供全面参考。

关键词——边缘通用智能(EGI)、移动智能体 AI、知识蒸馏(KD)、无线边缘智能

I. 引言

A. 背景

移动边缘计算市场正在经历显著增长,预测显示其市场规模将从 2024 年约 16.5 亿美元增长至 2032 年超过 135 亿美元¹。推动这一增长的动力主要来自对低时延计算以及更高质量体验(QoE)的需求,而移动与物联网设备的数量正快速攀升。这样的发展格局催生了一场重要的技术变革,即所谓的“智能体化(agentification)”,通过集成大型语言模型(LLMs)和其他先进 AI 模块,使边缘设备具备自主能力。这一转变将传统被动的边缘节点转化为主动的移动智能体 AI 系统,使其能够感知环境、进行推理,并在无须人工干预的情况下执行复杂的多步骤任务。 这一智能体中心的范式具有多重优势。移动智能体 AI [1] 能够实现更高程度的自动化与个性化,因为智能体可以学习用户偏好并在设备本地实时适应动态场景。本地计算显著降低了时延,并通过减少对集中式云服务器的依赖提升了数据隐私。此外,这些智能体可以主动预判问题、优化流程,并在不同系统之间协同操作,从而提升运行效率、加速问题解决、增强服务灵活性。通过在网络边缘嵌入复杂的认知能力,移动智能体 AI 为更加智能、响应迅速且安全的应用铺平了道路,这是迈向 EGI 的关键步骤。EGI 被定义为:边缘设备在严格的资源与时延约束条件下,能够执行类似云端 AI 的通用推理与问题求解能力 [2]。 EGI 的实现依赖于移动智能体 AI 的部署。LLMs 为这些智能体提供了认知引擎,在规划、推理和工具使用方面展现出卓越能力。然而,LLMs 巨大的计算、存储与能耗需求与移动端和边缘设备的资源受限特性根本不兼容 [3]。这种“部署鸿沟”是实现 EGI 愿景的首要障碍。 为弥合这一差距,知识蒸馏(Knowledge Distillation, KD)作为一种压缩大型模型的关键方法应运而生。KD 指的是训练一个较小的“学生”模型去模仿一个更大、更强的“教师”模型的行为。这使得学生模型能够在紧凑的模型规模中保留教师的高级能力,从而适用于资源受限的边缘硬件部署 [4]。

B. 与相关综述的比较及本文贡献

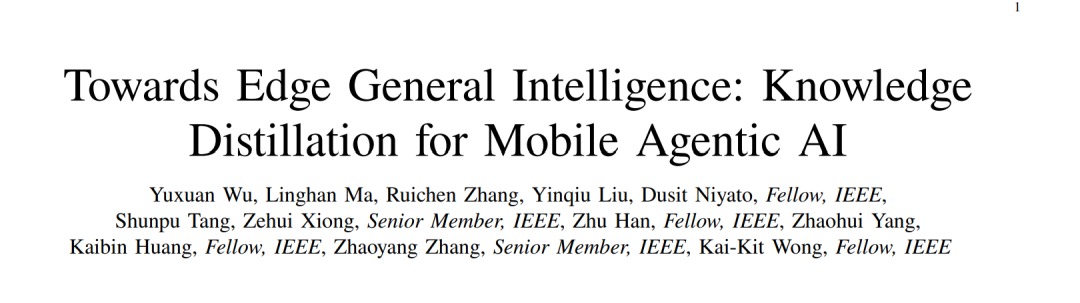

利用 KD 推进智能体 AI 并实现其在 EGI 中的部署,已展现出巨大潜力,可显著降低计算开销并增强其在动态无线环境中的适应性。本文旨在提供关于 KD 基础、其在智能体 AI 中的应用,以及支撑 EGI 部署的新型技术的全面综述。表 I 展示了相关综述的深入比较,重点强调 KD、智能体 AI,以及它们在 EGI 中的实现方式。

现有综述主要关注 KD 的发展与优化。例如,Gou 等人 [9] 提供了 KD 的基础性综述,详细介绍了知识类型、训练策略和师生架构等核心组成部分。 此外,也有若干综述研究智能体式 AI 的应用。Hosseini 等人 [1] 回顾了智能体式 AI 在组织中的变革性作用,强调其核心特性以及从“人类辅助 CoPilot”向“自主 Autopilot”模型的战略性迁移。Wu 等人 [8] 则综述了多模态移动智能体的领域,将其方法分为基于提示与基于训练两类,并比较了它们在移动设备上的部署效果。 与此同时,越来越多的研究展示了智能体式 AI 在推动 EGI 发展中的重要性。Xu 等人 [5] 提供了关于边缘智能的全面综述。随着强大 LLMs 的发展,EGI 的研究在最近几年迅速增长。Chen 等人 [2] 提供了基于 LLM 的 EGI 分类框架,将其分为集中式、混合式和去中心化系统,并回顾了其实现方式。He 等人 [6] 提出,将基础模型集成至边缘系统是迈向 EGI 的关键方向,并给出了未来研究挑战。围绕智能体认知核心,Zhao 等人 [7] 则分析了世界模型如何为智能体 AI 提供主动规划与推理能力,使其能够在边缘侧运行。 然而,现有研究缺乏对适用于 EGI 约束条件的系统化 KD 方法的深入探讨,同时也缺乏对智能体 AI 在边缘环境中所面临的资源限制与模型适应性挑战的全面分析。本文填补这一空白,对先进的模型自适应技术(如无线蒸馏 [10]–[13]、以及为边缘而设计的新型架构 [14]–[17])进行系统性讨论。此外,我们展示通过 KD 如何有效适配多种 EGI 部署场景,如自动驾驶车辆 [18], [19]、无人机(UAV)[20], [21]、机器人 [22], [23],以及其他物联网应用 [24]–[26]。 本文的主要贡献总结如下: * 我们针对无线通信场景提供了 KD 技术的专门回顾,强调 KD 如何提升信道估计、反馈压缩以及无线边缘的资源高效模型部署能力。

我们系统综述现有 KD 技术及其优势,强调其与新型架构集成的潜力,并进一步全面讨论在 EGI 中结合 KD 与这些架构所带来的机遇。

我们分析现有模型的局限性,并基于这些不足,介绍超越 Transformer 的新型架构,以及与知识蒸馏结合的调优技术,以适配边缘设备部署需求。

我们进一步从技术与伦理两个维度分析当前 EGI 面临的挑战,并提出潜在的未来发展趋势与解决方案。

C. 本文结构

**

**

本文结构如图 1 所示。 第 II 节介绍 EGI、移动智能体 AI 与知识蒸馏的基本概念,并进一步阐述三者之间的相互关系。随后,第 III 节系统阐述了将 KD 融入 EGI 的新型架构与无线蒸馏方法,并展示现有模型取得的研究进展。第 IV 节描述 KD 在 EGI 中的作用及其在多个特定领域的应用。最后,第 V 节总结本综述的经验与目前领域面临的挑战,并从技术与宏观层面提出未来研究方向。

Agentic AI 提供了一个自主的“感知–规划–行动–记忆”循环,而 EGI 则将这一范式扩展到网络边缘,使其能够在严格资源约束下获得广义认知能力。二者共同勾勒出智能化、可适应与自主的边缘系统统一愿景。

A. 智能体式 AI 的兴起与边缘通用智能的愿景

1) 移动智能体式 AI:

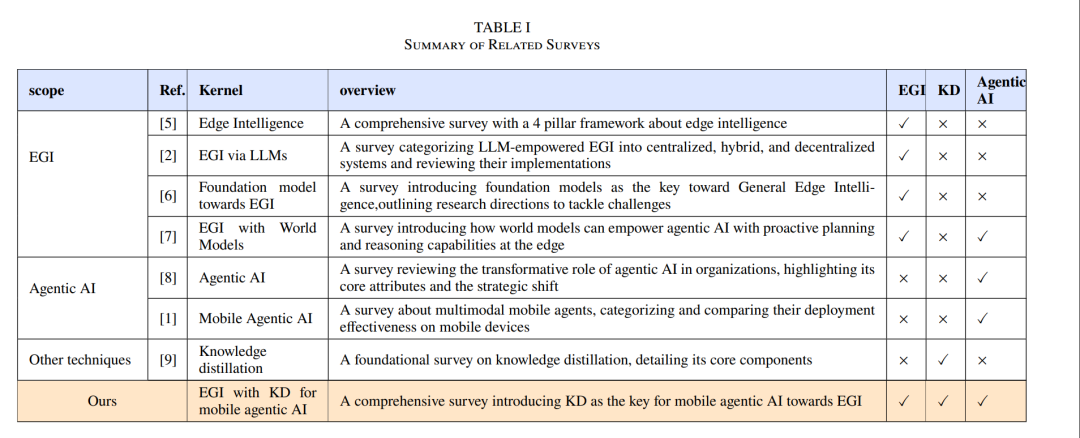

智能体式 AI 指能够在最少人工监督下,通过感知、推理、规划和行动来实现目标的自主系统 [8]。这些系统在一个连续循环中运行,通常称为 智能体循环(agentic loop),由四个核心模块组成:感知(Perception)、规划(Planning)、行动(Action)和记忆(Memory) [8]。

• 感知(Perception):

感知模块整合多模态信息,以形成对环境的连贯理解。如图 2 所示,该过程从物理传感器或数字通道采集数据开始。随后对原始数据进行处理,以提取关键特征并识别相关实体及其属性。

• 规划(Planning):

规划模块负责制定一系列行动以实现高层目标,通常利用 LLM 作为认知核心。如图 2 所示,智能体规划由静态、预定义的动作序列向动态规划演进——智能体会根据环境反馈持续更新计划,从而确保强健的适应性。

• 行动(Action):

智能体执行所选动作,与环境交互并对其产生影响。动作种类包括模仿人类使用图形用户界面(GUI)进行点击或输入 [27](见图 2),或通过 API 调用进行更深层的系统集成,如修改设备设置或自动化应用导航。在多智能体系统中,通信本身也是关键行动,使智能体能够协调并分配任务 [27]。

• 记忆(Memory):

记忆模块使智能体能够跨时间保留信息,提供连贯交互所需的上下文,并支持持续学习。如图 2 所示,记忆通常分为两层: * 短期记忆: 维护当前会话的上下文,通常由 LLM 的上下文窗口管理; * 长期记忆: 跨会话存储知识,如已学习的事实和经验,通常由外部向量数据库实现。智能体通过相似度检索访问该知识库,这是检索增强生成(RAG)的核心机制。

此外,**协作(Coordination)与适应(Adaptation)**是智能体式 AI 处理动态环境中长时任务的关键能力 [28], [29]。 * 协作通过动态多智能体协同实现,使多个智能体交互以达成共享目标 [29]; * 适应则是智能体从环境中学习并实时调整行为以追求高层目标的能力 [28],其根本依赖于集成记忆系统与强化学习 [30]、终身学习 [31] 等机制。

强健的协作协议与记忆驱动的适应性之间的协同,使现代智能体式 AI 与众不同,为更鲁棒、更自主的系统铺平道路。

当其部署在无线与边缘计算环境中时,智能体循环的每一部分都必须在有限计算、存储与通信带宽的约束下运行。这一挑战推动了通信协议设计的重大转变:从追求原始吞吐量转向 语义效率(semantic efficiency) 的范式,即优先传输简洁且高价值的信息,而非冗长原始数据 [32]。 面向 6G 的新兴框架提出“内容感知”网络,可智能地优先处理语义关键数据,模糊应用层与网络层的界限,使网络从被动管道转变为信息交换的主动参与者 [32]。

2) 边缘通用智能(EGI):

EGI [2] 是一种变革性范式,旨在使边缘设备具备通用的认知能力,使其能够在动态环境中自主地感知、推理与行动。EGI 的终极愿景是在网络边缘实现人工通用智能(AGI):系统不仅能够理解、推理、规划和从经验中学习,且具备接近甚至超过人类水平的认知能力。 与传统边缘智能主要依赖静态、任务特定模型不同,EGI 强调: * 通用性(versatility)

可适应性(adaptability)

自主认知推理(autonomous cognitive reasoning) [5]

为此,EGI 依赖基础模型,使设备能够在无需频繁再训练的情况下执行多类任务,并在实时中动态适应上下文与环境变化。

这种智能根植于“知识”这一更深层概念,它不仅包括事实信息,还包括复杂推理模式、上下文理解与在大规模数据中学习到的决策能力。EGI 的架构在“知识如何分布”上形成一个连续谱:

• 集中式架构:

由云端强大的 LLM 提供全部知识,负责复杂推理与规划;边缘设备仅承担数据采集与命令执行。

• 去中心化架构:

通过在每个边缘设备上部署中等规模或小型语言模型(SLM),使其拥有自身知识库,实现本地推理与点对点协作 [33]。

• 混合式架构:

在二者之间取得平衡: * 本地 SLM 提供关键的、常用的低时延知识; * 云端 LLM 处理大范围、更深层的认知任务。

EGI 的潜在应用场景广泛且具有颠覆性,将重塑多个领域的人机交互方式,包括自动驾驶、工业自动化、智慧城市与个性化医疗等。 **

**

**

**